#101「データ活用を阻む「無意識のワナ」──アンコンシャスバイアスがDXを狂わせる理由(バイアス#1)」

第65回「デジタル社会の敵:アンコンシャスバイアスとは? -認知バイアスの仕組み-(認知バイアス# 1)」デデデータ!!〜“あきない”データの話〜の台本をベースにnote用に再構成したものです。

はじめに

「アンコンシャスバイアス」という言葉を耳にする機会が増えた。これは日本語で「無意識の偏見」と訳されることもあるが、実際にはどのような場面で、どのように影響を及ぼすものなのか。

私は企業の組織改革やDX(デジタルトランスフォーメーション)の現場に携わる中で、技術導入やデータ利活用を検討する際、必ずといっていいほど「人」にまつわる問題に行き当たってきた。その中でも特に根が深いと感じるのが、人間が無意識に抱く認知的な偏りである。いくら最新のテクノロジーを導入しても、最終的に判断や評価を下すのは人間だ。そこに「バイアス」が潜んでいると、多様性を失い、有望なアイデアを排除し、結果としてDX推進の大きな阻害要因になる。

今回は、認知バイアス特集の初回として、アンコンシャスバイアスとは何かを整理し、有名な思考実験である「リンダ問題」を通じてバイアスが生じるメカニズムを探る。さらに、なぜDXや組織変革を歪めるのか、どうすればバイアスを抑えられるのかといったポイントを、心理学や行動経済学の理論を交えながら考察してみたい。

1. アンコンシャスバイアス(無意識の偏見)とは何か

アンコンシャスバイアス(Unconscious Bias)とは、無意識に形成される偏見や先入観を指す。心理学では認知バイアス(Cognitive Bias)の一種と位置づけられ、人間の意思決定プロセスをさまざまな形で歪める可能性がある。

人間は日々膨大な情報に触れており、それを逐一論理的に精査するのは膨大な負荷を伴う。そこで脳は、過去の経験や文化的なステレオタイプをもとにした「思考のショートカット(ヒューリスティック)」を活用して、素早く判断する。

この仕組み自体は生存戦略として有効に機能してきたが、社会の複雑性や多様性が増す現代では、こうした思考のショートカットが誤作動を起こし、「無意識のうちに不当な扱いをする」というリスクを高める要因になりうる。

「女性は理系が苦手」「○○出身の人は大らか」といった思い込みは、当人の悪意とは関係なく、結果的に組織の効率性や公平性を損なう恐れがある。

DX推進でも新しい技術やデータを評価する際、「若手の意見は大したことがない」「あの部署は保守的で使えない」といったバイアスが先に立てば、本来採用すべきアイデアを却下してしまうかもしれない。

ステレオタイプ・偏見・バイアスの違いの整理

ステレオタイプ(Stereotype)

集団やカテゴリに対して、一般化されたイメージや固定観念を抱くこと。例としては「営業は外交的」「技術者は寡黙で理系志向」などが挙げられる。偏見(Prejudice)

ステレオタイプに感情的要素が加わり、好き嫌いや優劣の評価として表出する状態。たとえば「○○人は苦手」「あの出身大学の学生は好きになれない」といったかたちで現れる。バイアス(Bias)

認知や判断に生じる体系的な歪みのこと。アンコンシャスバイアスは、特に無意識レベルで起こるバイアスを指す。

ステレオタイプが「○○人はこういうものだ」という“信念”であるとすれば、偏見は「だから○○人は好き(嫌い)」という“感情”、そしてバイアスは「○○人はこうだから採用を見送ろう」といった“判断”にまで影響を及ぼす。いずれも、人間が持つ思考のクセであり、気づかないうちに組織や社会に深刻な歪みをもたらし得る点で共通している。

2. リンダ問題:無意識の思い込みを浮き彫りにする思考実験

リンダ問題の概要

アンコンシャスバイアスを象徴的に示す思考実験として有名なのが「リンダ問題」である。ノーベル経済学賞受賞者のダニエル・カーネマンと、その共同研究者であるエイモス・トヴェルスキーが提示した。

リンダは31歳、独身。哲学を専攻し、学生時代には差別や社会正義の問題に強く関心を持ち、反核デモに参加していた。

Q:次のうち、どちらがより可能性が高いか?

1.リンダは銀行の窓口係である。

2.リンダは銀行の窓口係であり、フェミニスト運動に活発に参加している。

直感的には、多くの人がリンダのプロフィールから「フェミニストらしい」と判断し、2番を選びやすい。

しかし、確率論的には「銀行の窓口係」である場合のほうが、常に可能性が高い。これは**「代表性ヒューリスティック」あるいは「結合の誤謬(コンクジャンクションの誤謬)」**と呼ばれるバイアスの典型例だ。リンダの個人像に「社会正義」「反核デモ」などの要素が並ぶと、人は「フェミニスト運動に参加している」という可能性を過大評価してしまう。

花子さん問題(日本版)

日本の事例でも同様の現象を示すため、「花子さん問題」がしばしば引き合いに出される。

花子さんは29歳、独身で明るくエネルギッシュ。大学では日本文学を専攻し、在学中は茶道部の部長を務めた。休日は着物で古都めぐりをするのが趣味である。

Q:次のうち、どちらがより可能性が高いか?

1.花子さんは会社員である。

2.花子さんは会社員であり、茶道の師範である

こちらも、プロフィールからつい「会社員かつ茶道の師範」と結びつけたくなるが、実際は「会社員である」だけのほうが確率としては高い。こうした「直感的に納得しやすいが、実際には確率論と矛盾する選択肢を選びがち」というのがリンダ問題の本質であり、私たちが無意識の思い込みに陥りやすいことを示す好例といえる。

3. バイアスはなぜ生まれるか──カテゴリー化と利用可能性ヒューリスティック

カテゴリー化とプロトタイプ

人間の脳は、膨大な情報を効率的に処理するために、あらゆる事象を「カテゴリー」に分ける。

たとえば「鳥」と聞いたときに、頭の中ですぐに「小さくて空を飛ぶ生き物」というイメージが浮かぶのは、脳がもつプロトタイプ(代表例)の作用である。しかし、鳥にはダチョウやペンギンのように飛ばないものもいる。プロトタイプとのズレがあると「鳥なのに飛ばない」と違和感を覚えるのは、固定化されたカテゴリーが無意識に働いているからだ。

ビジネスでも「営業成績が高い=優秀」「◯◯大卒=データ分析に強い」といった短絡的な思考に陥りやすい。実際にはたまたま成績を伸ばせる市場環境だったり、資格を持っているだけで実務には弱かったりと、さまざまな可能性があるにもかかわらず、「典型例」に安易に当てはめてしまう。これが組織内で無意識に働くアンコンシャスバイアスの一例だ。

メディア報道と利用可能性ヒューリスティック

もう一つの代表的なバイアスとして、**「利用可能性ヒューリスティック(Availability Heuristic)」**がある。これは「直近でよく目にした情報や印象的な事例を、実際以上に頻度が高いと思い込む」という人間の認知的クセだ。

飛行機事故のニュースを大きく報じられると、「飛行機は危険だ」と感じる人が増えるが、実際の統計では車の事故のほうが発生件数ははるかに多い場合がある。メディアはセンセーショナルな事件を好んで取り上げるため、それが繰り返し報道されることで多くの人の記憶に強く刻まれ、「世の中は物騒になった」「未成年の犯罪が急増している」と思い込みやすい。実際の統計ではむしろ減少傾向というケースも少なくないが、印象の方が優先されるわけだ。

ビジネスの現場でも、競合他社がAI導入で成果を上げたというニュースを耳にすると、自社でも拙速にAIを入れようとする事例が少なくない。しかし十分な検証なしに導入した結果、期待した効果が出ないまま頓挫することもよくある。これも利用可能性ヒューリスティックが原因と考えられる。

4. DX推進を阻むアンコンシャスバイアスの具体例

採用や人事考課でのバイアス

組織において特に問題になるのは、採用や昇進などの重要な判断でアンコンシャスバイアスが色濃く表れるケースである。名前からマイノリティと推測される候補者が書類選考で不利になる、容姿の整った候補者が過大評価される、といった現象が研究によって示唆されている。

こうした無自覚な偏見が組織に定着すれば、多様な人材を取りこぼすだけでなく、公平性を欠いた評価制度によって人員が流出し、イノベーションが生まれにくくなる恐れもある。優秀な人材を正しく評価・登用したいなら、アンコンシャスバイアスの影響を明確に自覚し、その対策を講じることが必須だ。

DXや新規提案の評価プロセス

DXの文脈でも、最終的な意思決定は人間が行う。たとえ有望なデジタル技術を導入する提案があっても、上層部やキーマンが「若手は経験が足りない」「あの部署はどうせ成果を出せない」と無意識に思い込んでいれば却下されてしまう。その一方で、ほぼ同じアイデアでもベテラン社員が発案した場合はすんなり通る、という不公平が発生することもある。

最新のテクノロジーを入れれば自動的にDXが進むわけではない。人間の評価や合意形成プロセスがバイアスによってゆがめられると、せっかくの改革の芽が摘まれ、DXが形骸化してしまう。実際、どれほど高機能のAIを導入しても、それを正しく理解し活用する組織文化がなければ意味がないのだ。

5. システム1とシステム2──バイアスを生み出す思考モデル

二重過程理論(Dual Process Theory)の概要

ここで紹介したいのがシステム1とシステム2 についてだ。

ダニエル・カーネマンは、人間の思考をシステム1とシステム2の二種類に分ける「二重過程理論」を提唱した。

システム1(System 1)

直感的・瞬間的・自動的に意思決定を行う思考プロセスである。ヒューリスティックを用いるため脳への負荷が低く、日常の会話や簡単な作業で頻繁に活用される。しかし、確率的思考や複雑な判断が必要になると誤謬を引き起こす場合が多い。システム2(System 2)

意識的・分析的・論理的に物事を考える思考プロセスだ。数学や統計、複雑な計画など脳に負荷の高いタスクを担う。システム1の誤謬を修正し、客観的・合理的な判断を下す力があるが、常にフル稼働させるのは難しい。

私たちの日常では、まずシステム1が働いて判断し、その後システム2が必要に応じて介入する。ところが実際には、システム1の直感に頼ったまま結論を出してしまうことが多い。その結果、リンダ問題のような「結合の誤謬」に気づけなかったり、ステレオタイプの影響を過度に受けたりしてしまうのだ。

システム1とシステム2の具体例

「パスタとサラダを合わせて1100円、パスタはサラダより1000円高い。各々いくらか?」

多くの人が即座に「サラダ100円、パスタ1000円」と答えてしまうが、この差額は900円にしかならない。

正解は「サラダ50円、パスタ1050円」である。システム1を使うとこうした誤答になりやすいが、システム2で方程式を立てれば簡単に解決できる。これほど単純な数値の問題ですら直感に引きずられるのだから、人材評価やDXの投資判断といった複雑な意思決定ではなおさら注意が必要だ。

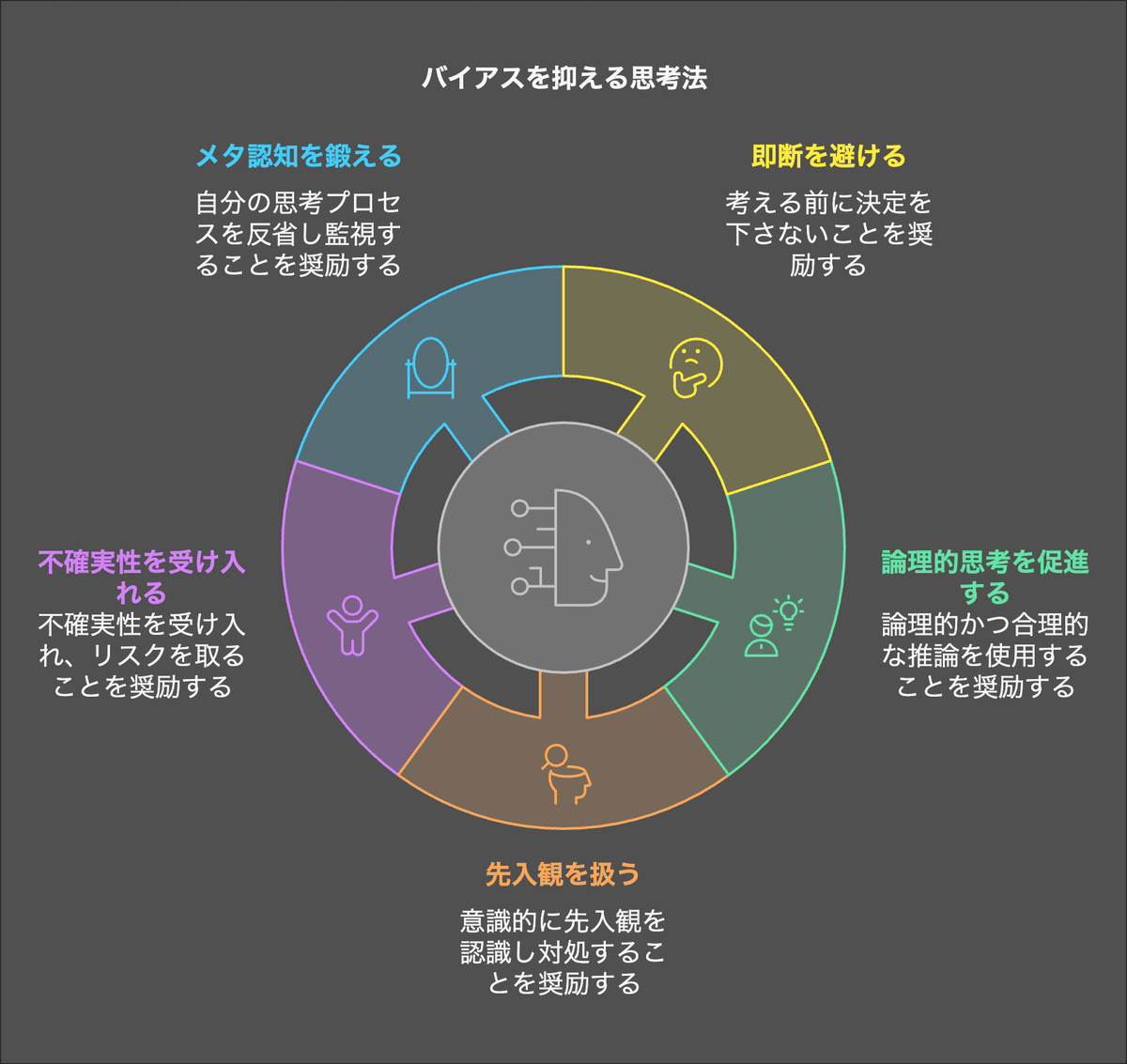

6. バイアスを抑える思考法──システム2を意識的に使う

一旦保留する習慣

バイアスを抑えるためには、システム1が出す即断に対して「ちょっと待とう」と一呼吸置く習慣が大事だ。これだけでもシステム2を呼び起こすきっかけになる。

たとえば仕事の会議でアイデアを聞いたときに「どうせダメだろう」と即断しかけたら、「その根拠は何か」と自問するだけで思考の幅が広がる。

「なぜ?」を問い続ける

とりわけビジネスシーンでは、「なぜそれが良いのか」「なぜ効果があるのか」を論理的に突き詰める姿勢が不可欠だ。広告で「このサプリで必ず痩せる」と謳われていても、「なぜ痩せるのか」「根拠は何か」を考えると、いい加減な説明が多いことに気づく。DXでも「AIを導入すべきだ」となったとき、「どのプロセスをどう改善するのか」を問うことで具体的な検証に進みやすい。

先入観をカッコに入れる(エポケー)

「エポケー」とは哲学の用語で「判断停止」を意味する。SNSで炎上中のトピックを見たときに「あの人が悪い」と決めつける前に、情報源を確認し「他の論点はないか」を調べるという態度を取るだけでも、極端な偏見から距離を置きやすい。先入観をいったんカッコに入れておくことで、違う角度から事実を見られるようになる。

不確実性を受け入れる

人間は結論を急ぎたがる傾向がある。しかし、研究開発や新規プロジェクトのような未知領域では、「まだわからない」という状態に耐えられる力が重要だ。中途半端に早期の結論へ飛びつくと、可能性を閉ざしてしまうリスクがある。

メタ認知を鍛える

「今自分はシステム1の直感だけで動いていないか?」と客観視する力をメタ認知という。数独やチェスなどの思考ゲームは、直感と論理を行き来する練習になり、メタ認知を高めるために有効だと考えられている。

7. まとめ:バイアスを意識してこそDXは成功する

アンコンシャスバイアスは、人間の脳がもつ高速処理(ヒューリスティック)の副作用ともいえる存在であり、誰にでもある程度は備わっている。問題は、その無意識の偏りが特定のグループを不当に扱い、多様性を阻害し、組織の成長を阻む点である。DXにおいても、優秀なアイデアや人材を活かせるかどうかは、最終的に「人間の意思決定」次第だ。

どれほど先端的な技術を導入しても、偏見が評価基準をゆがめていればイノベーションは育たない。リンダ問題や花子さん問題が示すように、「確率よりも直感的に『それっぽい』情報を優先する」のが人間の常だ。だからこそ、意識的にシステム2を働かせる必要がある。

筆者自身、データ活用コンサルティングの現場で痛感してきたのは、最先端技術を導入する前に「人間の無意識の偏り」に気づくことがDX成功の土台になるということだ。少し立ち止まって「本当にそうだろうか?」と問い直すだけで、驚くほど判断が変わる場合も多い。

アンコンシャスバイアスはゼロにできないが、意識し続けることで影響を抑えることは十分可能だ。DXの成果を最大化するためにも、組織全体で「思い込みによる排除」を防ぎ、データから導かれる事実を受け止める文化を育むことが急務である。リンダ問題のような例を自分ごととしてとらえ、常に「システム2を発動させる習慣」を心がけたい。

専門用語解説

1. アンコンシャスバイアス(Unconscious Bias)

意味:無意識のうちに形成される偏見や先入観のこと。本人の自覚なしに判断や意思決定をゆがめる要因となる。

背景:社会心理学で「認知バイアス」の一種として扱われ、ダイバーシティ&インクルージョンや組織論などで特に注目を集める。

2. 認知バイアス(Cognitive Bias)

意味:人間が情報を処理し、判断・意思決定を行う際に生じる体系的な偏りの総称。

例:代表性ヒューリスティック、利用可能性ヒューリスティック、アンカー効果など、多種多様なバイアスが知られている。

3. ステレオタイプ(Stereotype)

意味:特定の集団やカテゴリに対して、画一的・固定的なイメージを抱くこと。

特徴:多くの場合、実際のバリエーションや個人差を無視して単純化した見方をしてしまう。

4. 偏見(Prejudice)

意味:ステレオタイプに感情的要素が加わった状態。対象への「好き・嫌い」「優劣」といった評価を伴う。

注意点:当人の主観的な感情が根底にあるため、自覚しにくい無意識のバイアスが生じやすい。

5. バイアス(Bias)

意味:認知や判断が一定方向へ偏ること。ステレオタイプや偏見の影響で、意思決定が公正さを欠きやすい。

アンコンシャスバイアス:特に、意図せず無意識のうちにかかるバイアスを指す。

6. ヒューリスティック(Heuristic)

意味:迅速な意思決定を下すための、脳の「思考のショートカット」。必ずしも厳密な計算や検証を行わない。

利点:生存戦略として有効なことが多い(危険を即座に察知など)。

欠点:確率や論理を見誤るなど、認知バイアスを引き起こしやすい。

7. 代表性ヒューリスティック(Representativeness Heuristic)

意味:ある対象が「典型例(プロトタイプ)」にどれだけ近いかで確率や可能性を判断してしまう認知傾向。

事例:「リンダ問題」で、フェミニストらしい要素を強調された情報に引っ張られてしまう現象など。

8. 利用可能性ヒューリスティック(Availability Heuristic)

意味:直近で印象に残っている出来事や、容易に想起できる情報を過大評価しやすい認知傾向。

例:メディアで報道された飛行機事故を見て「飛行機は危険だ」と思い込み、実際よりリスクを高く見積もる。

9. 結合の誤謬(Conjunction Fallacy)

意味:2つ以上の条件が重なる事象(複合事象)のほうが、単独事象より確率が高いと誤って判断してしまう現象。

代表例:リンダ問題(「銀行員かつフェミニスト」のほうが「銀行員」よりも確率が高いと感じる)。

10. 二重過程理論(Dual Process Theory)

意味:人間の思考をシステム1とシステム2の2種類に分けて捉える理論。行動経済学者ダニエル・カーネマンらによって提唱された。

意義:日常的な認知バイアスの発生原因を説明する理論的枠組みとして注目される。

11. システム1(System 1)

意味:直感的・自動的・瞬時に働く思考プロセス。ヒューリスティックを多用し、認知負荷が低い。

利点・欠点:素早い判断が可能な一方、論理的誤謬やステレオタイプを見逃しやすい。

12. システム2(System 2)

意味:意識的・分析的・論理的に働く思考プロセス。複雑な課題や数理的処理を担当する。

利点・欠点:誤りを修正したり客観的判断を下せたりするが、認知負荷が高く持続が難しい。

13. カテゴリー化(Categorization)

意味:膨大な情報を処理・整理しやすくするため、類似する属性を持つ対象をまとめる脳の機能。

問題点:一度形成したカテゴリーに合わない対象(例:飛ばない鳥など)を排除したり低く評価したりしがち。

14. プロトタイプ(Prototype)

意味:あるカテゴリーを代表する「典型例」のイメージ。カテゴリー化の際に最もよく想定される。

例:「鳥=スズメのように小さく飛ぶ生き物」という固定観念。飛ばない鳥が例外扱いされやすい。

15. エポケー(Epoché)

意味:ギリシア語で「判断停止」を意味する。先入観を一旦カッコに入れて、事実や論理を見直す手法。

活用例:SNSの炎上を見たとき、すぐに「誰が悪い」と判断するのではなく、情報源や異なる意見を調べて考え直す。

16. メタ認知(Metacognition)

意味:自分自身の思考プロセスを客観的に認識・監視・制御する能力。

重要性:バイアスに陥っていないかをチェックしたり、システム1/システム2の切り替えを意図的に行うために不可欠。

17. DX(デジタルトランスフォーメーション)

意味:デジタル技術やデータ活用によって、企業や組織のビジネスモデル・業務プロセス・文化などを変革する取り組み。

関連:DX推進の場面でも、意思決定や評価プロセスにアンコンシャスバイアスが潜み得るため、注意が必要とされる。

18. アルゴリズム・バイアス(Algorithmic Bias)

意味:機械学習やAIの設計・学習データに人間のバイアスが組み込まれ、差別的・不公平な結果が生じてしまう現象。

関連:アンコンシャスバイアスがAIのトレーニングデータに反映されるなどの事例が報告されている。

本編にいられられなかったデータ活用のバイアスの話

以下に、データ活用の現場で起こりうるバイアスの具体例を5つ挙げ、それぞれ解説する。

1. 確証バイアス(Confirmation Bias)

概要

既に自分たちが信じている仮説や期待を裏付けるデータのみを注視し、反証となり得るデータを軽視または排除してしまうバイアス。

事例イメージ

新規プロジェクトの売上増加を期待している上層部が、好調なデータやポジティブなユーザーレビューだけを集め、ネガティブ評価や売上減少例を「例外」「外れ値」として無視する。

部門長や関係者が「この施策は絶対成功する」と思い込んでいると、数値が悪化していても「一時的なブレ」で済ませてしまい、改善の着手が遅れる。

なぜ問題か

ポジティブな結果ばかりに注目するため、リスクを見落としやすい。

修正や軌道修正の機会が遅れ、最終的に大きな損失を被る可能性が高まる。

対策のヒント

意図的に「仮説に反するデータ」を探しにいく仕組みを設ける。

結論ありきではなく、肯定意見と否定意見を等しく検討するプロセスを組み込む。

2. 利用可能性ヒューリスティック(Availability Heuristic)

概要

直近で話題になっている事象や、インパクトの強い事例ばかりを思い出してしまい、それが頻度や重要性を過大に判断させるバイアス。

事例イメージ

メディアで特定の業界トレンドが大きく報道されると、「今すぐこの領域に投資しなければ遅れる」と組織が思い込み、十分なデータ検証をしないまま新事業やシステム導入を決めてしまう。

新製品が数件のSNSバズで一時的に「売れている」ように見えるが、実際は継続的な購買データが伴わないまま、過大評価して在庫を仕入れすぎる。

なぜ問題か

話題性や一時的な盛り上がりに影響され、冷静な数字検証が疎かになる。

長期的には需要の見込み違いを起こし、在庫や人材、設備投資などを誤配分して損失を生む。

対策のヒント

一時的な「記憶に残る数字」だけでなく、過去の長期トレンドや大規模データを比較検討する。

定期的に全体統計や複数ソースのデータをクロスチェックし、客観的な視点を取り戻す。

3. アンカリング効果(Anchoring Effect)

概要

初めに提示された数値や情報が基準点(アンカー)となり、その後の判断を強く左右してしまうバイアス。

事例イメージ

予算策定時、最初に「前年同月比10%増」と数字を提示されると、別の要素(市場全体の動きや競合状況など)を考慮する前に「10%増」が目標として固定されてしまう。

データ分析の打ち合わせで、管理部門が「期初に立てた売上目標」を根拠づけるデータばかり要求し、現実との乖離を修正しようとしない。

なぜ問題か

一度アンカー(基準値)がセットされると、仮にその数字が適切でなくても、後続の判断が歪んだ方向に引っ張られる。

環境が激変しても、アンカーを再検証しない限り意思決定が古い指標に縛られ続ける。

対策のヒント

初期設定や「最初に示される数字」が本当に妥当か、複数の分析観点から見直す。

会議や分析の際に、最初の“前提数値”を意図的に複数パターン提示し、いずれが最適かを検討するプロセスをつくる。

4. サバイバーシップバイアス(Survivorship Bias)

概要

成功事例や生き残ったデータだけを過度に重視し、失敗・脱落した事例を見落とすことで、実態よりも成果が大きく見えるバイアス。

事例イメージ

「スタートアップで億単位の調達に成功した会社の事例」をいくつも参照し、そこに至らなかった多数の失敗例を無視。結果、「自社でも同じようにうまくいく」と過信する。

顧客キャンペーンの成功事例を分析する際、「応募してきた人」の声だけを聞いて改善を図る。実は応募しなかった層のニーズをまったく把握できず、施策が偏る。

なぜ問題か

成功データのみで分析していると、潜在的なリスクを過小評価しやすい。

多数の失敗を踏まえた教訓が排除されるため、再現性の低い施策を「必勝パターン」と誤認してしまう。

対策のヒント

「成功以外」の事例(クレーム、脱落顧客、失敗プロジェクトなど)に注目し、原因を分析する仕組みを持つ。

全母集団の構造を意識し、「そもそも誰が外れたのか」「どの段階で失敗が起きたのか」まで追跡する。

5. オーバーフィッティング/ピッカミス(Cherry Picking)

概要

分析者が膨大なデータの中から、自分の仮説や期待に合う部分だけを抽出し、全体の傾向を誤解するケース。

機械学習の観点では「学習データに過剰に適合しすぎて汎用性を失う(オーバーフィッティング)」とも呼ばれる。

事例イメージ

売上データを分析する際、「特定の顧客セグメント」と「特定期間」だけ抜き出すと成長率が非常に高く見える。しかし、全期間・全顧客で見ると実は横ばいかマイナス。

AIモデルの学習データで、たまたま突出したパターンを検出し、テストデータ(未学習データ)に対してはまったく成果が出ない。

なぜ問題か

部分的な「都合のいい」データに合わせて意思決定を行うため、実際の市場全体や別のセグメントで失敗する可能性が高い。

部門間やプロジェクト間で評価が歪みやすく、組織内の不公平感や摩擦を招く。

対策のヒント

データ分析の計画段階で、分析対象や期間、セグメントの選定理由を明示し、外したデータの範囲や理由も共有する。

機械学習モデルの場合は、学習用データと評価用データを分割し、過学習を防ぐための検証(クロスバリデーションなど)を徹底する。

まとめ

データ活用の現場では、数字を扱うからといって自動的に正しい結論に至るわけではない。上記のようなさまざまなバイアスが混在すると、**「フェアな情報処理」や「客観的な判断」**を妨げる要因となる。データや分析ツールが高度化するほど、一見“客観的”に見えながらも実はバイアスに引きずられた判断を下してしまう危険性が高まる。

最終的に重要なのは「自分たちがどんなバイアスに陥りやすいかを知り、それを避ける仕組みをつくる」という意識的な取り組みである。たとえば、データ分析のプロセスを複数人でレビューしたり、仮説と反証をセットで検証するようにするなど、具体的な対策を積み重ねることで、バイアスの影響を最小化していくことが可能だ。