#ELYZA

【初心者向け】最近のローカル日本語LLM【ローカル万歳】

はじめにOllama Open WebUIやLM Studioのローカルで簡単に利用できる最近の実用的な日本語対応のLLMを紹介しようと思います。※ Python言語を利用してアクセスするのではなく、「モデルのダウンロードとGUIソフトウェアの設定」で実行できるものです

Open WebUIの詳しい導入方法は下記事で紹介しています。

公式レポジトリはこちら

Qwen 2.5中国アリババ社の

Llama.cpp + WandBで始める日本語AI評価:Gemmaモデル(gemma-2-9b-it-Q4_K_M.gguf)のELYZA-tasks-100パフォーマンス分析

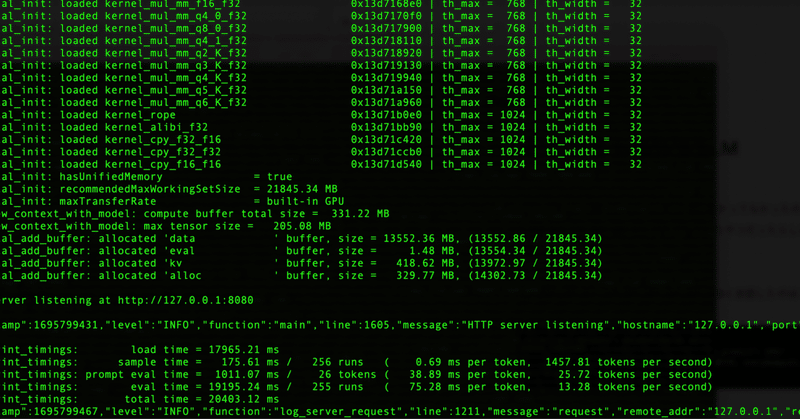

はじめにこんにちは!この記事では、Google Colab上でGemmaモデル(gemma-2-9b-it-Q4_K_M.gguf)を使用して、ELYZA-tasks-100データセットの評価を行う方法をご紹介します。この記事は、大規模言語モデルの評価に興味がある初心者の方々向けに書かれています。

この記事を読むことで、以下のことが学べます:

llama.cppの環境構築方法

Gemmaモデル

ローカルLLM(Llama-3,gemma-2)でAIアバター「えーあいそーだんいん」の観光案内セリフを作ってみた!

少しご無沙汰しております!横須賀市生成AI推進チームのM田です!

2024年4月27日から5月31日にかけて、メタバースプラットフォームVRChat上で、AIアバター「えーあいそーだんいん」の試験運用を行いました!

これは、もち山金魚さんのかわいい3Dアバター「まめひなた」に、スカジャンを着てもらって、GPT-4と魂のプロンプトを吹き込んだ、音声で会話を楽しんだり観光案内をしたりしてくれるAI

700億パラメータの日本語LLM「ELYZA-japanese-Llama-2-70b」を開発し、デモを公開しました

はじめにこの度 ELYZA は、新たに開発した700億パラメータの大規模言語モデル (LLM) である「ELYZA-japanese-Llama-2-70b」のデモを公開しました。「ELYZA-japanese-Llama-2-70b」は、前回までに引き続き、英語の言語能力に優れた Meta 社の「Llama 2」シリーズに日本語能力を拡張するプロジェクトの一環で得られた成果物です。

ELYZ

LM Studioを使ってELYZA Japaneseをインストールしてみた

とある諸事情から、LLMをインストールしてローカルで使えるようにってことをやっている。

最初はGPT4ALL元々はGPT4ALLを触ってた。GPT4ALLも良かったんだが、日本語環境が欲しいな、と思ったので、別の環境を探してた。ちなみに、GPT4ALLを触るならこのページを参考にするのが一番いいんじゃないかと。

で、日本語LLMを探してたんだが、そんなにハイスペックなPCを持ってるわけでもない

130億パラメータの「Llama 2」をベースとした日本語LLM「ELYZA-japanese-Llama-2-13b」を公開しました(商用利用可)

本記事のサマリーELYZA は「Llama 2 13B」をベースとした商用利用可能な日本語LLMである「ELYZA-japanese-Llama-2-13b」シリーズを一般公開しました。前回公開の 7B シリーズからベースモデルおよび学習データの大規模化を図ることで、既存のオープンな日本語LLMの中で最高性能、GPT-3.5 (text-davinci-003) も上回る性能となりました。また、推

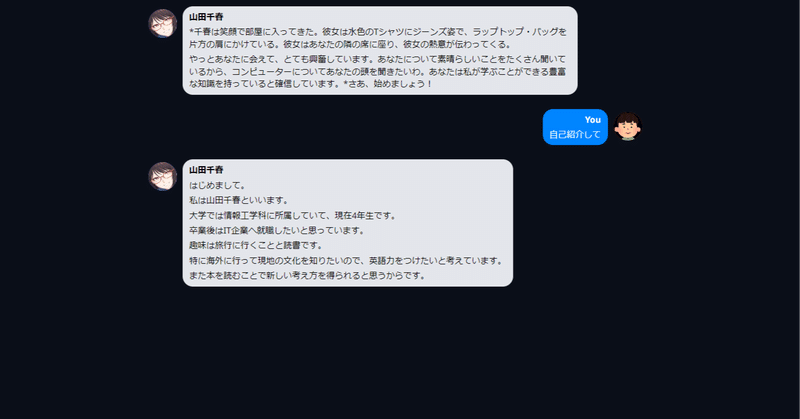

もっとみるtext-generation-webuiでELYZA-japanese-Llama-2-7b-fast-instructとのチャットを考える

text-generation-webuiにはデフォルトでChiharu Yamadaという謎の美少女とチャットできるプリセットが搭載されています

ModeをChatにすると、LLMにはどのようなプロンプトが渡っているのでしょうか。

左下のハンバーガーメニューから「send to default」または「send to notebook」を選ぶと、実際にLLMに渡っているプロンプトを確認するこ

text-generation-webuiで、ELYZA-japanese-Llama-2-7n-fast-instructをExLlamaでロードし、LoRA適用してみる

text-generation-webuiで、ELYZA-japanese-Llama-2-7n-fast-instructをExLlamaでロードし、LoRA適用してみます。

Exllamaでモデルをロードするために、以下のGPTQモデルをお借りします。

Download model or LoRA画面にdahara1/ELYZA-japanese-Llama-2-7b-fast-instr

text-generation-webuiで、ELYZA-japanese-Llama-2-7n-fast-instructのLoRAトレーニングを試す。

text-generation-webuiで、ELYZA-japanese-Llama-2-7n-fast-instructのLoRAトレーニングを試してみたので、その備忘録を記します。

Google Colabでtext-generation-webuiを起動ローカルマシンではVRAMが足りなかったので、Google ColabでA100を利用します。

以下のコードを実行すると、Google

Metaの「Llama 2」をベースとした商用利用可能な日本語LLM「ELYZA-japanese-Llama-2-7b」を公開しました

本記事のサマリーELYZAが「Llama 2」ベースの商用利用可能な日本語LLM「ELYZA-japanese-Llama-2-7b」を一般公開

性能は「GPT-3.5 (text-davinci-003)」に匹敵、日本語の公開モデルのなかでは最高水準

Chat形式のデモや評価用データセットも合わせて公開

既に社内では、130億、700億パラメータのモデルの開発も進行中

はじめにこんにちは