Adobe Auditionを使ってみる

AIで楽曲の長さ調整ができると聞いて

お金もないのに、Adobe Auditionを契約する。

理由は手を動かしたかったとか、デジタルの波形を触りたかったとか、不意にガンプラ作りたくなる衝動に近しいあの感覚。

しかしながら、いち社会人。お金を使う以上は大義名分が必要だ。

知人のディレクターから聴いた、「最近はAIで1分の曲を2分半にしたりして作業してるよ」のひと言が、サブスクをポチる最後のひと押しとなった。

ほんの数年前までBGM作業といえば、動画制作プロジェクトで使う楽曲を探し当て、波形をうまい具合で切って貼り、MAスタジオでオペレーターさんに上手に丸めてもらうのが自分の制作工程だった。

それが手前の環境でできる、しかも気に入った曲を好きな長さに解析して作り直してくれるとか……作曲家の友人には申し訳ない気持ちだが、ワクワクが止まらない。

実際にやってみる

早速、楽曲を選んでみた。

尺は2:34(24bit/48KHz)、自分の好きなLo-fi系のBGMを選曲してDLした。

早速取り込んでみる。

Auditionに楽曲を取り込む。(編集可能状態にする)

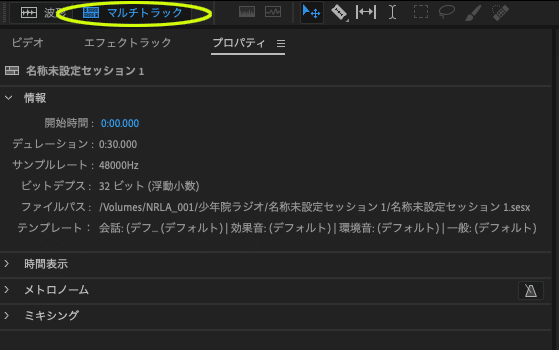

DLした楽曲をクリックドラックして黄色の枠内にプロジェクトに直に貼り付け、マルチ化する。

パネルの中のプロパティタブから「リミックスを有効」をクリック。

AIが波形を解析してくれる。この間ほんの数秒。

今回は1分30秒と30秒の動画を作成する。

同じ楽曲から2つの曲を生成できるなんて、フリーの音源すら少ない時代から動画制作をしていた身としては、AIの成長が凄い。

作業工程

楽曲ラインの端にカーソルを持っていくとカーソルが⇄に変わる。

そのまま好きな長さに持っていってカーソルを話すと、解析と生成が始まる。

これから更に改良(学習?)され利便性が増すのだろうが、この作業では厳密に指定のフレームまで調整することは難しかった。

どうやら楽曲全体の中から、延ばす際にはループ可能な箇所を、縮める際にはイントロとアウトロを除いた中間のカット可能な箇所を探しているようだ。

あまりにも短い音源、ループ箇所を解析できないような楽曲ではなく、少なくとも30秒~2分程度の楽曲をベースとした方が良いかもしれない。

注意点など

好きな楽曲を大体の長さに調整し直す、ことにおいては大満足だ。

注意点として

あくまでもループを作り楽曲を自然にストレッチさせる機能である

サビ、大サビなどまでは判別してくれない

フレームまでの調整はきかない、オーサリングは自分で

AIが解析しやすい楽曲を選ぶコツを掴めると活用しがいがある

衝動的に導入したツールとしては満足度は高い、あとは近年高騰し続けるアドビ税に見合う活用を自身ができるかが導入のキーとなりそう。

動画を作る編集者などは工数の削減は約束されるので、そこは大きいかもしれない。

今年も更にAIはクリエイティブを加速させるんだろうなと思いつつ、賢いAIが生成してくれた楽曲をスクラブしながら映像を作り始める。