#AI

【論文瞬読】スケッチから3Dゲームの世界が生まれる!? AI技術が変える次世代のゲーム開発

こんにちは!株式会社AI Nestです。今回は、ゲーム開発の世界に革命を起こしそうな最新のAI技術について紹介します。手書きのスケッチから、リアルな3Dゲームの世界を自動生成する――そんなSF映画のような技術が、現実のものになりつつあるんです!

はじめに:Sketch2Sceneとは?最近、「Sketch2Scene: Automatic Generation of Interactive 3D

画像を3Dに変換するAIツール「Stable Fast 3D」を試してみる

Stable Fast 3DとはStable Fast 3D…一瞬で画像を3D化するということでちょっと話題になってたので調べてみましたが、1 枚の画像から高速かつ高品質のテクスチャ付きオブジェクト メッシュを再構築する新しい手法で、内容としてはStability AIでTripoSR をベースにしているものとのこと。

作者はMark Bossさん。偉大な発明をありがとう!

速さと質が売りのような

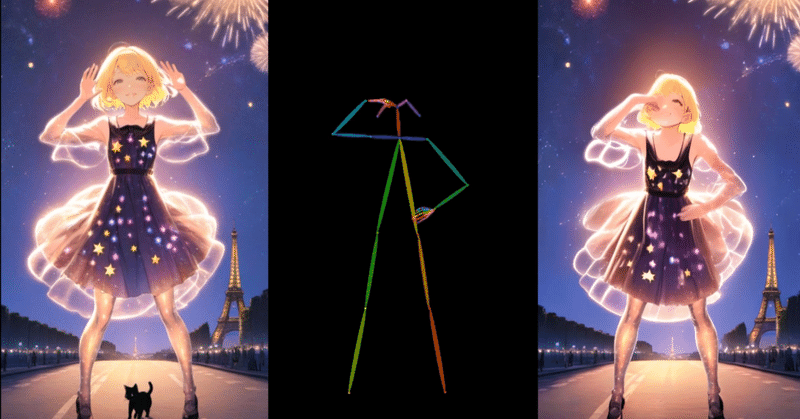

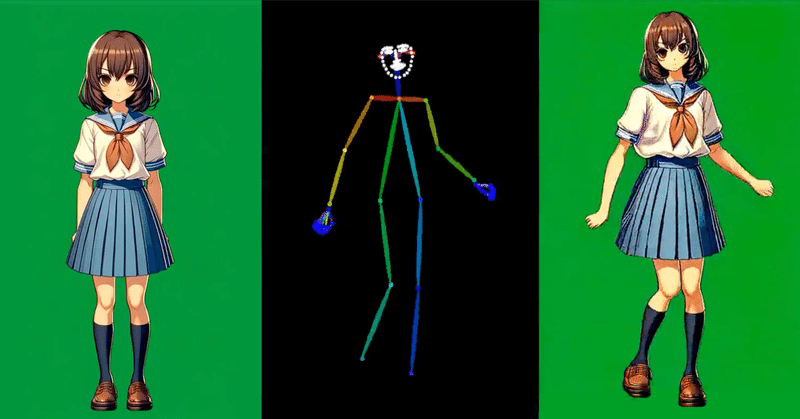

UbuntuでMusePoseを試してみる

「仮想人間生成のためのポーズ駆動型イメージ-to-ビデオ フレームワーク」であるらしいMusePoseを試してみます。

1. 準備環境構築

python3 -m venv museposecd $_source bin/activate

リポジトリをクローンして、パッケージをインストールします。

# clonegit clone https://github.com/TMElyralab/

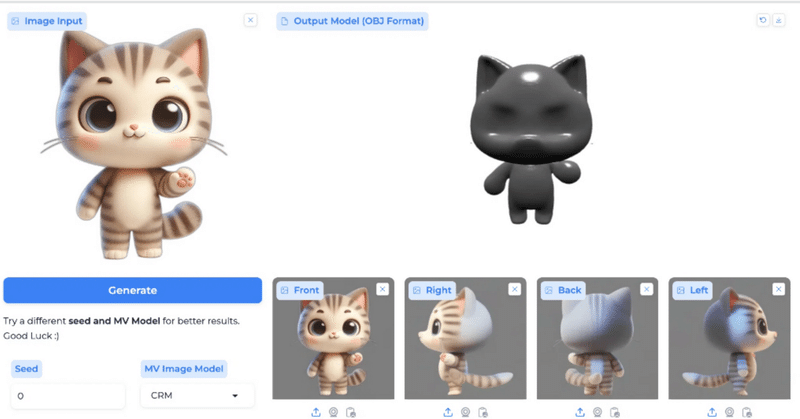

新しく見つけた2D-to-3Dの「CraftsMan」を試してみる

ということで今回はまた新しく見つけた2D-to3DのCraftsManを触ってみたいと思います!

CraftsManの最大の特徴は、二段階プロセスで行う高速かつ高精度な3Dメッシュ生成で、多様なMVモデルが選べるところらしいです。

CraftsManとはざっくりですがこのCraftsManのことをまとめて言うと、二段階のテキスト/画像から3Dメッシュを生成するモデルのことです。

特徴と呼ばれる

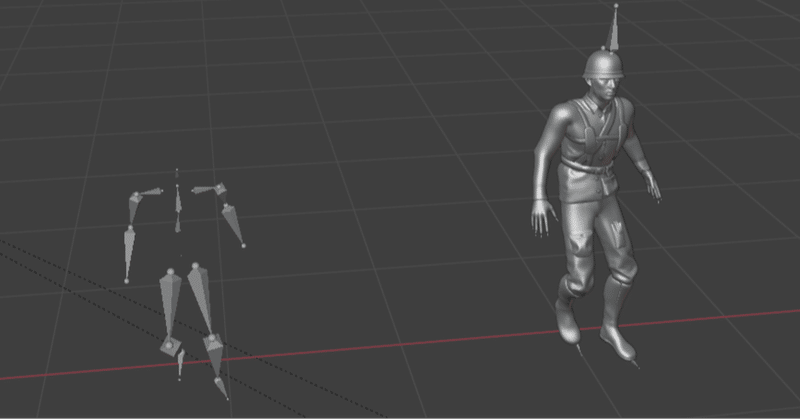

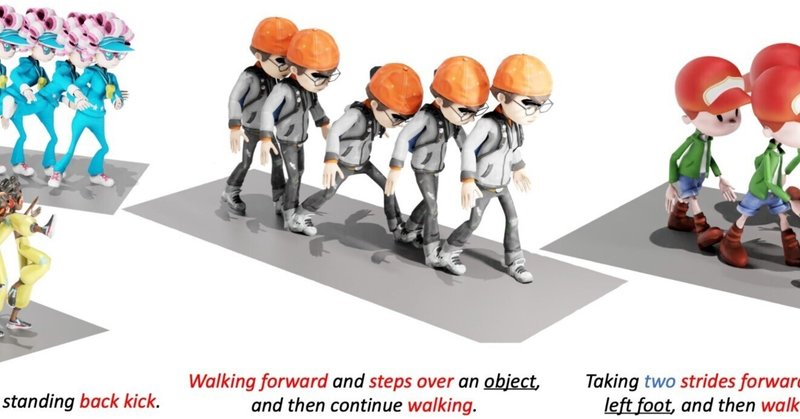

MotionGPT で作ったモーションを任意の 3D モデルに割り当てて動かす

MotionGPT でモーションを生成し、Blender 上で 3D モデルに適用して動かしてみた。

モーション生成概要

テキストからモーションを生成する技術。

行動を表すテキストを再現するようなモーションが得られる。

様々な手法

Motion Diffusion Model や text-to-motion 等様々な手法があり、Awesome-Video-Diffusion リポジトリに

3D画像を高速生成できるTripoSRというオープンソースのGoogle Colabでの実行方法

今回は、Google Colab上で、2D画像から3D画像を高速に生成できるTripoSRというオープンソースモデルを試してみます。

開発は、Tripo AIとStability AIとなります。

今回は、上記コードを参考に修正し、Google Colab V100で実行します。

左側に3D画像にしたい2D画像を取り込んで、Generateをクリックすると、右側に3D画像ができます。実際に、

Google Colab で Moore-AnimateAnyone を試す

「Google Colab」で「Moore-AnimateAnyone」を試したので、まとめました。

1. Moore-AnimateAnyone「Moore-AnimateAnyone」は、「AnimateAnyone」の再現実装です。元の論文で実証された結果を一致させるために、さまざまなアプローチやトリックを採用していますが、それらは論文や別の実装とは多少異なる場合があります。

これは非常