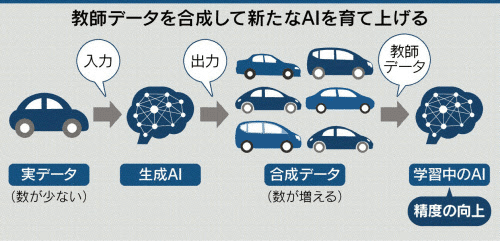

AIを鍛える「教師データ」を生み出す、生成AIができた

こんにちは。

今日も風が強いですね。

窓越しに、風にもめげず、学校へ、会社に出かける若い人たちの姿を見送っています。

今日も「やって、よかった」と思える充実した一日でありますように…。

いろんなことがあるでしょうが、前向きにとらえる「積極思考」でいきましょう。

本日の日経新聞も、“AI盛り”ですね。

「チャットGPT」の記事が掲載されない日はない!と言い切れるぐらいすごい。

しかし、「11月末に製品発表されて、4か月余り、何でこんなに騒ぐの!?」と、どこか冷めて記事を読む自分がいました。

その理由は、AI分析するには、

●分析に必要とされる、●信頼できて、●公平性の担保できる、●大量の「実データ」の収集が必要であるので、「ここまで、進歩したんだね!」の次の「これなら、正確で安心して普及できるね」は、まだ先だな、とタカをくくっていたからです。

ところが、「生成AIがAI鍛える」「大量のデータ収集不要に」の見出しを見て、ぶっ飛びました。

仮想空間上でAIを鍛える3次元の「教師データ」を生み出すと新技術というではないですか。

しかも、日本発のスタートアップ企業が開発したではありませんか。

日本企業が、IoTでロボット技術をリードするとともに、AIでは、海外記事がおどるなかで、ブリヂストンが出資するAI開発のアセントロボティクス社の発表は、たのもしい限りですね。

このブログをきっかけに、ぜひ日経新聞電子版を手元において、仕事に学びに活用してください。おすすめしますよ。

日経電子版 2カ月無料の春割でお申し込み|日本経済新聞のニュース・専門情報 (nikkei.com)

生成AIがAI鍛える ブリヂストン、新興に出資

「プレステの父」と組む 新技術広がる

2023/4/7付 日本経済新聞 朝刊

<リード文>

精巧な画像などをつくる生成AI(人工知能)を使って別のAIを鍛える技術が広がっている。ブリヂストンはゲーム機「プレイステーション」の生みの親の久多良木健氏が率いるAIスタートアップと組んでロボットの「手」の訓練に応用する。

住友電気工業も京都大学発ベンチャーと連携し、製品検査AIの学習に必要な時間を従来の5分の1に短縮した。

ブリヂストンは2月、AI開発のアセントロボティクス(東京・渋谷)に5億円を出資し業務提携した。アセントはソニー・コンピュータエンタテインメント(現ソニー・インタラクティブエンタテインメント)元会長で「プレステの父」として知られる久多良木氏が最高経営責任者(CEO)を務める。

ブリヂストンはタイヤやホースの開発で培ったゴム製人工筋肉の技術を使い、物流や小売りなどの現場で人間の手の代わりとなるロボットハンドの事業化を目指している。2023年1月には同社初の社内ベンチャーを立ち上げた。

ロボットハンドが対象物を認識して適切な力でつかむには「頭脳」となるAIを大量のデータで鍛える必要がある。ただ、訓練のために様々な大きさや形状の物体を実際に用意するのは難しい。仮想空間上でAIを鍛える3次元の「教師データ」を生み出すのが、アセントの生成AI技術だ。(後略)

オープンAI、対話AIの安全策公表 不正使用防止へ監視/個人情報削除

2023/4/7付 日本経済新聞 朝刊

<リード文>

【シリコンバレー=渡辺直樹】人工知能(AI)開発の米オープンAIは5日、高度な言語能力を持つAIの安全面での施策を公表した。外部の専門家や利用者の声を交え、動作監視して改善するほか、AIの訓練に使うデータから個人情報をできる限り削除することなどを掲げた。プライバシー侵害をめぐり欧米で批判や懸念の声が強まっていることに対応した。

<引用>

人と自然な会話ができるサービス「ChatGPT(チャットGPT)」と、それを動かすための基盤となる最新技術「GPT-4」に関して施策を発表した。

GPT-4は従来の8倍にあたる2万5000語まで文章を扱えるようになり、米国の司法試験の模擬試験では上位10%程度の成績で合格する性能を誇る。

だが、どのようにデータを集めているか不透明で、イタリアの当局が個人情報保護の法令に違反するとみて一時的に禁止していた。

オープンAIは可能な場合は、AIを訓練するデータから個人情報を削除する。外部から個人情報の削除の要請があった場合にも応じることでプライバシー侵害を最小限にするとしている。

また動作については外部の専門家や利用者の声を反映して改善し、監視する仕組みをつくる。「API」と呼ばれる外部ソフトとの連携機能を通じ、実際のサービスの使われ方を確認することで、不正使用を防ぐようにするという。(後略)

チャットGPTに情報漏洩リスク 「業務利用にルールを」 米専門家見方 全面禁止は逆効果

2023/4/7付 日本経済新聞 朝刊

<リード文>

「ChatGPT(チャットGPT)」など対話型の人工知能(AI)が急速に普及している。使いこなせば業務効率を改善できるが、使い方によっては外部漏洩のリスクも指摘される。

対話型AIを安全にどう活用すべきか、米通信大手ベライゾンのマネージング・ディレクターでデータ漏洩に詳しいクリス・ノバック氏に聞いた。

(聞き手はサイバーセキュリティーエディター 岩沢明信)

<引用>

――対話型AIが企業に与える影響は。

「最大のリスクは、社員のユーザーがAIに機密情報を与えてしまう点だ。社外のクラウドサービスに対して通常は働く危機意識が、相手がAIだからと安心して働かなくなってしまうことがある。

AIがその入力内容をベースに学習を深め、社外の他のユーザーへの回答に反映するといった、会社が想定していない形での機密漏洩が起きてしまう」

「あるバイオテクノロジー企業から『漏洩が発生した可能性がある』と相談を受けた。社員が自社の製造データをチャットGPTに入力し、どうすれば製造効率を改善できるか質問してしまったという。幸いにして致命的な機密ではなかったがこうした悪意のない行動で漏洩が起こりうる」(後略)

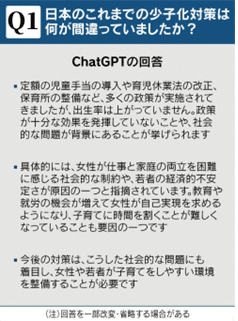

人口と世界AIと考える ニッポンの宿題少子化は副作用、根本治療が必要

2023/4/7付 日本経済新聞 朝刊

<リード文>

座談会に参加した(左から)サイボウズの青野慶久社長、ニッセイ基礎研究所の天野馨南子氏、大正大の小峰隆夫客員教授

世界の人口減を先取りするかのように、想定を上回るペースで日本で生まれる子どもの数が減り続けている。少子化対策に欠けていたものは何か、仕事と育児の両立に必要なものは何か、人口減社会でも成長を続けられるのか――。そんな疑問を対話型人工知能(AI)「Chat(チャット)GPT」にぶつけ、生成された回答をもとに経済学者やエコノミスト、企業経営者がAIとの座談会形式で解を探った。

<引用>

天野氏 アンコンシャスバイアス(無意識の偏見)が入っている。

「仕事と家庭の両立を困難に感じる社会的な制約」は女性だけでなく「若い男女とも」だろう。

男性の方が社会的制約を感じているとの調査結果すらある。回答は日本で人口多数派となっている40代以上の意見に偏っていて古いと感じる。

青野氏 AIは今ある情報を基に答えを返す。過去が反映された答えになるので、あまりクリエーティブではないし、未来に向けたものになっていない。

小峰氏 無難な回答だ。国の予算も十分に手当てされてこなかった。考えなければいけないのは、少子化が病気なのではなくて、もっと大きな病気に伴う副作用ではないかということ。

男女共同参画が不十分、働き方が柔軟ではないといったことが本当の病気で、少子化は副作用ではないか。子育て支援は病気で熱が出たから解熱剤を飲んでいるようなもので根本治療にはならない。(中略)

<引用>チャットGPT、膨大な学習もとに回答 誤った見解・古い情報に注意

2023/4/7付 日本経済新聞 朝刊

米オープンAIが2022年11月に公開した対話型人工知能(AI)。

質問を文章で打ち込むと、人間が書くような自然な回答を生成する。英語、日本語のほか様々な言語に対応する。

1月時点で世界の利用者数は1億人を突破した。

文脈を読み、推測して回答する能力が飛躍的に進歩している。調査や文章の要約・翻訳、プログラミングコードの生成など幅広い分野で活用できる。米国では経営学修士号(MBA)の試験科目で合格レベルの答えを書いたとの研究結果が発表された。

東京大の松尾豊教授は「日常的な仕事のかなりの部分を代替できたり支援したりできる」と指摘する。

チャットGPTを利用する上で注意すべきは、「不正確または無意味な回答を書くことがある」(オープンAI担当者)という点だ。ウェブ上での誤った見解や古い情報を参考に回答を生成するケースもある。

回答をビジネスや研究で活用する際は、事実関係の検証が必要となる。

サイバー攻撃プログラムや、フェイクニュースの生成に悪用できるとの指摘も出ている。技術進歩を社会が健全に享受するためには、利用のルールづくりや悪用を防ぐ技術の導入も欠かせない。

高い能力の背景には膨大な「学習量」がある。ネット上のあらゆる文章データを読み込み、機械学習モデルを用いて人間らしい対話の手法を学んだ。

チャットGPTが学習に要した演算回数は10の23乗の3倍に達する。1980年代のAIモデルの4兆倍に膨れ上がっている。

米マイクロソフトはオープンAIの技術に早くから着目していた。1月に数十億ドルの追加投資を発表し、2月には自社の検索エンジン「Bing(ビング)」にチャットGPTの機能を組み込み始めた。

マイクロソフトのサティア・ナデラ最高経営責任者(CEO)は発表時に「ネット検索にとって新たな一日が始まる」と期待を語っている。

座談会を終えて AIはさらに進化、共存し議論を

2023/4/7付日本経済新聞 朝刊

小峰氏 問いかけに文章で答えるというAIがどんどん発展し、広がっていくだろう。新しい次元に飛んだような気がして、今回は先駆けの歴史的な座談会なのかな、と思う。大学のリポートでいえば、創造性がないので「A」評価は付けられないが、「B」にはすでになっている。

学生が使い出したらどうするか、教師にとっては悪夢のような一面もあるほどだ。チャットGPTの回答が常識のようになり、フェイク的な常識が皆の常識になる素地が作られてしまう懸念はある。プラス面と今後出てくるであろう様々な問題があるが、まさしく(AIと共存する)入り口にいるんだなと強く感じた。

天野氏 非常に素晴らしい機能ではあるが、回答は最終解ではなく議論のたたき台であることを忘れてはならない。日本人はディスカッションが得意ではないので、こうした機能を使って「こう言っていますよ。

では、あなたは独自の回答を持っていますか」と問いかけていくような使い方は面白いと感じた。回答に突っ込みを入れられるような学生さんを高く評価するといった使い方も考えられる。

青野氏 コンピューター側のビジネスをしている者として、驚愕(きょうがく)している。これだけ自然に答えを返してくれるレベルまでできちゃった。しかもこれから進化する。まだ序の口で「A」評価まで上がる可能性がある点も衝撃だ。ただ座談会では限界も感じた。どうしても一般論になり、踏み込みが足りない。まだ人間が補完してあげないといけない部分はある。AIをもっと賢くするためにも人間が頑張らなければいけないとも感じた。

ご精読、どうもありがとうございます。

毎日コツコツ進めていきましょう!

就活モチスキゼミコーチ 山内康義

いいなと思ったら応援しよう!