国連を中心に生まれている、AIの倫理を考えるための問い

AIは徐々に社会に名前が浸透して来ていますが、解決できていない課題に関してはまだまだ議論がされていません。

今回は国連やユネスコ、IEEEなど国際組織で標準化関連のワーキンググループで活躍するEdson Prestes先生に人工知能、ロボット技術に倫理的な要素が必要な理由を聞いていきたいと思います。

第二回はユネスコや国連で始まっているAIと倫理に関する取り組みのお話を聞いていきます。

Kohei: 国連のデジタル協力に関するハイレベルパネルでは、多様なメンバーが集まって現在はどのようなチャレンジに取り組まれているのでしょうか?

国連が取り組むテクノロジーと社会課題

Edson: 取り組みの中には数多くのチャレンジがあって、特にデジタル領域にまつわる取り組みを行っています。デジタル技術が社会に実装されていく中で、いかにネガティブな要素を減らしながら、利便性を高めていくかが大きなテーマになっています。

目標とするゴールは非常に幅広く設定しています。理由としてはテクノロジーといってもただ一つのテクノロジーの話をするだけでなく、様々な異なる要素を組み合わせて議論を行う必要があるからです。

(動画:Launch of a High-level Panel on Digital Cooperation)

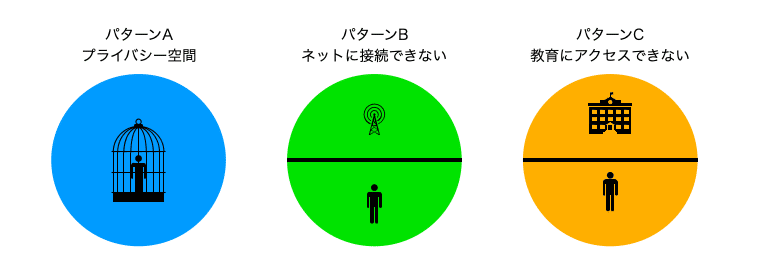

そして、この分野を深く分析する際にはインフラの話や規制など社会に実装していく上で必要な要素に加えて、インターネットに平等にアクセスでき、質の高い機会を提供できているのかどうかも同時に検討する必要があります。

現時点ではこれからの目標は達成できておらず、アフリカや南アメリカの地域ではまだ電気が通っていない地域も多く存在します。TVが家庭になく、電気が通っていない地域ではこのようなテクノロジーにアクセスする事もできません。まず私たちが考えるべきことはインターネットに平等にアクセスできる環境を考えることで、とても重要なトピックです。

それ以外には、人工知能の問題も取り上げています。将来多くの便益を社会にもたらしてくれる技術の一つで急激にテクノロジーの進化は進んでいます。

ビジネスとしての成功だけでなく、より良い教育の機会を個人に合わせて提供できたり、医療などの仕組みを開発するなども実現できる可能性を秘めています。ドローンや自動運転もまさにそう入った技術の代表例ですが、問題は技術が社会にとって良い使われ方をされ続けるかどうか(技術とサステナビリティ)と言うことです。

倫理というのはとても重要で、機械が危険な方向性に向かってしまわないように私たちは注意していく必要があります。自律型致死兵器システムのような兵器に使われる事も想定されます。

誰が医療情報を取り扱うかによっても最終的な判断が変わってきます。システムが間違った形で意思決定を行ってしまう事は前提としてありうるので、事前にシステムに対してトレーニングを実施する必要があります。

それ以外にもデジタル上での人々の人権に関する問題はとても重要な話です。日本の教育システムには明るくないのですが、開発者やエンジニアの人たちが社会全体にに関心を持つ機会を作る事がより重要だと思っています。

私たちの活動では一連の流れをプログラム化してしまうためのトレーニングシステムを作成しています。これは開発する際にシステムの事だけを考えるのではなく、システムを作る上で前提として社会に浸透し、価値を見出す事を前提として設計しています。

そこでは人権や人を中心にプログラム設計に取り組んでいるのですが、プログラムを設計する際に、「どうすれば人を前提にして設計することができるのか」という問いが一番苦労しているポイントです。

それぞれデジタル上でドメインを持って定義をマップ化して作っていくのですがその中で様々な要素を加えながら考えます。貧困コミュニティ内での標準的な生活や、プライバシーを前提とした空間、家族、質の高い情報を受け取ることができる環境などドメインを設定していきます。それぞれが近しい要素ではあるのですが、直接マップ上でつながる事はありません。

国連の取り組みでは新しい提案などが生まれてきていて、人工知能に関する事や、人権に関する事、インターネット接続環境の事や、サイバー空間とプライベート空間の話、セキュリティや国際協力の話など多岐に渡ります。

現在のAIが抱えるデータの問題

日本を例にして考えると、モバイルのアプリやシステムを通じて数多くのデータが誕生していると思います。日本は、ロボットと人が交流する事で新しいデータがより多く生まれる環境に生まれる土壌が整っていると思います。

でも世界全体で見ると全ての人がそう入ったデータにアクセスできるわけではなく、一部のデータを切り取って企業はビジネスにつなげようとしていると思います。

全てのデータにアクセスできるわけではないので、データをもとにソリューションを設計した場合アクセスできないデータ量に関しては不完全なソリューションになってしまいます。

そのため、私たちが今検討しているのはデータを共有できるプラットフォームで、企業や組織が新しいビジネスを構築できるように質の高いデータを共有できるようにしようという目的で進めています。

私たちが今取り組んでいる事は領域が非常に幅広いので、それぞれポイントを抑えていきながら幅広い視点で考える必要があります。

Kohei: なるほど。データを共有するというのは一つ重要なポイントになりそうですね。私もこれまでに教育分野で活動していた事がありますが、まだ日本でもサービスの恩恵を受ける事ができない人たちはたくさんいます。テクノロジーの発展の影で、テクノロジーによって恩恵を受けられていない人たちがいる事も理解する必要がありますね。

テクノロジーによって恩恵が受けられる人たちが増えていく事はとても大事で、今はテクノロジーの進歩が早いため利用者側が十分に理解して追いついて行けていないというのが課題としてあるのではないかと思います。

ここからは次のトピックに移りたいと思います。AIと倫理の話はEdsonさんが取り組んでいる領域だと思いますが、AIに関しては多くの既存企業やスタートアップが取り組んでいる分野でもあります。

今起きている問題としては、開発者自身が社会全体のマイノリティであるという課題で、さらにオープンソースなどを開発している人たちに焦点を当てるともっと小さな割合になるのではないかと思います。

私もオープンソースコミュニティ属して活動した事はありますが、とても限られた人たちの世界でありつつも、そう入った人たちの努力によって技術が発展している側面もあります。

全人口で見るとコミュニティがとても小さいのでバイアスやコミュニティ内での概念が反映されやすい仕組みになってしまっているのではないかと思っています。特に性別や哲学、人種などは代表的な問題ですね。

Edsonさんはユネスコのプロジェクトでこう入った問題に取り組まれていたと思うのですが、これからAIと倫理に関しては未来に向けてどのように考えて行けば良いのでしょうか?

ユネスコで行われているAIと倫理に関する議論

Edson: とても面白い質問だと思います。一つのソリューションで解決できる問題ではないので難しいですが、幅広い視点でAI技術を見ていく必要があると思っています。例えば、人を中心にした社会を考えるときには、インフラとして技術を考えていく必要があります。

(動画:Do you know AI or AI knows you better? Thinking Ethics of AI (version with multilingual subtitles))

もし、インフラとしての考えが抜けてしまっていれば、デジタル空間で大きなギャップが生まれてしまいます。そのためには教育システムを見直していく事も重要ですね。

STEMと呼ばれる理系の教育機会を広げていく事も必要です。ただ、それだけでは不十分です。開発した技術が社会全体に悪影響を考える必要もあり、その場合は開発する側への教育だけでなく社会全体の影響を考えるような教育も必要になってきます。

それぞれ立場が異なる人たちの状況も考えた上で設計する必要があり、問題解決のソリューションだけでなく、クリティカルシンキングの要素も必要になってきますね。

その場合はより人に近い分野の教育(人文)も必要になってくるので、クリティカルシンキングや人間同士でのコミュニケーションに関して体験を通じて学び、共感する能力もとても重要な要素になっていくと思います。こういった分野を学ぶためには教育の仕組みを見直す必要があります。

AI技術を社会の中で実装させていくためには、こういった事前の準備が必要で先ほど出てきた性別などは今すぐにでも取り組む必要がある分野だと思います。そのためには女性がテクノロジー分野に入ってくる事も重要ですね。

これまで開発に携わる事がなかった人たちが、開発の設計に関わる必要がある理由は、機械で仕事のマッチングなどを判断するようになった際に将来良い仕事の機会に巡り合う事が難しくなる可能性があるからです。

例えば、女性の視点が入っていないシステムは、処理を行った際に自動的に女性にマッチした職種を少なく表示させる可能性があります。そう言った事を避けるためにも様々な人の立場を設計段階で組み込んでいく事が重要ですね。

これは女性などの性別だけに限らず、社会全体で「テクノロジーの恩恵を誰が享受できるのか」を考えた上で設計していく事が必要になります。設計の際にバイアスがかかってしまう事は避けられないので、意思決定者はデータで何が実現できて、出来ないのかを事前に理解している人が就く必要がありますね。

例を挙げてみましょう。システムを設計して、AIが自動で候補者の役職をデータから判断する場合に読み込むデータの設計に女性の視点が入っていない場合はAIが候補者のデータを判断する事で、女性以外を選んでしまう傾向が出る可能性もあります。

これはデータの倫理にも関わってくる問題で、事前に一定のレベルを設定して検討する必要があります。設計の際に想定するデータ以外の要素(この場合は男性視点では想像できない女性視点の要素)に関しては機械が判断する事ができないためこういった問題が発生してしまいます。

機械が特定の情報のみを処理する場合は、システムの背景にある人がどういった状況にあるのかを正確に把握する事が難しいため、想像しない危険な状況を生み出す可能性もあります。

これは世界中で話題になっているテーマで、ブラジルでは増加するフェイクニュース問題に関して議論を実施してきました。世界全体で見ると米国と中国が対立しているように、捉え方が大きく変わってきています。人によっては中国のワクチンはフェイクニュースの可能性があるので受け入れないという人もいると思います。

それ以外にもAIの課題としては場所や背景が異なる場合に柔軟に対応できない点が挙げられます。日本で開発された仕組みがブラジルでは上手く機能しないようなケースですね。加えて、誰が開発した機械に対して責任を負い、説明を行っていくのかが曖昧というのも問題です。

機械に欠陥があり、機械の判断で人が亡くなったりした場合に誰が責任を取るのかは問題になります。法的な責任も必要で、もしこういった問題に取り組めなければ安全に利用する事は難しいでしょう。

また、適切に法的な責任を追求するのも実は難しい問題です。これはユネスコでも議論されている問題ですが、多国籍での利用を考える際に適切なガバナンスは一体どういったものになるのかという問題です。その場合は政治家などのルールを決めていく人たちと連携しつつ相互の規律を作っていく必要がありテクノロジーだけで解決できる問題ではありません。

相互の規律と相互の側面を前提とした上で、複数のステークホルダーを前提として考えることも大切です。大学や市民社会、政府機関が連携する事はとても重要ですね。

議論を深めるだけでなく実際に道筋を示していく必要があります。政策を作る人たちが必ずしもテクノロジーに明るい訳ではないし、一方で技術者が政治に詳しいと言う事でもありません。法律の専門家でもないので、様々な分野の専門家が集まって議論する事が人工知能を発展させていくためには必要不可欠だと思います。

AIと倫理を考える上でまずは何から始めていけば良いか?

Kohei: その視点は大切ですね。ありがとうございます。少し具体的な質問をしたいと思うのですが、私たちが明日から倫理的に判断していくためにはどういった事をすれば良いのでしょうか?気になっている人は多くいると思うのですが、とても答える事が難しい質問だと思います。

まずはコミュニケーションなど小さく始めて見て、実際に話を聞いて見るなど複数のコミュニティを前提とした上で進めていくのが一つ考えられるのではないかと思っています。実際に倫理と技術の発展を並行していく上ではどういったアクションが必要になりそうでしょうか?

Edson: まずできる事としては技術自体の理解を世界全体で進めていく事だと思います。これはとても重要で、ほとんどの人たちはテクノロジー自体を理解していないからです。人工知能のシステムや知能とは何かも含めて間違った理解が進んでいます。

そこには教育におけるバックグラウンドを持っていない人でも参加できるようにして、政策を作るルールメーカーなどが入ってくる必要もあります。特に公正なシステムをAIで実現できないか政策を考える人たちは検討を進めているので、そういった人たちとも連携する必要があります。

(動画:Does AI make better decisions than humans? Thinking Ethics of AI)

もしシステムが中立公正で、世界中どんな人が利用しても公正に判断されるようになればそれは素晴らしい事だと思います。

こういったバイアスが無い状態で設計をすることは必要で、知性を前提に設計しなければ問題が多く発生してしまうと考えられます。一つ判断を間違うと、一つの技術で数多くの人たちの生活にも影響が及ぶ可能性もあります。

ブラジルではこういった問題がいくつも残っていて、課題が山積みですね。特に人種の問題などは深刻です。こういった人種差別のような考え方が仕組みに実装されると大きな問題になります。

黒人の人たちは白人の人たちと比較して罰を受ける機会が多くなってしまっていることも人種差別が現れている一つの象徴だと思います。女性に対する差別もそうです。改めて私たちは技術を十分に理解して、その上で権利を尊重する必要があります。

ブラジルではこれまでデータを企業が集めてそのデータをもとにサービスを提供する事が当たり前に行われていましたが、今はブラジル政府はGDPRのような規制を企業に要求しています。例えば、データを元にしてエネルギー企業がエネルギー利用に関して判断するようなケースもあると思います。

ここで考えるべき質問は「教育を十分に受ける事が難しい人たちが、システム利用を自ら避けるにはどうすればいいのか」と言う事です。倫理的な考え方を自動化の仕組みに加えて開発を実施することは、一般のユーザーが企業にや政府よって不利益を一方的に被ることを避ける場合にもつながりますし、これは初期のステップとしてとても大切な事です。

Kohei: 確かにそうですね。始めのステップとして私たち自身が自分たちの方向性を見出していく事はとても重要だと思います。とても面白いインタビューなのですが、残念ながら時間になってしまいました。最後に聞いてくださっている皆様にメッセージを頂いても宜しいでしょうか?

Edson: まずはこういった形でとても重要なトピックに関してお話しできてとても嬉しいです。特に技術の開発を進める上で倫理的な考え方は大切にして欲しいですね。これはとても急を擁するトピックでもあり、よりテクノロジーが安全に社会に出ていく上でも公正な仕組みを検討することは人間中心を前提にしても必要な事だと思います。

日本でも数多くの技術が開発され、ロボットの人工知能などは世界に届けていく技術の一つだと思います。こういった規律は倫理的な人工知能やロボット開発の模範になるのではないかと思います。

私たちの住む南アメリカやアフリカの地域でより良い生活を過ごすためにも新しいソリューションの開発は世界的にも重要な取り組みだと思います。こういった議論を皆さんと一緒に進めていく事ができればとても嬉しいです。

Kohei: 素晴らしい時間をありがとうございます。今回のトピックはとても幅広いものでしたが、とても参考になるお話しでした。技術開発を行う人たちだけでなく、様々なバックグラウンドの人たちが一緒になり、社会活動や政治的な動きも徐々に巻き込んでいけると良いですね。

Edsonさん。今日はインタビューにお越し頂きありがとうございました。お話しできてとても良かったです。是非皆さんとこれからの活動の橋渡しになれるよ良いと思います。

Edson: ありがとうございます。

Kohei: ありがとうございました。

データプライバシーに関するトレンドや今後の動きが気になる方は、Facebookに気軽にメッセージ頂ければお答えさせて頂きます!

プライバシーに関して語るコミュニティを運営しています!是非ご興味ある方はご参加ください!

「Privacy by Design Labコミュニティ」↓

いいなと思ったら応援しよう!