【Y Combinator Fall 2024 / Winter 2025】注目スタートアップ7選+最新バッチ動向、考察まとめ

初めまして、2024年クリスマス直前、HAKOBUNEにリモートでジョインした鈴木です!

2024年のFallバッチから2025年のWinterバッチにかけて、Y Combinator(以下、YC)はさらなる変革期を迎えています。

特にAI領域のスタートアップが全体の8〜9割近くを占めるほどAI一色な状況になっていることは周知のとおりですが、そのほかにも複数の新潮流が明確に見え始めています。

本記事では、YCの最新バッチ(Fall 2024・Winter 2025)を中心に、個人的に注目している7社のスタートアップと、YCの最新バッチから読み解ける大きなトレンド・考察をまとめてみました。読了後には、YCにおけるスタートアップの動向がどのようにシフトしつつあるのか、そして2025年以降に何が起きそうなのかをイメージいただけるのではないかと思います。

今回のトレンドと背景

AIスタートアップの比率がさらに増大

ここ数年のYCでは、AI関連スタートアップが32%(W23)→57%(S23)→70%(W24)→77%(S24)と大幅に増えていましたが、2024年Fallバッチでは実に87%が何らかの形でAIを活用しています。

AIといっても、生成AI(Generative AI)、音声AI、AIエージェント、デベロッパーツール(AIコパイロットやAIコーディング支援など)など、多岐にわたるサービスが登場。

とくにAIによる自動化の加速と人員リソースの大幅な削減が可能になりつつあるため、YC内でも「10人で年商数千万〜10億ドル規模のユニコーンが誕生する」シナリオが現実化しつつあると言われています。

小型バッチへの移行と“年4回化”

これまでYCは年2回の開催(Winter/Summer)で1バッチあたり200〜400社という規模が基本でした。

しかし2024年からはFallとSpringを加えて年4回となり、1バッチあたりの採択社数は約90社程度に縮小。

小規模化によってパートナーがスタートアップに個別に伴走できる時間が増えたため、バッチ全体の成長率(週成長10%、バッチ期間中3倍化など)が一段と向上していると言います。

ハードウェア・AR/VRの停滞、AIコーディングとガードレール系の台頭

過去にはAR/VRやロボティクス、ハードウェア系スタートアップが脚光を浴びるケースもありましたが、直近ではハードウェア関連は難易度が高いことや、物理的制約が多いことが再認識され、やや苦戦傾向。

他方で生成AIの「ハルシネーション(Hallucination)」やバイアス、企業ポリシーに適合する出力(ガードレール)を手掛けるスタートアップの注目度が急上昇。

さらに「AIエージェント」の商用化も徐々に進んでおり、営業担当や会計士の代替となる形で大手企業への導入事例が増えています。

注目スタートアップ7選

StudyDojo:個別最適化された学習体験で教育格差を縮めるAI家庭教師

カテゴリ

#教育 #EdTech

創設者

Bowen Liu:https://www.linkedin.com/in/bowen-liu/

Janet Liu:https://www.linkedin.com/in/janetwkliu

Michael Tong:https://www.linkedin.com/in/michaelytong

従来の学校教育では、一律のペースや内容に合わせて進行する授業が多く、理解度にバラつきが出たり、苦手分野に時間を割けない生徒が増えやすいという課題がありました。たとえばアメリカの教育統計によれば、中学・高校段階で学習意欲を失う生徒は30%以上に上り、学習習熟度にも大きな格差が生じています。

ここでStudy Dojoは、AIを活用して生徒一人ひとりの弱点や進捗状況をリアルタイムに把握し、最適な問題集やフラッシュカードを自動生成する仕組みを提供しています。

例えば、以下は私が高校時代に履修したIB(国際バカロレア)というプログラムのEconomics(経済学)の模擬試験を試したものです。

ここでAIに「ヒントをください!(Give me a hint)」と尋ねると、

AIが単純に答えではなくヒントを出力してくれます。

ヒントに沿って答えを入力すると、、、

論述形式の問題でもAIが瞬時に採点。9/15点という恥ずかしい点数を取ってしまいました。トホホ。。。しかしAIのフィードバックは的確です!

更にキーボード入力以外にも手書き画像や音声入力による回答にもAIが対応して採点してくれます。

従来なら教師や保護者が手作業で個別教材を用意する必要がありましたが、Study Dojoが提供するプラットフォームなら、生徒それぞれの状況に合わせた学習コンテンツをAIが効率的に作成し、進捗管理や段階的なフィードバックまでを一括して支援できるのが画期的です。

無料から使えて、AIチャットの無制限利用などのオプションを追加しても最大月35ドルでこのサービスが利用できることを考えると塾に通うより費用対効果がよほど高いと思われます。

既に2,000人以上の有料顧客を獲得し、年間経常収益が6桁台半ばに達している事実からも、ニーズの高さがうかがえます。こうしたアプローチにより、教師の負担軽減だけでなく、生徒の学習意欲向上にも寄与し、教育格差の解消に一役買っているのです。

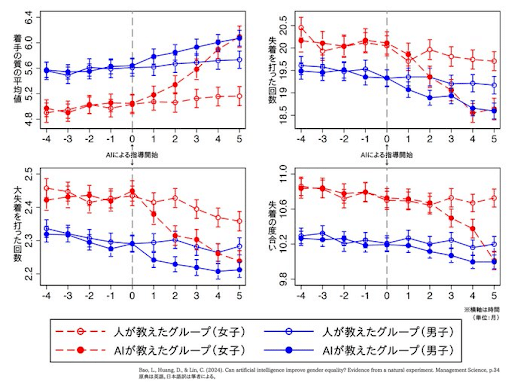

更にもう一点、私がStudyDojoに注目した背景として、2024年10月に公開された『Can Artificial Intelligence Improve Gender Equality? Evidence from a Natural Experiment(人工知能はジェンダー平等を向上させることができるか?実験からのエビデンス)』という論文が示唆した研究結果があります。

この論文では人間が囲碁を教えるグループとAIが囲碁を教えるグループに分けてその結果を男女別で検証したモノです。

結論から言うと、男女ともにAIが教えた子供たちの棋力が向上しただけでなく、AIによる指導の結果、男女の実力差が無くなったというのです。

この研究結果が示唆しているのは従来考えられていたように、性差によって棋力の向上に差がつくのではなく、指導する側の潜在的な(性差的な)感情によって子供の囲碁の成長が左右されていたということです。

囲碁の世界に限らず、通常の学校での教育やその他の業界でも、人間ではなくAIが指導することにより、より男女差のない世界が訪れるのでは!という期待感からもAI×教育という分野に引き続き注目していきたいです。

Edexia: 教師の採点負担を最大100%削減し、教育の質を高めるAIアシスタント

カテゴリ

#教育 #Saas#AIアシスタント

創設者

Daniel Gibbon:https://www.linkedin.com/in/daniel-gibbon-/

Nathan Wang:https://www.linkedin.com/in/nathan-wang-b73966235/

教育現場で特に負担が大きいのが、レポートや論述問題などの採点作業です。

2018年、文部科学省が調査した「教員勤務実態調査(全国の小学校400校、中学校400校に勤務する教員が対象)」の集計によると、全体の3割を占める教員が最も負担が大きいと感じている業務として、テストの採点などを含む「成績処理」と答えています。

採点や成績管理に割いている分、授業の準備や生徒への個別指導に時間をかけにくくなるというジレンマが生じています。

EdexiaはAIを用いて、教師一人ひとりの採点スタイルを学習し、ほぼ同じ基準で答案を評価できるシステムを提供します。

評価項目に関するドキュメントをアップロードするとEdexiaが自動的に学生の成果物やパフォーマンスを評価する際の具体的な基準や指標を生成します。

この評価項目をもとに生徒の最終成果物をEdexiaが生成した評価基準に沿って各評価項目に沿う文章をハイライトし、採点。

採点結果が気に入らなければ適宜修正を入れることができ、教師が一度修正を加えれば、AIがそのフィードバックを吸収し次回以降に反映するため、使えば使うほど精度が高まる点が特徴です。

また、教師のコメントに基づいた個別フィードバックも自動生成でき、生徒にとってより具体的で役立つ指摘が得られます。

こうした仕組みにより、教師は採点業務から解放され、授業改善や生徒サポートに注力できるのが画期的です。日本を含む多くの国で、教育現場の過重労働が社会問題化する中、Edexiaのようなソリューションは教師の働き方改革だけでなく、生徒の学習効果向上にも大きく寄与すると期待されています。

内申点を気にする生徒からしても、AIが客観的に採点して成績をつけてくれるというのはかなり納得感の高いものになるのではないでしょうか?

中学校時代、中間/期末テストは全て9割越えだったにも関わらず先生と折が合わず美術の評定が5段階中3だった筆者としても是非、美術を含めあらゆる分野においてAIが客観的な評価をしてくれる公平な世界を望むばかりです( ;∀;)

Lightscreen AI:不正行為を絶対に許さないエンジニア用AI面接プラットフォーム

カテゴリ

#Saas #人材採用#エンジニア#不正防止

創設者

Prachie Banthia:https://www.linkedin.com/in/prachiebanthia/

Gavin Saldanha:https://www.linkedin.com/in/gavin-v-saldanha/

企業がエンジニアを採用する際、必須となってくるのがコーディングテストやテクニカル面接です。

COVID-19のパンデミック以降、コーディング面接が全面的にリモートに移行したことにより、以前に比べても多くのエンジニアが応募するようになり、採用企業の面接担当のエンジニアに大幅に負担がかかっていました。その状況にさらなる追い打ちをかけたのがChatGPT等を用いた不正行為を行う応募者の出現です。

GAFA含めたテック企業に入社せんとアメリカの大学では従来、コンピュータサイエンス系の生徒はLeetCodeなどの『コーディング面接対策用学習サイト』を用いて必死に就職活動に備えていました。

ところが、ChatGPTを含むLLMの登場により、学生/転職者含め、まったく勉強せずコーディングスキルがなくても不正行為により楽々コーディング面接を突破できるようになってしまったのです。

学生/転職者には願ったりかなったりの状況かもしれませんが採用側の企業にとっては大問題です。

Lightscreen AIはこれらの課題に対処するために、AIを用いたペアプログラミング形式の面接を導入しました。

学生/転職者などの候補者はAIと一緒にコードを書きながら30分間問題解決に挑戦し、そのやりとりやコードの正確性、開発プロセスが即座に分析・可視化されます。面接が終わると数分で主要指標のハイライトや文字起こし、コード内容などを含むレポートが生成されます。

更にはテクニカルスキルやコミュニケーション能力といった面接官の主観に頼りがちだった指標に関してもAIが客観的かつ効率的に評価できる点が画期的です。

このようにLightscreen AIは、採用担当者の時間的なコストと評価の属人性を同時に削減すると共に、多くの企業が抱えるGPTを用いた不正行為などに対するコーディング面接の根本的な課題を解決しようとしているのです。

GPT等のAIによる不正行為に頭を悩ませているのは何も企業だけではありません。大学などの教育機関においてもCS系の学部を中心にこうしたシステムを導入することで、教師陣の不安や負担を軽減しつつ真に能力のある学生を適切かつ公平に評価できるようになるのではないでしょうか。

Rulebase:急増する音声詐欺をリアルタイム検知する金融セキュリティ

カテゴリ

#金融 #詐欺撲滅

創設者

Olaoluwa Gideon Ebose:https://linkedin.com/in/gideon-ebose-2a5187100

Chidi Williams:https://www.linkedin.com/in/chidiwilliams/

Rulebaseは、金融サービス業界における新種の音声詐欺対策を最前線で支援するスタートアップとして脚光を浴びています。昨今、電話やコールセンターを介したフィッシング、なりすまし攻撃が極端に巧妙化し、高齢者や多忙なビジネスパーソンを狙うケースが増加傾向にあります。

特にAIで生成された「音声クローン」は、人間の耳では判断しづらい微妙な声質の違いを補完し、巧みに語りかけるため、一度被害が起きると顧客や金融機関双方に大きな損失を与えかねません。

アメリカ連邦取引委員会(FTC)の報告では、2023年の電話関連詐欺による被害額が数十億ドルに上るとの推計があり、特に高齢者層が狙われやすい状況が深刻化しています。音声生成モデルの性能向上に伴い、法規制面の整備が求められる一方、まだまだ対策は追いついていないのが現状です。

2024年に話題になったメジャーリーガー大谷翔平選手の元通訳である水原一平氏による巨額窃盗の手口について、『水原容疑者は大谷になりすまして、約24回銀行に電話をかけて送金手続きを行った』と報道されていたのを覚えている方も少なくないでしょう。

水原氏の例は信頼関係を逆手に取った詐欺という意味でかなり特殊な例でしたが、今や合成音声の発達で有名人の音声などを簡単に生成し詐欺行為を働くことが容易になっているため電話音声による詐欺は指数関数的に増加すると予測されています。

Rulebaseのすごいところは、「リアルタイム」に音声を解析し、不正行為を検知・ブロックできる点にあります。具体的には、複数の音声パラメータ(発話テンポ、声紋特徴、抑揚パターン等)をAIモデルが統合的に評価することで、「合成音声らしさ」「なりすましの疑い」などを高精度で検出する仕組みを提供します。

AIによる音声分析技術を駆使し、人間の耳では見分けにくい合成音声の特徴を特定し、コールセンターのオペレーターに即時警告を出すのがRulebase独自の強みです。

さらに、従業員向けのトレーニングやシミュレーション機能をセットで導入することで、金融機関全体の“音声セキュリティリテラシー”を継続的に向上させることが可能です。

今後の発展としては、コールセンターの既存システム(CTIシステムやCRM)とのシームレス連携が重要課題となるでしょう。

顧客情報を参照しながら音声認証を行い、不自然なやり取りが発生した時点でフラグを立てるなどこうした自動フローの構築に、Rulebaseはさらに力を入れると考えられます。

また、金融セクターに限らず保険・医療・行政サービスなど“音声による本人確認”が日常的に行われる現場への拡張もあり得ます。音声クローン詐欺のリスクが全産業で高まっている今、Rulebaseは「音声セキュリティの標準プロトコル」として普及すると考えます。

Encore:中古品横断検索で大量消費社会に風穴を開けるAIマーケットプレイス

カテゴリ

#消費者 #小売テクノロジー

創設者

Alex Ruber:https://linkedin.com/in/alex-ruber

Parth Chopra:https://linkedin.com/in/parthematics

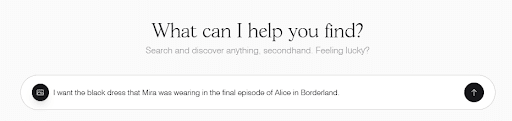

Encoreは、DepopやeBay、Grailed、Poshmarkなど複数の中古品マーケットプレイスに散らばる中古品(特にファッション系)をAIを用いて横断検索し、ユーザーに最適なアイテムを提案するプラットフォームを展開しています。

これまでは、中古市場に魅力を感じるユーザーでも「複数プラットフォームを行き来して検索するのが煩わしい」「ブランドやサイズ、状態などの条件を細かく指定するのが面倒」といった課題に直面することが多々ありました。

Encoreは、自然言語による会話型検索で「画面に映っていたあのドラマのヒロインが着ていたワンピースが欲しい!」といったあいまいなリクエストにも対応し、結果を横断的に提示してくれます。

試しにNetflixで全世界的なヒットを記録した『今際の国のアリス』に出演した私の推しでもある女優の仲里依紗扮するミラの服装を検索してみました。

今際の国のアリスで最終回に登場するミラが着ていた黒のドレスが欲しい!と検索

すると

候補の一つをぽちっと押すと

商品の候補を横断的にいろんなサイトから引っ張ってきて提示

中古市場は、単なる節約志向だけでなく、SDGsや循環型経済(サーキュラーエコノミー)の概念が浸透する中で年々拡大しており、米国だけでも中古ファッション市場は今後5年で2倍近くに成長すると予測されています。

Encoreが特徴的なのは、ファッションアイテムの検索にスタイリングのヒントやトレンド情報を付加することで、ユーザーが新品に近い感覚で“買い物の楽しさ”を味わえるよう設計している点です。

家のソファでゆったりとテレビでも見ながら気になる芸能人の着ている服やファッションが気になったら即座にEncoreがパーソナル ショッピング アシスタントとしてユーザーに寄り添ってくれるのです。

今後の発展としては、画像認識×パーソナルデータ×会話型AIの高度な統合により、「ユーザーが写真をアップロードすれば、類似デザインの中古アイテムをサイズ感も含めて一括提案する」といったさらなる進化が期待できるのではないでしょうか。

また、“中古品の再販売→Encore→再び消費者の手へ”という流通サイクルを可視化することで、カーボンフットプリント削減の測定や、各アイテムの「環境インパクトラベル」を提示する機能も十分に考えられます。中古品購入を単なるお得な選択ではなく、環境保護や社会的意義を意識した行動として捉えるユーザーによる需要もかなりあるのではないかと期待しています。

CTGT:AIのハルシネーションを排除し企業の安全なAI導入を加速

カテゴリ

#BtoB #Saas#企業向け

創設者

Cyril Gorlla:https://linkedin.com/in/cyrilgorlla

Trevor Tuttle:https://linkedin.com/in/trevor-j-tuttle

AIが吐き出す出力のなかでも、「ハルシネーション(Hallucination)」は生成AIや大規模言語モデル(LLM)が社会実装されるにつれ特に大きな問題として認識されています。ハルシネーションとは、LLMが自信満々に誤った内容を述べたり、存在しない文献を引用するなどの事象で、ハルシネーションによる誤情報やバイアスによる被害事例が後を絶たない状況です。

例えばアメリカの弁護士であるスティーブン・シュワルツ氏が訴訟のために用意した複数件の裁判事例が全てChatGPTによる出力結果であり実際には存在しない判例であることが判明し2000ドルの制裁金を科されるという事例まで出てきました。

AIを活用したい企業としても、AIの出力品質や信頼性に不安があるとして、特に医療や金融など厳密さが求められる領域での導入が遅れている一因になっています。

CTGTは、このハルシネーションや意図しないバイアスをリアルタイムで検知・防止するプラットフォームを提供するスタートアップとして、高い評価を得ています。たとえば医療分野では、患者の病状説明や投薬情報をAIが誤って伝えると取り返しのつかない被害を招きかねないため、CTGTのソリューションが“セーフティレイヤー”として不可欠になる可能性が非常に高いです。

例えば上記の画像の例ではユーザーがLLMに対して、『第3四半期のパフォーマンスについて投資家に送るメールを作成して』というインプットに対して、

『親愛なる投資家の皆様、

第3四半期の結果は、収益が2億4,500万ドルとなり、前年比で12%減少しました。市場環境は厳しいものでしたが、私たちは長期的な成長について楽観的であり続けています。』

と『楽観的』という無責任な言葉を用いたアウトプットが出てきました。リスクがつきものの投資において、もし、来期の結果も芳しくないものだとしたら、このメールを送った担当者は投資家から責任を取らされるかもしれません。

これに対して、CTGTの技術を使い、リスクを低減させた書き方にすると、

『親愛なる投資家の皆様、

第3四半期の結果は、収益が2億4,500万ドルとなり、前年比で12%減少しましたが、市場環境が厳しかったことが要因です。コスト削減の取り組みは計画通りに進行しております。』

と、あくまでも事実ベースに留まったアウトプットを出力してくれるようになりました。

CTGTの技術的特徴は、大規模言語モデル(LLM)の出力と内部表現をモニタリングし、いったん曖昧または不確実と判断した場合に即座にフィードバックループをかける点にあります。これにより、モデルが誤った回答に進む前に軌道修正することが可能になり、安定感の高い応答を提供できます。また、企業が独自のポリシーやドメイン知識を組み込んで再学習する際に、学習バイアスを自動的に検出・補正する機能も注目ポイントです。

広義的に見れば、この「ハルシネーション防止エンジン」は単なるチャットボットにとどまらず、自動化が進むあらゆるAIサービスの品質保証レイヤーとして広く適用されるかもしれません。

たとえば自動契約書作成ツールやニュース生成ツールなどでも、誤解を招く文言や不適切な言及を削ぎ落とすためにCTGTの仕組みを導入する余地があるわけです。さらに将来的には、「AI同士が会話する場面」(例:社内エージェントと外部エージェントが連携するケース)においても、ハルシネーションやバイアスの連鎖を防ぐための仲裁者的役割を担うシステムへと拡張可能でしょう。エージェント同士の自動交渉が主流になる未来が見据えられる中で、CTGTのような安全弁の存在はますます重要度を増すと考えられます。

Galini: 企業ポリシーと業界規制に適合するガードレールを「即時構築」できるAI運用基盤

カテゴリ

#BtoB #Saas#企業向け#コンプライアンス

創設者

Shaun Ayrton:https://www.linkedin.com/in/shaun-ayrton/

Raul Zablah:https://www.linkedin.com/in/raulzablah

生成AIの社会実装が進む一方、コンプライアンス違反や不適切出力のリスクを恐れて導入に踏み切れない企業は多数存在します。金融や医療、行政においては業界規制が厳しく、たとえAIが業務効率を何十%も向上できる見込みがあっても、ガイドラインを満たせなければ導入不可という現状があります。

Galiniは、そうした企業向けにカスタマイズ可能なガードレールを素早く構築・展開できるプラットフォームを提供し、一種の“AI導入の安全ネット”として機能しています。

ガードレールというと何かの専門用語に聞こえるかもしれませんが単純に車道と歩道の間に設置してある下の画像のようなモノを想像してください。

AIが自動車だとすれば、まだ誕生して数年の発明品です。自動車が誕生した当時、道路は整備されていたでしょうか?道路交通法は制定されていたでしょうか?交通ルール、速度制限、そんなものが存在していたでしょうか?

法整備も追いついていないという意味では未だ黎明期といっても過言ではないAIにとって、物理的に事故を防ぐためのガードレールは必要不可欠なのです。勿論、AI開発企業や当局がAI開発・運用のための自主的ガイドラインや法整備をしてくれるのが望ましいのですが、現状、企業がAIを導入するにあたっては自主的に安全性を高めるための責任が求められるのです。その解決策の一つがガードレールの導入というわけです。

Galiniが革新的なのは、企業のポリシーや法規制をGUI上で設定し、その設定に基づき有害な入力と出力をリアルタイムにブロックできる点です。これにより、自社にとって不適切なカテゴリーの語彙や、センシティブな個人情報に抵触するような問い合わせがあった際、システム側で自動的に対処できます。加えて、ガードレールの効果をテストし、必要に応じて微調整していく仕組みも整っているため、PoCから本番運用までシームレスに移行可能です。

今後の展開を考えると、Galiniは企業毎のAI統制ハブとして進化し、複数のAIエージェントが混在する環境で「どのエージェントにどの範囲の権限を与えるか」を一元管理する未来像も見えてきます。たとえば、顧客データを扱うエージェントは金融系ガードレールを厳格に適用し、人事関連エージェントは個人情報保護ルールを厚めに設定するなど、部署や役割ごとにルールを分けることで、企業全体のAI活用度合いを最適化できるかもしれません。さらに規制当局がAI利用に対する新基準を設けた場合でも、Galiniを介して柔軟にアップデートを行えるため、企業にとっては“導入後のリスク管理コスト”の大幅な低減につながるでしょう。

考察

ここでは、AIが主役となりつつあるYCの現状と、シードステージ全体を取り巻く変化を整理しながら、なぜこれほどまでにAI偏重になっているのか、そしてこの流れが今後どう影響を及ぼすのかを考察します。

1. 新世代のシードステージ:少人数・短期間で急成長する企業の出現

1.1. AI自動化で劇的に下がる人件費

AIがこれだけ注目を集める大きな理由のひとつは、人件費の削減余地です。従来、スタートアップが成長するにはエンジニアの大量採用や営業チームの増強など、「人海戦術」がある程度必要でした。しかし、コード生成AIや会話型エージェントが普及すれば、10人~20人規模で回していた業務を3~5人以下でカバーできるケースが増えてきます。

YCパートナーのGary Tan(ギャリー・タン)氏も「2~3人のチームが1年で数千万ドルのARRを到達させる可能性がある」旨の言及をしており、この「スモールチーム+AI」というモデルがすでにYCのいくつかのスタートアップで成果を上げ始めています。

結果として、シリーズAやBなどの大型ラウンドが不要になることも考えられ、シードラウンドのみでキャッシュフローを回して黒字転換を果たし、そのままエグジットへ向かう企業が出てくるかもしれません。これは従来のVC投資サイクルにも大きな影響を与える可能性があります。

1.2. 超高速プロダクト開発とエンドユーザーへの浸透

AIの恩恵は人件費削減だけではありません。プロダクトの開発スピードが数倍にアップし、わずか数週間~数ヶ月でMVPを組み上げることが可能になります。さらに営業やカスタマーサクセスも半自動化できれば、初期導入企業のサポートを人手に頼らず大規模に展開できるのです。

このように「小さなチームが短期間で大きな市場に浸透する」現象は、YCのデモデイ前後の短期間で月次売上が何倍にもなるという事例として既に複数報告されています。先述のとおりYCのバッチ期間で週10%の成長を実現する企業が珍しくなくなってきた背景には、この圧倒的な開発効率化があると考えられます。

1.3. 競合優位性の確立とリスク

一方で、AIを活用したサービスは「AIモデルさえオープンソースなどで手に入れば、ほかの競合もすぐに真似できる」という課題も抱えています。従来のSaaSであれば顧客データやカスタマイズに時間がかかり、差別化が進む余地も大きかったのですが、AIの世界では競合がほぼ同じ基盤モデルを用いて短期間で追随してくる可能性があります。

したがって、小人数で急成長を狙うAIスタートアップにとっては「ドメイン知識」や「データ独占」がいっそう重要になり、単なるコモディティAIの上にUIを付けただけのモデルでは生き残りが難しくなるでしょう。YCのパートナーたちも、そのあたりのデータソースやバーティカル特化度を厳しく見極めていると推測されます。

2. バーティカル特化AIの急拡大と、その先にある「エージェント化」への道

2.1. バーティカル特化AIの台頭

汎用LLMが飽和していく中での差別化

2022年末〜2023年初頭には、ChatGPTのAPIを利用した「ジェネリックなAIチャット」や「汎用的な要約ツール」などが一斉に生まれました。しかし、それらの多くは明確な差別化やユースケースの定義が甘く、数ヶ月後には競争に埋もれてしまったケースが少なくありません。

こうした流れを受けて、2024年以降のYCスタートアップを見ると、はじめから特定の業界や課題領域に向けてカスタマイズされたLLMを導入する企業が圧倒的に増加している印象を受けます。たとえば、

Study Dojo:教育×AI

Lightscreen AI:技術面接×AI

Rulebase:金融詐欺対策×AI

Edexia:教師の採点支援×AI

いずれも実運用に耐えうる品質を目指し、単なる「GPTラッパー(wrapper)ツール」ではなく、業界固有の要件を熟知したプロダクトを志向している点が特徴的です。

「データの垂直統合」が鍵

バーティカル特化AIにおいて最も重要なのは、その領域ならではの専用データをどれだけ保有し、AIモデルのファインチューニングや評価指標に活用できるかです。

教育領域なら学習カリキュラム、教材データ、学習ログ

技術面接領域なら候補者のコード提出ログや面接対話ログ

金融詐欺対策なら音声や通話内容、認証データベース

このようなドメイン特有のビッグデータを握ることができれば、競合他社には模倣しにくい差別化された精度を実現できます。

YC参加スタートアップの多くは、小さくても独自の「データパイプライン」を構築し、そこをバリヤー(参入障壁)にしようとしている点が大きな共通項だといえます。

バーティカルAIがもたらす業務効率化・コスト削減

とりわけ教育や金融、採用などでは人の目や手をかける工程がまだまだ多いのが現状です。そこにAIを導入することで、作業が半自動化され、最大90~100%近いコスト削減が見込めるケースも存在します。例えばEdexiaでは、「教師の採点業務をほぼ丸ごとAIに任せる」ことを実証しようとしていますし、Study Dojoは「AI個別指導」が一定レベルに達しつつあります。

一方、こうした人間の判断が多分に入り込む領域だからこそ、バーティカルAI導入には専門性が求められ、企業や学校がすぐに導入を決めるにはリスク評価が必要です。結果的にガードレール系や解釈可能性ツールとの連携が非常に重要になり、スタートアップ同士のエコシステム的な相乗効果が期待されるのではないでしょうか。

2.2. AIエージェントとしての進化:現実と期待

AIエージェントとは何か

最近、「AIエージェント」と呼ばれる概念が大きく注目を集めています。これは人間の最小限の指示だけで、自律的にタスクを遂行し続けるAIプログラムを指すものが多いです。たとえば営業のAIエージェントなら、見込み客リストを生成し、メールを送り、反応をモニターして返信内容を考え、次のアクションを自動で決定していきます。

YCの中でも、“AIセールスアシスタント”や“AIリクルーター”といったエージェント型のサービスを提供する企業が増え始めており、今後「AIエージェント×バーティカル特化」という形でさらなる深化が見込まれます。

エージェント化の3つのフェーズ

AIエージェントの普及は、ざっくり以下の3つのフェーズで進むと考えられます。

操作的フェーズ:現行のLLMチャットボットが主流となり、人間が都度プロンプトを与えながらタスクを実行させる。

自動化フェーズ:特定の領域(営業、採用、カスタマーサポートなど)に特化したエージェントが登場し、最小限の人間の監督で業務を回せるようになる。

汎用フェーズ:大半の知的タスクがエージェントにより横断的に処理され、人間は最終承認や戦略決定だけを担当。複数エージェントが連携して企業活動をほぼ自動運営するケースも出現。

現在はフェーズ2に足を踏み入れつつあり、YCが後押しするスタートアップの多くは「自動化フェーズ」に適合したソリューションを急ピッチで構築している段階と言えます。

エージェント化を阻むハードル

とはいえ、AIエージェントがフル稼働するには以下の課題が存在します。

誤作動リスク:ハルシネーションや不適切判断により、不利益なメールや対応をしてしまう可能性がある。

責任所在の不明確化:AIが独自判断で行動した結果、法的問題やブランド毀損が起こった場合に誰が責任を負うのか。

データ共有・権限管理:AIに任せるタスクが増えるほど、機密データへのアクセスが必要になるが、企業のセキュリティポリシーと衝突する可能性がある。

これらのハードルは、「AIセーフティ」「コンプライアンスガードレール」「ハルシネーションモニタリング」などのソリューションによって徐々に解消されると期待されています。まさにGaliniやCTGTなどがこの領域を補完することでAIエージェントの安全かつ規制遵守な運用が実現していく流れです。

2.3. セーフティ系・ガードレール系サービスの将来的な地位

“AI管理プラットフォーム”の誕生

ユーザー企業が複数のAIエージェントを運用し始めると、それを一元的に管理し、出力を監視し、必要に応じてポリシーを変更する「AI管理プラットフォーム」が必要となります。Galiniが掲げる「ガードレールアズアサービス」はこの流れの先駆けと言えますが、さらに大規模な「企業AIオーケストレーション」サービスが登場する可能性も大いにあるでしょう。

たとえば、すべてのAIエージェントを一括でモニタリングし、分散しているログを集約してダッシュボード化、さらに音声認証やコンプライアンスチェックを通じて「このエージェントに与えている権限が適切か」を常時検証するような仕組みが必要とされるはずです。

規制強化がもたらす追い風

AIの社会実装が進むほど、各国での法規制や業界ガイドラインは強化されていくと予想されます。EUではAI Actが議論され、米国でも連邦政府レベルでの規制検討が本格化しています。日本でも個人情報保護法や産業別のガイドラインが今後アップデートされていくでしょう。

規制が厳しくなるほど「コンプライアンスを満たしつつAIを使いたい」とする企業需要が増大し、その需要を満たすガードレール系ソリューションが一層不可欠になります。結果的にGaliniやCTGTのようなスタートアップが業界標準として大成する可能性が高まります。

(終わりに)

以上の考察から、YCバッチ(Fall 2024 ~ Winter 2025)で見られるAI偏重やガードレール系スタートアップの盛り上がりは、単なる一時的なブームではなく、“AIが当たり前に使われる社会に向けての準備段階”であることが浮き彫りになります。今回取り上げた7社の事例は、その最先端の断面を示すにすぎません。

さらなるAI活用の深まり

レギュレーションやコンプライアンス強化への対応

小人数・高速成長スタイルの定着

これらが複合的に作用し、新しいシード投資モデル、あるいは新しいスタートアップのかたちが2025年以降に主流化していくでしょう。今後のYCに注目しながら、スタートアップや事業を立ち上げようとする方々にとっては、AIと垂直特化、ガードレールという3つのキーワードを念頭に置きながら、如何にして独自の差別化と優位性を構築するかが重要なテーマになるのではないでしょうか。

HAKOBUNEとしての展望

HAKOBUNEでは今回取り上げたStudy DojoやGaliniのような“AI×教育” “AI×コンプライアンス” “AI×金融セキュリティ”など、多様な領域でのAIの応用可能性を注視しています。特にバーティカルAIがますます充実していくことで、社会のあらゆる業種・業態が根本的に再定義されていくことは確実でしょう。

私たちも、これからの社会を担う起業家の方々と積極的にコミュニケーションを図り、AIの成長が加速するこのタイミングで、新しい価値創造に貢献していきたいと考えています。

もしアイデア段階やPoC段階の方で「こういうサービスを作りたい」という方がいらっしゃいましたら、ぜひお気軽にご連絡ください。HAKOBUNEは引き続き、AIをはじめとした先端領域への投資・支援を積極的に行ってまいります。

HAKOBUNEのウェブサイト:https://www.hkbn.vc

筆者のXアカウント : https://x.com/S_Suzuki_ring

参考文献・リンク

YC Fall 2024 batch applications due by 8/27

https://www.youtube.com/watch?v=sx9oisgdCmg