他人事ではない動画生成AI 私たちの仕事や生活にどう影響するのか 今後やってくるカオスと対策

こちらでは動画生成AI(人工知能)が私たちの普段の仕事や生活にどのような影響を与えるかについて、ここ1ヶ月の100を超える海外・国内の文献調査の結果や私なりの見解も含めて記載しようと思います。

※2024年3月30日に開催されたMachine Learning 15 minutes! (ML15minutes)において私が講演した内容に沿って記載します

OpenAIから動画生成AIであるSoraが2024年2月15日に発表されました。これまでも動画生成AIは存在していましたがSoraはこれまでのものと一線を画します。1分間という長さの、あまり違和感の無いリアルな動画を生成することができ、私もそのニュースを知ったときは興奮しました。非常にリアルな動画、Hyper Realistic Videoを生成することができるAIの到来です。

私たちがあまり違和感を感じない理由は動画の鮮明さだけではなく前のフレームと後のフレームの連続性の維持にあります。もちろん現時点で完全というわけではありませんが、これまでのものと比較して長い時間にわたって同じ見た目の人物や動物、物体を表すことが可能です。

私はどちらかといえばコンピュータをどんどん使っていこうと考えています。しかしSoraのニュースを見たときは興奮と同時に「これはまずいな」と感じました。良い影響だけではなくそのまま利用されると悪い影響も与えかねないと思ったためです。

実際、OpenAIのSoraやVoice Engineが現時点で一般に公開されていないのもそのような影響を考えてのことです。OpenAIの最近のブログを見ていると安全性について特に気にしていることが伝わってきます。現にVoice Engineについて紹介されているページの冒頭の文でsafeという単語が用いられています。

良い影響と悪い影響、こうなるのではないかという仮説をまずはそれぞれに対してざっくりと想像しました。しかし自らの仮説の解像度に荒さを感じました。解像度を高めるためにも海外の文献を調査するところから始めました。

パーソナライズ動画に対する可能性と影響

動画生成AIによって海外で今話題になっているトレンドのひとつにパーソナライズ動画に対する可能性が挙げられます。

パーソナライズ広告動画

広告業界ではこれまで比較的大きな人数に対して少数の動画を作成していました。それは動画を作るコストが高いためです。

一方で動画を作るコストが下がれば動画をたくさん作ることができます。現状としてはクラスター(集団)ごとにいちいち広告やマーケティングのための動画を作り分けている例は少ないと思いますが、そのようなことも可能になりますし、究極的には個々人に対してそれぞれの人にささりやすい広告動画を生成AIによって作ることが可能になるでしょう。

もちろん現在の動画生成AIですぐにそのようなことができるかといわれると技術的な課題はまだあると思います。しかし違和感のあまりない非常にリアルな動画をAIが生成できつつある現状や今後のAIの進化を考えればこれらの可能性があることは明らかです。

個々人にささりやすい広告動画を作ることができればコンバージョン率の改善が期待できます。

パーソナライズ学習動画

またパーソナライズ学習動画も期待されています。これは個々人の細かな学習状況にあわせた学習動画をAIが生成し個々人が別々の動画をみることができるというものです。

皆が一様に同じ講義を聴いて内容を学ぶのではなく本人にとって今必要な学習動画を生成することで学習効率の向上が期待できます。

学校の学習において教科書だけではなく授業があるのは文章よりも目で見る動画のほうがわかりやすいからだと私は考えています。

パーソナライズ学習動画を作成するには単に教材を作ればよいというわけではありません。個々人の学習状況や過去の問題集・テストの正答の結果など複数のデータが必要になるでしょう。それらのデータと組み合わさることであるタイミングで個々人に届けるべき動画が何であるかが決まるはずです。

個々人にあわせた学習というと個別指導に近いですが、これまでの個別指導と比較して人件費を圧倒的に抑えることができるかもしれません。

もちろん現在のSoraのような動画生成AIは莫大な電力を消費しようしているという報道もありますが、近年は比較的小さなモデルでの精度の向上や特定用途の半導体の開発・製造による処理の高速化・省エネ化などの進化もあり、消費電力やAIを維持するためのコストも長期的には下がっていくことが予想されます。

個別指導で大量の教師を雇用するコストを下回って、これらの学習動画の品質が追いつけば個別指導塾に対して競合になり得ます。

この話はあくまで一例であり、動画を作る人だけではなく思わぬ人たちが影響を受ける可能性があることを示しています。

動画を作る人に対する影響

映像制作者への影響

2024年3月7日のテレビ東京 ワールドビジネスサテライトにて映像アーティストのカイル・グッドリッチさんは、AIはハリウッドを変えるのかというインタビューに対して以下のように答えています。

「少なくともこうした技術を知るべきだ 映像制作でもAIの活用で新しいドアが開く」

また映画「オッペンハイマー」の監督であるクリストファー・ノーラン監督は以下のように語っています。

「驚きではなかった。映画関係者はAIのポテンシャルに気付いていた」

AIを積極的に利用しようとする人やその可能性に気づいている人が業界の中においてもすでに一定数存在しています。

テキストを入力するだけで動画を作ることができるのであれば、制作に関わるコストを削減することができることはわかりやすい用途でしょう。

今年2月にタイラー・ペリーさんが8億ドル規模(日本円にして約1400億円)のスタジオ拡張を中止すると発表したことは海外でニュースになりました。

330エーカーの所有地に12のサウンドステージを追加する予定だったタイラー・ペリーさんはSoraの能力を知り、この技術によりロケ地の移動やセットの建設が不要になるかもしれないと述べています。またSoraのようなツールはエンターテイメント業界のクリエイティブな人間の生活に直接の脅威をもたらすと考えていることも明らかにしています。

映画のセットやロケ地で働く人たちに対してある一件の判断だけでも約1400億円の仕事が中止になっているという事実から、すでに業界で影響は出始めていると考えて良いでしょう。

アニメーション産業で働く人への影響

今後のアニメーション産業への影響はどうでしょうか。先ほどと同じくワールドビジネスサテライトの取材にてカリフォルニア州立大学ロングビーチ校のオーブリー・ミンツ教授は以下のように述べています。

「(AIによって)アニメの仕事の9割が置き換えられるか深刻な影響を受ける」

「5年間で伝統的なアニメ手法は一掃された」

取材の際にミンツ教授が座っていた椅子の横にあったデスクはかつてディズニーで使われていたものでした。過去の人員整理で放出されたもので、過去とはかつてコンピュータ・グラフィックスが導入された以降の時期をさします。過去にも人員整理はあったのです。

どのような動画の制作に対して影響があるか

ではどのような動画の制作に対して影響があるのでしょうか。まず影響が考えられる動画はライトユースや素材系の動画です。

これらの動画はあまり細かなこだわりがなく用いられます。そのため置き換えが比較的容易です。

一方でプロ向けの細かな表現が必要な動画や、動画を作る際の意思決定に関する仕事は現時点で全ては代替されないだろうという見方もあります。私も同意見です。

Martin Gent, creative director, Buska Video

I believe the first to be impacted by Sora’s release will be the stock video libraries, as has been the case with AI image generation. Then we’ll start seeing Sora being used to generate things like establishing shots and GVs.

Soraのリリースによって最初に影響を受けるのは、AI画像生成の場合と同様に、ストックビデオライブラリーだと思います。そして、エスタブリッシングショットやGVのようなものを生成するためにSoraが使われ始めるでしょう。

Ludo Fealy, founding partner, nineteentwenty VFX

I’ll finish by saying that no amount of code or computing power will ever replace the expression, spontaneity and decision making powered by the creative eye of the human.

どんなにコードや計算能力を駆使しても、人間の創造的な目による表現力、自発性、意思決定には取って代われないということを最後に言っておきましょう。

※上記の引用元にはさまざまな動画制作のプロの意見がまとめられており、クリエイターへの今後の影響を考える上で個人的に最も参考になったページでした

動画を利用する人に対する影響

実はこちらで私がもっともお伝えしたいことは動画を利用する人に対する影響です。

私も普段何気なくYouTube等で動画を見ますが、そのような動画を見ている私たちに対しても影響があります。

ではどのような影響が考えられるでしょか。影響について考えるうえで、私がまずは思い出したのはPeter Aikenさんのフレームワークです。

これまでと異なり非常にリアルな動画を生成することが可能である新たなものが生まれつつある中で、AIはデータと表裏一体です。AIが学習するものはデータですし、AIがアウトプットするものもデータです。データを軸に私たちへの今後の影響について考えてみましょう。

こちらのフレームワークは企業があるアプリケーションを導入しようとしたときにどのような変遷をたどるかについてまとめられています。

企業があるアプリケーションを導入しようとした際、以下の順で考えていくことになるというものです。とてもざっくりと解説します。

フェーズ1:データストレージ、前処理などのオペレーション、セキュリティ、データモデリング

フェーズ2:データアーキテクチャ、データ品質、メタデータ

フェーズ3:基本的なデータ分析(ビジネス・インテリジェンス)、マスタデータ、ドキュメントやコンテンツの整備、データの利活用を推進するためのルール作りと徹底(データガバナンス)

フェーズ4:これらを達成してようやく高度なデータの利活用が可能に

高度なデータの利活用とは高度なAIの利活用と考えていただいて良いと思います。

これらを軸として考えるとすでにこちらに沿って影響が出始めており、対策を考える時期がきていることがわかります。

リアルな動画で騙されないために 新たなセキュリティ

これまでは動画を作るコストは比較的高いものでした。特に違和感のない映像・音声の動画をゼロから作ろうとすればCGなどの高い技術や制作のための長い時間が必要でした。そのためフェイク動画もすでに存在はしていましたが数には限りがありましたし、顔の一部を変えただけのもので違和感が残るものもありました。

以下は2023年に公開されたフェイク動画です。岸田首相の声が加工されて卑猥な言葉を発しているように見せかけています。

上記の動画は口の部分だけが動く動画であり違和感を感じます。

しかしフェイク動画を作るコストが下がり、しかも違和感のない非常にリアルな動画を簡単に作ることができる場合に今後どうなるでしょうか。

もし悪意を持った人によって非常にリアルなフェイク動画が量産され、拡散されると誤った情報が拡散されてしまい誤った理解や判断・行動につながる可能性があります。

本物と区別がつかない

非常にリアルな動画、Hyper Realistic Videoは違和感がないために本物なのかどうか区別がつかない可能性があります。

以下ではSoraが生成した動画と現実世界の動画について1000人以上の成人に対して調査をした結果、ビッグサーの動画については約60%の回答者が「人間が動画を作った」と誤って推測していることが報道されています。またそれ以外の動画も多くの人々が誤った推測をしています。

ある動画が本物かどうかということはこれまでそれほど真剣に考えられていなかったと思います。簡単にフェイク動画を作ることができるために、非常にリアルなフェイク動画が多く出回った場合、それらによってだまされて人に危害が加わることを防ぐためのセキュリティの重要性が増します。

現時点でフェイクだと見抜くための強力な方法は無い

そして憂慮すべきことに現時点でフェイク動画かどうかを見抜くための強力な方法はありません。今回もそのような技術がないかを海外の文献を中心に探しましたが現時点では無いというのが私の結論です。以下の2024年3月7日のnature誌の記事にもそのことは記載されております。

And there is currently no robust method for detecting such images and videos. “It's going to get pretty scary in the sense we are going to be bombarded by fake and synthetically generated data,” says Rodriguez. To address this, some researchers are developing ways to inject signals into AI-generated images to enable their detection.

そして、そのような画像や動画を検出する強固な方法は今のところ存在しない。「フェイクや合成で生成されたデータで溢れかえるという意味で、かなり恐ろしいことになるでしょう」とロドリゲスは言う。これに対処するため、AIが生成した画像に信号を注入して検出できるようにする方法を開発している研究者もいる。

もちろん全くこれらの対策方法が無いわけではありませんし、個々での対策は存在します。しかし、これという決定打が現時点では無いことも事実です。

そのため、フェイク動画であるかどうかを見破るための仕組みや技術が確立されるまでは、フェイク動画かどうかがよくわからないカオスな状態になる可能性があります。個人的にはそうなって欲しくはないですが、こちらを書いている今も以下のような、ネットにアップされた動画がリアルなのかフェイクなのかわからないといった記事が出てきており、すでにカオスな状態は始まっているとみています。

社会がすでにそのような状態に直面していることをまずは一人ひとりが認識しなければなりません。

現時点での対策

2024年3月19日の国内外の報道でYouTubeが生成AIを使ったリアルな動画へのラベル付けを義務化するニュースが報道されました。海外の記事によればラベル付された動画は「サウンドやビジュアルは主に編集されたものまたはデジタルで生成されたもの」といったように表示されるとのことです。

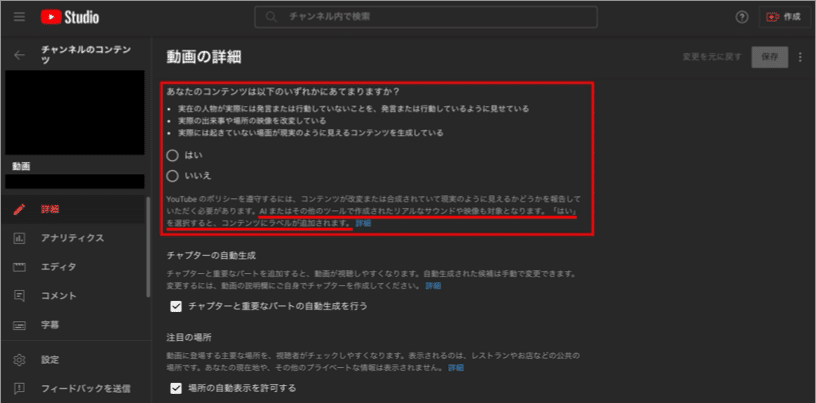

記事では英語版のYouTubeのページについて記載されていたため試しに自分でYouTubeスタジオを開いてみると、日本語版においても本件に関わる選択肢があることを確認しました。

これはメタデータの一種です。メタデータをざっくりと解説すると「データを説明するためのデータ」です。たとえばこの動画は誰が作ったのか、いつ作ったのか、どのように作ったのかといったその動画を説明するためのデータはメタデータです。

ただしYouTubeのラベル付けに関する例は現時点ではあくまで人によるラベリングです。悪意を持った人が素直にフェイク動画に対してラベリングをつけることは目的からすると考えにくいと思います。

Meta社の以下のウェブサイトでは、動画ではありませんが画像生成AIに対するラベル付けに関する記載があります。

目に見えるマーカーだけではなく目に見えない透かしや、さらには透かしがなかったとしてもAIによって生成されたコンテンツかどうかを自動的に検出するための分類器の開発についても言及されています。

But it’s not yet possible to identify all AI-generated content, and there are ways that people can strip out invisible markers. So we’re pursuing a range of options. We’re working hard to develop classifiers that can help us to automatically detect AI-generated content, even if the content lacks invisible markers. At the same time, we’re looking for ways to make it more difficult to remove or alter invisible watermarks.

AI が生成したコンテンツをすべて識別することはまだ不可能であり、人間が目に見えないマーカーを取り除く方法はあります。そのため、私たちはさまざまな選択肢を追求しています。私たちは、コンテンツに目に見えないマーカーがない場合でも、AI によって生成されたコンテンツを自動的に検出できる分類器の開発に熱心に取り組んでいます。同時に、目に見えない透かしの削除や変更をより困難にする方法を模索しています。

政治に対する影響

EUにおいては生成AIと透かしに関する文書が2023年12月に公表されています。

Generative AI and watermarking

https://www.europarl.europa.eu/RegData/etudes/BRIE/2023/757583/EPRS_BRI(2023)757583_EN.pdf

また以下の2024年3月13日に公開されたWSJによるOpenAIのCTO(最高技術責任者)であるミラ・ムラティさんへのインタビューにおいては記者から2024年11月の大統領選挙について質問されています。

Soraを可能であれな今年中にリリースをしたいとミラ・ムラティさんが述べたあとすぐに記者から、リリースが選挙の前になりそうか後になりそうかを尋ねられています。

このように非常にリアルな動画、Hyper Realistic Videoを作ることができる生成AIはEUの政策やアメリカ大統領選挙といった政治にも影響を与え始めています。

カメラで撮影したかどうかを確認する技術

以下は画像の例にはなりますが、個々での対策のひとつとしてある画像がカメラで撮影したかどうかを検証することが可能になる技術をソニーが発表しています。以下は2024年3月28日の国内の報道です。

今私たちにできること

今私たちにできることは、その動画データの出所はどこであるかを確認することです。どこが発信しているのか、誰が発信しているのかという情報です。

先ほどの岸田首相のフェイク動画はあたかも日本テレビが出しているかのような見せかけがある点について注意が必要です。特に重要な情報についてはチラ見ではなくきちんと出所を確認したほうが良いです。

もちろんそれらも100%信頼できるわけではないかもしれません。しかし、どこが発信しているかわからない、誰が発信しているかわからない動画データよりは、出所が明らかである動画データのほうが信頼できます。

また以前から名前が知られており社会的に信頼がある報道機関や公的機関などが出所元である情報は信頼性が比較的高いでしょう。

その動画データが信頼できるどうかは実はデータの品質で考えるべき項目の一つです。

今後、ルールづくりや第三者がチェックする体制づくりも必要となるでしょう。それらはデータガバナンスの一種です。

そして改めて上記のPeter Aikenのフレームワークを見てみると、フレームワークの中に存在するメタデータやデータ品質、データガバナンスといったフェーズについて私たちが考えなければならない時がすでに来ていることに気付かされます。

動画生成AIもおおよそこれまでのデータの利用の軸と同じ変遷をたどると私は考えています。

このようにリスクについて色々と書いていますが、先ほども述べたとおり私はどちらかというとコンピュータを有効にどんどん使っていくべきだと考えております。それはビジネス上の競争優位性にも影響があるためです。

ただ新たな技術が人に大きな危害を与えてしまうのでは本来人の役に立つべき技術としては本末転倒です。これらの対策が完璧にできる日はこれまでのセキュリティ同様に来ないかもしれませんが、インターネットが広く利用されている今と同様に、有効に活用できる日が早く来ると良いなと思います。

そのために今私たち一人ひとりにできることからまずは始めるべきだと思います。

こちらのもととなったML15minutesの講演資料は以下のX(旧twitter)で公開しています。Xでは今後も最新のAIやデータについて公開していきますのでお気軽にフォローいただければ幸いです。

本日のMachine Learning 15 Minutesの資料です。1週間公開しますhttps://t.co/t8txrwhA7f

— 久保田 敏宏 WINENCE(株) CEO (@toshi_music) March 30, 2024

この記事が参加している募集

この記事が気に入ったらサポートをしてみませんか?