モバイルモーションキャプチャーmocopiでカスタムアバターを試してみた!

今朝mocopiが届きました。

本日(2023年1月20日)発売のモバイルモーションキャプチャーmocopiが今朝届きました!

3年ぐらい前から、フルトラ(フルトラッキング)をやりたい!!って言ってたんですよ。それでいろいろ試してはみてたんですが、自分のパソコンのスペックが足らずに上手く動かせず…。°( ´:ω:` )°。

mocopiはスマホで動くらしい!と聞いてポチっとしといたら、発売日当日に届いてウレシイ!!(要対象機種確認)

まずは箱を開けて、中に入っているQRコードをスマホで読み取って、スマホのmocopiアプリをダウンロードします。

セットアップします!

アプリの案内に従って、センサーのペアリングを行います。

最初にHEADから、次にWRISTのRをペアリングします!ここで、ワタシは間違えて左から順番にペアリングすると思い込んで、WRISTのLをペアリングしちゃいました!お気をつけて!(戻ってやり直しました。)

公式の説明動画を一度観てから準備すると間違いないです。

センサーの装着も、磁気の力で、強制的に正しい方向にハマるようになっていました!便利!

キャリブレーションも最初モタモタしてしまい、うまくいかない場合もありましたが、何度かやると慣れてきます。

最初はデフォルトのアバターを使って動かしてみたのですが、足のトラキングができてホント嬉しい!!!

カスタムアバターを使いたい!

次にカスタムアバターを使いたいので調べました。

ワタシの場合、iPhoneとmacだったので、iPhoneとmacをUSB ケーブルで繋いで、iPhone側のmocopiアプリの配下に、自分の使いたいアバターのvrmを入れるだけでした。

最近ワタシがよく使っている、VRoidで作った同相逆相ちゃんのvrmを入れて動かしてみました!

OBSを使って合成する

mocopiアプリは背景色が選べるので、背景をグリーンバックにします。

macとiPhoneをUSBケーブルで繋いで、OBSを使って映像デバイスキャプチャでmocopiアプリの映像を取り込みます。

そして重ねたい画像や動画を同じようにソースに入れます。ワタシはTwitterでmocopiの事を書いた画面と重ねました。

これで録画開始を押せば、OBSでグリーン部分を抜いてツイートした画面と重ねて合成したものが録画できます。

その録画した動画はこちらです。

他にもmocopiで自分の動作をモーションキャプチャーしてUnityに持っていけるらしい!

あとで試してみます!

追記:

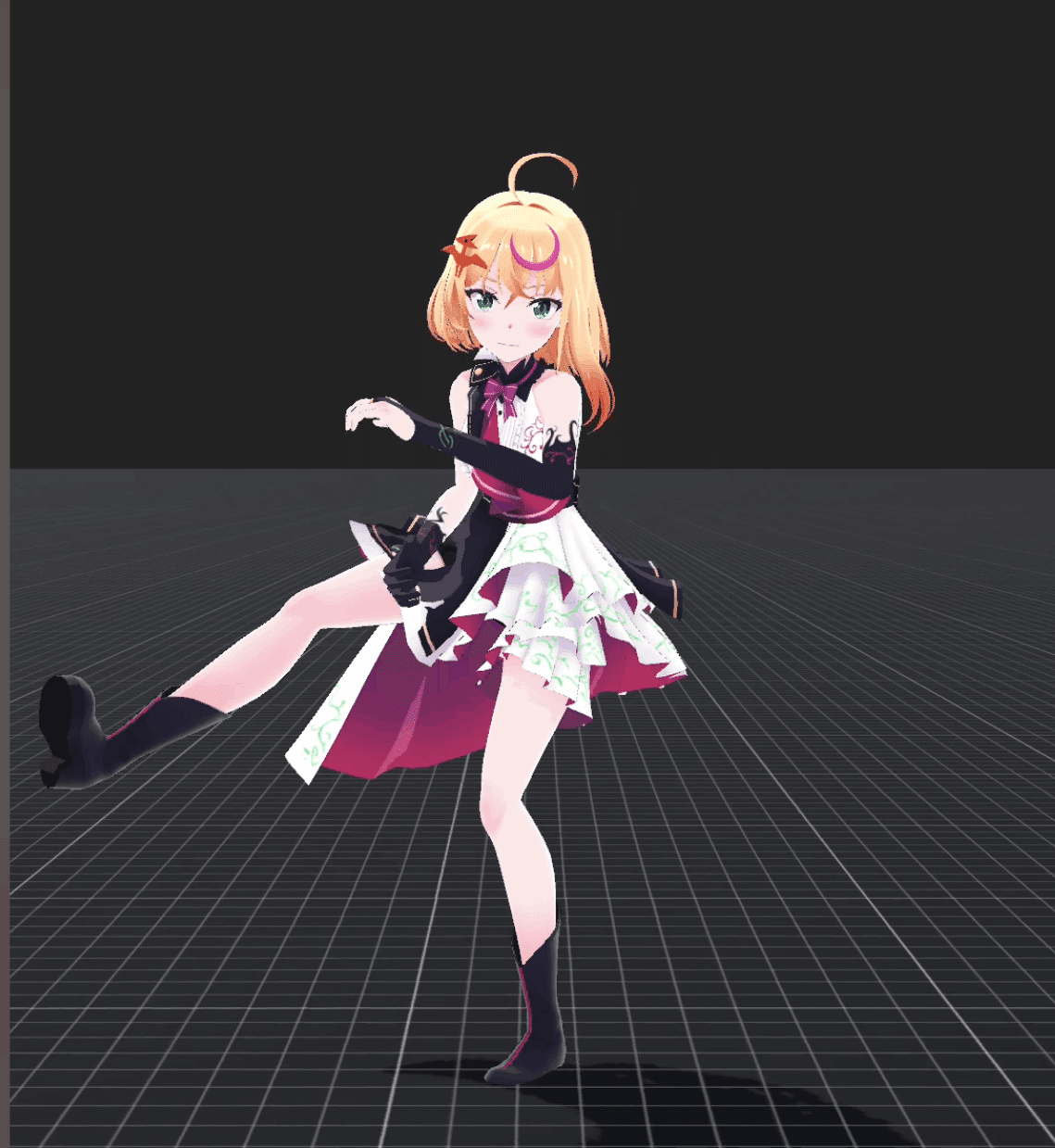

mocopi Receiver Plugin for Unityを使って、mocopiで保存したモーションデータがUnityで動いたので載せておきます!(モーション協力 by 次男)

mocopi Receiver Plugin for Unityを使って、mocopiで保存したモーションデータがUnityで動いた✨

— Yamada3 (@keropiyo_) January 20, 2023

(モーション協力 by 次男) pic.twitter.com/eHr023FeJO

(おしまい)