AI倫理の源流

先日投稿した記事『先生、ChatGPTは私たちの仕事を奪うのですか?』は、ことのほか多くの方々に読んでいただけたようで、正直驚いてます。NOTEの記事にはサブタイトルが付けられないようなので再掲しておくと…

…の4本です。未読の方は是非。よろしくお願いします🙇♀️

さて、この4つの記事を読んだ古い友人からリクエストがあったので、今回は第3回の記事で扱った「AI倫理」の起源について、もう少し掘り下げたいと思います。

「AI倫理」をひとことで説明すると「AIが倫理的にやってはいけない事」に関する議論です。実際に生成系AIを搭載したチャットボットとの会話で精神的に追い込まれた人が、それを苦に自殺した事件が起こっているので、AIが法規制の対象になるのは必然でしょう。当然、この議論を主導するのは法律家ですが、議論の中身は「もし裁判が起こされても、責任を問われないようにするために、日頃から注意しておかなければならないこと」いわゆるガイドラインの作成といった話になります。これは法律が苦手な我々一般人とっては、イライラする、できれば敬遠したい議論であることは容易に想像できるのですが…どんな返事をするのか開発者にもわからない生成系AIの場合、サービスを提供する事業者が全ての責任を負いきれない…利用者の責任になるケースが非常に多いのが悩ましいところです。

で…

そこは歴史オタクの僕ですから、DARPA(インターネットの基盤技術を開発した米軍の研究機関ですね)の文書アーカイブに埋もれていた、50年前の「AIが倫理的にやってはいけない事」を明確に言及しているメモランダムを引っ張り出してきて第3回で紹介したのですが、友人が「このメモランダムが書かれた経緯や当時の背景を含めて説明してはどうか?」とアドバイスしてくれたのでした。やはり、法律家がその場で思いつく仮定の話よりも、ノンフィクションのナラティブ(物語)の方が一般人にはわかりやすいですもんね。題して…

史上初の「AI倫理」論争を追って

…をお届けすることにしました。さすがにこのテーマを記事4回にまとめるの厳しそうなので、今回は6回でお願いします。

それでは…

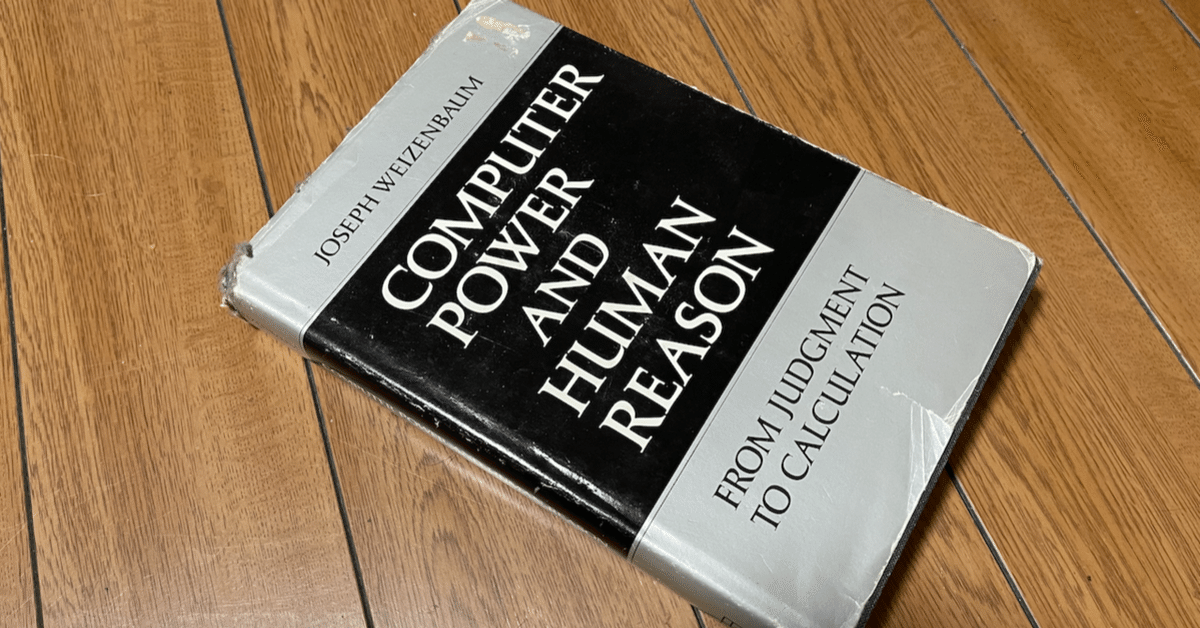

タイトルにある論争は1976年に出版されたこの本がキッカケでした。

第3回でも紹介したジョゼフ・ワイゼンバウムが書いた本です。全300ページの書籍ですが、目次は次のとおり。

目 次

序文 ix

はじめに

ツールについて 17

コンピュータのパワーの源 39

コンピュータの動作原理 73

科学と強迫的なプログラマー 111

理論とモデル 132

心理学におけるコンピュータモデル 154

コンピュータと自然言語 182

人工知能 202

理解不能なプログラム 228

手段的な理性の帝国主義に反対して 258

注釈 281

索引 289

実は、過去の経験から「一般向けにコンピュータの仕組みを解説した本」と僕は理解していたのです。が、改めて目次をみて「それは3章で挫折していたから」ってことを思い出しました😀 だって4章から英語が急激に難しくなるから…

今日、同書は「AI倫理」研究者の間でバイブル的な存在になっています。彼らは同書の主張を「敬意と配慮を必要とするカスタマーサービス担当者、高齢者のための介護者、兵士、裁判官、警察官、セラピストの代わりにAI技術を使うべきではない」として、その理由について次のように読み解いています。

ワイゼンバウムは、このような立場の人々には、本物の共感の感情が必要だと説明している。「もし機械が彼らに取って代わったなら、人工知能システムは共感をシミュレートできないので、私たちは疎外され、価値を下げられ、不満を感じることになるだろう。人工知能がこのように使われれば、人間の尊厳が脅やかされることになる」。ワイゼンバウムは、こうした職種を機械化する可能性への考えは、人々が「自らをコンピューターと考えることからくる人の魂の萎縮」を経験していることを示唆すると主張した。

この「人工知能の倫理」のページには、他にもAI倫理について網羅的に説明されています。ですが、そのほとんどが2000年以降の今世紀に入ってからのトピックで、ワイゼンバウムの問題提起だけが突出して古い(早い)事例であることがわかります。そこで、このページの彼の著作に関する記述の論拠となっているパメラ・マコーダックの著作を調べてみたところ、ワイゼンバウムの著作について次のように紹介しています。

1976年の春、ジョセフ・ワイゼンバウムによって書かれた『コンピュータの力と人間の理性』という本が登場しました。この本は、人工知能に対する詳細な批判であり、いくつかの側面は以前の批判を反映しており、他の側面は独自のものでした。その中でも特筆すべき特徴の一つは、この本が人工知能の主要な拠点であるマサチューセッツ工科大学(MIT)から出版されたこと、そしてこの分野に初期に大きな貢献をした人物であるジョセフ・ワイゼンバウムによって書かれたことで、彼の対話型プログラムである「ELIZA」は第11章で詳しく説明されています。ワイゼンバウムの本では、道徳に関する問題が明示的に初めて提起されました。

この本は、私たち全員が考慮するに値し、その考慮はいくつかのレベルで検討する価値があります。まずその大前提は、コンピュータが実現可能かどうかにかかわらず、侵入すべきでない領域があるということです。それまでの批評家たちは、コンピューターが人間的なことができないことから、AIは軽蔑に値するという論争にほとんどのエネルギーを費やしてきました。しかし、科学の生態系におけるそのニッチな位置をしがみつくことがますます難しくなりつつある今、ワイゼンバウムは埋めるべき新しいスペースを提供しました。彼はAIを論破するために多くのスペースを使用していますが、それでも彼の主要な懸念は科学的ではなく道徳的な問題であると主張しています。コンピュータが侵入すべきでない領域が存在すると、彼は明確に述べています。その領域とは、そのような侵入が生命そのものへの攻撃を意味する場合、その影響が不可逆的であることが容易に確認でき、副作用が完全に予見できない場合、対人関係の尊重、理解、愛に関わる人間の機能の代用としてコンピューター・システムが提案される場合などです。

また、ワイゼンバウムの本は、その第二の前提、すなわち、この分野で行われている仕事のほとんどは科学ではなく技術であり、科学者ではなく、コンピューター設備周辺ではハッカーとして知られる強迫的なプログラマーたちによって行われ、彼らは誇大妄想によって極端な状態に陥っているという点でも注目に値します。

確かにこの文章は、今日、ワイゼンバウムの著作が再評価的に注目を集める理由を端的に説明してくれています。しかし、おそらくワイゼンバウムが言う「強迫的なプログラマー」に分類されるであろうキャリアをたどってきた僕自身には「第二の前提」以降の文章には、正直、大きな違和感を感じるのです。(僕も含めた)ハッカーと呼ばれる人種が「科学ではなく技術」に関わっているとの指摘はともかく、この人種が「誇大妄想によって極端な状態に陥っている」との理解には拡大解釈が過ぎると思えてなりません。

まずワイゼンバウムが著書でふれたハッカーに対する知見は1960年代のMITのAIラボに所属した面々に限られたものでしょう。現在の生成系AIの研究開発に携わる面々までを同列視するのはいかがなものでしょうか?そもそも、自身も優れたコンピュータ・サイエンティストであり、コンピュータだけでなく哲学・心理学などさまざま分野に博識だったワイゼンバウムがマコーダックが言うような敵意をハッカーに抱いていたのでしょうか?

またもや「伝説の真相」を確かめたくなってきました。(つづく)