Kling AIをどんどん使ってみる。(1)

この続きです。

Adobe Express でMP4 から GIF に変換したものを note 記事に貼れるので

動画の中でテロップを使って説明するより記事に纏めるのが容易に

なりました。

https://new.express.adobe.com/tools/convert-to-gif

ただ「大(高画質)」を選ぶとファイルサイズが大きいためか貼り付けの

アップロードが失敗することが多いようで、「中(標準画質)」を

選びようにしました。

Kling AIをどんどん使ってみています。

現時点で LUMA AI の Dream MACHINE が無償使用では「IN QUEUE」

状態で12時間以上待たされたあげく、数分で動画出力される

Leonardo.Ai より少し動きがリアル程度の動画しか出力されない

(使い始めた当初の余計とも言えたダイナミックな動きが最近では

影を潜めた印象)のに比べて Kling AI はただちに処理に入ってくれて

Leonardo.Ai 並みの速さで予想を超える動画を出力します。

その予想は期待するものと異なることもありますが、すぐに結果を

得られ、無償でも1 日あたり6 動画を得られるので、根気をそがれる

ことなくカット&トライを続けることが出来ます。

Kling AI も有名になってくると LUMA AI の Dream MACHINE のように

「IN QUEUE」待ちが出て来るのでしょうか。

(あんまり記事にしないほうがいいのかも…?まあ私の note 記事など

それほど影響力はないですが。)

この Stable Diffusion Web UI (AUTOMATIC 1111 版)による静止画を

動画化しましたが、他の作例以上に動きが予想を超えました。

ダイナミックな振り返り方ですが、最後のほうでちょっと品のない表情に

なってしまってます。GIF のコマスピードでは分かりにくいですが

MP4 原動画では明らかに気になりました。

最後をカットすると折角の髪のなびき方まで途中で終わってしまい

ますので、痛しかゆしです。

もう一度実行してみました。

何だか堪えていたのが爆発寸前、みたいな動きです。

肩と背中と腕や首の動きが解剖学的にも正しそうな連動をしています。

予想を超えている動きであるものの、まあ期待する感じとは違いました。

ここでパラメタ設定を見てみますと、「創造性」と「関連性」の間で

バランス調整が出来るようです。やや「関連性」に倒してまた実行

しました。(静止画から動画生成するサイトには、このオプションは

必須ですが、今のところ LUMA AI の Dream MACHINE だけはそれが

ありません。)

ようやく期待に沿った動きになりました。

最後に向けてどんどん最初のノーブルな表情がアマゾネス化(?)して

行く感じが余計ですが、これなら最後のほうをカットすることも

出来ます。

Leonardo.Ai ではパラメタ値を小さくして、動画化による顔などの

崩れを抑止(炎や波など自然現象は物理法則に沿った動きが為される

ものの、人物の動きは解剖学的には沿っていないので、値が大きいと

ただ醜く歪んで来る)がしている関係もあって、動きが地味過ぎますが、

これまではこれが無難かつ充分と考えていた水準でした。

このように無償利用出来る範囲でも、技術革新のスピードは物凄いと

感じます。

今や作業の様相と調整の選択肢はますます増えて、ローカルPC での

元画像作成の時間をあまり持てなくなっています。

Kling AI の静止画に関しては、1 日6 動画作成の後、残った6 credits で

30 画も描けるので、いろいろ試しています(ますます時間を要する)が

少なくとも人物画(特に女性画)に関しては、もう手慣れたローカルPC

描画に任せようと感じ始めています。

先の記事のようにプロンプトで足りない要素をどんどん追い込んで、

気に入らない印象を潰して行くのも、やり方ではありますが(そもそも

ローカルPC での描画ではその工程は不要。目指す画風に合わない

CheckPoint ファイルを無理に使い続ける必要が無いため)、

「Reference Image」で「こんな感じにしてくれよ」という調整を

すれば、一足飛びにイメージに近い描画を得られます。

ただまあその「Reference Image」で与えた画に比べて人物の日の丸構図が

気になります。多くのネット上にあるヒーローものの肖像などと同様で、

幼少時から写真を撮り続けて半世紀をはるかに超えてしまった私には、

無視出来ない鼻につく要素です。

(この点、イラストレーター志望だった方が AI 描画の世界に入られた

場合は、真逆の印象をお持ちになるかもしれないことは理解しています。)

妙な艶めかしさは SDXL 系の CheckPoint 描画によるものでしょうが

「Reference Strength」で、ある程度の調整は効くようでした。

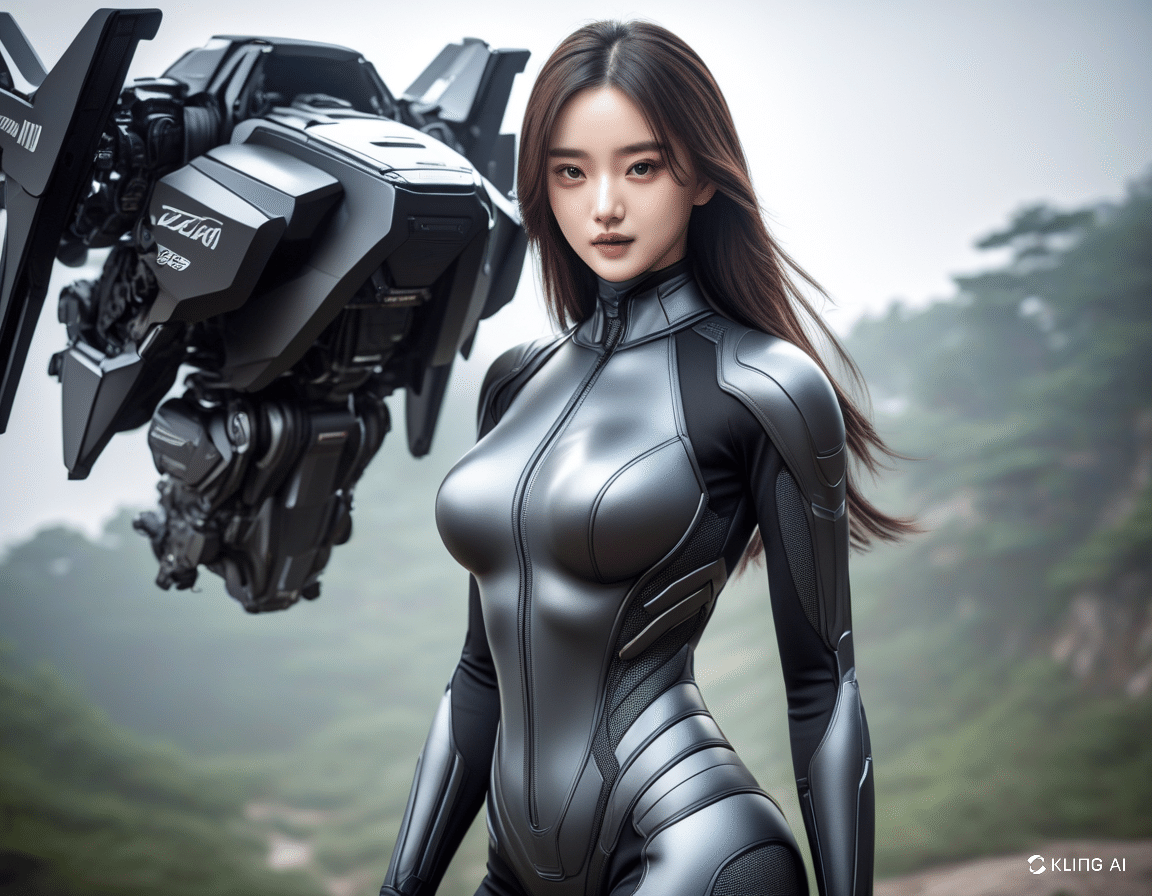

「Reference Strength」を最小に下げると、こんな感じです。

元々のバタ臭さが出て来るだけかもしれませんが。

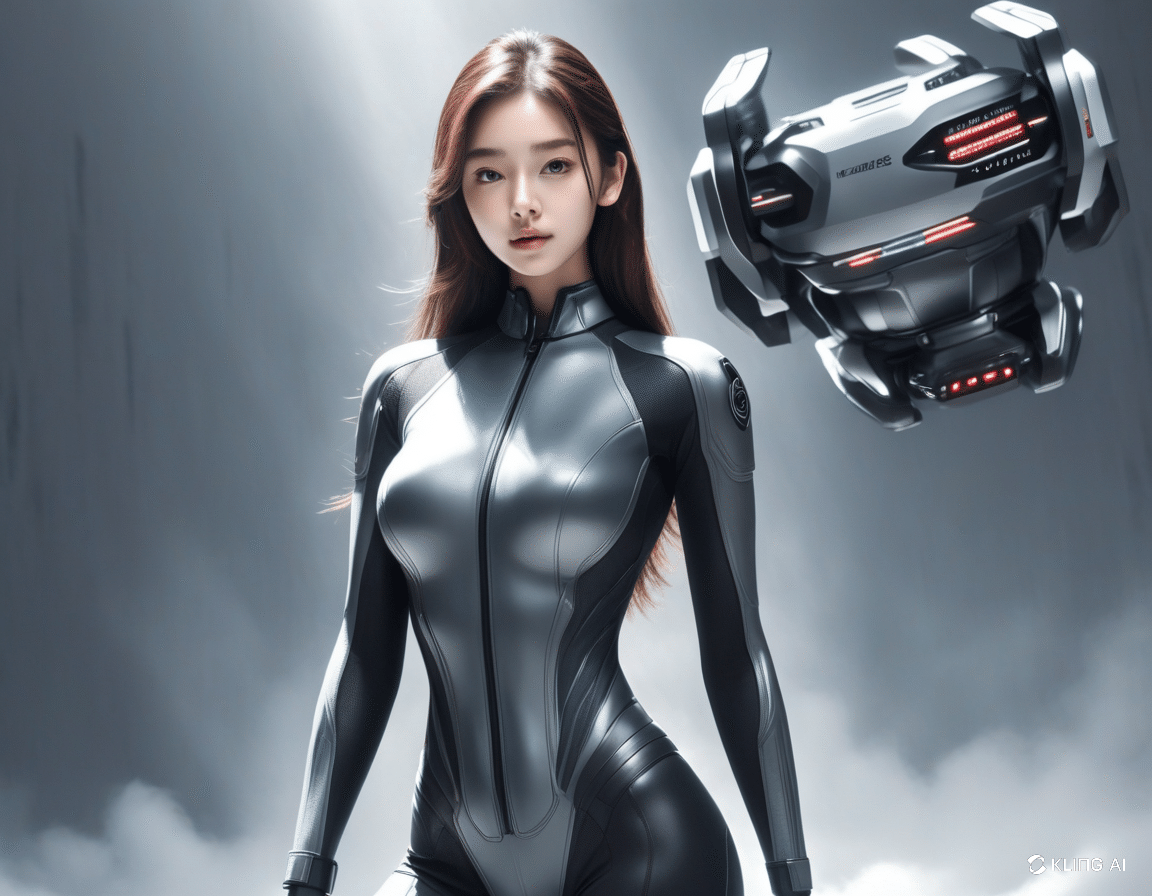

最大設定ではこんな感じでした。

まああまり甲斐のない調整努力といった感じで、現時点で120 以上保有

するCheckPoint ファイルを適材適所に使って、意のままに描画出来る

ローカル PC での描画に専念すべきでしょう。

他の例でも日の丸構図が目立ち、人物の詳細感も「Reference Image」に

劣ります。(掲載した全ての作例の「Reference Image」は日の丸構図

ではありません。)

そもそも「Reference Image」が描かせたい理想なら、最初からローカルPC

で描画すれば良いことなのでした。

Text to Image によるメカ画や天体画に関しても、今では Stable Diffusion

Web UI Forge で多種のSDXL を扱えるので、かつての mage.Space の

ように特に Kling AI に依存する必要はありません。

以下はこの Stable Diffusion Web UI Forge で描き、先日 CivitAI に公開

した画と同じプロンプトを使って Text to Image で描かせたものです。

(プロンプトは CivitAI でご覧になれます。)

まあかつての mage.Space の無償 SDXL と同様に、1 つの有効な

CheckPoint ファイルの選択肢がある、程度の位置づけで良いかと考えます。

こんなタッチの描画を欲しいと思えば、Kling AI を使えば良いという

ことです。6 動画の生成が終わったら、残った6 credits は捨ててローカル PC

での描画に作業時間を充てるべきなのでした。

本来、ローカルPC とクラウド系サービスの使い分けなので、動作環境

的には同時並行作業は可能なのですが、やはり創作に属する作業なので

あまり器用に集中力を分散配分することは私には難しいです。

時間をかけての静止画が過去に完成していてのスタートであるクラウド

系サービスとは異なり、ローカルPC ではまずは「何を描かせよう。

何で描かせよう。何をどう直そう。」の強いイメージをもって

カット&トライすることが必要ですから。

ご覧いただきありがとうございます。

この記事が参加している募集

この記事が気に入ったらサポートをしてみませんか?