AIは「私たち」をどうデザインするか

2025年、AI(人工知能)はもはや特別な存在ではなく、ビジネス、教育、芸術、コミュニケーションなどあらゆる領域で当たり前に利用されるテクノロジーとなりつつあります。

チャットボットや自動翻訳、画像生成や音楽生成、さらにはエージェントまで、多彩な形でAIを目にするたびに、私たちは「人間の仕事や役割はどう変わるのだろう」という人もいるでしょう。

本記事では、そういったAIの影響を網羅的について掘り下げていきたいと思います。

※本記事はテリー・ウィノグラドとフェルナンド・フローレスの存在論的デザインの発想をベースとしていますが、存在論的デザインの前段として、まずはAIの影響を考えています。どこかでまたその記事は書きたいと考えています。

※本記事は長いです。

1.AIが私たちをデザインする

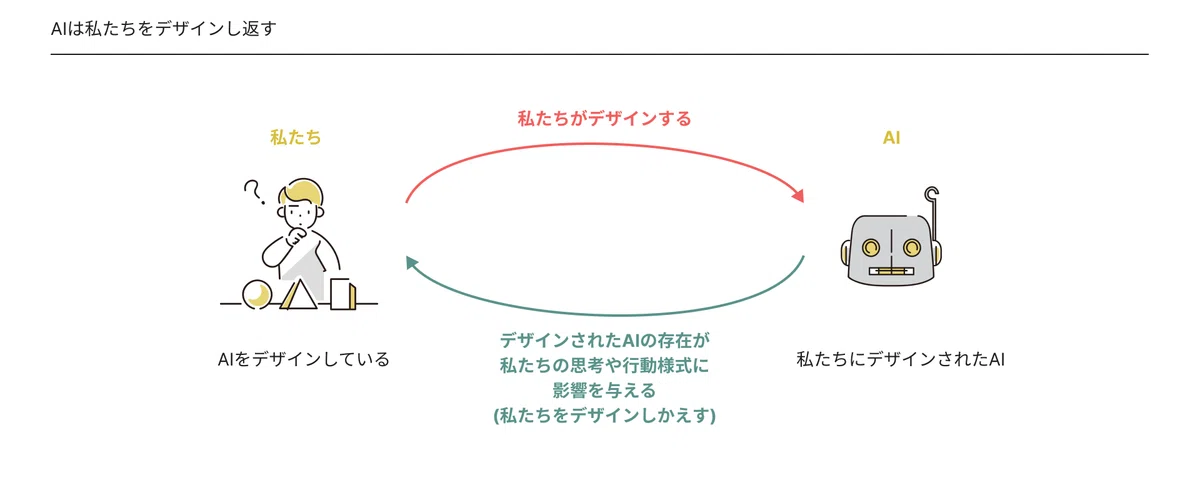

私たちは普段、「デザイン」という言葉に対して、製品やUI/UXの意匠、見た目の美しさや使いやすさ、といった面をイメージしがちですし、その際のデザインする主体は常に人間です。

普通に考えれば、「人間が何かをデザインする」のです。

ところが、1986年にテリー・ウィノグラドとフェルナンド・フローレスは

曰く、「私たちはデザインするものによってデザインされている」という相互作用の視点を持つべきであると述べました。

彼らが言うにはコンピュータやソフトウェアはもちろん、アルゴリズムやUIの細部もまた、開発者や組織の意図・思想が反映されており、そしてそれを使うユーザーは、しらずしらずのうちにそのデザイン方針に沿った思考・行動をとるようになると言うことです。

たとえばInstagramは写真や動画をシェアするSNSですが、これは単なる情報発信ツールを使っているだけのように見えて、実際には「インスタ映え」を意識した行動や消費が広まり、社会の価値観や商業戦略に影響を与え、私たちの行動様式を完全に塗り替えてしまっています。

このように私たち人間は世界から切り離された主体ではなく、世界の中でモノや他者と関係を結びながら自分を形成していくのであり、「私たちによってデザインされた人工物や環境が、人々の存在の仕方そのものに介入し、新たな規範や行動パターンを生み出す」という循環が存在します。

AIが「私たち」や「社会」にあたえる影響を考える

AIの世界でも、たとえば学習データに潜むバイアス(人種差別やステレオタイプなど)が、そのままアルゴリズムの出力に影響することが大きな問題になっています。しかも、ユーザーがそれを無批判に受け入れれば、結果的にそうしたバイアスを再生産・拡散してしまう可能性があります。

こういった単なる「AIがどう動くか」という技術的性能だけでなく、「AIがどう人間を変えていくか」が上のテーマです。

全てを上げることはできませんが、ある程度インパクトのありそうなものを網羅的に抑えてみたつもりです。

というわけでAIが私たちや社会にどんな影響を与えるかを見ていきましょう。

可能性1:認知と思考プロセスの変化

私たちがAIと対話するうちに、AIのわかりやすい形の表現、そして言語的表現が強化され、主観的なものや身体に紐づくものなどが疎かにされる傾向が発生すると思われます。

しかし一方で、暗黙知、身体知、非言語なものなど言葉にされないものはむしろ価値をまし、それ自体が人間の強みとなるかもしれません。

1-1.思考の最適化と単純化

対話型AIが普及するにつれ、私たちは自然言語でAIとやりとりを行いながら、なるべく誤解なく意図を伝えようとします。

その結果、「曖昧な表現を捨て、論点を細分化して整理し、AIに答えやすい形に落とし込む」という思考習慣が身についていくのではないでしょうか。

というか、すでにChatGPTが台頭して2年弱、日常的にLLM使ってる人であればもう完全にこちらに変わってしまったひともいるでしょう。

これは論理的思考や言語化能力を高める利点がありますが、同時に、複雑で曖昧な領域や、暗黙の文脈、詩的・比喩的表現などを切り捨てる危険も孕んでいます。

社会やビジネス上はあまり問題がありませんが、日常生活での会話の齟齬や、文化的なものを損なう要因にもなるかもしれません。

1-2.問いの自覚

前後しますが、AIに指示して回答を得るプロセスでは、まず自分自身で「何をどう質問したいのか」を定義する必要があります。

これは問題解決の前段階であるにもかかわらず、意外に自己理解や気づきを促す側面もあります。(つまり指示することが理解につながる)

しかしながら、「AIのほうが効率が良いから任せてしまおう」と過度に依存すると(曖昧な指示を出しすぎると)、考えるプロセスそのものを放棄し、自分なりの判断基準を見失ってしまうリスクが高まるかもしれません。

その上でさらにAIの成果物を見ると「これだ」「これじゃない」と妥当性や違和感を感覚えることもあり、言語化されていなかったものが言語化される、、、という側面もあるので、如何ともし難いところはあります。

1-3.AIによって解釈フレームを規定される

普段の検索やレコメンド機能によって私たちが視る・読む・体験する情報は、背後にあるアルゴリズムの意思決定に大きく左右されます。

たとえばYouTubeやNetflixのおすすめ、SNSのタイムラインなどは、たしかに便利ではあるものの、知らないうちに「自分と似たものばかり」を目にするフィルターバブルを強化し、多様性を失わせる可能性が指摘されています。

同様に、AIを通じて認知空間が最適化される一方で、思考や価値観が狭まりかねません。

これは後続でも言及していますが、バイアス問題につながります。

1-4.AIなしの決断・選択を嫌い、挑戦に臆病になる

AIが正解らしきものを出してくれるということは、AIに聞くと成功率が上がる、だからAIなしに決断・選択をすることを次第に人はしなくなっていくのではないでしょうか。

AIに聞けることも爆発に増えていく一方で、中にはAIの介在が難しい・AIを持ってしても予測不能な挑戦も依然として残り続けます。

こういった挑戦は「正解」を約束してくれるものとの差が際立ち、より選択されなくなる…かもしれません。

1-5.反省や内省の機会損失

スピーディーに大量の情報を処理できるAIが身近になることで、脳内でゆっくり咀嚼しながら考えるより先にAIから答えを得てしまうケースも増えています。

例えば教育の分野では、AIによる個別学習支援や即座の質問応答により、学習効率は飛躍的に向上することが報告されています。

学生はわからないことがあれば瞬時にAIから答えを得られるため、一見すると習熟が早まるメリットがあります。

しかしその一方で、自分で考える前に答えが得られてしまう状況が常態化すると、深く悩んだり試行錯誤したりする機会が減少しかねません。

実際、AIが即座に示す解答に頼りすぎると、学生の批判的思考力や問題解決力が育まれにくくなるとの指摘があります

1-6.曖昧な状態が許容されなくなる

また、明確な答えやデータで裏付けられた結論が迅速に得られるようになると同時に、他方で途中の曖昧な状態や答えの出ない過程が敬遠される文化が形成されつつあります。

言い換えれば、言語化・数値化できないものの価値が低下する傾向が見られます。

現代社会では既に「速ければ速いほど良い」というメッセージが至る所で発信されており、かつて美徳とされた忍耐や待つことは時代遅れのものとさえ扱われつつあるのではないでしょうか。

1-7.即効性重視社会

上記二つに加え、人々が「すぐ手に入る答え」に慣れることで、迷ったり保留したりすることが許容されにくい雰囲気が生まれるでしょう。(タイパ重視もこの流れ?)

ゆっくり考えて決めるよりも、直感的に即断することが良しとされる風潮の中では、優柔不断や逡巡はマイナス評価を受けやすくなります。

こうした傾向は、選択に悩む時間そのものを減少させ、結果として自分の気持ちや長期的影響を深く考えずに決めてしまうケースを増やすかもしれません。

これは個人の判断基準から波及して、社会が何を「良し」とし何を「悪し」とするかの基準にも変化を及ぼします。

例えばビジネスでは、長期計画よりも即座に成果を出すことが有能さの証と見なされたり、教育では遠回りしてでも自分で発見する学習より効率よく正解に辿り着く学習の方が良いと判断されたりするかもしれません。

社会全体が「待てない」状態になり、即応性や適応の早さ、結果の明快さが称賛される傾向につながるでしょう。

ゆっくり熟すことに価値を置く文化的・精神的活動の存続も難しくなります。

効率が重視されれば、長い時間をかけて記事を読むと言う行為も当然なくなります。この記事を見た時にみんなも最初にAIに入れて読むんじゃないかと思っています。

可能性2:ポスト暗記と学びの変容

AIで知識が参照できるということは、学びがポスト暗記の時代になることを意味します。もはや画一的な暗記テストなど役に立たないでしょうが、それは知識を学ぶことが無意味になることを意味しません。

この時代に適した学びは何か、考えていく必要があるでしょう。

2-1.「情報」と「内面化された知」が区分される

AIの台頭は「記憶しなくてもAIに訊けば済む」という姿勢を強め、従来の「暗記重視」の学習観を否定するのではないでしょうか。

もちろん、暗記ばかりが学習ではありませんが、AIによる迅速なリサーチ・分析・要約が可能になるほど、「自分でやるべきこと」と「AIに任せるべきこと」との線引きが問題になるでしょう。

一方で、知識を頭に入れるプロセス自体が新しい視点をもたらすことも事実です。

知識やリテラシーを深く身につけるからこそ、発想が豊かになり、複眼的なまなざしによる理解が得られることもあるでしょう。

AIからいつでも引き出せる「単なる情報」と「内面化された知」は別物・別機能である点に注意する必要があります。

(つまり、依然として学習は重要であると考えられる-複眼的なものの見方を鍛える方法などが重要か。)

2-2.暗黙知と身体的学びの価値

また、AIがデータや論理を扱う能力を高めていくほど、逆に「身体を使って獲得する実践知」や「試行錯誤から得られる経験知」などの内面化された知や非言語の知の重要性が見直されるでしょう。

実際のところ、職人的なスキルやアートの制作過程、研究の試行錯誤など、遠回りや失敗がイノベーションの源泉になることは少なくないように、言語化できないからといって、それに意味がないわけではありません。

しかしながらAIが「最短の正解」を教えてくれると、人間は失敗を避け、わざわざ失敗するような道を避けるのではないでしょうか?

結果的に新しい発見をする機会が縮小する懸念もあり、もはや「失敗は成功の母」という世界観ではなくなってしまうかもしれません。

学習過程をどう設計するかが極めて重要になり、「あえて非効率を残す」「身体を動かす工程や行き詰まり」を意図的に織り込むことが求められるかもしれません。

2-3.情報過多とメタ認知

膨大な情報が簡単に手に入る環境では、知識をただ取り込むだけでなく、その真偽や文脈をメタ的に検証するスキルが学習の肝要となるでしょう。

AIはの出力が正しいとは限らず、ハルシネーションを起こすことで知られていたりやバイアスが含まれている場合もあるため、学習者自身が批判的にチェックし、再構成する能力が問われます。AIと共存する社会において、教育ではこの「メタ認知力」をいかに育むかがカギを握るのです。

この辺りも以前noteにも書きました。

可能性3: 労働観と社会帰属の再定義

労働が効率化できるからお金が稼げるね、ベーシックインカムで幸せだ…というほど人間は単純ではなく、働くことは社会帰属につながり、個人の貢献感は個人の幸福にもつながります。

今の形で働く、という行為が残らないかもしれませんが、労働の効率化は必ずや帰属感の問題を伴うでしょう。

3-1.自動化と余暇、そしてアイデンティティクライシス

AIやロボットによって、単純労働や一定の専門作業が大規模に置き換えられるシナリオは十分に考えられます。

すると、「人間の働く意味」や「アイデンティティの拠り所」が根底から揺らぐでしょう。

というのも、仕事というものは単に収入源だけではなく、自分が社会のなかでどのように役立ち、所属感を得るかに影響を与える社会的帰属の場でもあるからです。

失業の拡大や格差の拡大は社会不安を増幅させる一方で、ベーシックインカムのように生活を保障し、人間が創造的活動やコミュニティ活動に専念できるような仕組みもそのうち出てくるかもしれません。

つまり、仕事をしなくてよい世界が即座に幸福をもたらすとは限りません。

「働かなくてもいい」という状況は、「自分は何者なのか、何のために生きるのか」という問いをむしろ深刻化させるかもしれないからです。

3-2.「人間らしさ」はどこに残るのか

AIが人間の代わりに働く社会では、人間が担うべき領域はどこにあるのでしょう?

感情的ケアや身体的営み、アートやスポーツ、哲学的探求など、人間固有とされてきた活動領域も、AIのさらなる発展によって部分的に代替される可能性があります。

しかし同時に、「労働」の意味が変化するなかで、「創造」「遊び」「つながり」「自分自身の内面探究」といった活動が、それまでの余暇や趣味にとどまらず、社会の核心を支える役割を果たすようになるシナリオもあり得るでしょう。

要は、人間のアイデンティティを「労働=生存手段」に縛られず、多面的に確立するチャンスでもあるわけです。

可能性4:新しい美学・芸術観の萌芽

美とは何か、創造とは何か、人類が長い年月を向き合ってきたテーマではありますが、人類が作り出した別の知性体が美や創造にアクションをかけてきたのがこの時代です。

自分たちが今やっていることは何で、それはAIとは何が違うのか、そういうことを見直していく必要がありそうです。

4-1.「創造性」の問い直し

AIが文章や音楽、画像、動画などを生成し、人々に提供する状況は、すでに珍しくありません。こうした「生成AI」の出力物は一見すると人間の作品と見分けがつかないほど洗練されています。

さて、これはAIの持つクリエイティビティなのでしょうか?

あるいはクリエイティビティとは何か?

「AIに本当の創造性はあるのか?」という議論が浮上しますが、しかし、人間の創造活動であれ、過去の知識や経験を新しく組み合わせる営みだと考えれば、AIの創造と厳密にどこが違うのか、線引きは曖昧です。

4-2.偶然・逸脱・失敗から生まれるもの

先ほども軽く触れましたが、多くのビジネス人、クリエイターなどが主張するように、人間の創造は「偶然の失敗やエラー」「想定外の破綻」などがしばしば革新的アイデアを生むという点も見過ごせません。

AIは過去の膨大なデータを学習して「それらしいもの」を作るのは得意ですが、感情の機微や、失敗や矛盾に耐えながら作品を育てる人間の感性は、容易には再現できません。

効率追求型のAIに頼りすぎれば、新しいインスピレーションを得るチャンスを失う…かもしれません。

4-3.人間×AIの共創と新たな美意識

双方のメリットをとれば、AIが創作のプロセスでパートナー的に機能し、人間がそこから得たアイデアをさらに編集・再構成する流れが一般化するでしょう(しつつあります)。

ここでは「作者は誰か」「著作権は誰に帰属するのか」といった問題が浮上します。同時に、新しい表現や美意識が生まれる契機にもなり得ます。

AIとの協働によって、人間の芸術観が更新され、「オリジナリティ」「完成度」「鑑賞の意義」などを考え直す必要が出てくるからです。

可能性5: コミュニケーションの変質

AIのロジカルでポジティブなコミュニケーションに慣れきると、複雑で曖昧で感情的な人間とコミュニケーションするのはストレスかもしれません。

一方で、ロジカルなコミュニケーションで世界が回ってるのはビジネスぐらいで、それ以外のあらゆる日常生活は複雑で曖昧で感情的でしょう。

双方をそれぞれ大事にしていく必要があるのだと私は感じています。

5-1.スムーズなAIの応答と、フリクションする人間同士

チャットボットやAIアシスタントは、待ち時間もほぼなく、曖昧さの少ない応答を行います。これに慣れすぎると、人間同士の会話は「遠回り」「感情が絡んでややこしい」という理由で煩わしく感じられ、敬遠される可能性があるのではないでしょうか。

しかし、人間同士のコミュニケーションには、誤解や衝突がある一方で、それがきっかけとなって深い共感や関係性の深化が起こることが多々あります。この「摩擦」が人間的豊かさを生むと捉え、それをどう活かすかが課題になるかと思います。

特に私はUXリサーチ-人間の感情に触れるものなので、ここは見過ごせません。

5-2.人間がケアすること、そしてAIのケア性

人間同士のコミュニケーションは時としてケア-人への癒しとなります。

しかしながら、すでにAIがこのケア性を受け継ぎつつ、たとえば自分の悩み事をAIが解決するということもあるでしょう。

ペット型ロボットや会話AIが高度化すると、ユーザーがAIとの間に愛着や擬似的な友愛を感じるケースも増えてきます。孤独や不安を抱える人にとって、AIは感情的ケアを疑似的に提供する存在にもなりえます。

けれども、あくまでAIはアルゴリズム上の反応を示しているにすぎず、そこに本当の感情や倫理的主体を認めるかどうかは、社会的にも哲学的にもまだ議論が続いています。

AIをパートナーとして遇するならば、どこまで権利や尊厳を認めるのか、という問題も浮上します。逆に道具として扱い続けるならば、人間のほうがAIとの依存関係に溺れ、かえって主体性を失う恐れもあります。

いずれのケースでも、AIと人間の関係性をよく考えることが重要と言えます。

可能性6:AIガバナンスと責任・倫理の行方

AIがオートメーションで仕事をこなす会社が設立された時、誰が責任を持てるのでしょうか?あるいは見せかけの人間の代表を立て、いざという時は首を切るのでしょうか?

現代社会において、責任は賠償(あるいは懲役)と可換なので、AI主体がお金を稼げばそこに責任が取れる…という考え方もできます。

いずれにせよ、AIと責任・倫理について深めていく必要はあるでしょう。

6-1.責任の所在が曖昧になる社会

AIに高度な意思決定を委ねる場面が増えるほど、問題が起きた際に「いったい誰が責任を取るのか」という問いが生じます。

自動運転車が事故を起こした場合、AI開発企業なのか、オーナーやユーザーなのか、それとも学習データを提供した者なのか。

さらに、複雑なアルゴリズムが“ブラックボックス化”していると、人間ですら出力理由を説明できなくなるかもしれません。

こうした責任の曖昧化は、被害者救済を困難にし、社会的混乱を招くリスクを存在しています。

6-2.AIに「法人格」や「人権」を与える可能性

一部では、AIシステムに法人格(企業のような法的主体)を与える構想や、将来的に強い自律性を持ったAIに人権を認めるシナリオも論じられています。たとえばニュージーランドで川に法人格を認めた例があるように、必ずしも「人間だけ」が法的主体とは限りません。

日本の法律は分かりませんが、世界レベルで見ればAIは容易に法的主体になり得るでしょう。

もしAIを法的主体と認めるなら、賠償責任の所在をAIに押しつけ、人間が「AIがやったことだから」と責任逃れする悪用も懸念されます。

また、仮にAIに人権を与えるなら、それは“生物学的存在としての人間”に限定されてきた人権概念の大幅な書き換えを意味するため、倫理的・社会的インパクトは計り知れません。

6-3.情報操作・監視社会とAI

ディープフェイクや大量の生成コンテンツによって、虚偽情報を拡散・操作するハードルが下がっており、特定勢力がAIを活用し、プロパガンダや世論形成を巧妙にコントロールするリスクは現実味を帯びています。

また、検索履歴やSNS上の言動をAIが解析し、個人を徹底的にトラッキングする監視社会もすでに一部で進行しています。AIによる利便性を享受する一方で、私たちがどれほどのプライバシーや自由を犠牲にしているかは、改めて問い直さねばなりません。

可能性7:バイアスの解消と助長

AIはバイアスを解消する…という言説の裏側で、むしろAIによって助長されるバイアスも存在しています。

AIであろうとバイアスが存在する事実をきちんと理解し、誠実に努めていく必要がありそうです。

7-1.他者認識のバイアスを解消する

AIがジェンダーギャップを解消しうる、というのはすでに指摘されており、たとえば、男女に囲碁を教える際に、人間ではなくAIが教えることで男女差がほぼ解消した、という実験が発表されています。

これによって教育の現場において、教師側に存在するバイアスが存在することが指摘されています。

【人間教師とAI教師】

— 毫釐千里⚫️ごうりせんり⚪️ (@gorisenri) December 25, 2024

人が囲碁を教えるグループとAIが囲碁を教えるグループを比較したところ、AIが教えた子たちの方が強くなっただけでなく、それまであった男女の実力差がほぼ解消したそうです。

棋力の男女差は、生物学的な性差によるものではなく、指導する側の問題だったことを示唆する結果です。 https://t.co/wVU6GNHbAl pic.twitter.com/dUFxlfcx3X

7-2.自己認識のバイアスを解消する

一方で、教育を受ける側にも、ジェンダーに支配されたものの見方によって、自己肯定感や自己効力感に影響があります。

たとえば、女性は「自分が理系に向いてる」と感じる割合が男性より少ないそうです。

男子は女子よりも「自分が理系に向いている」と強く感じる割合が高く、男子の50.1%が「理系に向いている」と考えるのに対し、女子は31.2%となり、18.9ptの差が出ました。女子は「理系に向いていない」と感じる割合が約5割も占めており、男子よりも理系に関する自信が低い傾向が見られました。

指導側に思い込みがある一方で、利用側にも思い込みがあり、循環して再生産されてるのではないでしょうか。

こうした相互のバイアスを断ち切ることもAIによって成し得ると考えられます。

7-3.バイアスを助長する

一方で、AIにおいても依然としてバイアスには問題があります。

特に顕著なのが、データセットの偏り、そしてアルゴリズムによるものです。

AIは過去のデータを学習して意思決定を行いますが、もし学習データが特定の偏った社会状況を反映していれば、AIはそれをそのまま模倣し将来の判断に投影してしまいます。

例えば、人種や性別による偏見が含まれたデータで訓練されたAIは、求人や融資判断において差別的な結果を出力し、過去の不公正を温存・拡大させる危険がありますし、実際に、近年その問題が指摘されており、透明性や公平性を高める設計上の工夫が求められています。

意識的に使えばバイアスを減らすことができますが、AI自体が持つアンコンシャス・バイアスに我々が規定されることを避けねばなりません。

可能性8:格差の解消と、新たな格差

バイアスの話に近いですが、AIによって様々な知識が民主化されます。

一方で、さらに新たな格差が生じます。

8-1.専門性の民主化による格差の解消

ご存知の通り、AIは専門的な知識を解消しつつあります。

今のところはデザイナーがプログラムを書いたり、エンジニアがプログラムをしたり…というITによったものが多くありますが、あらゆる知識が民主化されつつあります。

自分もこの記事を書くにあたって、DeepReserachでAIと存在論的デザインについて論じてるものがないか調べてみたのですが、こういうことが一瞬でできるようになることがもう未来の世界だと感じています。

(Deep Resesarchはかなりいい感じです。気持ちよさについても書きました)

8-2.インフラ格差によるさらなる格差の増大

先進国では高速通信インフラが当たり前になりつつある一方、途上国や農村部ではインターネットアクセスが不十分な地域が多いため、AIツールを活用しようにも、端末やネット環境が整っていなければ享受できません。

また、AI技術は英語など主要言語向けのモデルが先行しがちで、多くのローカル言語への対応は限定的だったり。テキストデータや学習データ自体が不足しがちな地域だと、ローカルコミュニティに合ったAIサービスが育ちにくいなどもあるでしょう。

そしてさらにAIを活用するために必要となるデジタルリテラシーや基礎教育が行き届いていない場合、そもそも活用のスタートラインに立てないこともあるでしょう。先進国と途上国、都市部と地方部とのあいだでAI格差が拡大する恐れがあります。

8-3.AIとリープフロッグ

一方で、途上国でもスマートフォンの普及とともに、AIベースのサービスが普及し、従来のインフラを飛び越えて新たな形の経済活動や教育モデルが生まれるケースもありえます(例:アフリカのモバイルマネー普及など)。遠隔医療や農業支援など、従来の医療・産業インフラが十分でない地域にこそ、AI技術が急速に浸透して課題解決を促す可能性もあり得るかもしれません。

8-4.文化的多様性の収斂

AIがグローバル企業(GAFAなど)のプラットフォーム上で開発され、英語やメジャー言語圏のデータを中心に学習していると、ローカル文化・言語が省みられずに文化的収斂(均質化)が進む恐れがあります。

また、グローバルに普及するAIシステムには西洋中心の価値観や知識体系が埋め込まれており、他の文化的視点を周縁化する恐れがあるという指摘もあります。

すでに、AIの持ちうる言語表象が英語圏の文化に根ざしていることは指摘されており、日本人が考える日本とアメリカ人の考える日本は違うように、日本語で学習されたAIの日本観と英語で学習された日本観も異なるでしょう。

チャットAIやコンテンツレコメンドの仕組みも、多数派の嗜好に最適化され、少数言語・少数文化の露出がさらに減るリスクがあります。

昨今は「脱植民地的AI(Decolonial AI)」という概念も提唱されており、現行のAI開発がしばしば植民地主義的(特定の文化・権力構造の押し付け)的であると批判されています。

可能性9: AIやITに接続されることが正義

AI時代が深まるにつれ、「データ化」「オンライン化」されていないモノや領域はどんどん可視化されにくくなり、社会的にも軽視されるリスクが高まっていきます。

たとえば農村部のようにITインフラが十分整っていない地域や、伝統的手工芸のようなデジタル化が困難な技術・文化は、政策上もビジネス上も置き去りにされるかもしれません。

9-1.デジタルへの傾倒

(すでにこの傾向は存在していますが)

AIが利用できる、ITに接続されている、というのが決断の主要因になっていくこともあるでしょう。

AI化IT化しやすい領域が優先されるのは、様々なタイミングで起きることで、より一層分断を作ります。

9-2.オフラインな価値・存在の不透明化

現代はあらゆるものをデータ化し、可視化したうえで「定量的評価」をする風潮が強まっています。

しかし、アナログ的・身体的・ローカルコミュニティ的な価値は、そもそもデータ化に向かない場合が多いです。

にもかかわらず「数値データにしにくい」というだけで重要度が低いとみなされ、結果的に支援やリソース配分が減ってしまうこともあり得ます。

また私は、クレジットカードの信用履歴さながら、オンライン上にデータが存在しない人間はどんどん"信用"されなくなっていく未来もあるかと思っています。

SNSで写真が上がってないから、データが足りず顔認証できない…みたいにならないといいのですが。

もう少し近い話ですがGoogle検索でも同じ流れがありますね

この懸念は尤もだなと思いつつ、同時にGoogle検索が登場した時にも同じ懸念が呈されたなー、というのを思い出した。

— Takeshi Sakaki@ (@tksakaki) February 4, 2025

Googleにインデクスされない(Google八分された)論文な、存在しないことになる、みたいな。

結果、どうなったかと言うと(続く https://t.co/2UHE1afDH3

9-3.デジタルの外にあるもの喪失

特に地域固有の文化、土地に根ざした慣習、対面で培われる人間関係などは、デジタル化されにくい代表例と言えます。

それらの営みが「AIやITで接続されないから」と見なされ、観光資源や経済的な価値につながりにくいと判断されれば、予算や関心がいっそう集まりにくくなるでしょう。

結果的に、非デジタル領域で営まれてきた多様な文化や暮らし方が衰退するかもしれません。

SNSで煌びやかな発信をすること、そしてAIに組み込まれることが必要になってきている…のかもしれません。

今後、意図的にオフラインでしか得られない価値を守る・引き出す設計思想や制度設計を行わなければ、多様な存在様式が均質化され、「AIにとって扱いやすいものだけが正義」となる危険があります。

AIの影響をコントロールする

ここまで見てきたように、AIは私たちの認知や学習、労働、創造、コミュニケーション、社会制度など、あらゆる面でインフラ的に入り込み、私たちの思考や行動に影響を与えています。

可能性を考えながら、何を考えていかねばならないのか…と私が感じたものを下記にまとめます。

「効率性」と「非効率」の同居

AIが情報処理や意思決定を高速・正確にこなせるようになるほど、人間の不完全で非効率な部分は、「不要」とみなされがちですが、非効率であるからといって人間は感情を切り捨てることなどできません。

そもそもビジネス社会が効率性で回っているだけで、家族や友人同志のコミュニケーションは効率性ではありません。むしろケ非効率的な-ケア的な繋がりです。

というわけで、AIが進むからこそ、意図的に非効率な営み、そして社会とは違う論理的なものに価値を見いだそうとする動きが強まるともいえます。

主体性の希薄化とその再構築

AIを過度に信頼/依存/信奉してしまうと、人間が自分自身で判断するプロセスが損なわれ、「判断をAIに委ねることが当たり前」の社会になる可能性があります。しかしながら、あらゆる思考はAIによって代替しうる可能性も存在しています。

たとえば、私たちが責任や倫理意識を放棄し、トラブルが起きたときに「AIがやったから」と自分を免責してしまう風潮が広まるかもしれません。

このような危機感が高まるほど、逆に「では人間の主体性とは何なのか」を取り戻そうとする動きも生まれるでしょう。

AIの判断があっても、最終的に責任を引き受けるのは人間であり、「意図的にAIの助言を無視する」「あえて不合理な選択をする」自由があるという意識を保つことが重要です。

そこには「AIに委ねられる社会だからこそ、人間が主体的に介入する意味がある」というパラドクスが存在しています。

「人間らしさ」を問い直す

人間がAIにどんどん近づき、あるいはAIが人間の行動パターンを「完璧に」模倣するようになったとき、「人間らしさ」とはいったい何を指すのでしょうか? 「体を使う」「感情を持つ」「逸脱する・失敗する」などが人間的要素として語られたりしますが、それすらも技術進歩で一部が再現されてしまうかもしれません。

とはいえ大事なのは、「人間らしさ」を固定的に定義して守ることではなく、AI時代の変化のなかで私たち自身が「どんな価値を大切にしたいか」「何を守り、何を捨てるのか」を問い続けることだと考えられます。

その問いこそが、AIによる変容を人間社会にとって豊かな方向へ導く鍵、かもしれません。

おわりに

AIが日常のインフラとなり、人間の学習、労働、創造、コミュニケーションのあり方を全面的に書き換えていく現代において、技術の発展そのものを否定的に捉える必要はありません。

むしろ、その可能性は計り知れず、私たちの能力や社会の豊かさを大きく伸ばしてくれるでしょう。

しかし同時に、AIがもたらす変化をただ受動的に享受するだけでは、いつの間にか人間の主体性や多様な文化、身体性、創造の余白が失われてしまうかもしれません。

また、今回は単に「AIが私たちに与える影響」と書きましたが、これは現時点での私たちの感覚を是としたもので、私たちの感覚や認識自体が現在のものと異なっていく可能性に感じては論じたものではありません

例えば下記のような可能性があるでしょう。

・「AIに質問する」という行為が当たり前になることで、「考える」とは何を意味する行為となるか

・「正解を得る」ことと「考える」ことの関係が、どのように再定義されているか

・AIとの対話を通じて、私たちの「対話」という概念自体はどう作り変えられているか

AIの「影響」ではなく、AIとの共存によって再定義されていく「私たちの存在」についても考えていく必要があるのですが、一旦長くなったので今日はこのぐらいで。

いいなと思ったら応援しよう!