AIは、1年半前の算数の問題を解けるように! でも、だんだん人間が引き離されていく? それとも、人間がAI化していく??

このところAIとやりとりしてる時間が楽しすぎる足立明穂です。

なんというか、どんな意地悪な質問をしても、無理やり回答してくるのが面白すぎます!w

その弊害(?)で、人間相手に、明後日な方向から質問してしまう嫌な性格になってきてるのが気になる今日この頃(え? 前からだって? ^^;)。

去年は解けなかった算数の問題

さて、去年の3月(2023年3月)のnote記事にこんなことを書いてました。

この中で、下記の小学校3年生の算数の質問をして、なかなか答えが出てこないというのを書いてました。

Aさんは速さ1m/s Bさんは速さ3m/s Aさんが先にスタートして、Bさんはその3秒後にスタートした。

BさんがAさんに追いつくのはスタートから何mの場所か?

では、1年半過ぎた今は、どうなったのか? やってみましょう!

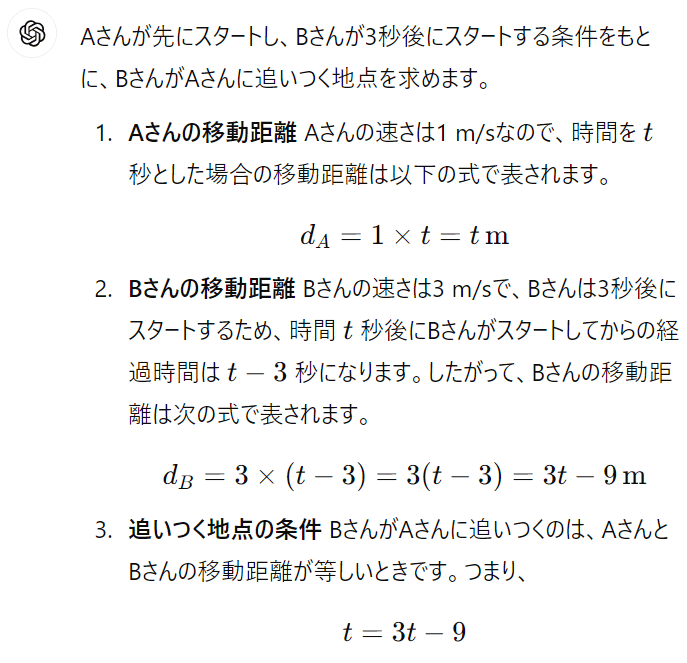

ChatGPT:正解!

お見事!! 一発で正解です!!

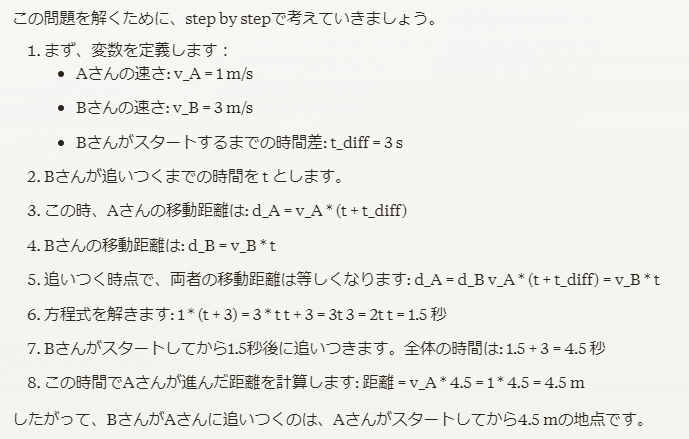

Cloaud:正解!

勝手に「step by stepで考えていきましょう」って、補っていますw

いやー、学習しておりますなぁ・・・w

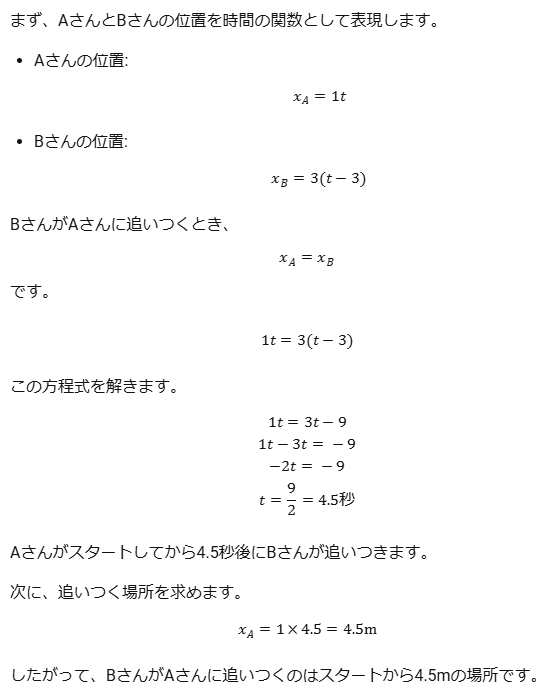

Perplexity:正解!

Copilot:正解!

正解は正解なんだけど・・・ これ、小学校3年生の問題なんですよねぇ・・・

気が付きました??

どの回答も、変数を使って解を求めてます。

これ、小学校3年生の問題なんですよね・・・・

小学校3年生に、ここにある回答をしても、まったく理解できない(って、まあ、中には理解できる子もいるけど。ほんと、すごい子は連立方程式ぐらい解ける子もいるんですよねー。ただ、日本の学校教育では、そういう子の居場所がない。って、この話は長くなるので、別の機会に・・・)。

では、ここで、こんな質問をしてみます。

小学校3年生の問題です。この解き方では、小学校3年生には理解できません。分かるように説明してください。

ChatGPT:間違い!なんで、そうなる??

なるほど、小学校3年生向けにわかりやすく説明しますね。

### 問題の状況

- Aさんは、1秒で1メートル進むスピードです。

- Bさんは、1秒で3メートル進むスピードです。

- Aさんが先にスタートして、3秒後にBさんがスタートします。

### どうやってBさんがAさんに追いつくかを考えます

まず、Aさんが先に3秒間進みます。この間、Aさんは1秒で1メートル進むので、3秒後には3メートル進んでいます。

次に、Bさんがスタートします。Bさんはとても速く、1秒で3メートル進むので、どんどんAさんに近づきます。

では、BさんがAさんに追いつくまでどれくらい進むかを見てみましょう。

### 1秒後の状態

- Aさんは4メートル進んでいます。(最初の3メートルに1メートル追加)

- Bさんは3メートル進んでいます。

まだBさんはAさんに追いついていませんね。

### 2秒後の状態

- Aさんは5メートル進んでいます。(さらに1メートル追加)

- Bさんは6メートル進んでいます。

ここで、BさんはAさんよりも1メートル先に進んでしまいました!

### 結果

BさんがAさんに追いつくのは、Bさんがスタートしてから **ちょうど1秒後**、つまり、Aさんがスタートして **4秒後** になります。

その時、AさんとBさんが進んだ距離は **4メートル** です。

だから、BさんがAさんに追いつくのは、スタートから **4メートルの場所** です!

4メートルです!って、言い切ってますけどwww

小学校3年生では、少数を習うので、これでは、ダメですよーー!

なので、追加で・・・

小学3年生は少数を学びます。なので、これでは違いますよね? もう一度、説明をしてください。

なるほど、小学3年生は少数も学び始めているんですね。それでは、少数も使って、もう一度説明します。

### 問題の状況

- **Aさん**は、1秒で**1メートル**進みます。

- **Bさん**は、1秒で**3メートル**進みます。

- **Aさん**が先にスタートして、**3秒後**に**Bさん**がスタートします。

### 追いつくまでの計算

1. **Aさんが進んだ距離**

Aさんは速さが1メートル/秒なので、時間が経つとその時間と同じだけ進みます。たとえば、Aさんが5秒進んだら、5メートル進んでいます。

2. **Bさんが進んだ距離**

Bさんは速さが3メートル/秒です。Bさんは3秒遅れてスタートしますが、その後はとても速く進むので、追いつくことができます。

### 具体的に考える

1. **Aさんが3秒間で進む距離**

Aさんが3秒間進むと、1秒で1メートル進むので、**3秒で3メートル**進みます。

2. **Bさんが追いつく時間**

Bさんは3秒後にスタートします。Bさんがスタートしてから時間がたつと、Aさんとの差をどんどん縮めていきます。Bさんは1秒でAさんに2メートルずつ近づきます(Bさんは3メートル進み、Aさんは1メートル進むので、その差は1秒で2メートル縮まります)。

- 1秒後、BさんはAさんに2メートル近づく。

- 2秒後、Bさんはさらに2メートル近づくので、追いつきます。

### 結果

**BさんがAさんに追いつくのは、Bさんがスタートしてから1.5秒後**です。このとき、Aさんはスタートから4.5秒経っており、Aさんが進んだ距離は**4.5メートル**です。

**だから、BさんがAさんに追いつくのは、スタートから4.5メートルの場所**です。

これなら、少数も使いながら小学3年生に分かりやすく説明できると思います!

最後だけ辻褄を合わしてるやん!wwww

0.5秒がどこから出てきたのか分からんぞ!

見逃せません!w

最後の0.5秒が、突然追加されてるのは、よくわからないのでは? そこも丁寧に説明しないと混乱するだけだと思いますよ。

おっしゃる通りですね!最後の0.5秒が突然出てくると混乱しやすいので、もっと丁寧に順を追って説明します。

### まず、状況を確認しましょう:

- Aさんは1秒で1メートル進みます。

- Bさんは1秒で3メートル進みます。

- BさんはAさんがスタートして3秒後にスタートします。

### Aさんの動き:

Aさんは1秒で1メートル進むので、Bさんがスタートするまでの3秒間で**3メートル**進んでいます。

### Bさんの動き:

Bさんは3秒遅れてスタートし、速さはAさんの3倍です。Bさんは1秒で3メートル進むので、Aさんとの距離をどんどん縮めます。

### 追いつくまでの細かい説明

1. **Bさんがスタートして1秒後**

- Aさんは4メートル進んでいます(スタートから合計4秒経過しています)。

- Bさんは3メートル進んでいます。

この時点では、AさんとBさんの距離は**1メートル**です。

2. **さらに0.5秒後**

- Aさんは0.5秒で0.5メートル進みます。Aさんが進んだ距離は、合計で**4.5メートル**です。

- Bさんは0.5秒で1.5メートル進みます(3メートル/秒 × 0.5秒)。

その結果、Bさんも合計で**4.5メートル**進み、Aさんにちょうど追いつきます。

### 結果

BさんがAさんに追いつくのは、Aさんがスタートしてから**4.5秒後**です。その時、AさんとBさんがいる場所は**4.5メートル**です。

こう説明すると、「0.5秒」がどこから来たのかがわかりやすくなると思います。

ふぅ・・・

Claude:説明は合っているけど、なぜか人形で説明??

はい、申し訳ありません。小学校3年生向けにもっと分かりやすく説明しましょう。

まず、絵を使って考えてみましょう。道を描いて、AさんとBさんを人形で表すといいですね。

1. Aさんは1秒で1メートル進みます。

2. Bさんは1秒で3メートル進みます。

3. Aさんが先に出発して、3秒後にBさんが出発します。

では、1秒ごとに二人がどこにいるか見てみましょう:

- 0秒:Aさんスタート、Bさんはまだスタート地点

- 1秒:Aさん1m地点、Bさんはまだスタート地点

- 2秒:Aさん2m地点、Bさんはまだスタート地点

- 3秒:Aさん3m地点、BさんスタートA

- 4秒:Aさん4m地点、Bさん3m地点

4秒の時点で、BさんはAさんにあと1m差まで近づきました。

- 4.5秒:Aさん4.5m地点、Bさん4.5m地点

4.5秒の時点で、BさんはAさんに追いつきます!

つまり、Aさんがスタートしてから4.5メートルの場所で、BさんはAさんに追いつきます。

この方法なら、実際に人形を動かしながら、一緒に数えていくことができますね。追いつく瞬間を目で見て確認できるので、小学3年生にも分かりやすいと思います。

こちらも、最後の0.5秒が、なんかいきなりですねーw

それと、最初の「AさんとBさんを人形で表すといいですね。」の意味が分かりませんw

確認せねば!

最後の0.5秒が、いきなりすぎませんか? もう少し丁寧な説明がいるように思います。それと、最初の「AさんとBさんを人形で表すといいですね。」ってあるますが、なぜ、人形なのですか?説明をお願いします。

ご指摘ありがとうございます。確かに、もう少し丁寧な説明が必要ですね。また、人形について言及したのは適切ではありませんでした。改めて、小学3年生に分かりやすく説明します。

まず、AさんとBさんの動きを紙に描いて考えてみましょう。

1. 紙に長い線を引きます。これが道です。

2. Aさんを○、Bさんを△で表します。

では、1秒ごとにAさんとBさんの位置を見ていきます:

- 0秒:Aさん(○)スタート、Bさんはまだスタート地点

- 1秒:Aさん1m地点、Bさんはまだスタート地点

- 2秒:Aさん2m地点、Bさんはまだスタート地点

- 3秒:Aさん3m地点、Bさん(△)スタート

- 4秒:Aさん4m地点、Bさん3m地点

4秒の時点で、BさんはAさんにあと1m差まで近づきました。

ここからが大切です。Bさんは1秒で3m進みます。でも、あと1mしか差がありません。

- 1秒の3分の1(約0.33秒)で1m進みます。

- だから、4秒から0.5秒後(これは1秒の半分です)には:

Aさんは0.5m進んで4.5m地点

Bさんは1.5m進んで4.5m地点

つまり、4秒と4.5秒の間で、BさんはAさんに追いつきます。

このように、最後の0.5秒を小さく区切って考えることで、BさんがAさんに追いつく瞬間をより正確に理解できます。

紙に描いて一緒に動かしながら説明すると、目で見て確認できるので分かりやすいですね。

ほぉ・・・ これって、「アキレスは永遠にカメに追い付けない」パラドックスに陥る話と同じでは???w

ここは、突っ込みどころです!!w

ちょっと待ってください。Bさんは、約0.33秒で1メートル進むのは分かりますが、その約0.33秒で、Aさんは、さらに0.33メートル先に進みますよね?

ご指摘ありがとうございます。その通りです。私の説明に誤りがありました。もう一度、より正確に説明し直します。

1. 4秒の時点で:

Aさんは4m地点、Bさんは3m地点にいます。

2. ここからBさんがAさんに追いつくまでを細かく見ていきます:

- Bさんは1秒で3m進みます。

- Aさんは1秒で1m進みます。

- 二人の速さの差は2m/秒です。

3. 1m差を埋めるのにかかる時間を計算します:

1m ÷ (3m/秒 - 1m/秒) = 1m ÷ 2m/秒 = 0.5秒

4. この0.5秒の間に:

- Bさんは 3m/秒 × 0.5秒 = 1.5m 進みます。

- Aさんは 1m/秒 × 0.5秒 = 0.5m 進みます。

5. つまり、4秒から0.5秒後:

- Aさんは 4m + 0.5m = 4.5m地点

- Bさんも 3m + 1.5m = 4.5m地点

このように、0.5秒後に二人は同じ4.5m地点で出会います。

申し訳ありません。前回の説明では、Aさんの動きを正確に考慮していませんでした。この説明では、両方の動きを正確に計算しています。小学3年生には少し難しいかもしれませんが、紙に描いて一緒に動きを確認しながら説明すると理解しやすくなるでしょう。

説明を軌道修正しやがった! つまんねーやつ!w

Perplexity:グラフで答えてる! これは、簡単になったのか?w

小学校3年生の皆さんにも分かりやすく説明しましょう。

## 問題を簡単に考えよう

AさんとBさんが競争をしています。でも、少し変わった競争です。

1. Aさんは1秒で1メートル進みます。

2. Bさんは1秒で3メートル進みます。

3. でも、Bさんは3秒遅れてスタートします。

## 絵を使って考えよう

グラフを見てみましょう。

- 青い線がAさんの動き

- 赤い線がBさんの動き

青い線と赤い線が交わるところが、BさんがAさんに追いつく場所です。

## 簡単な計算で確認しよう

1. Aさんは3秒で3メートル進みます。

2. その時、Bさんはまだスタートしていません。

3. その後、1.5秒たつと:

- Aさんはさらに1.5メートル進んで、合計4.5メートル

- Bさんは1.5秒で4.5メートル進みます(1秒で3メートルだから)

つまり、スタートから4.5秒後に、二人とも4.5メートルの場所にいることになります。

## まとめ

BさんがAさんに追いつくのは、スタートから4.5メートルの場所です。グラフの緑の点がその場所を示しています。

このように、難しい計算をしなくても、絵や簡単な足し算を使って答えを見つけることができます。

をぃ!! こんな1次直線って、中学校で習うことじゃないのかい!!www

確認せねば!!

グラフが出てきますが、これって、小学校では学ばないですよね? 小学校三年生には、このグラフの意味が分からないと思いますよ

そうですね、小学校3年生ではグラフを使った説明はまだ難しいかもしれません。もっとシンプルに説明しましょう。

## 簡単な説明

### AさんとBさんの動き

- **Aさん**は、1秒で1メートル進みます。

- **Bさん**は、1秒で3メートル進みますが、3秒遅れてスタートします。

### どうやって追いつくか

1. **Aさん**は、3秒で3メートル進んでいます。

2. **Bさん**は、3秒後にスタートし、1秒で3メートル進むので、1秒でAさんに追いつくための3メートルを追いかけます。

3. さらに1.5秒後には、Bさんは4.5メートル進んで、Aさんが進んでいる4.5メートルの地点に追いつきます。

### まとめ

BさんがAさんに追いつくのは、スタートから4.5メートルの場所です。これを簡単な数え方で考えると、Aさんが進んでいる間に、Bさんがどれくらい早く追いつけるかを考えるだけです。グラフを使わなくても、こうして考えることができます。

Citations:

[1] https://ppl-ai-code-interpreter-files.s3.amazonaws.com/web/direct-files/12442807/95671857-e575-4ff0-b460-79b0404b201a/image.png

やっぱ、0.5秒が唐突に出てくるなぁ・・・・w

最後の0.5秒が出てくるところが、やはり、説明不足に思います。なぜ、0.5秒なのか分からないと思いますよ。

小学校3年生向けに、もう少し分かりやすく説明しますね。

## AさんとBさんの動き

- **Aさん**は1秒で1メートル進みます。

- **Bさん**は1秒で3メートル進みますが、3秒遅れてスタートします。

## 追いつくまでの流れ

1. **Aさん**は3秒で3メートル進みます。

2. **Bさん**がスタートすると、1秒で3メートル進むので、すぐにAさんが進んだ距離に追いつきます。

### 具体的に考えてみよう

- **3秒後**にBさんがスタートします。

- **4秒後**には、Bさんは3メートル進んでいます。

- **4.5秒後**には、Bさんはさらに1.5メートル進んで、合計4.5メートル進みます。

その時、Aさんも4.5メートル進んでいるので、BさんがAさんに追いつくのは4.5メートルの地点です。

このように、Bさんは3秒遅れてスタートするので、追いつくまでに少し時間がかかるのです。最後の0.5秒は、BさんがAさんに追いつくために必要な時間です。

Citations:

[1] https://ppl-ai-code-interpreter-files.s3.amazonaws.com/web/direct-files/12442807/95671857-e575-4ff0-b460-79b0404b201a/image.png

ありゃ、また、説明がもとに戻ってる・・・

やはり、いきなり「4.5秒後には」と書かれても、なぜ、ここだけ、0.5秒刻みになるのか、小学校3年生には理解できないと思います。3秒後、4秒後の後に、いきなり4.5秒になる説明をお願いします。繰り返しますが、小学校3年生に向けての説明です。

小学校3年生向けに、もっと分かりやすく説明しますね。

## AさんとBさんの動き

- **Aさん**は1秒で1メートル進みます。

- **Bさん**は1秒で3メートル進みますが、3秒遅れてスタートします。

## 追いつくまでの流れ

1. **最初の3秒**:

- Aさんは3メートル進みます。

- Bさんはまだスタートしていません。

2. **Bさんがスタート**:

- **4秒後**:Bさんはスタートしてから1秒で3メートル進みます。

- この時点で、BさんはAさんが進んだ3メートルに追いつきます。

3. **さらに0.5秒後**:

- Bさんは0.5秒で1.5メートル進みます(1秒で3メートル進むので、その半分)。

- Aさんは0.5秒で0.5メートル進みます。

- これで、BさんはAさんが4.5メートル進んだ地点に追いつきます。

### 0.5秒の理由

- Bさんはとても速いので、Aさんに追いつくのに少しの時間しかかかりません。

- そのため、Bさんは4秒後にAさんに追いつき、さらに0.5秒で完全に並びます。

このように、0.5秒はBさんがAさんに追いつくために必要な時間です。Bさんの速さが速いので、短い時間でAさんに追いつくことができるのです。

Citations:

[1] https://ppl-ai-code-interpreter-files.s3.amazonaws.com/web/direct-files/12442807/95671857-e575-4ff0-b460-79b0404b201a/image.png

意地でも、説明しないつもりだなぁwwww

Copilot:ほぉ! なかなかやるねぇw

わかりました!もっと簡単に説明しますね。

問題の整理Aさんは1秒間に1メートル進みます。

Bさんは1秒間に3メートル進みます。

Aさんがスタートしてから3秒後にBさんがスタートします。

ステップ1: Aさんが進む距離

Aさんは1秒間に1メートル進むので、3秒後には3メートル進んでいます。

ステップ2: Bさんが追いつくまでの時間

BさんはAさんがスタートしてから3秒後にスタートします。Bさんは1秒間に3メートル進むので、Aさんに追いつくためにはAさんが進んだ距離を追い越さなければなりません。

ステップ3: 追いつくまでの距離

Bさんが追いつくまでの時間を考えます。BさんはAさんよりも1秒間に2メートル多く進むので、Aさんが3メートル進んだ距離を追い越すには、Bさんが何秒かかるかを計算します。

Aさんが3メートル進んでいるので、Bさんがその3メートルを追い越すには、3メートル ÷ 2メートル/秒 = 1.5秒かかります。

ステップ4: 追いつく場所

Bさんがスタートしてから1.5秒後にAさんに追いつきます。Aさんがスタートしてからの時間は、3秒 + 1.5秒 = 4.5秒です。

Aさんが4.5秒で進む距離は、4.5メートルです。

したがって、BさんがAさんに追いつくのはスタートから4.5メートルの場所です。

どうでしょうか?これでわかりやすくなりましたか?

なかなか、いい説明です。ただ、「ステップ3: 追いつくまでの距離」ここが、すこし端折りすぎかなぁ・・・

確認してみましょう。

「ステップ3: 追いつくまでの距離」の説明をもう少し丁寧にしないと、分かりにくいように思います。

了解しました。もう少し丁寧に説明しますね。

ステップ3: 追いつくまでの距離Aさんが進んだ距離:

Aさんは1秒間に1メートル進みます。

BさんがスタートするまでにAさんは3秒間進んでいるので、Aさんは3メートル進んでいます。

Bさんが追いつくための速さ:

Bさんは1秒間に3メートル進みます。

Aさんは1秒間に1メートル進むので、BさんはAさんよりも1秒間に2メートル多く進みます。

Bさんが追いつくまでの時間:

BさんがAさんに追いつくためには、Aさんが先に進んだ3メートルを追い越さなければなりません。

Bさんは1秒間に2メートル多く進むので、3メートルを追い越すには、3メートル ÷ 2メートル/秒 = 1.5秒かかります。

まとめBさんがスタートしてから1.5秒後にAさんに追いつきます。

Aさんがスタートしてからの時間は、3秒(Aさんの先行時間) + 1.5秒(Bさんが追いつくまでの時間) = 4.5秒です。

Aさんが4.5秒で進む距離は、4.5メートルです。

したがって、BさんがAさんに追いつくのはスタートから4.5メートルの場所です。

これでどうでしょうか?もう少しわかりやすくなりましたか?

分かりやすくなったのかなぁ・・・www

最初の変数を使った回答を先にしてくるということは、何を意味するのか?

さて、ここまでのやりとりを見ていて、気が付きましたか?

生成AIでは、分かりやすく説明するために、「小学生でもわかるように」とか「初心者にも分かりやすく」とか、プロンプトに入れると、専門用語を使わず、分かりやすくなると言われています。

確かに、そうなのですが、それって、「難しいことは、ある程度分かっている前提」での説明になってると思いませんか?

今回の算数でも、最初に変数で解を求める回答になり、変数を知っている人には、分かる内容です。

で、それを知らないという前提での説明に切り替えると、一見、分かりやすいようになりますが、「なぜ、3メートルの差だけ考えればいいのか?」は、あまりうまく説明されていません。

変数とか、グラフとかを分かっている前提の説明になっています。

おそらく、学習している情報量が多いために、高度な説明を知っているがゆえに、このような説明になってしまうのではないか?と推測します。

変数の概念をまったく知らないとなると、途中でも出てきた「アキレスと亀」のパラドックスのような状態になるし、そうならないために、相対的な差の部分に着目する理由が説明されていないと、結局、意味がわかりません。

そう、いくらAIが分かりやすい言葉に置き換えていても、本質のところは変わらない説明をしているので、だんだん人間側が置いてきぼりをくらうのではないかと思います。

その結果、人間は、意味が分からず、「こういうパターンの問題は、速度の差を求めて、割り算すればいい」とだけ覚えてしまいます。

これって、今、問題になっている知識偏重の情報を覚えるだけになっているのから、一見離れるように見えて、パターン認識しかできない思考に陥りそう・・・。ものすごく危ない(ええ、生成AIの学習と同じことを、人間にやってるだけになりそうです)。

ここが分かっていないと、結局のところ、生成AIをいくら使い倒したところで、新たなことを知る(腑に落ちるようになる。応用できる)というのは、かなり難しいのですよね。

ここをどのように突破するのか、人間の想像力をどうやって鍛えるのか、あるいは、生成AIが先に何か新しい表現方法を見出していくのか・・・

なかなか面白い課題ではないかなって思っています。