自動運転をつくる: Turing AIディレクターとしての500日

こんにちは、Turing株式会社でAI開発の責任者をしている山口 (@ymg_aq) です。Turingは自動運転車の開発をするスタートアップなのですが、最近はその開発規模も大きくなってきました。初期からいる人間として、ここまでのTuringの自動運転開発の軌跡を振り返ってみたいと思います。

(このNoteは Turingアドベントカレンダー2023 16日目の記事です。)

1. Turing株式会社とは?

Turing株式会社は2021年創業のスタートアップです。現在社員は40名を超え、業務委託やインターンを含めると60名近くの規模になっています。事業としては「完全自動運転EV(=電気自動車)の量産」を掲げており、ソフトウェアとハードウェアの両面で日本から新しい自動車会社を立ち上げようとしています。

シードラウンドとしては異例の規模で、創業から11ヶ月の2022年7月で10億円、2023年8月には5.2億円の資金調達を実施しています。また現在も次のシリーズに向けた資金調達に向けて動いています。

プレスリリース出ました。

— Yu Yamaguchi | Turing Inc. (@ymg_aq) July 13, 2022

"自動運転車開発のTURING社、シードラウンドで10億円の大型資金調達を実施" https://t.co/9LdiJY1Apf @PRTIMES_JPより

会社の拠点は千葉県柏市、つくばエクスプレス柏の葉キャンパス駅近くにあります。ソフトウェアエンジニアが多いこともあり、作業環境はかなり快適になっています。

こちらは昼下がりのTuringの開発風景です。最高に眺望がよいオフィスです pic.twitter.com/fuuk1xxnie

— Yu Yamaguchi | Turing Inc. (@ymg_aq) October 11, 2023

湾曲ウルトラワイドディスプレイはいいぞと社内で布教し続けた結果、通常モニタが絶滅しつつあります pic.twitter.com/5Bz17rL3Mf

— Yu Yamaguchi | Turing Inc. (@ymg_aq) October 24, 2022

また、車両を含めたハードウェア開発拠点として工場(Kashiwa Nova Factory)もあります。こちらも同じく柏の葉キャンパス駅が最寄りです。

工場がどんどんできあがってますね。来月末あたりに工場見学ツアーを予定しています😎😎😎 pic.twitter.com/UrLcWVbk5q

— たつさん/Turing HR (@Eindrachen) May 24, 2023

最近ですと、2023年10月にJapan Mobility Show 2023(旧東京モーターショー)に自社開発の電気自動車を展示して話題になりました。

スタートアップはEVを作れる! pic.twitter.com/eTbg2wnsTT

— 山本一成🌤️TuringのCEO (@issei_y) October 27, 2023

2. Turingに入る前

私は元々、つくばにある産業技術総合研究所というところで研究者をしていました。在職中、AlphaGoの論文を読んだのをきっかけに、深層学習に興味を持ち、趣味で囲碁AIや将棋AIをつくってるうちに世界大会に出るようになりました。

第三局が始まりました pic.twitter.com/9kEWxUK4uB

— Yu Yamaguchi | Turing Inc. (@ymg_aq) July 29, 2018

NHKスペシャルに出てました pic.twitter.com/6ZC8WyzSbb

— Yu Yamaguchi | Turing Inc. (@ymg_aq) December 12, 2021

流れで研究所を退職して2年ほどフリーランスの機械学習エンジニアとして働いた後、AI系の上場企業に入社して執行役員としてAI開発の責任者をやっていました。

3. 入社、機械学習チーム立ち上げ

CEO山本とは20年来の友人ということもあり、Turingには最初の社員の一人として2022年4月にJoinしました。入社当時は机も十分にない状態でまさに「スタートアップ」という感じでした。そしてこの記事を書いているちょうど500日前の2022年8月に「Director of AI」に就任し、(まずは一人から)機械学習の開発体制を立ち上げることになりました。

4月1日よりTURING株式会社に加わりました。

— Yu Yamaguchi | Turing Inc. (@ymg_aq) April 1, 2022

TURINGはLV5完全自動運転を実現するスタートアップです。イメージングデバイスと深層強化学習により、自動運転を強力に前進させていきます。 pic.twitter.com/aQHbmsKu39

4. 自動運転をつくる

さて、自動運転に向けた機械学習といっても、まずは何をやればいいのでしょう?自動運転にはすごくざっくりいうと「LiDAR方式」と「カメラ方式」という2つのセンサ方式があります。

LiDARはLight Detection And Ranging(光による検知と測距)の略称で、主に近赤外光を使って対象物に光を照射し、その反射光を光センサでとらえ距離を測定する計測手法です。あらかじめ取得しておいた走行エリアの地図(高精度3Dマップ)と組み合わせることで、自分の位置や周囲の移動物体を認識できます。この手法は2000年代に発達し、代表的な企業としてGoogle傘下のWaymoがいます。

もう一つの方法であるカメラ方式は主なセンサとして、普通のRGBカメラを使います。カメラを使った自動運転自体は昔からあったのですが、2012年からの深層学習技術の発展により、ずっと高度な画像認識ができるようになりました。カメラを使う利点として、センサの解像度が高いこと、価格が安く小型である(=車両に組み込みやすい)ことがあります。

カメラ方式を採用する代表的な企業はTeslaです。Tesla車に搭載されている自動運転システムは複数のカメラとAIモデルで周囲の状況を把握しています。そしてTuringもこのカメラ方式を採用し、AIモデルを用いた自動運転を開発しています。

AIモデルをつくる一方、Turingでは実際の車両とのつなぎこみ(カメラ/計算機/車両制御)を進めており、2022年9月には最初の公道実験を開始しました。

TURING、公道での走行実験に入りました。この最初の区間は1kmに満たないですが、大きな一歩です。

— Yu Yamaguchi | Turing Inc. (@ymg_aq) September 13, 2022

自動運転モデルをつくって自分たちの車で動かす課題、最高に面白いです。機械学習に興味のあるエンジニアの方、TURINGで働いてみませんか? https://t.co/Poo2wsAqgO

そして「1kmに満たないが大きな一歩です」と言った2週間後には北海道一周(約1500km)の走行実験を実施しました。(私も運転席に座る人として参加)

TURING、自動運転で北海道一周しました!総距離1480 kmのうち約95%をAIによる自動運転で走破しました。私も運転手(運転しない)として搭乗してきました。

— Yu Yamaguchi | Turing Inc. (@ymg_aq) October 12, 2022

動画は先導車とそれに続く自動運転車の様子です。フロントに取り付けたカメラのみで推論・制御していますhttps://t.co/Z7AoQLIBmv pic.twitter.com/lowVTHM6e1

そして2023年3月にこの自動運転システムを搭載したTuringとして初めての車両「THE FIRST TURING CAR」を販売することができました。

本日、「THE FIRST TURING CAR」の納車式を実施しました!全社員総出で納車をお祝いしました!みんな本当にいい笑顔!https://t.co/ne14QyKBbn

— 田中大介/Turing株式会社 COO (@DaisukeMAN) March 3, 2023

5. LLMを組み込む

自動運転システムができたのでAIディレクターはお役御免…とはなりません。2023年3月のシステムはLevel2と呼ばれる自動運転のカテゴリで、人間が責任を持つ必要があります。これに対してTuringが目指すのは「Level5」、いわゆる完全自動運転です。

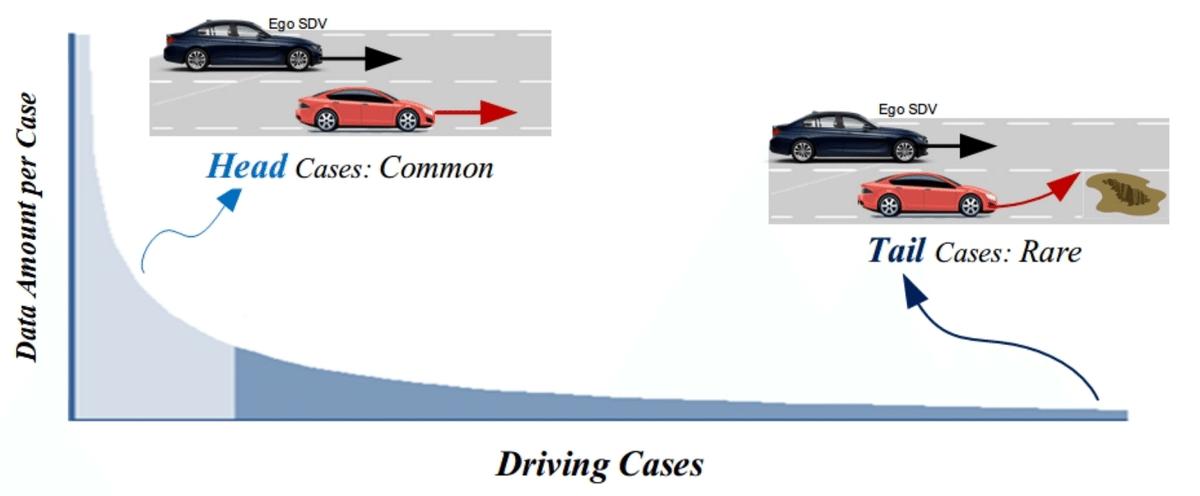

どのような状況でもシステムが責任を持つ完全自動運転では、Turingの方式も含め既存の自動運転技術の延長では難しいと考えています。なぜなら、運転環境のうち数%は稀なケースが大量にあるような典型的なロングテールな分布になっており、その全てに対応するのが難しいためです。

このような状況に全て対応するには、人間のように論理的・抽象的に思考し、あらゆる状況に対応できる汎用モデルが必要です。

5-1. ChatGPTの出現

入社時から高度な自動運転にはLanguage Modelが必要ではないかと考えてたのですが、2022年11月にChatGPTが公開されるとその予想は確信に変わりました。

社内でChatGPTについて話しました pic.twitter.com/TvLnvR4nKJ

— Yu Yamaguchi | Turing Inc. (@ymg_aq) December 9, 2022

そしてその後のGPT4やその他のLLMの登場により、とりあえずこれを車両に組み込んで動かすことにしました。

実際の走行デモは2023年6月に行われました。このときはまだマルチモーダルモデルではなく、カメラの映像から物体検知モデルを動かし、その座標等の情報をLLMに渡して車の経路や停止・発進を判断させ、実際に車両の制御もさせていました。

ちなみにこちらの研究はちょうど今週ニューオリンズで開催されていたNeuRIPSと併催されたML4ADというシンポジウムで発表した他、論文もArXivで公開されました。

Evaluation of Large Language Models for Decision Making in Autonomous Driving

— AK (@_akhaliq) December 12, 2023

paper page: https://t.co/TKo9CccbPs

Various methods have been proposed for utilizing Large Language Models (LLMs) in autonomous driving. One strategy of using LLMs for autonomous driving involves… pic.twitter.com/iBvJS8tWOa

5-2. マルチモーダルモデルをつくる

LLMと自動運転を組み合わせることに成功はしましたが、課題もみえてきました。それは画像の情報を過不足なくLLMに伝えるのが難しいという点です。人間もそうであるように、運転の判断の90%以上は視覚情報によるものです。

そこでTuringではLLMに視覚を与えるマルチモーダルモデルの開発を進め、2023年9月にはマルチモーダル用の学習ライブラリ「Heron」とその学習済みモデルを公開しました。

本日、Turingより画像-言語を統合的に学習できるマルチモーダル学習ライブラリ「Heron」を公開しました!

— Yu Yamaguchi | Turing Inc. (@ymg_aq) September 7, 2023

また、最大700億パラメータの学習済みマルチモーダルモデル群も同時に公開しました。

今回の知見をもとに、完全自動運転にむけた開発を強力に進めていきますhttps://t.co/mRkar3It5l

これにより、画像認識モデル + LLMでは難しかった複雑な交通環境も理解可能になりました。将来的にはこのようなモデルをさらに学習させ、自動運転車両に搭載します。

先日公開したHeron、何がすごいかって「進入禁止」と「天下一品」を区別できるんですよねhttps://t.co/zuvAxNWjha pic.twitter.com/t8LfDvvzir

— Yu Yamaguchi | Turing Inc. (@ymg_aq) September 10, 2023

というかこれ、すでに結構理解できてる…?https://t.co/zuvAxNWjha https://t.co/MGLH5clZUl pic.twitter.com/AjwHU1Mudp

— Yu Yamaguchi | Turing Inc. (@ymg_aq) September 14, 2023

6.「完全な」自動運転をつくる

さて、将来的な完全自動運転に向けた Director of AIの仕事は天才的な手腕を発揮して超人間的なAIをゴリゴリと完成させること…ではありません。では何かというと、自動運転用の大規模モデルを完成させるには

データを集める

GPUを集める

人を集める

を進めることだと考えています。

まず1つ目の「データを集める」ですが、AIを学習するには大量のデータが必要になります。そして自動運転の場合には走行データです。Turingでは軽自動車を改造して周囲にカメラを取り付け、1台あたり300km/日程度のデータ収集車両を開発し、運用しています。

車両CANからのデータも含めた走行データセット500時間収集を完了しました㊗️🎉🎉アカデミア研究での活用も並行して進めてます(進めはじめた) pic.twitter.com/EbSxWc6Xai

— 青木 俊介 TuringのCTO (@aoshun7) November 4, 2022

自動運転AIの学習にはとにかく走行データが必要なわけですが、各ドライバーにランダムなルートを毎回用意するのは地味に大変という悩みがありました。

— Yu Yamaguchi | Turing Inc. (@ymg_aq) November 25, 2022

インターンの井上さんにお願いしたところ、自動化されて100倍速く経路を指示できるようになりましたhttps://t.co/AhMuSwltHN

また、走行データは動画で取得するので多い時で週10TB程度増加していきます。そのような大規模データを学習したりデータパイプラインを構築する、いわゆるMLOpsを大規模に整備する必要があります。

技術記事を書きました。モデルを学習させるとき、非常に巨大なデータセットをどう扱うか?という話題です。

— Yu Yamaguchi | Turing Inc. (@ymg_aq) May 23, 2022

PyTorchとWebDatasetを使って、ネットワーク経由で訓練データをハンドリングする方法を紹介します。https://t.co/Ad6QGOCHmu

気を整え、拝み、祈り、感謝のアノテーション一日一万回🚥 pic.twitter.com/McKzHLrGRh

— 山本一成🌤️TuringのCEO (@issei_y) November 18, 2022

そして2番目の「GPUを集める」ですが、これはやはり大きなモデルを学習させるには避けては通れません。私はここ半年くらい、大規模なGPUリソースを確保するために奔走しています。

AWSのLLM開発支援プログラムでさっそくH100x8を使って学習をガンガン回してます!!!人生初のH100😂計算機がとにかく必要なので本当にありがたいです🙏効率よくたくさん実験回していい結果出していきたい! https://t.co/7Lv52xk8K1 pic.twitter.com/bWSu2vwVHF

— いのいち (@inoichan) September 5, 2023

大規模モデルを支える分散並列学習のしくみ Part1|https://t.co/6Si5kJE0xg #zenn

— Kazuki Fujii (@okoge_kaz) June 20, 2023

インターン先でTech Blog書きました!!

分散学習に関する知識を網羅的に扱っています

そして2023年5月ごろから動いていたH100 96基からなる自社GPUクラスタ「Gaggle Cluster」について、先日発表しました。この他も公的な補助金の申請なども担当して進めています。

Turing、大規模GPU基盤「Gaggle Cluster」を構築します。まずはH100 96基でノード間通信とストレージ速度を最大化し、LLM向けに国内最高レベルの分散学習環境を整えます。

— Yu Yamaguchi | Turing Inc. (@ymg_aq) November 22, 2023

自動運転EV開発のチューリング、AI開発基盤として大規模GPUクラスタ「Gaggle Cluster」の構築に着手https://t.co/YMziTyR5yj

最後に「人を集める」、これが最も重要です。完全自動運転は人類にとってのグランドチャレンジだと私は考えています。そのためには1人のスーパーマンではなく、100人のスーパーマンが必要です。

そこで、2023年6月により将来に向けた研究を進める「リサーチチーム」を新設しました。現在はインターン含め8人が所属しています。

Turingで開発に関わり始めてもうすぐ2年です!これまで様々なプロジェクトに取り組んできて気づいたことを言語化してみました!これからもどんどん成長していきたい💪

— いのいち (@inoichan) September 2, 2023

創業期スタートアップに2年いてわかった働き方に対する「気づき」|いのいち @inoichan #note https://t.co/0sEGnJEcxL

リクルートからTuringに入社した、つよつよエンジニア、棚橋さんの入社記事です。量子アニーリングをはじめ最適化のプロフェッショナルで、自動運転リサーチチームで完全自動運転に向けた研究開発に一緒に取り組んでいます

— Yu Yamaguchi | Turing Inc. (@ymg_aq) June 15, 2023

棚橋 耕太郎/Kotaro Tanahashi | Turing https://t.co/5ZmcFxZ6Us

また、個人的にはTuringの課題はKaggleをやっている方と相性がよいと思っているので、そういうコミュニティにリーチすべくイベントのスポンサーをしたり、Kaggler向けの採用導線を作ったりしています。

9/23(土)に関東Kaggler会というオフラインイベントを開催します!!!当日は豪華なスピーカーの方々をお招きしてKaggleについて語っていただきます🎉ぜひ参加してください🙌LTも募集してますのでKaggleネタをお持ちの方はぜひ!

— いのいち (@inoichan) August 9, 2023

関東Kaggler会 https://t.co/DBHQKhwxzf #kanto_kaggler

また、もちろん機械学習以外のエンジニアも集めなくてはいけません。TuringはなぜかTwitter認知度が異常に高く、初対面の方に9割くらい「Twitterでみてます」と言われます。これはいいことですが、Twitterだけだと技術的な詳細が伝わりにくく、エンジニアの採用には中々つながりません。

そこで2022年10月ごろからテックブログを活用することで技術発信をしていく方針を打ち出しました。

私はAI開発だけでなく、Turingのソフトウェア開発全般の責任者でもあるのですが、車のソフトウェアは組み込みからOSのような低レイヤからアプリケーション、UI、機械学習モデルなど、すごく多岐にわたります。そのような開発の内容を発信していけば、多くのエンジニアに認知されるのでは…という戦略です。

最近「Turingのテックブログみました」と言われることが増えてきました。

— Yu Yamaguchi | Turing Inc. (@ymg_aq) August 21, 2023

ちょうど1年くらい前に技術発信の一形態として力を入れ始めたので、皆さんの目に留まる機会が増えてありがたいですhttps://t.co/LzhgFuySAz pic.twitter.com/FPGc48eLy4

7. おわりに / 次の500日に向けて

軽くやったことを振り返る記事にするつもりが、思ったより多くて長文になってしまいました。ディレクターというと何だか偉そうですが、日々の仕事の感覚としては「球拾い」をひたすらしているという方が近いです。ただ、Turingが普通の会社と違うのは、球拾いの途中でフルスイングしてホームランを打つ必要があるところでしょうか。

Turingは会社の本社を2024年1月22日から大崎に移し、さらに多くの人を集めたいと考えています。

Turing、2024年1月22日より本社機能を柏の葉から大崎に移転します。

— Yu Yamaguchi | Turing Inc. (@ymg_aq) November 10, 2023

場所はJR大崎駅直結、ゲートシティ大崎です。リサーチ/ソフトウェアチームもこちらに移動します。

自動運転EV開発のチューリング、組織拡大に伴い「ゲートシティ大崎」へ本社を増床移転 https://t.co/yW8qWmb8Ue

自動運転開発もそうですし、会社事業もこの先の500日はさらに難しい局面が待ち受けていると思いますが、しっかりと頑張っていきたいと思います。

頑張ります https://t.co/4y9GwjnkOw

— Yu Yamaguchi | Turing Inc. (@ymg_aq) June 18, 2023

Appendix: 車への興味

実は私はTuringに入るまでは車に1ミリも興味がなく、免許を取って以来12年間ペーパードライバーでした。しかし実際に車を所有するようになって知らないうちにいつの間にかすごく興味を持つようになりました。

ちょうど今週、4台目であるTesla Model3が納車されたので、「研究」していきたいと思います。

Tesla Model3 (AWD) 、納車されました。しっかり研究していきます pic.twitter.com/m7ZS4EcbVD

— Yu Yamaguchi | Turing Inc. (@ymg_aq) December 13, 2023