Final Cut Pro 11のアップデートから考える

昼から取材を終えて3キロを走ったらもう暗くなっていた。シャワーを浴びて、買ってきた焼き芋を食べながら、コーヒーではなく紅茶を淹れた。最近リプトンに浮気しつつある。特に日曜日の昼下がりは。

ファイナル・カットを立ち上げると、App Storeからバージョン11が出たとの報告が来た。報告というより、自分でアップデートを確認しにいったのだけど。

Final Cut Pro 11は、これまで以上に速く、よりスマートに進化したらしい。10から11だから大きな変更がある。新しいAI強化ツールを活用し、時間を節約できるワークフローの改善で効率的に作業し、空間ビデオを編集できるとのこと。

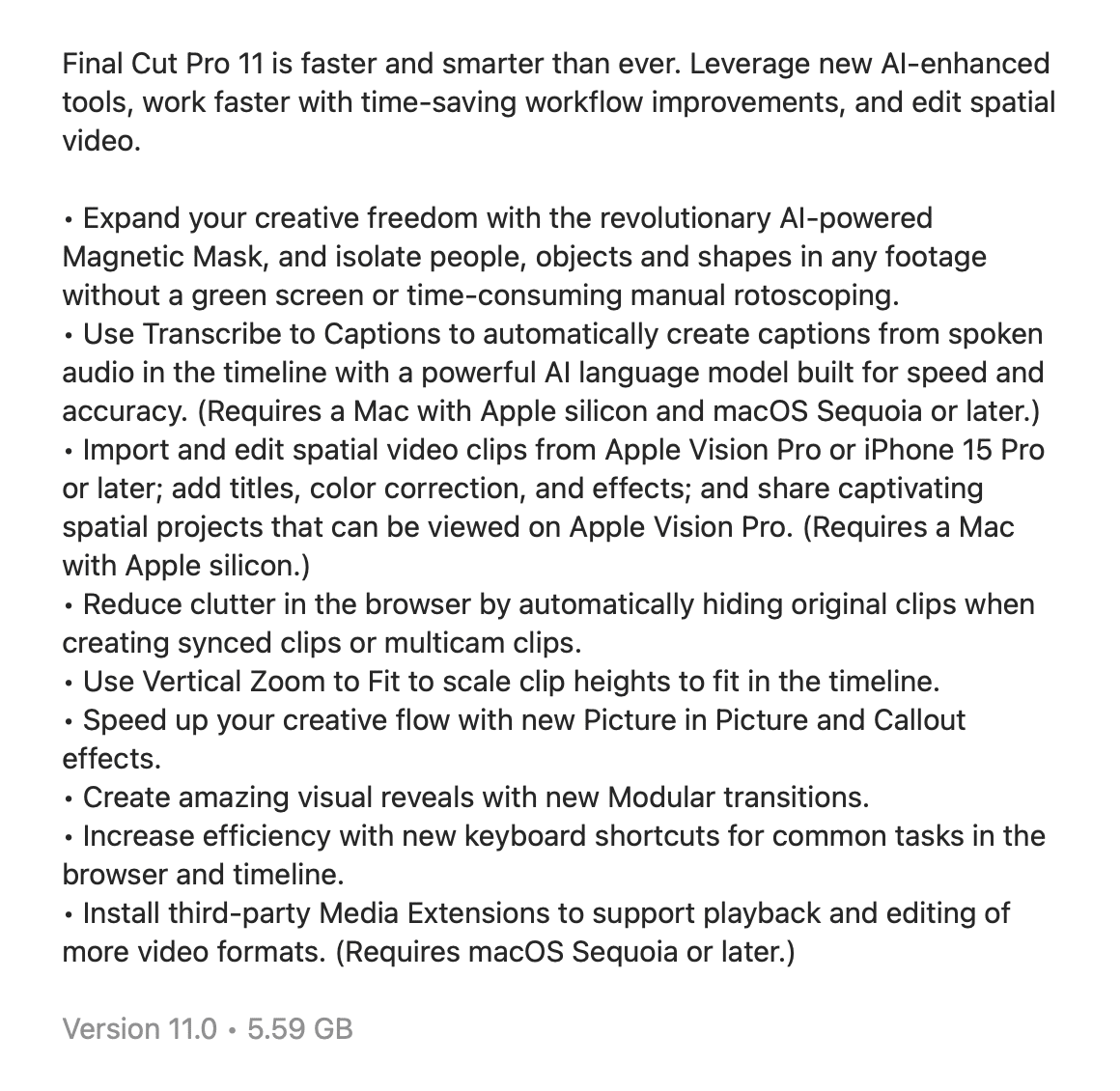

アップデートの内容はこのような感じ

・革新的なAI搭載の「マグネティックマスク」でクリエイティブな自由を拡大し、グリーンスクリーンや時間のかかる手動ロトスコープなしで、映像内の人物、物体、形状を分離できます。

・「トランスクリプトからキャプションへ」の機能を使用して、タイムライン内の音声を高速かつ正確なAI言語モデルでキャプションに自動変換します。(Appleシリコン搭載のMacおよびmacOS Sequoia以降が必要です。)

・Apple Vision ProまたはiPhone 15 Pro以降のデバイスから空間ビデオクリップをインポートおよび編集し、タイトルやカラー補正、エフェクトを追加し、Apple Vision Proで視聴できる魅力的な空間プロジェクトを共有できます。(Appleシリコン搭載のMacが必要です。)

・同期クリップやマルチカムクリップを作成する際に、ブラウザ内のオリジナルクリップを自動的に非表示にして、画面をスッキリ整理できます。

タイムラインのクリップの高さをスケールする「垂直ズームを合わせる」機能を活用します。

・新しい「ピクチャ・イン・ピクチャ」と「コールアウト」エフェクトでクリエイティブな作業をスピードアップします。

・新しい「モジュール型トランジション」で驚くような視覚効果を作成できます。

・ブラウザやタイムラインで一般的な作業に対する新しいキーボードショートカットで効率性を向上します。

・サードパーティの「メディア拡張機能」をインストールして、より多くのビデオフォーマットの再生および編集をサポートします。(macOS Sequoia以降が必要です。)

細かなところは解説系のYouTubeを見るとして、大きな変化としては以下の3つになると思った。

1,AIマグネティックマスク

2,自動文字起こし

3,Apple Vision用 空間ビデオの編集

オフィシャルによるとLogicと、iOSバージョンもアップデートしていて、映像、音楽、撮影、編集のワークフローをより統合し、最適化されたような印象がある。 https://www.apple.com/jp/newsroom/2024/11/final-cut-pro-11-begins-a-new-chapter-for-video-editing-on-mac/

1,AIによるマグネティックマスクは、いわゆる特定の人物や物にマスクをかける機能が強化されたということ。自動選択して、細かな調整は手動で行う必要があるが、自動選択の精度は編集時間の短縮を生む。そしてその精度は高いらしい。この機能が強化されると、背景合成前提で、スタジオでグリーンバックで撮影していたような撮影が不要になる。ライティングだけをきちんとして、とりあえずシンプルなバックで撮影しておいて、切り抜いて編集、ということができるので、撮影コストや時間を大きく短縮できそうだ。

2,自動文字起こしようやくキタ、と多くの人が思っただろう。やっとかという思いだった。しかし、日本語未対応で解析できる言語は英語のみ!これにはちょっとがっかりだけど、すぐに日本語対応してくる感じもする。

3,はApple Visionを使わない自分には正直関係ない。が、グラス型デバイスの時代に突入すると、重要度が増す部分で、触っておくに越したことはない。赤と緑の3Dメガネで見る時のような感じで、シーンやキャプションを編集できる。再現確認としても3D再生できるデバイスが必要なので、Apple Visionを買わないことには始まらないかも。

アドビに自動文字起こしが付いて誰もが歓喜して、ファイナルカットまだかまだかでようやくキタところに、日本語未対応で落胆する。

最近はAIが入ってから、プラットフォーム側が驚異的なスピードで進化しているので、編集の重要性が落ちているようにも感じる。

例えば、YouTubeの自動翻訳の精度が知らぬ間に”すごく”上がっている。少し前までは、宇宙からのメッセージのような日本語の自動翻訳を行っていたところが、最近はどんなに雑に喋ってもほぼ90%理解できるように翻訳してくれる。

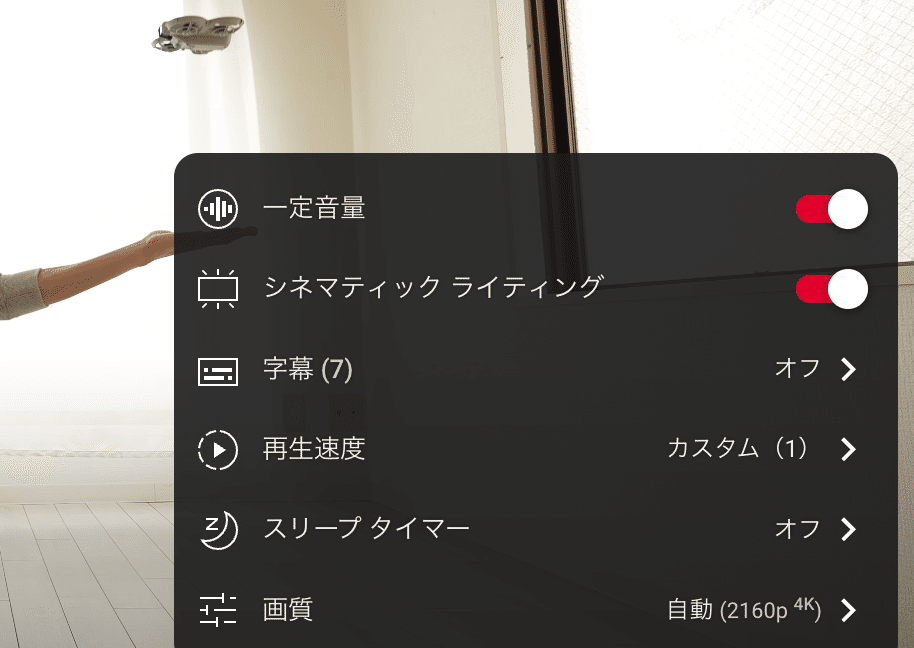

また「一定音量」の機能も追加されて、自動でONになっている。これはその名の通り、音量のばらつきがある映像に対して、均一化を行い聞きやすくするためのもの。自動でコンプレッサーをかけてくれているようなもので、何も音声編集をせずに雑に上げた動画でも聞けるようにしてくれるというもの。レベル調整量は限られているので、極端に音量が小さかったり、大きかったりするものはまだ難しい様子。

更に、これはおそらくまだ英語版、または一部のチャンネルのみとなるが、AIによる音声解析のちの、概要欄自動表示という機能も付いた。これは、もう自分で概要欄を書く必要が無いということ。

自動文字起こし、翻訳、キャプション、音量、さらに概要欄、というように、アウトプットに必要な要素の大部分をプラットフォーム側が行うようになると、動画制作のハードルはますます下がる。動画編集の技術が無い人でも、より手軽に動画をアップできて、発信ができるようになる。

だから、僕は今回のファイナルカットのアップデートにはさほど驚かず、むしろその周辺のプラットフォームやAIの進化(深化)について、ますます考えさせられることになっている。

ちなみに、仕掛中の編集があるため、まだ11にアップデートはできていない。

いいなと思ったら応援しよう!