[iOS 17] Object Capture for iOSの公式サンプルのコードを読む #WWDC23 #visionOS

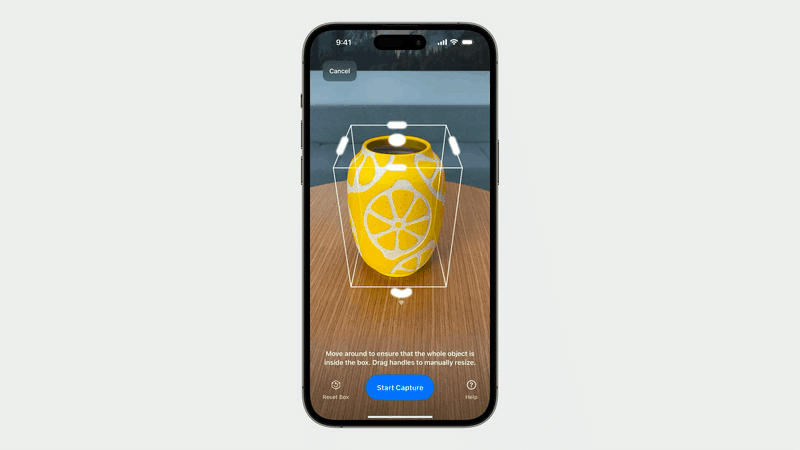

iOS 17では、3D Object Capture周りのAPIが追加され、次のようなインターフェースの3D物体スキャン機能の実装が可能となった。

「Meet Object Capture for iOS」セッション内で言及されているサンプルはWWDC23会期中の時点ではまだ公開されていなかったのだが、6月末〜7月頭あたりに公開されたようだ。

#WWDC23 会期中はまだ出てなかったObject Capture for iOSのサンプルがいつの間にか公開されてますね。

— 堤修一 / Shuichi Tsutsumi (@shu223) July 4, 2023

Scanning objects using Object Capture | Apple Developer Documentation https://t.co/3TdR2faqTC #iOS17

本記事ではこちらのサンプルのコードを読みつつ、Object Captureの実装方法を整理する。

ObjectCaptureSession とObjectCaptureView

Object Capture for iOSという新機能は、ObjectCaptureSessionとObjectCaptureViewという2つの新APIに集約される。

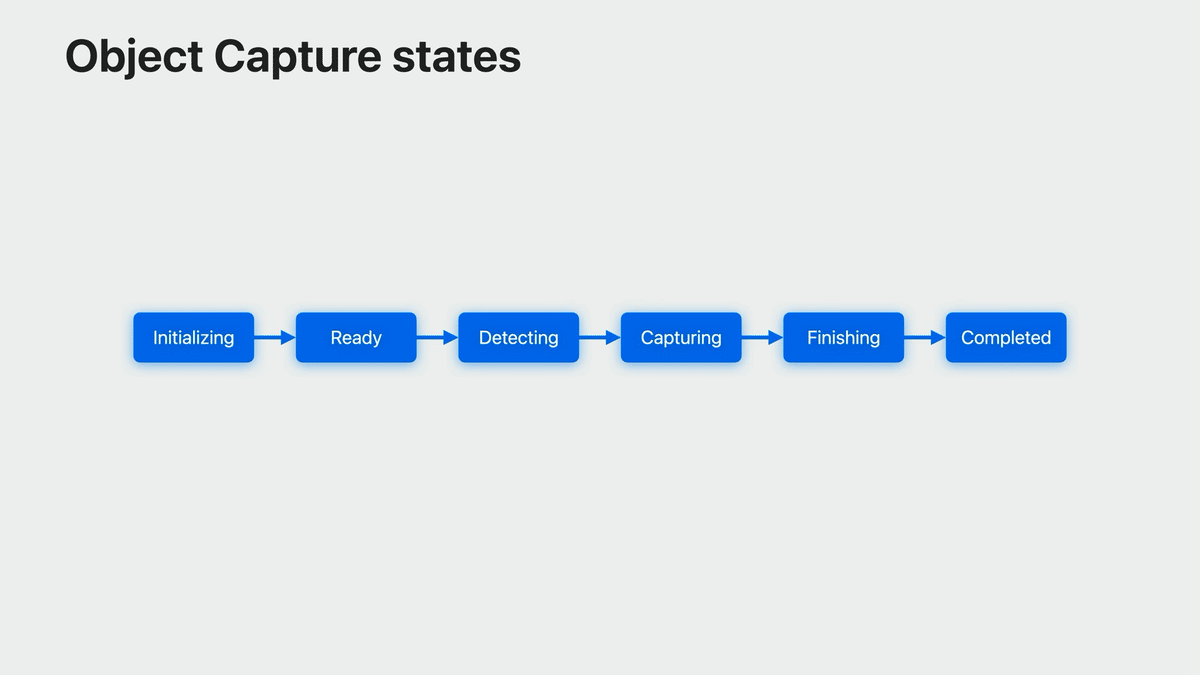

ObjectCaptureSessionは、3Dキャプチャーのセッションの状態を管理・制御するクラス。

そしてObjectCaptureViewは、ObjectCaptureSession オブジェクトを受け取ってセッションの状態に応じたUIを表示するSwiftUIのビュー。

ざっくりとした理解としてはこれだけでOK。

以下、セッションの状態 (ObjectCaptureSession.CaptureState) ごとに公式サンプルの実装を見ていく。

最後まで読んでいただきありがとうございます!もし参考になる部分があれば、スキを押していただけると励みになります。 Twitterもフォローしていただけたら嬉しいです。 https://twitter.com/shu223/