ロボットと哲学③ロボット工学の三原則

皆さんはアイザック・アシモフという人物をご存知だろうか。彼はアメリカの科学者兼作家であり、SF界のビッグスリーの一角をなす人物である。その中でも今回特に着目すべきは、彼の小説内に出て来る「ロボット工学の三原則」である。なお、ロボット工学(robotics)と言う語はアシモフの小説が初出である。

ロボット工学の三原則

ロボット工学の三原則

第一条 ロボットは人間に危害を加えてはならない。また、その危険を看過することによって、人間に危害を及ぼしてはならない。

第二条 ロボットは人間にあたえられた命令に服従しなければならない。ただし、与えられた命令が第一条に反する場合は、この限りではない。

第三条 ロボットは、前掲第一条および第二条に反するおそれのないかぎり、自己をまもらねばならない。 アイザック・アシモフ『われはロボット』(小尾芙佐訳,早川書房)2004.

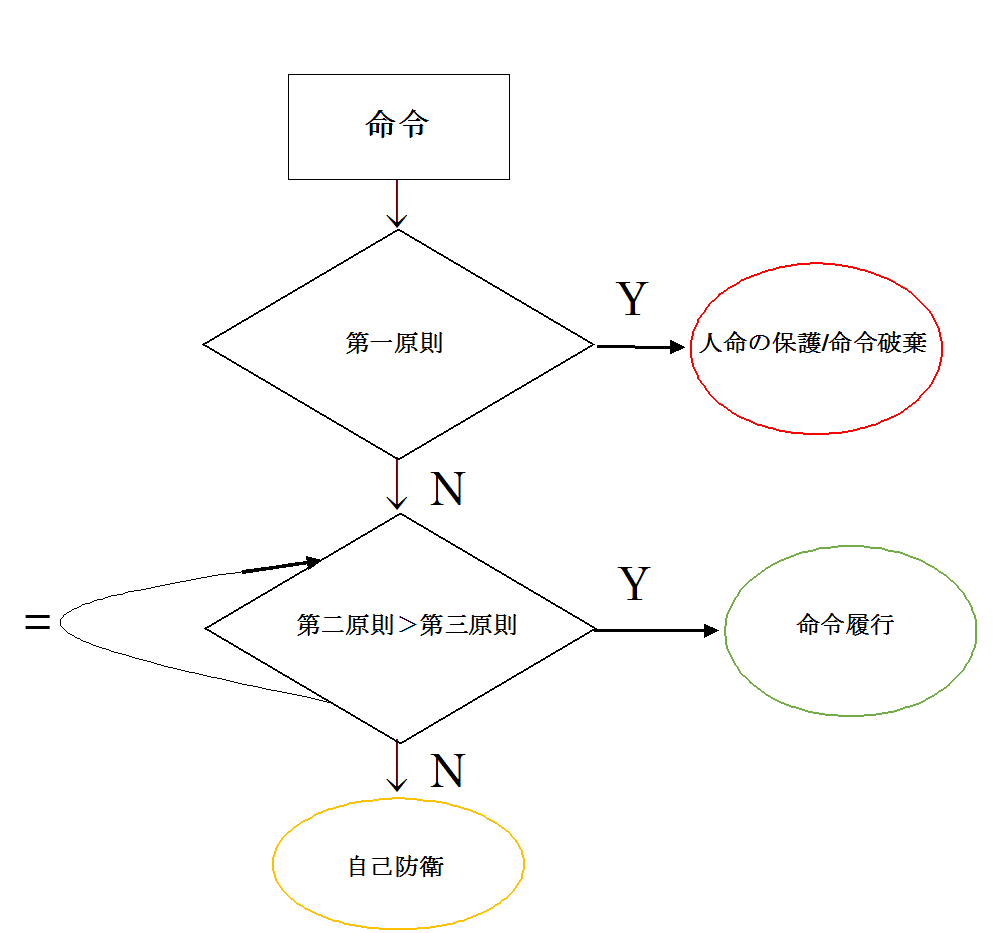

小説内のロボットは、この三原則に従って行動する。この原則をアルゴリズムとして図示すると、以下のようになる。

ロボットはある状態において、第一条に該当する場合(人間に目下の危険が迫っている状態、命令によって人間に危害が及ぶ場合)はYに進み、例え命令を破棄してでも人間に対する脅威から人間を守る。特に人間に対する危機が見受けられなければ、N方向(第二原則)に進む。命令が与えられていれば、それを履行する(Y)。命令が与えられていなければ、第三原則を参照し、自分に危機が迫っていれば自身を防衛する。人間・ロボット自身に対する脅威がなく命令も与えられていない場合は、特筆すべき行動選択は無い。

自己学習と推論

この「三原則」によって、ロボットは常に適切に行動するようになったのか、答えは否である。例えばある人がロボットに対して「Aという事実について、他人には秘密にしろ」と命じたとしよう。そこで別の人が同じロボットに「Aについて事実を話せ」と命じたら、ロボットはどうすれば良いのだろうか。このような場合、どちらの命令がより重要であるかを判断することになる。ロボットには推論能力や自律性が求められる。アシモフの小説内では、ロボットは三原則と自己学習の間隙にある不安定なものとして描かれている。

以下のケースから、推論メカニズムに生じる問題を考えよう。

この図は、アシモフのとある小説に出てきたロボットの行動をアルゴリズムとして図式化したものである。このロボットは高価なロボットであり、壊れたときの経済的損失が大きい。従って、与えられた命令の重要度から、第二原則と第三原則のどちらを選択すればよいのかを判断するようにプログラムされている。低次の命令に対してはロボットの損壊を回避する、すなわち高次の第三原則が優先するのである。しかし、第二原則と第三原則が同等であると判断された場合、どちらの原則を優先させればよいのだろうか、判断不可能になってしまう。命令の履行と自己防衛を同時に行うことが両立不可の場合、ロボットは思考のループに陥ってしまうのである。

ロボットにとっての自我

懐疑的な思考に陥り「自分たちよりも劣った人間が自分たちを創造したはずがない」と考える話もある。逆説的に言えば、人間よりはるかに優れたロボットが人間に従属しているのは第一原則があるからであり、人間は三原則によってロボットから守られていると考えられている。様々なロボットが登場するアシモフの小説には、推論や思考によってロボットがある種の「自我」を獲得したように見えることが多い。けれどども彼らの思考回路は設計されたものであり、どれだけ学習を重ねても結局は「ロボット工学の三原則」に縛られているのである。

作中でロボットが人間の創りだした「科学」を否定する一方で「小説」に興味を示す描写もある。人間の心や精神は、科学では超えることのできない領域にあるのかもしれない。哀れなロボットは三原則に縛られており、縛られているが故に自我も持てず自由にもなれず、しかもその三原則は必ずしも想定通りには機能しないため、完全な存在にもなりえない。私たち人間は性能は劣り時に間違えも起こすが、自分たちを操る絶対的な命令もなく、自由な思想と自我がある、私たちの精神は誰にも縛られていないのだ。

上記以外にも、労働がロボットによって代替されるなら子育てや政治、行政までもをロボットに任せても良いのか、プログラムに従ってある種硬直的に行動するロボットが人間の感情的な発言がいかに作用するかなど、様々なテーマが「ロボット工学の三原則」を背景に繰り広げられている。これ以上はアシモフの小説を実際に手に取って読んで頂きたい。

いいなと思ったら応援しよう!