【生成系AI 研究活動#04】Stable Diffusionをローカル環境で動かしてみた

はじめに

以前、Stable DiffusionをGoogle Colab(有料)で動かしてみたのですが、毎回起動するたびに使えるユニット数がどんどん減っていくことが、ネックでした。

AI画像生成は大量に作成して、自分の理想の画像を出力する必要があるので、やはり、ローカル環境でできるようにしておくことは必須だと感じました。

また、カスタマイズをするためにはローカル環境がいいということで、ローカル環境での構築と、AI画像生成を実施しました。

インストールとモデル取得

インストール方法は下記参照。

導入自体は簡単にできました。

※特記すべきことが無かったので、インストール過程は省略。

自分好みのモデルをダウンロードし、画像作成してみる。

※一番右が落としてきたモデル

モデル①

https://civitai.com/models/130165/irismix

モデル②

https://civitai.com/models/104100/kawaii-realistic-anime-mix

モデル③

課題

①大きい画像の場合(1024×670)に、画像が生成できない事象が発生。一度に5枚(デフォルト)が原因と思われるため1枚にして対応。

PCスペックが高ければ、問題ないかもしれない。

②生成中、PCが「ウィンウィン」言って上に排熱がけっこうあるので、冬場の作業に適してそう(パソコンへの負荷は大きい)。

③手はモデル変えても精度は上がらなかった。

④横長画像にすると、クオリティーが下がるのも同様。横長にするにしても768×512ぐらいまでに抑えるべき。

参考:https://bocek.co.jp/media/exercise/stable-diffusion/5125/

NG例①

腕が途中から枝分かれ・・・

NG例②

色々破綻している。一枚10分ほど。何度か実施したが、まともなイラストがなかなか生成されない。

さいごに

やはり「モデル」が大事。

そして、料金やデータ管理、拡張機能等、スペックが対応していれば、やはり、基本的にはローカル環境が最適という結論。

自分で「描く」よりコスパはいい。短期間に高品質のものが描ける。

描きたいものをどうやって描けるのか今後も学習が必要。

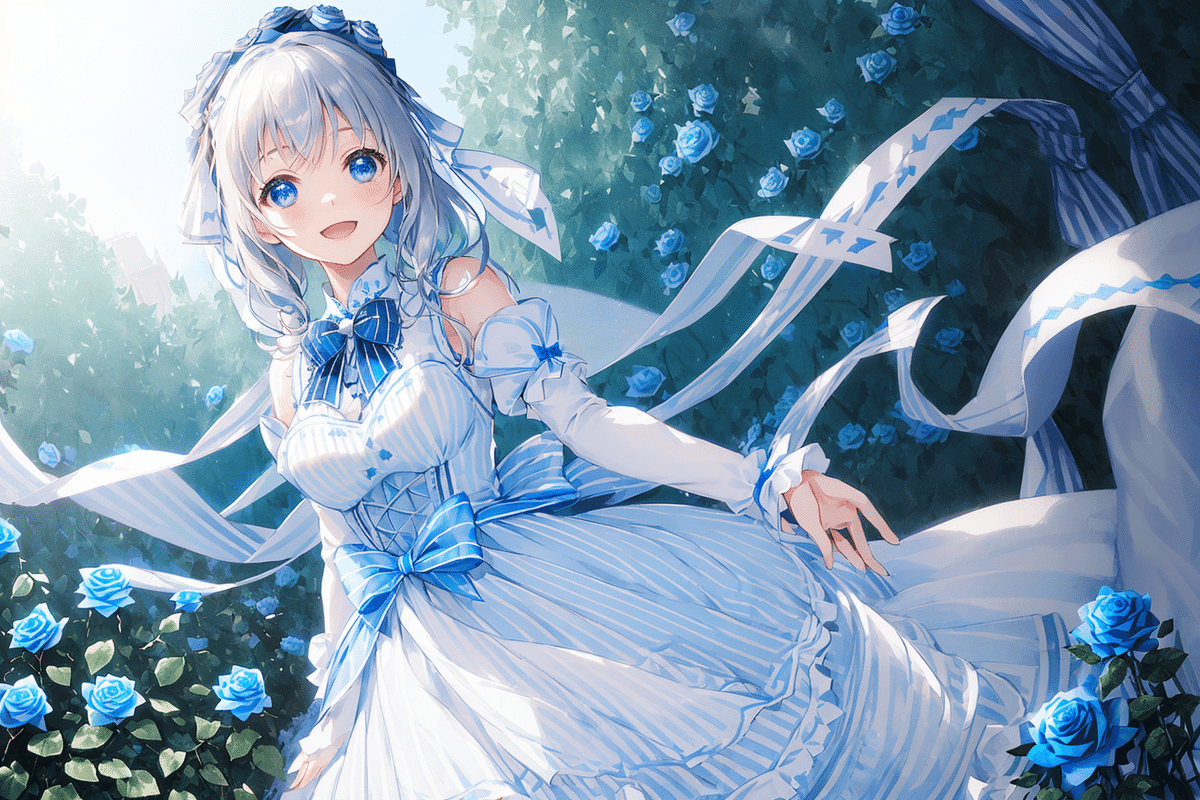

今回は少女ということで、サンプルがあるものなので、ある程度簡単に高品質のものができたが、男性のモデル自体が少ないし、それ以外の画像を作成したいときに、作成できるのかの問題があるのではないかと思う。

ちなみに、新しいモデルを作成できないか、調べてみたが、無理そうだった。

代わりにモデルをマージして(混ぜ合わせて)新しいモデルを作成する方法はあった。

以下、最後に作成したときのキャプチャと生成画像。