機械学習を体験!ジェスチャー操作でミニ四駆を動かそう!

こんにちは、ユカイ工学のkurikitチームです!

10/3,4に開催するMaker Faire Tokyo 2020に学研、マクニカ、タミヤ、ユカイ工学の4社協業プロジェクト「つみきプロジェクト」が出展します!

今回はそこで展示する試作機「ハンドパワーで、走れ!ミニ四駆」の作り方をご紹介します!

ぜひ、ご自宅でも体験してみてください!

* * * * *

タミヤから発売されているミニ四駆をユカイ工学のココロキットを組合わせて、ジェスチャー操作してみましょう!

工作レベル:★★☆

プログラミングレベル:★★☆

制作時間:3〜4時間

使うもの

・ミニ四駆(タミヤ)

・ココロキット(ユカイ工学)

・ハーネス

作り方

1. ミニ四駆を組み立てる

まずはミニ四駆を組み立てましょう!

組み立て方は、付属の説明書をご参照ください。

2. ココロキットを取り付ける

ココロキットをミニ四駆に取り付けましょう!

ココロキットには2つの端子がありますね。

これで2つのモータを操作できるんですが、ミニ四駆は1つのモータしか使いません。

そこで、片方の端子だけをミニ四駆の電池ボックスの+-端子にテープでくっつけます。長めの2ピンコネクターハーネスを使いましょう。今回はこちらを使用しました。

ハーネスは図のようにニッパーかはさみで片方を切りましょう。

カッターの刃で表面の被覆に円状の切り込みをいれ、手で被覆をむきます。

カッターで手を切らないように十分注意してください。

被覆がはげた部分をテープでミニ四駆の+-端子に巻き付けます。さらに上からテープなどで固定すればズレません。

ハーネスをシャーシとカウルの隙間から出し、ココロキットに繋げましょう。

両面テープでミニ四駆の上に固定したら完成です!

3. Scratchでプログラムを書く

ジェスチャーでミニ四駆を動かしてみましょう!

ココロキットにはML2ScratchとPoseNet2Scratchという機械学習モジュールを使うことができます。機械学習は、機械が画像を見てなにがどれなのかを判断できるように学習させることです。例えば、猫の画像を大量に見せて、機械が猫の画像かそうではないかを判断させることができます。

ML2Scratch(Machine Learning to Scratch)はパソコンのカメラを使って写真をとり、機械学習を勝手にやってくれます。学習が完了した時、その機械を識別器と呼び、それをscratchでコントロールできるという素敵なモジュールです。

PoseNet2Scratchは人間の関節を識別して関節がどの位置にあるかがわかります。PoseNetはすでに学習済みなので写真を取る必要がなく、すぐに人間の関節位置を示してくれます。

使い方はこちらの記事を参照してください。

今回はPoseNetを使って手首関節を認識し、ミニ四駆を操作します。

以下の手順に従ってサンプルプログラムを実行してみてください。

1. Chromeでスクラッチを開きます。

2. 拡張機能を追加ボタンからML2Scratchをクリックします。

3. 下のサンプルプログラムをダウンロードして、ファイルを読み込めばすぐに遊ぶことができます。

※ML2ScratchをPoseNetより先に起動させなければカメラが起動しません。

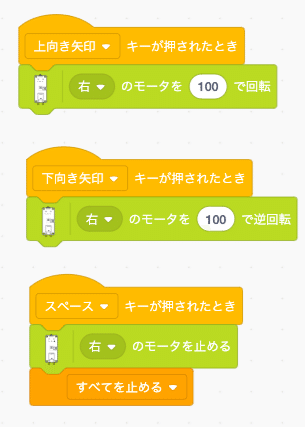

パソコンのキーボードで動かせるプログラムと...

手で動かすプログラムがあります。

手で動かすプログラムは緑色のフラッグを押すとスタートします。

赤い八角形のボタンを押すと終了します。

キーボードのプログラムは割り込みといって、キーボードのボタンが押された瞬間のみ実行されます。

遊んで慣れてきたらプログラムの数字を変えてみて動きがどう変わるのか試してみるのも面白いので是非やってみてください。

動かしてみよう!

Scratchの画面に自分が映っていることを確認したら、ポーズをとってみましょう!

サンプルプログラムでは手を上の枠に合わせると前進、真ん中で停止、下で後進します。

以上、機械学習を使ってミニ四駆をジェスチャー操作する方法でした!

みなさんも是非遊んでみてください!

この記事が気に入ったらサポートをしてみませんか?