スガにもできるパーフェクトシンク

はいぬっかさんの記事を読んで、私のモデルも微妙な表情まで拾ってくれるようになるかもしれない、と躍り上がったスガ。

しかしまあ、一筋縄でいかないのは〈モノガタリのキフクの常〉というものでして。あっ、でもハッピーエンドだから安心して読んでください。

これからパーフェクトシンクに挑戦する方々への覚え書きです。

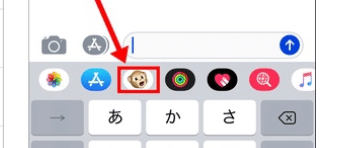

アニ文字がない!

いきなりひっかかりました。

まずはどんな感じで動くのかナー、と気楽にミー文字やアニ文字を試そうとしたら……。

ミー文字はあるけど、動かない!

そもそもアニ文字(うごくミー文字)を出すアイコンがない!

存在するのは「動かないミー文字(ステッカー)」を作るアイコンだけ。

私の iPadmini は 5G(5th Generation)。iOS も最新にしてるし、cpu も対応してる。なのに、ない。

はいぬっかさんに泣きついていろいろ頑張ったけど、出現せず、最終的にはこうやって確かめることになりました。

お手数ですが、

— はいぬっか (@hinzka) May 17, 2021

こちらのFaceCapというアプリをインストールしていただいて、顔のモデルが動くかみていただけますか?https://t.co/qdyFBgaPjD

こちらはフリーソフトなので、ともかく動作確認、という時には試しやすい。有料ソフト入れて動かなかったら目も当てられませんから。

で、インストールして起動すると、坊主頭の男が出現。

こわごわ笑顔を作ってみると、黒い歯茎を見せて男が、ニマーーリ、と笑った。

びっくりした。

ようするに、動いてる。

アニ文字は使えないが、機能的には対応してる、という証拠でした。

とりあえず無料系だけで試してみる

しっかり出端をくじかれちゃったので、できるできる大丈夫、と黒歯茎の坊主がいくらニマニマしようとも、不信感がやたらと大きくなっちゃって、素直に王道の組み合わせにお金を払おうという勇気がミジンコ並に小さくなってしまいました。

基本、新しいことをするのだったら、みんなが使っている、つまりはデファクトスタンダード的なものを導入するのが正しいルートです。

みんなが、ということは、参考記事も多いし、質問もしやすい。

しかし私はお財布がひもじいと訴えるので、あえて王様の道ではなく庶民の裏路地を選んで通ることも少なくありません。

裏路地はたいていマニアックで、「おめー、こんなとこへ足を踏み入れるってこたぁ、ちっとはワカッテルんだよな?」的記事で初心者にはちんぷんかんぷんのことも多く、お財布が満腹の人にはけっしてお勧めしません。

あと、実際はやらないまでも関連記事はできる限り読んでおくのが私のスタイルです。

・周辺情報を得ておくと、うまくいかなかったときの原因をつきとめやすい

・あれこれ比較でき、後からソフトを最善のものに乗り替えることもできる

VSeeFace(無料)はwaidayo(無料)と組み合わせればパーフェクトシンクが動くとのこと。

iPad miniに入れたwaidayoで表情を読み取り、それをPCに送ってVSeeFaceのモデルに反映するという仕組み。

はいぬっかさんが用意してくださっているパーフェクトシンク対応済みモデルは、気抜けするほどあっさり動きました。

パーフェクトシンク、ここまでできました!

— 菅 浩江 noteで小説作法とオタ界隈の話書いてます (@Hiroe_Suga) May 21, 2021

今度はモデル触る!@emifuwa @hinzka pic.twitter.com/CiinCDgbpi

やっぱりできるんじゃん、私のiPad mini!

ただし、注意点はwaidayoのほうからは「表情だけ」送らないといけない。からだの動きも一緒に送っちゃう設定ではleapmotionと共存できません。いやあ、焦った、焦った。

よし。動くと判ったら、次は自作モデルのパーフェクトシンク化だ!

HANAはどっちを買えばいいの?

そもそもパーフェクトシンクの仕組みってぇのは、VRMモデルは元のメッシュ構造(ワイヤーフレーム)が同じなので、それをiOSのつよつよ表情読みデータで動かしちゃおう、ということ……らしい。間違ってたらごめん。

最初に、VRMモデルに、iOSで使っているBlendShape(メッシュを変化させて表情を作るもの)を組み込む。

そんでもって、それをアニメートするキー(たぶん)BlendShapeClipなるもので名付けを行う。

そしたら、iOSのつよつよ表情読みのデータでVRMの顔が動かせる……らしい。間違ってたらごめん。

ここまでのことを一気にやってくれるツールがHANAという安価なソフトです。

HANAが出るまでは、BlenderやUnityを行ったり来たりしていたらしいので、ツール開発者というのは本当に神様だなあと思います。

ところが、HANAには二種類あった。

unity(ゲームエンジン)上で使う「HANA_Tool_v2」と、単体で動くツール「HANA_APP」。

私の七転八倒の経緯はすっ飛ばすとして、まとめるとこういうことになると思います。

私、unityの操作がまだよく判ってないので、アプリ版のほうを入れました。

パーフェクトシンク化はいたって簡単で、ぽちぽちっとクリックするだけ。

調整は iFacialMocap と連動させてリアルタイムで。(このとき、無料のwaidayoとリンクさせようとして「それはできない」と判るまでじたばたしてましたが)。

パーフェクトシンク化における問題が発覚したのは、他の作業をしたあとなのですが、先に書いておきます。

アプリ版は、リアルタイムで調整ができますが、その値を書き出したり次回まで記憶しておいたりはしてくれません。

設定を他のVRMにコピーすることもできません。

一体を、便利に細かく設定しようとするならアプリ版。

同一モデルのお着替えなどで表情設定のコピーをしたいならツール版。

というのが、2021/06/01現在のFA(ファイナルアンサー)のようです。

私は同じアバターを着替えさせて使うので、結局ツール版も買いました。

3tene というモデルを動かすほうのソフトの、pro V2 という有料バージョンには、FaceForge というおまけがついていて、それはもういとも簡単に2体間の表情コピーができるそうですよ。

3tene pro V2 を買った人はお得ですねー。

unityを使うのに敷居がそんなに高くない人や、他にも表情周りのいろいろな設定をいじり倒したい人、リアルタイム調整にさほど執着がない人、は、最初からツール版だけで大丈夫です!

これが精一杯の笑顔なの?

連日連夜、はいぬっかさんに迷惑をかけ続けるスガ。

おおお、じゃない。判ってることでした。すみません。iFacialMocap入れました。連携させるとスライダー効きません。waidayo【単体】のときでも千駄ヶ谷ちゃんがうまく笑えませんでしたから、どっかおかしい。連携切ってるとfunの表情はちゃんと出ます。

— 菅 浩江 noteで小説作法とオタ界隈の話書いてます (@Hiroe_Suga) May 21, 2021

今、ご都合悪かったら言ってくださいね。 pic.twitter.com/DCZUyLhnVQ

笑ってくれない千駄ヶ谷ちゃん。 pic.twitter.com/TQJ9fvuszK

— 菅 浩江 noteで小説作法とオタ界隈の話書いてます (@Hiroe_Suga) May 21, 2021

パーフェクトシンクで編集が必要なのは黄色のエリアだけです pic.twitter.com/hvS6FgFBHh

— はいぬっか (@hinzka) May 21, 2021

はい、こんなことも判ってなかったわけです。ほんと、ご迷惑をおかけしました。

パーフェクトシンクそのものの仕組みを勉強しないまま、はいぬっかさんの記事に頼って結果だけ得ようとしているのが丸わかりでハズカシイです。

けれどっ! 「こんなことすら判ってない」状態の人間が、私一人だとは思えないので、あからさまに書いておきますですよ……。

おそらく、パーフェクトシンクを使おうとした段階で、Clipsの上部、Extraまでのデフォルト表情は必要なくなっちゃうんでしょうね。

目瞬きや口の動きはこのデフォルト設定を参照するようですが(ブレンドシェイプ、というくらいなので、あちこちブレンドされる)、感情表現はもうパーフェクトシンクが顔のパーツの形状を拾ってくれるから、定形でセットされた表情は必要ない。

そんな感じじゃないでしょうか。

パーフェクトシンクを導入するまでは、これら「笑い」「びっくり」などの定形セット5種類から一番近い表情をとっかえひっかえしてたわけですから、典型的な表情の出現に慣れちゃってたみたいですね。

下の絵のように笑ってほしいなら、デフォルト部分の「目閉じ」を笑い目の閉じ方にして、笑うときには目をつぶるしかないようです。

お着替えさせるぞ!

授業をやっているのは、おしゃれなお嬢様が多い女子大。だから毎週お着替えしないと。

……。

というのは言い訳で、実は私が楽しいから。

ネットサーフィンでお洋服探している時なんか、さながらウィンドウショッピング気分だしね。

VroidStudio は、かんたんにお洋服が替えられます。

既存のワイヤーフレーム(ワンピース、とか、ペンシルスカート、とか)を呼び出して、あとはテクスチャと呼ばれる展開図のようなものを読み込んでやればいい。

お洋服は Booth+ のVroid のところで探せば、第三者利用可能のものが有料無料ともにたくさん見つかります。

テクスチャ自体はpng画像なので、利用規約がOKだったら色替えや模様付けもできます。(前回写真参照)

この前は、スカートが短すぎたので、ワイヤーフレームである原型を取り替え、テクスチャを長く伸ばしました。

問題は、パーフェクトシンクをどう引き継ぐか。

VroidStudioでは、拡張子vrmの完成アバターは編集できません。著作権の問題だと思います。普通にsaveした拡張子vroidは編集可能。

要は、毎回パーフェクトシンクをほどこしてやらないといけないということです。

初期はBlenderやUnityが必須で、かなり煩雑な手間がかかったようです。

が!

ありがたいねえ、今は簡単なんですよー。

ざっくりした手順は、以下の動画をご覧ください。

Unity超初心者だったので、アセット(プラグイン的なもの)を読むこむまでがおそるおそるでしたが、環境を整えてしまえば、ほんと、あっけないくらい簡単。

ついにOBSに手を出す

Hitogataには背景合成機能があって、授業や説明で使うPowerPointスライドをバックに喋っていました。

それを AG-デスクトップレコーダーでキャプチャしていたわけです。

vrmモデルを動かす方のソフトで、まず悩んだ。

VSeeFaceのままでもよかったんですが、どうもLeapMotionの挙動がアヤシイ時がある。そもそも他の有料ソフトを入れていないので、これが最適解かどうかの比較もできない。

ここはひとつ、路頭に迷うことになっても王の進む道を……。と、3tene(パーフェクトシンクは有料の PRO V2から対応)、Luppet の2者で悩み倒す。

3teneは全身キャプチャへ発展できるみたいだけど、結局、動きが柔らかく手が綺麗に動くLuppetに決定。キャラがTdaミクさんっぽい顔だったのも勝因。見慣れてる顔って強いね。

ちなみに私、最初はLuppet(ラペット)を勝手に「ルパート」って読んでました。

うん?Rはどこ?と気が付いたのは、はいぬっかさんにルパートルパートと連呼したあとでした。とほほほ。

Luppetには、PowerPointのように変化する背景を投影したり録画したりする機能はないので、なんらかの形で合成が必要です。

ここは安全策を取って、デファクトスタンダードの王者OBS。Open Broadcaster Software とのことで、配信が有名ですが、録画もできます。

以前から興味はあって、操作法などは前もって調べていました。

なので、トリミングやソースの読み込み、クロマキーなどはすんなりクリア。音声ゲージを見ながら喋れるので、マイク音量も安心。

やっと、動画を作りあげるところまで環境が整いました!

モデル修整するところから録画までの解説は、こちらをごらんください。(ニコ動のリンクが貼ってありますが、youtubeでも見られます。youtube版はミスを告白したテロップがありません)

個人的まとめ

思えば遠くへ来たもんだ。

ソフトやツールを開発してくださった方々、テクスチャを無料配付してくださっている方々、ほんとうにありがとうございます。

お蔭で私なんかでも楽しく便利に遊ばせていただけています。

私が引っかかったところをまとめておきますね。

・VRoidStudioで作った髪は、よくねじれて表示される。

・HANAにはUnityのツール版と、単体起動のアプリ版がある。

・HANA_APPは表情の書き出しや記憶ができない。

・アニ文字ができなくても、cpuやカメラが対応していたら大丈夫。

・IPアドレスを飛ばして表情を読み込むソフトでも、受け側が規定したものでないとダメ。例えばVSeeFaceはwaidayoとしか連携できず、LuppetはiFacialMocapとしか連携しない(たぶん)。

・waidayoは身体の動きも送れるが、切っておいて表情だけ送信しないとLeapMotionが反応しなくなる。

・パーフェクトシンクはもともとデフォルトの表情とは別物(まばたきなどはブレンドでデフォルトも利用しているっぽい)。

・眉が下がりすぎるときは鼻をしかめる表情で調整。意外すぎ。

・iFacialMocapのほうでも表情ウェイトの設定ができる。

・LeapMotionの感知範囲は案外狭い(ネックマウントの場合)。角度によっては手首がねじれがち(掌の裏表を間違えるっぽい)。

・OBSでソースをトリミングするのはALT+マウス動作。ちょっと珍しいので自力では気が付きにくい。

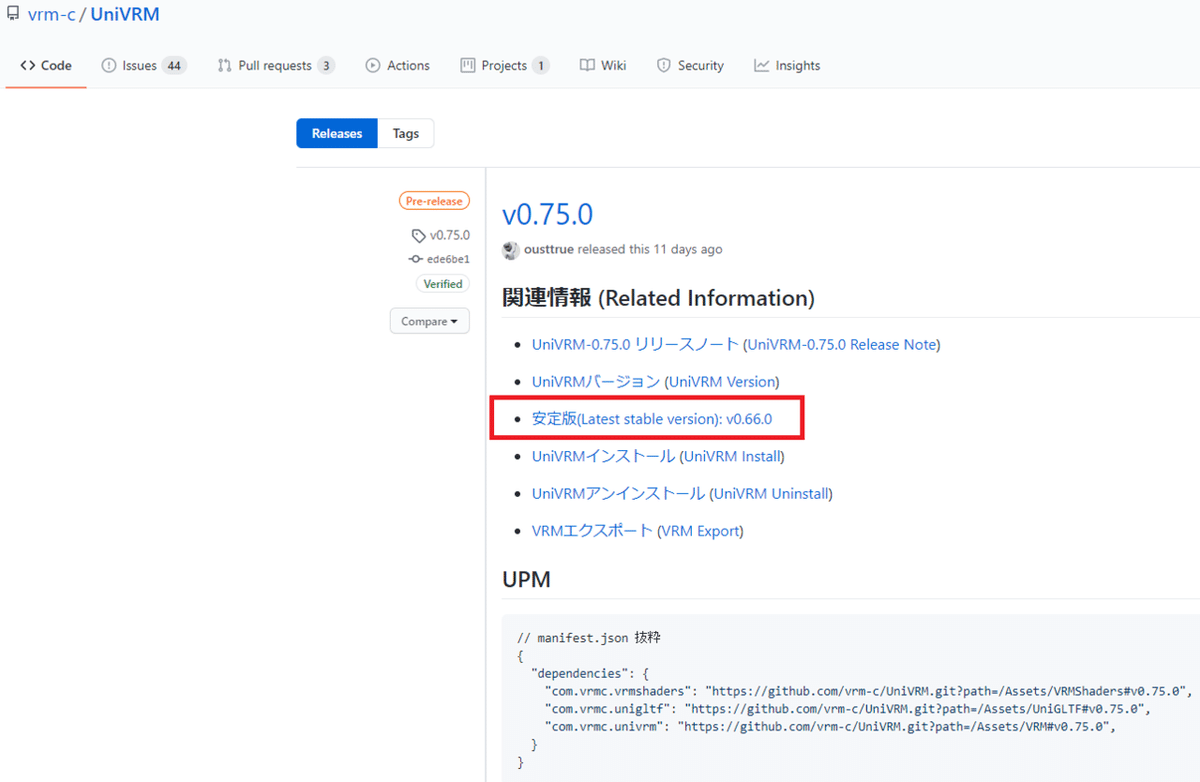

・UniVRMのダウンロード場所が判りにくい!!!

▼安定版をクリック → 安定版リリースページのうーんと下のほう。

途中でコードが出てきたりするけど、

「しまった。ここから先は専門領域だ! 総員撤退!」

と早合点して引き返したりしないこと(自戒)。

いかがでしたでしょうか(おずおず)。

ちょっとMMDをやってる程度のまーーったくの初心者が頑張りましたでござる。少しでもこの七転八倒がお役に立てば、いやいや、役に立たなくてもご笑覧いただければ幸いです。

最後になりましたが、はいぬっかさんにもう一度お礼を申し上げます。

このかたの記事がなければ何もできないところでしたし、iPadminiでもできるはずと教えてくださらなければ諦めていました。

本当にありがとうございました。

いいなと思ったら応援しよう!