「Hallo2」とは?特徴とセットアップを紹介!【無料で高品質リップシンク】

Hallo2の概要

Hallo2は、入力された音声と人物画像を同期させるオープンソースプロジェクトです。

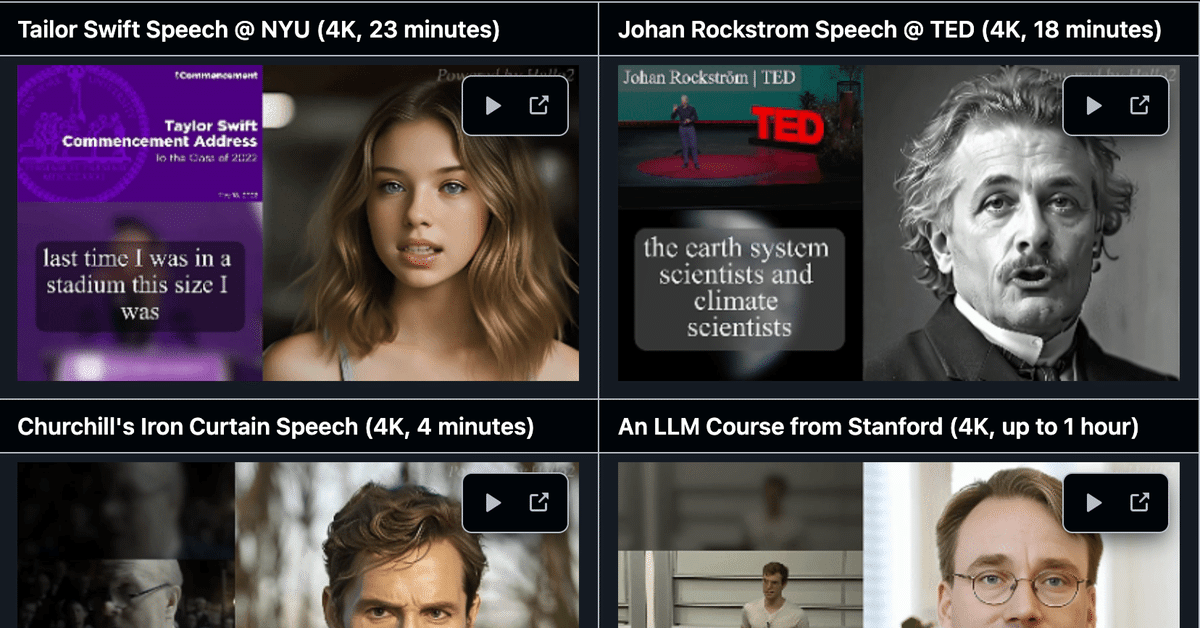

実際のアウトプットは、以下のイメージです。

We are thrilled to announce the open-source release of Hallo2: a new avatar video generative model capable of generating stunning 4K resolution videos for up to 1 hour! 🎥✨

— Siyu ZHU (@JoeSiyuZhu) October 16, 2024

Explore the project for the open source code: https://t.co/VLKG809rIG

Let's push the boundaries of avatar… pic.twitter.com/MFeOP74M43

Hallo2の強みは、大まかに以下の3つになると思います。

- 数時間のアニメーションが生成可能

- 高度な同期技術

- 解像度が4K

これらの強みを実現するために以下のような実装をしていると記載されています。

第一に、長時間の動画を生成するために手法を拡張する。外見ドリフトや時間的アーチファクトのような実質的な課題に対処するため、条件付き動きフレームの画像空間内での補強戦略を研究する。具体的には、長時間の視覚的一貫性と時間的一貫性を高めるために、ガウシアンノイズで補強したパッチドロップ技術を導入する。第二に、4K解像度のポートレート映像生成を実現する。これを達成するために、潜在符号のベクトル量子化を実装し、時間的整列技術を適用することで、時間次元にわたるコヒーレンスを維持する。高品質のデコーダを統合することで、4K解像度での視覚合成を実現する。第三に、肖像表現のための調整可能な意味的テキストラベルを条件入力として組み込む。これは従来の音声キューを超えるもので、制御性を向上させ、生成されるコンテンツの多様性を増加させる。我々の知る限り、本稿で提案するHallo2は、4K解像度を達成し、テキストによるプロンプトで強化された1時間の音声駆動型肖像画像アニメーションを生成する最初の手法である。我々は、HDTF、CelebV、および我々が導入した 「Wild 」データセットを含む、一般に利用可能なデータセットを用いて、本手法を評価するために広範な実験を行った。実験結果は、我々のアプローチが、長時間のポートレートビデオアニメーションにおいて最先端の性能を達成し、4K解像度で数十分に及ぶリッチで制御可能なコンテンツの生成に成功したことを示している。

DeepL直張りのため、原文興味ある方は以下のリンクから!

Hallo2のセットアップ

公式のREADMEから抜粋ですが、実行までのコマンドを紹介したいと思います。

公式ではLinux環境前提のため、それ以外の方は以下の記事が参考になるかと思います!

Google Colab

Docker

Clone & Conda環境の作成

conda環境での実行が公式では推奨されています。

git clone https://github.com/fudan-generative-vision/hallo2.git

conda create -n hallo python=3.10

conda activate hallopytorchとその他pkgのインストール

pip install torch==2.2.2 torchvision==0.17.2 torchaudio==2.2.2 --index-url https://download.pytorch.org/whl/cu118

pip install -r requirements.txtffmpegのインストール

# linux環境の場合

apt-get install ffmpeg事前学習モデルをダウンロード

git lfs install

git clone https://huggingface.co/fudan-generative-ai/hallo2 pretrained_modelsinterfaceの立ち上げ

python scripts/inference_long.py --config ./configs/inference/long.yamlconfigファイルからsource_image, driving_audio, save_pathなどのパラメーターをいじれるみたい。

参考

この記事が気に入ったらサポートをしてみませんか?