Stable Diffusionで実在しない日本の風景を作ってもらう #1

とは言いましたが#2以降が続くかどうかは完全に未定

まえがき

普段はTwitterでとりんさまに変な文字列を投げつけたり (TwitterAPIの仕様変更に伴ってとりんさまAIのBOTおえかきは2/12に停止)

絵でやっていくことにしたからしちゃんにミトコンドリアを描いてもらったりしているんですが、それはそれとして

Stable Diffusion

具体的には

GitHub - AUTOMATIC1111/stable-diffusion-webui: Stable Diffusion web UI

https://github.com/AUTOMATIC1111/stable-diffusion-webui

をローカルに導入して実在しない日本の風景を生成しています。

まだプロンプトはほとんど練っていない(最低限の写実的にする呪文を入れているぐらい)んですがなんかこう……動画の背景素材を横着できないかなって…………

そんな感じの備忘録的なあのあれです。

1.とりあえずやってみるか

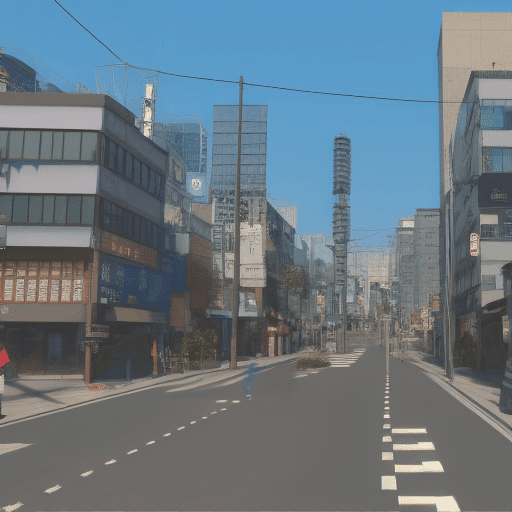

{japanese city},Google Street View,street,highly detailed, hyperrealistic, illustration, Unreal Engine 5,8K

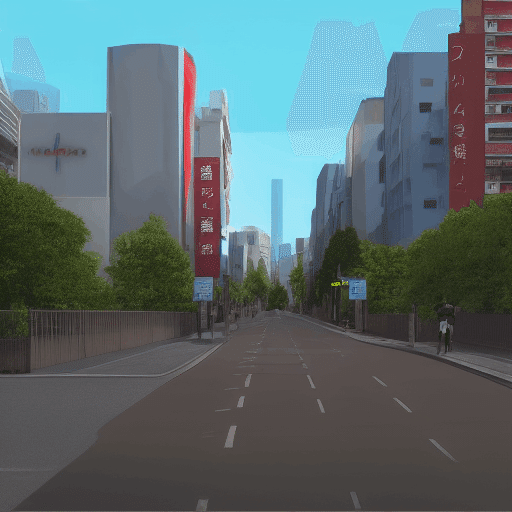

「色指定ノイズ法」(着色したノイズ画像をimg to imgのタネにする手法)が環境光のかわりにならんかなと思ってためしてみました

https://twitter.com/optical_gray/status/1625983308244086790

タネ画像はこんな感じ。ノイズにグラデーションマップで着色

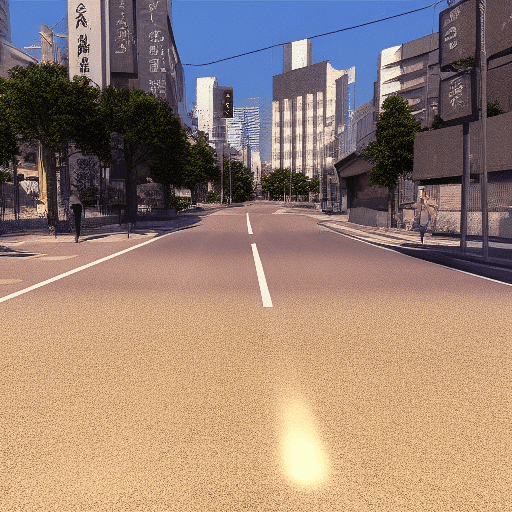

プロンプトは同じでタネ画像+img to img

なんとなく写真というよりイラストっぽい色味 これはこれでいいとおもいます。

「japanese city」で「日本の都市」を指定しているつもりなんですが「japanese」に引っ張られているのか障子のような格子扉が出てくることがたまにありますね。市街地の路地とかを出したかったら具体的な都市の地名(「tokyo」とか)のほうがいいのかも

2.プロンプトで時間帯を指定(twilight)

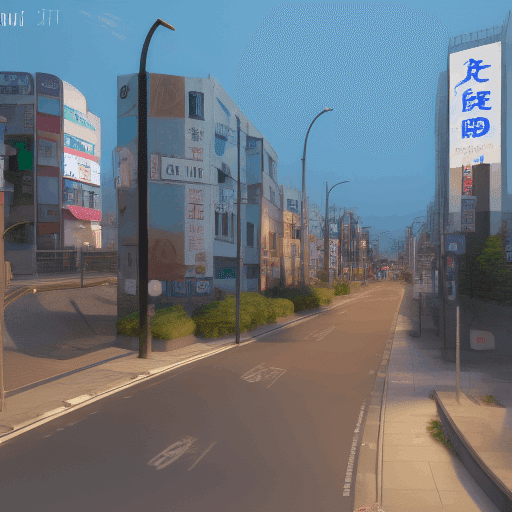

{japanese city},twilight,Google Street View,street,highly detailed, hyperrealistic, illustration, Unreal Engine 5,8K

架空文字が出てブチ上がっている図

txt to imgではより写実的な夕暮れ時の風景が出ます。日没前後のマジックアワーっぽい

そしてここにタネ画像をひとつまみimg to img。夕暮れっぽさ(明かりがついて建物の窓が光っている)も出しつつタネ画像の色味を反映しています。

燃えてね?

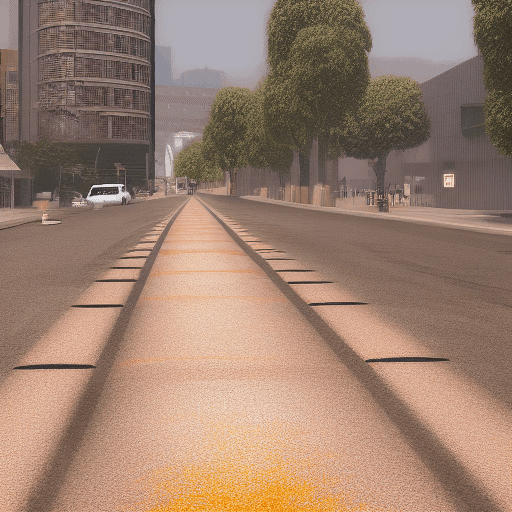

3.生成された画像から切り出した空の一部をタネ画像に

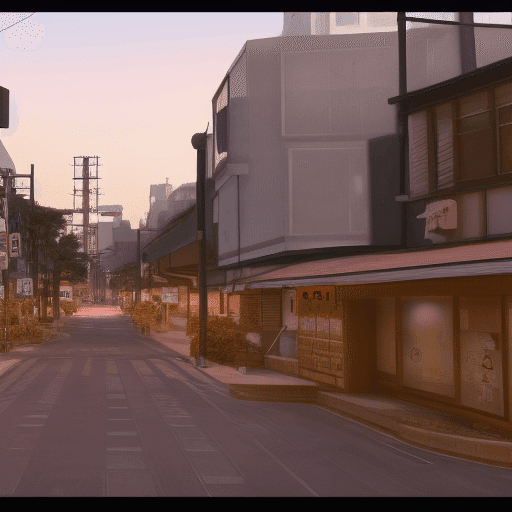

{japanese city},Google Street View,street,highly detailed, hyperrealistic, illustration, Unreal Engine 5,8K

空の一部

悪くはないんですがタネ画像が淡い色味でローコントラストだったので、どちらかといえば背景素材向きの結果が出た。昔のパワポにこういうテンプレートなかったっけ……

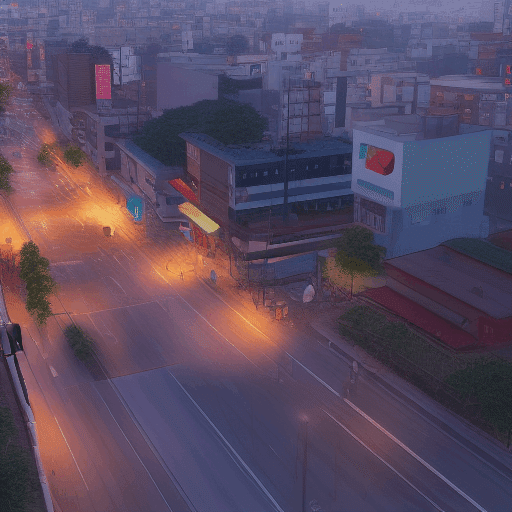

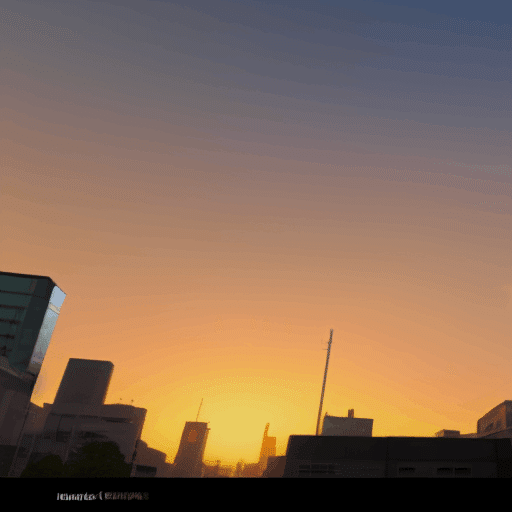

4.自分で撮影した空の写真をタネ画像に

画像下部のシルエット(おそらく木)に引っ張られすぎた

Photoshopでざっくりと加工してノイズっぽくしたものをタネ画像にしたらこれがなかなかいい感じだったのでいっぱい画像を出した。

まとめ

・色指定ノイズ法・抽象的な色のついた画像から生成する手法に可能性を感じている

・人が写り込んだときはimg2imgでinpaintするとよい

・キャラクターイラスト生成はものすごい先駆者がいっぱいいるのでそちらを参照してください

いいなと思ったら応援しよう!