PyTorch - Training a Classifier

ここでは画像を使って分類の仕組みを見ていきます。

torchvision

を使います。

For this tutorial, we will use the CIFAR10 dataset. It has the classes: ‘airplane’, ‘automobile’, ‘bird’, ‘cat’, ‘deer’, ‘dog’, ‘frog’, ‘horse’, ‘ship’, ‘truck’. The images in CIFAR-10 are of size 3x32x32, i.e. 3-channel color images of 32x32 pixels in size.

torchvisionのCIFAR10 データセットを使用します。中身については ‘飛行機’, ‘自動車’, ‘鳥’, ‘猫’, ‘鹿’, ‘犬’, ‘蛙’, ‘馬’, ‘船’, ‘トラック’ があります。CIFAR-10 の画像はサイズ 3x32x32です。例えばサイズが 32×32 ピクセルの 3-チャネル・カラー画像です。

順番にやっていきます。

1. torchvisionを使用してCIFAR10トレーニングおよびテストデータセットを読み込み、正規化する

2. たたみ込みニューラルネットワークの定義

3. 損失関数を定義する

4. トレーニングデータでネットワークをトレーニングする

5. テストデータでネットワークをテストする

まず最初に

Loading and normalizing CIFAR10 1. torchvisionを使用してCIFAR10トレーニングおよびテストデータセットを読み込み、正規化する

torchvisionを使用してCIFAR10トレーニングおよびテストデータセットを読み込み、正規化していきます。

torchvision データセットの出力は範囲 [0, 1] の PILImage 画像です。それらを正規化された範囲 [-1, 1] の Tensor に変換します。

transform = transforms.Compose(

[transforms.ToTensor(),

transforms.Normalize((0.5, 0.5, 0.5), (0.5, 0.5, 0.5))])

trainset = torchvision.datasets.CIFAR10(root='./data', train=True,

download=True, transform=transform)

trainloader = torch.utils.data.DataLoader(trainset, batch_size=4,

shuffle=True, num_workers=2)

testset = torchvision.datasets.CIFAR10(root='./data', train=False,

download=True, transform=transform)

testloader = torch.utils.data.DataLoader(testset, batch_size=4,

shuffle=False, num_workers=2)

classes = ('plane', 'car', 'bird', 'cat',

'deer', 'dog', 'frog', 'horse', 'ship', 'truck')transforms.Normalize((0.5, 0.5, 0.5), (0.5, 0.5, 0.5)は,引数の一つ目のタプルが RGBの各チャンネルの平均を表し,二つ目のタプルが標準偏差を表します.これらの平均と標準偏差にあわせて正規化します.

画像を読み込み"transforms.Normalize"で正規化、使えるようにしています。

ここでトレーニングの画像を表示させてみましょう。

import matplotlib.pyplot as plt

import numpy as np

def imshow(img):

img = img / 2 + 0.5 # unnormalize

npimg = img.numpy()

plt.imshow(np.transpose(npimg, (1, 2, 0)))

plt.show()

dataiter = iter(trainloader)

images, labels = dataiter.next()

imshow(torchvision.utils.make_grid(images))

print(' '.join('%5s' % classes[labels[j]] for j in range(4)))

と出ました。

次に2番目です

2. Define a Convolutional Neural Network2. たたみ込みニューラルネットワークの定義

class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

self.conv1 = nn.Conv2d(3, 6, 5)

self.pool = nn.MaxPool2d(2, 2)

self.conv2 = nn.Conv2d(6, 16, 5)

self.fc1 = nn.Linear(16 * 5 * 5, 120)

self.fc2 = nn.Linear(120, 84)

self.fc3 = nn.Linear(84, 10)

def forward(self, x):

x = self.pool(F.relu(self.conv1(x)))

x = self.pool(F.relu(self.conv2(x)))

x = x.view(-1, 16 * 5 * 5)

x = F.relu(self.fc1(x))

x = F.relu(self.fc2(x))

x = self.fc3(x)

return x

net = Net()self.conv1 = nn.Conv2d(3, 6, 5)

3-channel 画像 が入力できるネットワークになっています。

次です。

3. Define a Loss function and optimizer 3. 損失関数を定義する

import torch.optim as optim

criterion = nn.CrossEntropyLoss()

optimizer = optim.SGD(net.parameters(), lr=0.001, momentum=0.9)損失関数はCrossEntropyLoss()を使って、momentum SGDを optimizerとします。

次に

4. Train the network 4. トレーニングデータでネットワークをトレーニングする

for epoch in range(2): # loop over the dataset multiple times

running_loss = 0.0

for i, data in enumerate(trainloader, 0):

# get the inputs; data is a list of [inputs, labels]

inputs, labels = data

# zero the parameter gradients

optimizer.zero_grad()

# forward + backward + optimize

outputs = net(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

# print statistics

running_loss += loss.item()

if i % 2000 == 1999: # print every 2000 mini-batches

print('[%d, %5d] loss: %.3f' %

(epoch + 1, i + 1, running_loss / 2000))

running_loss = 0.0

print('Finished Training')[1, 2000] loss: 2.166

[1, 4000] loss: 1.844

[1, 6000] loss: 1.685

[1, 8000] loss: 1.588

[1, 10000] loss: 1.529

[1, 12000] loss: 1.467

[2, 2000] loss: 1.400

[2, 4000] loss: 1.358

[2, 6000] loss: 1.340

[2, 8000] loss: 1.316

[2, 10000] loss: 1.303

[2, 12000] loss: 1.256

Finished Training

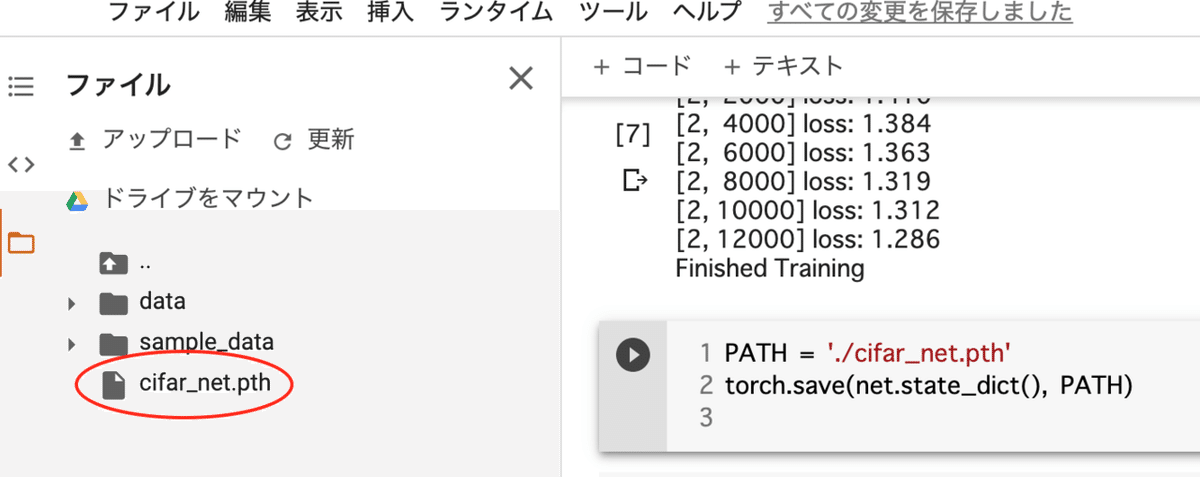

実行した後には、保存しておきます。

PATH = './cifar_net.pth'

torch.save(net.state_dict(), PATH)

保存されていることが確認できます。

次に、

5. Test the network on the test data 5. テストデータでネットワークをテストする

まず、テストセットから画像を表示してみます。

dataiter = iter(testloader)

images, labels = dataiter.next()

# print images

imshow(torchvision.utils.make_grid(images))

print('GroundTruth: ', ' '.join('%5s' % classes[labels[j]] for j in range(4)))

ここで保存してあったモデルを呼び戻しましょう。

net = Net()

net.load_state_dict(torch.load(PATH))サンプルimagesほネットワークに入れたらどんなものが出力されているかをみてみます。

outputs = net(images)outputsの画像を確認して10個のクラス

classes = ('plane', 'car', 'bird', 'cat',

'deer', 'dog', 'frog', 'horse', 'ship', 'truck')

からしているものの中から確率が高いものを選び出します。

_, predicted = torch.max(outputs, 1)

print('Predicted: ', ' '.join('%5s' % classes[predicted[j]]

for j in range(4)))

Out:

Predicted: cat car car plane

と出ました。cat とplaneは正解のようですが次のコードでテストデータセット全てに適用します。

correct = 0

total = 0

with torch.no_grad():

for data in testloader:

images, labels = data

outputs = net(images)

_, predicted = torch.max(outputs.data, 1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

print('Accuracy of the network on the 10000 test images: %d %%' % (

100 * correct / total))Out:

Accuracy of the network on the 10000 test images: 59 %

と出ました。さらにcat とplaneなどクラスごとの精度をみてみます。

class_correct = list(0. for i in range(10))

class_total = list(0. for i in range(10))

with torch.no_grad():

for data in testloader:

images, labels = data

outputs = net(images)

_, predicted = torch.max(outputs, 1)

c = (predicted == labels).squeeze()

for i in range(4):

label = labels[i]

class_correct[label] += c[i].item()

class_total[label] += 1

for i in range(10):

print('Accuracy of %5s : %2d %%' % (

classes[i], 100 * class_correct[i] / class_total[i]))Out:

Accuracy of plane : 52 %

Accuracy of car : 80 %

Accuracy of bird : 40 %

Accuracy of cat : 31 %

Accuracy of deer : 51 %

Accuracy of dog : 58 %

Accuracy of frog : 78 %

Accuracy of horse : 73 %

Accuracy of ship : 73 %

Accuracy of truck : 59 %

carがAccuracy of car : 80 %と一番高く、cat がAccuracy of cat : 31 %と一番低いと出ました。