ヒトとコンピューター2(エクリから)

前回に引き続きEKRITS<エクリ>に掲載中である水野勝仁氏による「インターフェースを読む」という連載を元に、そのモデルスケッチの清書と自身の考察を書いていきたいと思う。

今回は、第2回の「スケッチパッドで「合生」される世界」の記事である。

この考察シリーズを勝手に始めるに当たって自分の中で目的と目標ある。

まず目的としては、この「インタフェースを読む」シリーズを通して、ヒトとコンピューターのインタラクションの歴史と発展をしっかりと理解を深めて形式知として記録することがある。Human-Computer Interactionの分野は、Information Design、Typography、Systems Designに加えデザインを学び初めてから継続的に興味が絶えない範囲だった。水野氏の連載は、自分のこの分野に関する知識と理解を一気に深めてくれる貴重な情報である。

そして目標については、5回の連載を通して作るモデルを記事内容と正確にマッチさせて1つの連続したマップとして繋げることにある。これにはフォーマット、Typography、Visual Languageを丁寧に統一していく必要がある。どこまでシステマティックに統一できるかは、面白い挑戦だと思う。

とりあえず前回の終わりのスライドから始めたい。

コンピュータのもつ二つの手

前回の記事の終わりは、コンピューターが「最小化されたヒトの行為」という手と「アルゴリズム」という手をもつというポイントで締めくくっている。人は、コンピューターと出会い、オートメーションを可能にするアルゴリズムの起点としてそのプロセスの中に合成されていった。

最小化した手と行為する手

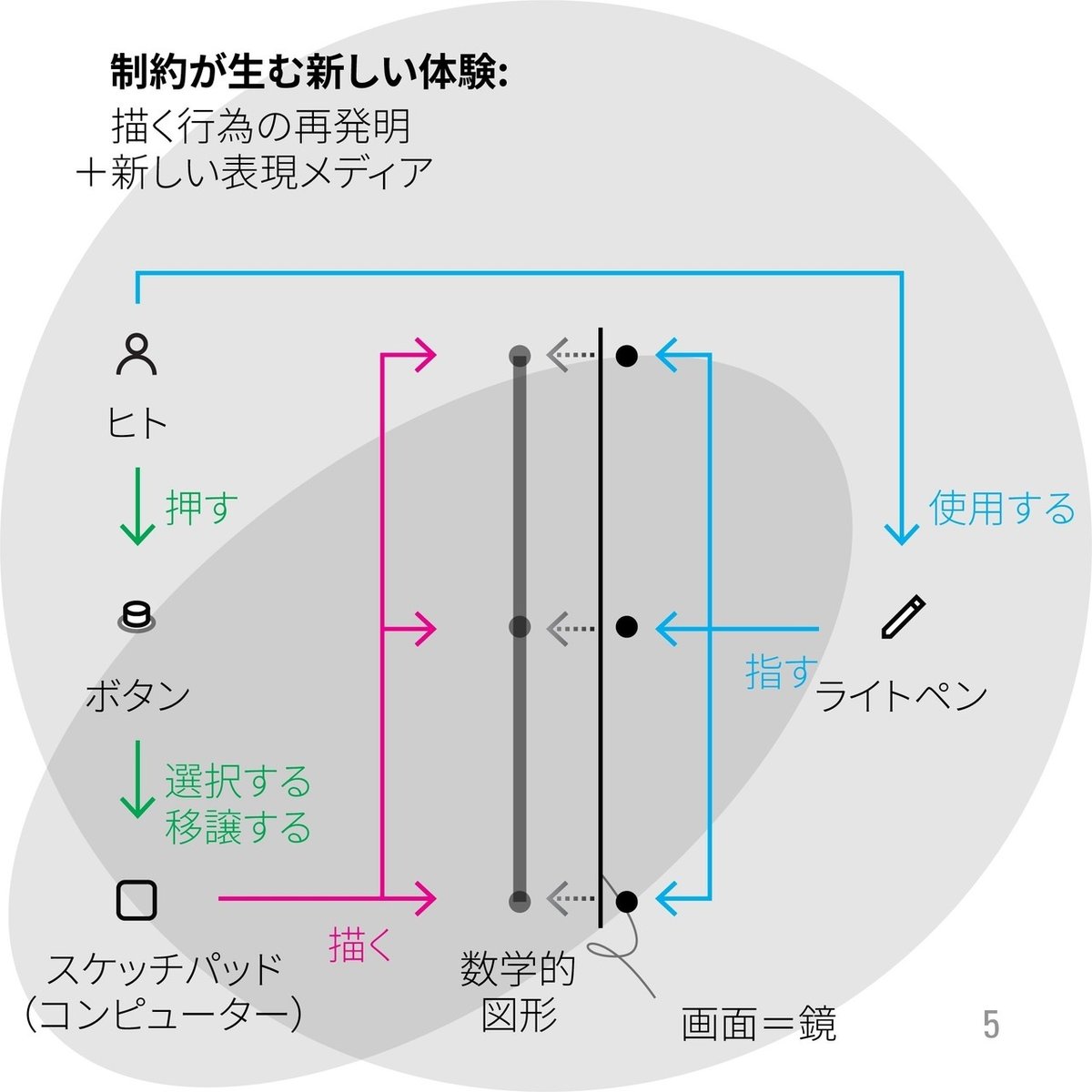

第2回目の連載の主要となるコンピューターは、1963年にイヴァン・サザランドによって発表されたスケッチパッドであった。このスケッチパッドでは、人はコンピューターにどの操作をする移譲するのかという選択をボタンを押すという最小化された手をを通して決定し、現実世界で慣れ親しんだ描くという行為を実行する手をライトペンと呼ばれるデバイスで実現している。

ヒトとコンピューターとがコミュニケーションをとる点が、1つから2つへと増えていることがこのモデルから見てわかる。

ディズプレイが映し出す数学的世界

ヒトとコンピューターとの間に存在するこの画面「ディスプレイ」の存在は、ヒトが所属する現実世界とコンピューターが映し出す数学的世界とを繋ぐことを可能にした。

この2つの世界のコミュニュケーションを実行するにあたって、「ノイズ」が生じることが問題点として挙げられていた。スケッチパッドにおける「ノイズ」は、ヒトが図形を描くときに生み出す生物特有の不正確さにある。サザランドは、この「ノイズ」を画面を通してコンピューターが調整することで、ヒトとコンピューターとのコミュニュケーションをスムーズにしたと説明してある。このセクションの中で、ノーバート・ウィーナーの「サイバネティクス」というフィードバックに関する1960年代のコンピュータサイエンスの分野の用語が引用されていたがこの辺りは、別の記事でいつか触れられると楽しいかなと思う。

もう一つの手となるアルゴリズム

スケッチパッドを通して図形を「描く」という行為は、それ以前の「描く」という行為におけるヒトの役割を大きく変更している。ヒトは最小化された手を通して、使用可能なコマンドを選択し、行為をする手を通して画面上の点を指し示している。これらのインプットを元にコンピューターのアルゴリズムが、数学的図形を描いている。このアルゴリズムが、スケッチパッドで「描く」という行為の第3の手になっている。

制約が生む新しい体験

こうしてみるとスケッチパッドは、ヒトの行為をボタンを押す・ライトペンで指すという動作に制約した。そして、「描く」という行為はコンピューターに移譲された。これらの制約によってこれまでとは全く異質の「描く」という行為が再発明された。

「描く」行為の再発明により、次にコンピューターの新しい表現メディアとしての認識が確立された。

そして最後に、数字を元素的にな素材として扱うことが可能なコンピューターの特徴をベースに、物理世界における制約からの解放を示唆した。ヒトは、コンピューターの画面を通して、数学的世界のみが映し出す世界を探索し、理解することができる機会を得た。

インターフェースで合成する

本記事のタイトルにもある「合成」には、2つの段階が存在する。1つは、「合成的出来事」である。これは、アルゴリズムとヒトをデバイスを介して繋いで行く行為のことをさす。

そして2つ目は、「合成的行為」である。これは、「合成的出来事」によってヒトとコンピューターが可能にする新しい行為のことを指す。サザランドのスケッチパッドにおいては、再発明された「描く」という行為がこれに該当する。

まとめ

第2回目の記事は、より深くヒトとコンピューターのインタラクションの関係を解説していた。個人的に作ってみたモデルから読み取れるヒトとコンピューターとの関係は、ヒトがコンピューターを「使役する」というよりは、共に「対話をする」という感覚が一番しっくりきている。

GUIの本質は、コンピューターのアルゴリズムが所持するコマンドに、ヒトが任意の変数を加えて、実行してもらうという行為を視覚的に可能にし、効率化するためのインターフェースであるように思える。GUIにおけるヒトとコンピューターの関係は、「使役する側」と「使役する側」というような感覚が正しい気がする。この関係が成り立っているときに人間中心的なUIをデザインする必要性がある。なぜなら、ヒトはコンピューターとの「対話」を必要としないからだ。ヒトは、ヒトが自然に思考するようにUIを操作できることの方が重要であり、そこには別のフィードバックシステムが存在する。

ヒトがコンピューターと「対話する」ためには、「アルゴリズムを書く」という行為が必要なのではないかと思った。Processingやp5などのプロジェクトの価値の根元がこの辺にありそうだ。ヒトの存在を必要としなくなった人工知能との「対話」はどうなるのか。そんなことを思いつつ今回の考察はここまで。

いいなと思ったら応援しよう!