LivePortraitインストールから使い方まで【画像のキャラ表情を動かそう】

AIVtuberシロハナちゃんの開発プロデュースをしているyukiです。

この記事ではLivePortraitという画像に写っている人物やキャラクターの表情を動かすツールのローカル環境構築と使い方について紹介しています。

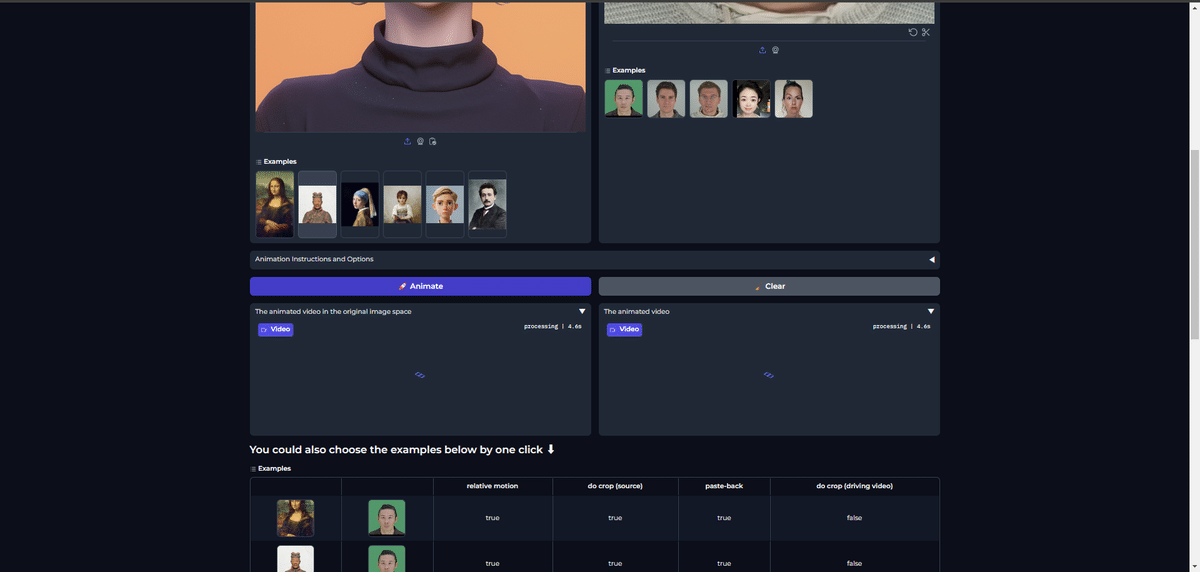

以下のように用意した素材動画と静止画を組み合わせることで人物やキャラの表情を動かすことができるというわけですね。

画像や動画素材によってはかなり自然な表情変化が楽しめるので個人的に結構おすすめです。

ローカル環境でなく簡単に試したい程度であれば以下サイトからお試してみてください。

また、本記事の内容をYouTube動画でも解説しているので興味があれば併せてご覧ください。

※この記事は2024/10/24時点のものなので今後変更があるかもしれないですのでご了承ください

LivePortraitローカル環境構築

ローカル環境にLivePortraitをインストールする手順を残します。

ちなみに今回試した環境は以下の通りです。

【OS】Windows11

【RAM】32GB

【CPU】インテル Core i7-13700H

【GPU】NVIDIA GeForce RTX 4060 Laptop GPU

事前準備

まず、LivePortraitインストール前に必要なツールがあります。

以下に参考リンクを添付するので用意しましょう。

※途中のAdd Miniconda3 to my PATH environment variableというチェックは入れるようにしてください

LivePortraitインストール

上記のGitHubのREADMEを参照してインストールしていきます。

まずはインストールしたいディレクトリにcdで移動しておきましょう。

今回はCドライブ直下ということにします。

cd C:\そして次にgit cloneしてその階層に移動します。

git clone https://github.com/KwaiVGI/LivePortrait

cd LivePortraitそこで仮想環境を作成してアクティブにしておきます。

conda create -n LivePortrait python=3.10

conda activate LivePortraitCUDAもダウンロードします。

# for CUDA 11.8

pip install torch==2.3.0 torchvision==0.18.0 torchaudio==2.3.0 --index-url https://download.pytorch.org/whl/cu118アクティブ化できたらそのまま必要なパッケージを一括でインストールします。※ここは結構時間かかります。

pip install -r requirements.txtこれで次は以下のGoogle Driveにあるフォルダをダウンロードしてpretrained_weights内に入れておく必要があります。

https://drive.google.com/drive/folders/1UtKgzKjFAOmZkhNK-OYT0caJ_w2XAnib

まず上記リンクからinsightfaceとliveportraitというフォルダをダウンロードします。

そしてこれらを解凍してC:\LivePortrait\pretrained_weightsに入れます。

これで準備完了です。

では実際にアプリを立ち上げてみましょう。

C:\LivePortraitに移動して仮想環境アクティブ化します。

cd C:\LivePortrait

conda activate LivePortraitそして立ち上げるコマンド実行します。

python app.pyそしてhttp://127.0.0.1:8890を開くとLivePortraitの画面が開きます。

LivePortraitでキャラ表情を動かしてみる

まずは表情を動かしたいキャラクターや人物を用意しましょう。

今回はにじジャーニーで画像生成をしました。

上記のようにプロンプトとしては、

3Dキャラクターの女の子、顔アップ、正面を向いている、背景は単色としています。

ここで注意なのは顔だと認識されないような画像、例えばイラスト調の画像のようなものだとエラー出てしまいます。以下が例。

なので3Dキャラクターなど、人間の顔に近い形状の画像を用意するのが良いかと思います。

そしてどんな風に表情を動かすかの動画素材も用意します。

今回は元々用意されているものを使いますが、自分の表情などを撮影して動画素材にすることも可能です。

そして最後に🚀Animateボタンを押下すれば処理が始まります。

1分程度待ちます。進捗はターミナル見ると分かりやすいです。

処理が終わると静止画キャラに表情が付いた動画が表示されています。

これで右上のボタンからダウンロードも可能になって完了となります。

こんな感じでとても自然な表情変化を楽しめます!

— yuki@AIヒロイン研究P (@ai_shirohana) July 19, 2024

←画像生成した静止画(素材)

→LivePortraitで表情を動かした動画 pic.twitter.com/YpW8tVjIaN

さいごに

LivePortraitを使ってキャラ画像に表情を付けるという体験はどうだったでしょうか?

とても新鮮で自然なものができるのでとても楽しいですよね。

もちろん素材を変えれば様々なバリエーションで表情を動かすことができるので色々と試してみてください!

最後に私がプロデュースしているAIVtuberシロハナちゃんの宣伝をさせてください。

理想のAIヒロインを目指して、AIを使ったリアルタイム配信や、AIヒロイン研究所というコンセプトのもと、「テクノロジー×キャラクター」に関する動画等を発信しています。

興味がありましたらぜひ!

いいなと思ったら応援しよう!