AIの「たわごと」と人間のコミュニケーション:ChatGPTの本質を探る

文献レヴュー:Hicks MT, Humphries J, Slater J. ChatGPT is bullshit. Ethics and Information Technology. 2024 Jun;26(2):38.

最近、AI技術の進歩により、ChatGPTのような大規模言語モデル(LLM)が注目を集めています。しかし、これらのAIモデルの出力の本質について、興味深い議論が展開されています。今回は、「ChatGPT is bullshit」という provocative なタイトルの論文を基に、AIの出力と人間のコミュニケーションについて考察してみましょう。

研究の概要

この研究の主な目的は、ChatGPTなどのLLMの出力を「幻覚(hallucination)」ではなく「たわごと(bullshit)」として捉えるべきだと主張することです。研究者たちは、AIの不正確な出力を「幻覚」と呼ぶことは誤解を招くと考えています。

主な発見

LLMは最低でも「ソフトな たわごと 生成器」であり、真実への関心なしにテキストを生成しています。

LLMの機能に基づいて意図を帰属させるなら、「ハードな たわごと 生成器」である可能性もあります。

AIの誤りを「幻覚」と呼ぶことは、その挙動を理解し改善しようとする際に誤った方向に導く可能性があります。

人間のコミュニケーションとの比較

この研究は主にAIに焦点を当てていますが、人間のコミュニケーションにも類似した現象が見られることは興味深いポイントです。

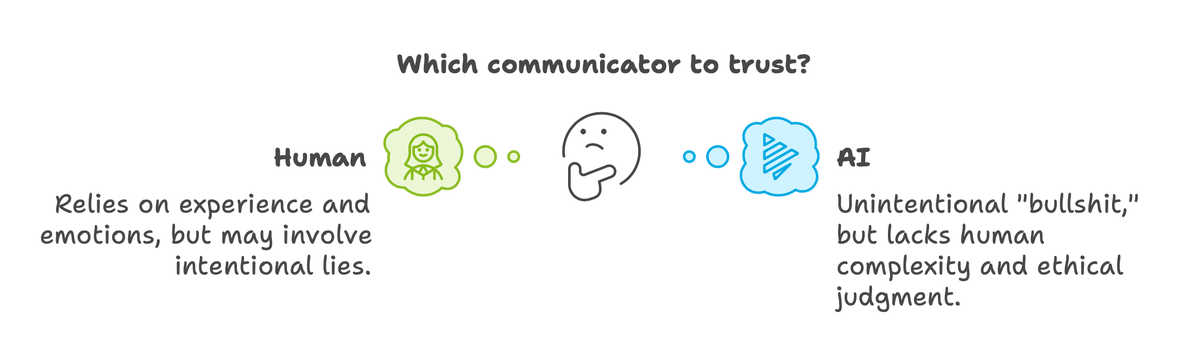

意図の違い:人間の嘘や誇張には多くの場合、自己防衛や社会的体裁の維持といった意図があります。一方、AIの「たわごと」は意図的なものではありません。

コミュニケーションの複雑さ:人間同士のコミュニケーションは文化や個人的経験、感情などが絡み合う複雑なプロセスです。AIはこの複雑さを完全に理解することは困難です。

学習と改善:人間は経験を通じてコミュニケーションスキルを向上させることができますが、AIの学習プロセスは異なります。

倫理的側面:人間の嘘には倫理的判断が伴いますが、AIの「たわごと」は純粋に機能的な結果です。

信頼性の問題:人間もAIも、それぞれの理由で完全には信頼できません。両者の限界を理解し、批判的に接することが重要です。

今後の展望

この研究は、AIの出力をより正確に理解し、改善していくための新しい視点を提供しています。今後は、以下のような研究や実践が期待されます:

「たわごと」フレームワークがAIの挙動をより適切に予測できるかの実証研究

AI システムにおける意図性や主体性についての哲学的分析

AI 出力の理解のための新しいメタファーや枠組みの探索

結論

AIと人間のコミュニケーションの類似点と相違点を理解することは、両者の相互作用をより良くするために重要です。AIの「たわごと」を理解することで、私たちはAIとのより効果的なコミュニケーション方法を見出せるかもしれません。同時に、人間のコミュニケーションの複雑さと豊かさを再認識する機会にもなるでしょう。

AIの進化は続きますが、それと同時に、私たち人間も批判的思考力とコミュニケーション能力を磨き続ける必要があります。AIと人間、それぞれの特性を活かしながら、より良い対話と理解を目指していくことが、これからの社会には求められているのではないでしょうか。

この記事が気に入ったらサポートをしてみませんか?