音楽エンジニアが映像を扱う 〜その3 映像と音のオフセット〜

こんにちは

レコーディングエンジニアの米津です。

その3となりますこちら。

例によって映像作品を主戦場にしている方には釈迦に説法と思います内容です。

君はオフセットをちゃんと設定しているか

というわけでこちら。

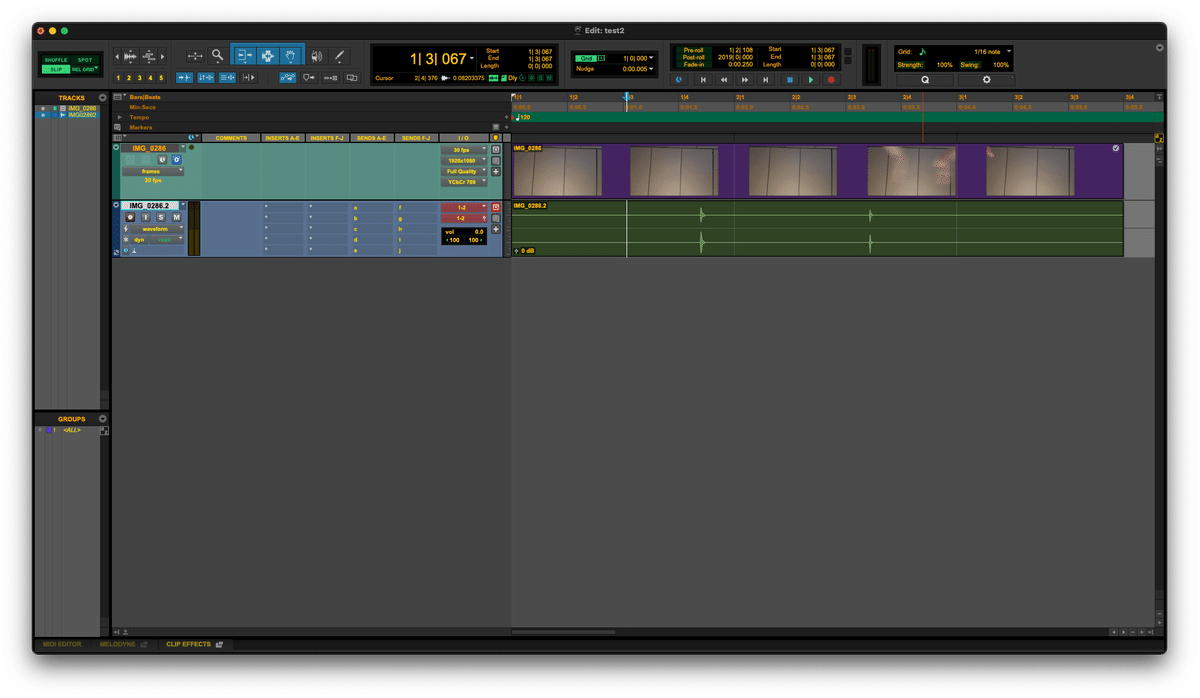

その2で紹介したvideo syncを使うか、Pro Toolsから映像を出すか、

どちらにしても自分の手元から

映像

と

音

を出す、というのは変わりないわけです。

つまり現在の作業環境で映像と音の出力されるタイミングの校正ができている必要があります。

パソコンの画面ってあたりまえに映っているから、

そこに機器ごとの遅延があるっていう発想にあまりならないことが多いです。

ディスプレイによって描画タイミングは違うし、

テレビに映したりしたら、テレビのモードによっても変わる。

そして音の方も、オーディオドライバの設定によって発音の早さは違うし、

その後にデジタルプロセッサ(Trinnovとか)入れていたらそこでまたズレる。

環境ごとの設定が必要です。

困る例

「まぁ言うてMAするわけじゃないし、音楽スタジオでの段階でそこまで詰める必要ないでしょ」

って考えで「オフセット?知らね〜」って人いると思うんですけど、

よくないです。

後からズルっとずらせばいい。そんなわけないない。

たとえばライブミックスで

マルチ一本で録った素材でミックスをしていて、

映像チームからはスイッチングアウトをもらって、ミックスを進めている。

映像の音とマルチの頭を合わせて……

ん〜、でもちょっと映像が遅く見えるから、

映像クリップを1フレーム前に置いちゃおっと。

とかをしても、

別に問題は起きない。

一本化された2MIXをMAのときに最終的に映像に合わせてくれればいいもんね……

このまま終われば別にこれで問題はない。

しかし、

ミックスの途中で、歌手のテイクを一部差し替えたい。

となったときに、

リップシンクの整合性がとれているか、映像をみながら波形編集をするわけです。

その際に上記のような ”オフセット設定を正確にしていない環境” で作業を行うと、

その場ではいいけど、

そのあとMAで2MIX全体を映像に合わせた時に、

差し替えた部分だけズレてしまう。

CM音楽でも

「カット変わりでこのフィルがドンと!」

とか、音楽の仕掛けを作っていても、

オフセットが正しくないと、その場ではいいけど、

MAに行った時に正しい位置に2MIXを貼り直した時には、

カット変わりとズレている。

さらに、

自分の目の前のメインディスプレイでリップシンクを詰めて、

さぁじゃあプレイバックです。

みんなが見える大きい画面に映し変えて、プレイバック。

なんかズレてる……

みたいなことが起きるんです。

オフセット設定を無視していると。

正直この部分は外のスタジオに行ったら

「当然設定できてるよね……?」

という部分だったりするので、

セッション終了後 or 「なんかズレるな……」発覚後に

オフセット設定全然してませんでした。

ってなるとアシスタント気まずいと思う。

基本的には設備に対して適正値を設定しておくものだと思います。

Mac持ち込みとかTrinnov持ち込みとかならエンジニアの責任なので気にしなくていいと思います。

さてではオフセット設定してみましょう。

一番簡単な方法です。

iPhoneとかでビデオをなんか撮る。

その映像をPro Toolsにインポート

そして再生。

この時に、映像と音がズレないようにするのがオフセットの設定。

ms単位の方が音楽ミキサー的には理解しやすいですね。

ちなみにこの二項は積算されるので、どっちかだけ入れればよし。

ちなみにうちの環境ではオフセット0だと音が早く感じる。

その場合はここに正の数値を入れる。

これで映像と聞こえてくる音のタイミングが合いました。

これでオフセットの設定は完了。

ということになるので、

この環境で作業する分には心配いらない。

が、

さてさてお客さんに見せるためには横のでかいテレビに映すか。

これはMacの二画面目としてhdmiで繋いでいます。

さて、そして再生。

そうするとズレてます。

あららさっきオフセットの数値を入れて合わせたのに。

つまり、メインディスプレイとテレビの描画スピードが違うということですね。

ですのでテレビから映す場合はオフセットを設定し直さなくてはいけません。

まぁ大抵テレビの方が描画は遅い。だからテレビにはゲームモードとかがついてるんですね。

と、このように、

正しい環境で音を映像とともにチェックするためには、

オフセットに気を配る必要があるとご理解いただけましたでしょうか?

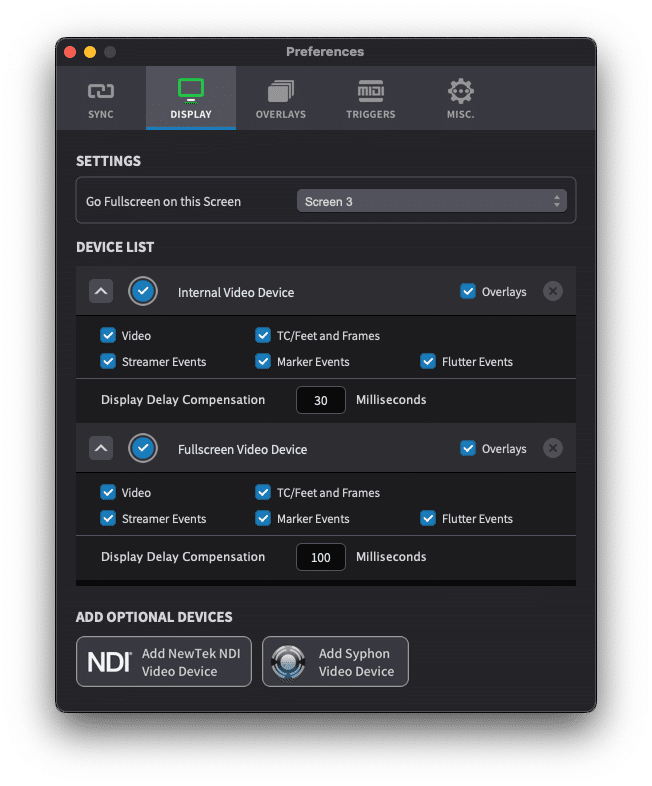

video syncを使う

さて、

さっきのようにPro Toolsのビデオウィンドウを画面間で移動させた場合、

映すディスプレイによってオフセットが変わってしまいますよね。

とはいえビデオウィンドウを動かすたびに、

毎回オフセットの数値を変えるのは絶対間違えそう〜

そんな場合にもvideo syncは活躍します。

video syncはこのように、繋がってる映像デバイスごとにオフセットが設定できる。

Display Delay Compensation

ね。

これがあるため、映すディスプレイごとにオフセットを設定しておけるのです。

優秀〜

(大規模なスタジオだとblackmagicの映像ハブみたいなのから映像を出していたりして、その中で同様のことをおこなったりしている)

注

Pro Toolsで設定したVideo offsetはあくまでPro Toolsから映像を出す時のみ影響するので、video syncのオフセット設定には関与しない。

仮にPro Tools - video sync間でオフセットかけたい場合はSession setupのtimecode offsetでやろう(やる必要ないと思うけど)

もっとちゃんとオフセット合わせたいぜ!

さて、オフセットの必要性と設定の仕方はご理解いただけただろう。

でもこの「目で見て音と映像のズレを調整する」

というのが私は結構苦手で、

なんか気になり始めるとあってない気もするし、

微調整し始めると音が早いのか遅いのか〜〜〜んんん〜〜〜???

となる。

正直そんなとこで神経使いたくないので、

そういう時の便利ツールを紹介します。

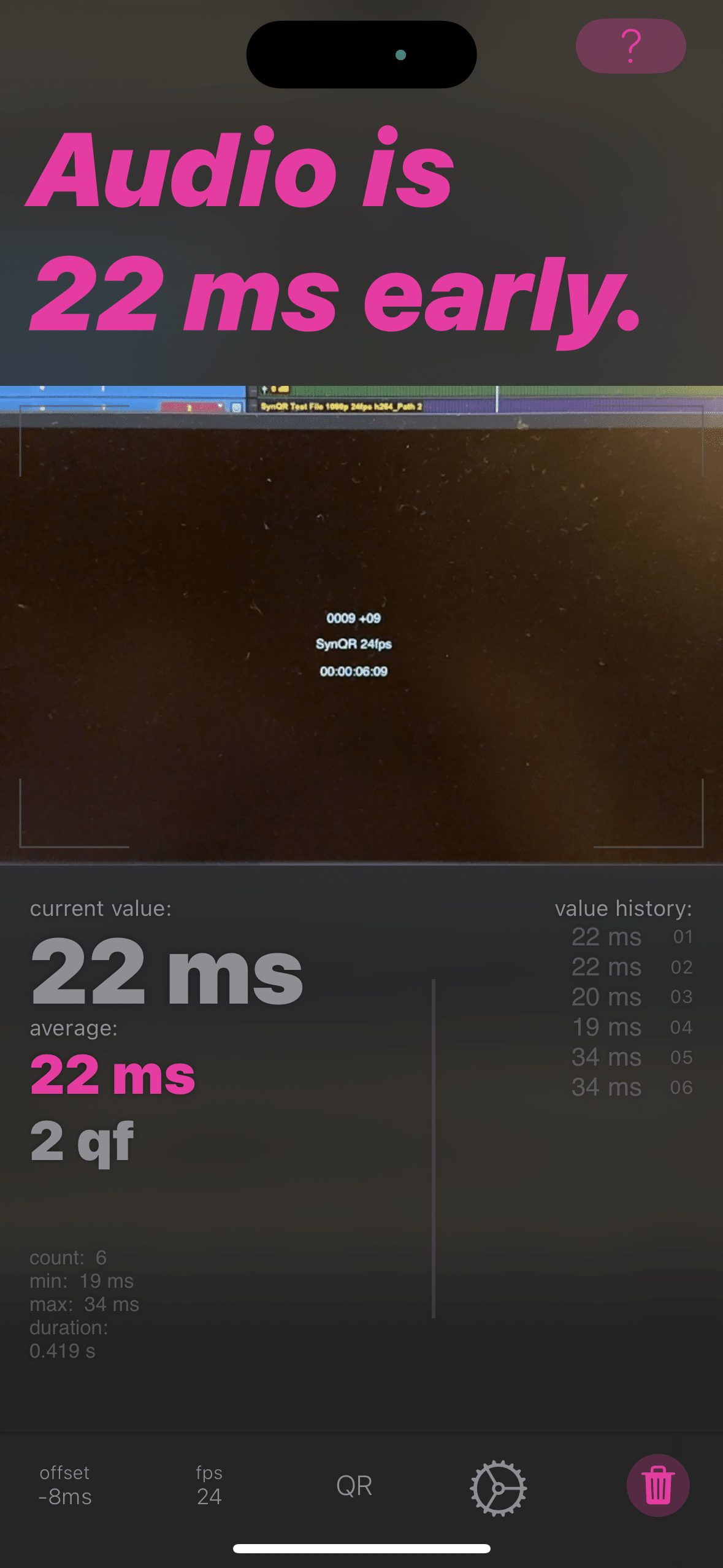

さて、こちら、SynQRというiPhoneアプリです。

iPhoneにこのアプリを入れて、

このサイトのDownloadsにある映像ファイルをタイムライン上に貼る。

そして再生した画面をこのアプリで映すことで、

一緒に鳴るピッという音をマイクで拾って、

映像と音のズレっぷりを数値で教えてくれる。

超便利。

iPhoneアプリの方では最初にiPhone本体のカメラとマイクのオフセットの校正を行う必要がある。

この設定を行うことで、iPhoneのカメラの映像入力と、マイクの音声入力のタイミングを正確に合わせた。ということになる。

iPhoneの機種ごとに決まった設定値を提示してくれればいいのに、

とも思うが、

iOSのverによっても変わったりする可能性があるだろうから、

そこをしっかり測定してからしか使えないようになっていて、

信頼度は増す。

一回設定すればその後は大丈夫。

初期設定が済んだら

実際の使用

Pro Toolsを走らせて、ピッという音をiPhoneに聴かせつつ、

画面をiPhoneで映す

平均値を考えて、それをPro Toolsのオフセット設定にいれる。

まぁだいたい20msくらいかな。

video sync offsetに入力

これでばっちり。

他の映す可能性のあるディスプレイにvideo windowを移動させて同じことをすることで各ディスプレイのオフセットがわかる。

video sync使用時も同じようにやろう。

こうして機械に測定させることで安心感は増し、無駄な神経を使う必要がなくなる。

SynQR

オススメです。

この記事が有用で私にコーヒーでもおごってやろう!という剛毅な方はこちらのQRコードからお願いします