【人工知能】AIの基本とAIの限界をまとめてみると。

総合的な思考基盤を養うことをテーマに読書した知識を引用・解説していくnote。本稿では「教養としてのAI講義 著メラニー・ミッシェル」より、人工知能におけるナレッジを紹介していく。

【対象者】

人工知能、AI、自動化の歴史や知識に興味がある人

【メリット】

①人工知能がどのように動いているか理解できる

②人工知能、というざっくりした理解ではなくカテゴリ別に理解できる

③概略を知っておくことで人工知能の現状を正しく把握できるようになる

それではみていこう。

#1パーセプトロンをさくっと理解しよう

AIと聞いてまず思い浮かべるのはなんだろう?自分で好き勝手に動くロボット、脳みそや神経系、だらだらと書かれたプログラミング…

いや、大きく分けるとAIは記号的AIと非記号的AIに分かれる。記号的AIとは、

いわゆる人間の理解している理屈をコンピュータが分かるような言葉で書いたやつだ。

例えば、「歩く」だったら、右足を上げて前に出して、次に左足を上げて右足よりも前に出す、その時手は反対の腕を前に出す、みたいな

一方で非記号的AIというのは、

脳から発想を得た非記号的AIプログラムの初期の例は、1950年代終盤に心理学者フランク・ローゼンブラットが開発した「パーセプトロン」だ

━━━「パーセプトロン」を簡単に説明すると、入力値1、入力値2、入力値3の合計値によって出力結果を決定する神経細胞をモデル化したものだ。

ただ、この仕組みには限界がある。入力値は無限に増やせるがその足し算のみでしか計算/結果出力できないからだ。

パーセプトロンが「完ぺき」に解ける問題の種類は非常に限られていて、しかも大量の重みと閾値が必要なタスクにおいては、パーセプトロン学習アルゴリズムをそれに応じて拡張することが難しい

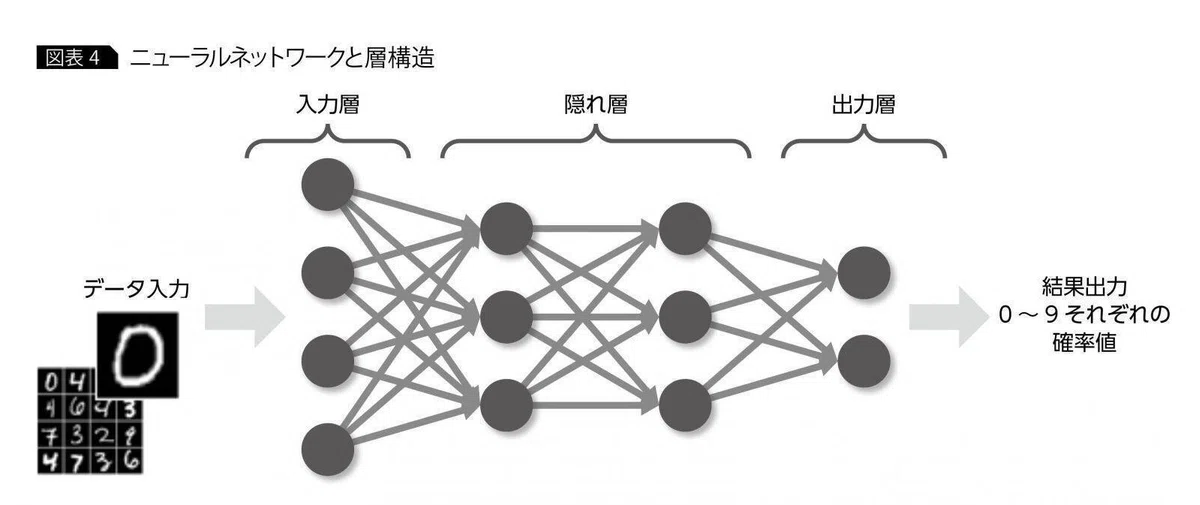

そこで、パーセプトロンの仕組みをバージョンアップして、さらに入力層を増やし、重みづけを拡大することで解ける問題の種類を拡大しようとしたのが多層ニューラルネットワークだ。

何がバージョンアップされたかというと入力層と出力層の間に任意の数のニューロンを追加したのだ。━━━隠れ層(=隠れニューロン)と呼ばれる。

当時(1970年代)はこの多層ニューラルネットワーク構築による効果について世論は懐疑的であったが、フランク・ローゼンブラッドを筆頭に粛々と進められ、学習アルゴリズム「バックプロパゲーション」が開発される。

これは誤差逆伝搬法とも呼ばれ、いわゆる

出力結果を評価することで各ニューロンの重みづけ(=条件)を変更していく方法

である。━━━?????おい、何を言ってんだ、ちゃんと説明しろ!

ボーリングでイメージしてみよう。1投目投げた時に1番ピンよりも右側に逸れたので2投目では少し左から投げよう、という━━━人間は無意識にしている━━━微修正とやっていることは同じである。

結果を見てみて次回どうすればいいか結果から入力にアドバイスをあげるのが、学習アルゴリズム「バックプロパゲーション」である。

これで君はもうバックプロパゲーション(=誤差逆伝搬法)マスターだ。ただこの方法もあらゆる分野で応用される中で限界が見つかっている。最後にそこだけ簡単に書いておく。

何が限界かというと、大規模になるにつれて学習すべき重みが非常に多くなるため、最適な値を見つけることが難しくなることだ━━━初期値などに依存する「局所解」と呼ばれる

ボーリングで例えると(またボーリングかよ!)投げてすぐガターになるようなイレギュラーな入力を最初にしてしまうと2投目どういう修正を行えばいいか迷ってしまうことになる、のと同じである。

ある程度入力値の範囲が予測されるものであれば微修正を重ね正解に近づいていくことができるが、突拍子もない入力の可能性がある分野への応用は中々ハードルが高い。

***

#2強いAIと弱いAI?

強いAIと弱いAIというと、バトルをしてどっちが強いかという優劣の話を思い浮かべてしまうがそうではない。

サールにとっての「強いAI」とは、「精神を模倣しているのではなく、本当に精神を宿すようプログラムされたコンピュータ」

強いAIとは例えばどらえもんのことだ。自分で考えているように、話しているように”見える”のではなく、実際に感情を持って考えて話している。

反対に弱いAIとは、データを解析したり、siriのような音声を入力すれば音声で返ってくるような人間が覚えさせた通りの挙動をするAIのことを指す。

━━━なるほどなんとなくわかった。でもそれで?本当に精神が宿っているかどうかはどう確認するんだっけ?

これは中々難しい疑問だ。”本当に”心がある状態とはどういう状況か?について「認識論」という分野で連綿と議論が続いている。色々な例をみてみよう。

マウスを使ったこんな実験がある。マウスが特定の行動、例えば滑車を10回回した、台の上に乗った、をした時におやつを与えることを繰り返す。するとネズミは学習してその行動をとる頻度が格段にあがる。

次にハンスの馬の例がある。賢い天才馬として一躍有名になったハンスはなんと、足し算ができるのだ!!飼育員がハンスに「3+4=?」と聞くと幾つか答えが書かれた紙を前足で器用にチョイスする、しかもなんと正解だ。

━━━しかし、後にそれは誤解だったことが判明する。

ハンスは投げかけられていた質問やその数学的な考え方を実際に「理解」していたのではなく、質問者が無意識に送っていたかすかな合図に反応していた。

サピエンスは長い歴史の中で進化し、脳を拡大させてきた。それにより膨大な記憶力を持ち、複雑なコミュニケーションができるようになった。

以下の画像を見てほしい。何が想起されるだろうか。

・男性が右手に持っているのはスマホでかなり没入してる感がある

・半袖なので季節はなつなのかもしれない

・前をみていないので男性は人生お先真っ暗だ

・首に乗っているのはピカチュウだ。主従関係が逆になっている

・ポケモンGOに夢中になっているということか

・これを書いた人はポケモンGOに夢中になっている人とぶつかってけがをしたので腹いせに書いたのかもしれない

この画像だけでも人間が見れば色々なことを想像できる。それは人間が持つ2つの基本的能力「抽象化」と「アナロジー」のおかげである。

抽象化とは具体的にあった出来事を一般化できる能力のことだ。例えば、バイクとぶつかって転んだ→乗り物にぶつかるとけがをする→自動車が走っている場合も気を付けよう、といった流れだ。

アナロジーとは物事の間の特定の点での類似性から、他の点での類似性を推論する能力のことだ。

バイクと自動車は動く機械だからどっちも乗り物、だけどタイヤの数でいくとバイクと自転車は同じで、自動車は4輪だからバイク等とは異なる、という形だ。

このような人間であれば簡単にできることもコンピュータにさせるとなると非常に難しい━━━ぐるぐるバットをしてからピンポン玉を投げて100m先の1つ分の穴にいれるくらい難しい(え?簡単だって?)

━━━もし人間と区別できないほど十分人間らしいコンピューターがあれ

ば、それは『真に思考している』ものを考えていいのではないか?

ジョン・サールは論文の中で画期的な思考実験「中国語の部屋」を展開した。

ある小部屋の中に、アルファベットしか理解できない人を閉じこめておく(例えば英国人)。

この小部屋には外部と紙きれのやりとりをするための小さい穴がひとつ空いており、この穴を通して英国人に1枚の紙きれが差し入れられる。

そこには彼が見たこともない文字が並んでいる。これは漢字の並びなのだが、英国人の彼にしてみれば、それは「★△◎∇☆□」といった記号の羅列にしか見えない。 彼の仕事はこの記号の列に対して、新たな記号を書き加えてから、紙きれを外に返すことである。

どういう記号の列に、どういう記号を付け加えればいいのか、それは部屋の中にある1冊のマニュアルの中に全て書かれている。

例えば"「★△◎∇☆□」と書かれた紙片には「■@◎∇」と書き加えてから外に出せ"などと書かれている。彼はこの作業をただひたすら繰り返す。

外から記号の羅列された紙きれを受け取り(実は部屋の外ではこの紙きれを"質問"と呼んでいる)、それに新たな記号を付け加えて外に返す(こちらの方は"回答"と呼ばれている)。

すると、部屋の外にいる人間は「この小部屋の中には中国語を理解している人がいる」と考える。

しかしながら、小部屋の中には英国人がいるだけである。彼は全く漢字が読めず、作業の意味を全く理解しないまま、ただマニュアルどおりの作業を繰り返しているだけである。

それでも部屋の外部から見ると、中国語による対話が成立している。

計算機に「6+5=」と入れると11と返ってくる。もっと複雑な「13422×7239=」と入れても97,161,858と返ってくる。では計算機の中に天才的な小さいおじさんがいるのだろうか??

もちろんそんなことはないと小学生でも知っている。

最近siriなど音声対話サービスが増えているが、計算して答えを出力するよりもさらに複雑な対応ができるようになっている。

でも彼らは”思考”しているわけではない。あくまで人間が決めた枠の中で忠実に最適解を求めているだけだ。

見間違えるほど人間と同じ対応をしたとしても、

想定内の対応であり、自分で思考してその都度臨機応変に対応できているわけではない。

つまり現状の人工知能の延長線上には思考するAIは誕生しない、というのが私の考えである。

思考できるAIを創るためには赤ん坊を育てるのと同様に、時間をかけて常識などの抽象概念をインプットさせて人間と遜色ない知識データベースを構築する必要がある。

━━━プロジェクトとして動いている常識知識ベース Cyc が代表的だがいまだ完成には程遠い

それが現時点での人工知能である。

思考できるAIが誕生し、人間世界が壊滅するようなSFは多々あるが、心配しすぎだ、あのレベルはまだまだ到達しない。でも一方で人工知能の世界ではまさしく強いAIの完成を目標にしのぎを削っている。

それまでに新たな職業が消えるだろうし、日常生活はより便利になるだろう。その時になぜそうなっているのか理解できていないと時代に取り残される。

そういう意味で人工知能の専門ではなくとも最低限ベースの知識をつけておくのが賢明だと、私は考える。