【2023/11最新】Vroidで配信超おすすめアプリ!Vnyan導入:入門編

POINT!

自分が読む必要があるところだけで大丈夫です!

この記事では日本語しかわからない方のDL-アバター読み込み-カメラ等設定-マイク設定-配信設定をサポートしています。

都度目次に戻ってくるのが読み疲れないです

設定につまずいたら戻ってきてください。

はじめに

初めましての方は初めまして。普段Twitchで耐久配信をしているうにのれむと申します。

最近たくさんのTwitch配信にお邪魔する機会が増えて配信を見に行くたびに「あ、うにのれむさん!はじめまして!どこかで見ました!ああぁ!たぬえさ3の記事の人だ!」って言われることがとても多いです。

とっても嬉しい!!!!!!!!!!

でもたぬえさ3を作った人ではないので、たぬえさ3のことはDiscordにて開発者さんに聞くのが一番早いと思います。

もちろん僕でもいいですが、結局開発者さんに回しちゃうかも!w

今回はVroidを普段つかっている配信者さんの方向けの入門記事になります。

Vnyanの簡単な導入方法から、Vnyanについている機能を紹介します。

正直機能がありすぎるのでたぬえさ3同様使いこなしているわけではないのですが、使っていて便利だと思った機能を簡単に紹介していきます。

個別に機能を紹介しながらだらだらと長く書いていきたいと思います。

機能ごとの記事はまた別途UPしたいと思っているのでその時はまたよろしくお願いします!

Vnyanとは~何をすることができるんだ!

まず、Vnyanって何をするアプリかをまとめます。

https://suvidriel.itch.io/vnyan

ここからどんなことができるのか列挙していきます!まじですごいです。

・Vroid(3Dアバター)を表示することができる。

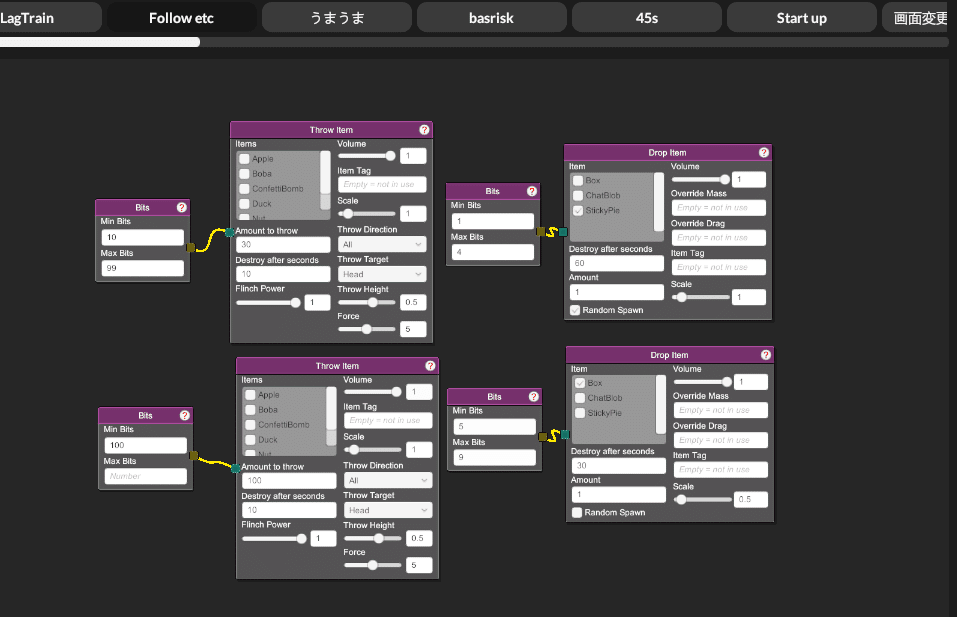

・レイドやビッツ、チャンネルポイントなどのさまざまな配信中のアクションに対応していて、それをトリガーにしてイベントを起こせる。

・ビッツの量やレイドの人数などでフィルタして細かく調整できる。(10人以上のレイドで特別な演出、特定のビッツの量で特別な演出など)

・Twitch integrated throwing system(T.I.T.S.)やKbonkなどの代わりに3Dのアイテムを投げて当てたりくっつけることができる。しかも自分で作った3DアイテムやMP3も設定できる。

・たくさんのVnyan内カメラを準備して画面内の好きなところにワンタッチで移動できる。(がち恋距離や全身表示など)

この機能を活用してStreamer.botやたぬえさ3などと連携して画面に合わせて半自動でVを移動させられます。

ゲーム中と雑談で表示させたい場所を選びたいときに超便利です。

OBSでソースを移動させたり別々で作ったりするのは面倒ですからね…

もちろんたぬえさ3やStreamerbotで仕込めるイベントなら半自動でも動かせます。

・2D素材の眼鏡や3D素材の剣、動くGIF画像などを体の好きなところにつけることができる。

画像やアイテムを手や頭、腰などのどの部分に出現させられるかを3D空間で

選ぶこともできます。

・Twitchのエモートを画面に降らせることができる。

・配信のコメントに反応してイベントを起こすことができる。

・VRM、VRM 1.0、VSFAvatarが使える(アバターの種類)

・Webカメラ、iFacialMocap, Vtube Studio(iphoneトラッキング), MeowFaceでトラッキング可能。微妙な表情に合わせてVroidの顔を変えられる(眉をどのくらい上げたらとか目をどのくらい見開いたらとか口角があがったらとか)

・MMDのモーションと音声の再生ができる

・心拍計の心拍数の最大値や最小値に反応してイベントを起こせる。(Pulsoidを使用)

・マイクから入力される周波数と音量に反応してイベントを起こせる。(ホラーでビビったときとか)

・Websocketを使ってコマンドを受け取れる。(たぬえさ3やStreamdeck, Streamer.bot などから信号を受け取ってイベントを起こせる。)

・Live2Dのアバターのようにまばたきしたときに目をプルプルさせることができる、瞳孔は暗いと小さくなるのでその再現。(瞳孔の物理演算)

また、WEBカメラだけで目をギョロギョロさせることもできます(たまにキモイ)

話の話題に、今なに見ているの?とかより細かい感情もWEBカメラだけで設定できます。

・iphoneのARkitによるパーフェクトシンクにも対応しているので、同じくパーフェクトシンクのVroidを用意することで、よりレベルの高いトラッキングを実現することも可能です。(ちなみに余談ですがうにのれむ自身はパーフェクトシンク非対応のVroidを利用しており、Streamdeckやiphoneを使ったトラッキングをしていません。)

・Spout2とNDIキャプチャを使える。(Vの設定画面を配信画面に映さずに設定できる)

・初期設定以外のほぼすべてのノードや目の弾力設定などを他の利用者と共有することができる(自分の設定を他の人と共有して、より良い設定を創り出すことができる)(ちなみに僕のNOTEで自分の設定をある程度公開して、みんなが使えるようにする予定です。お金はとりません!)

以上です!だいたいこれだけの機能があります。

(かっこ)の中に子どもでもわかりそうな感じで具体的に何ができるのか書いてます。

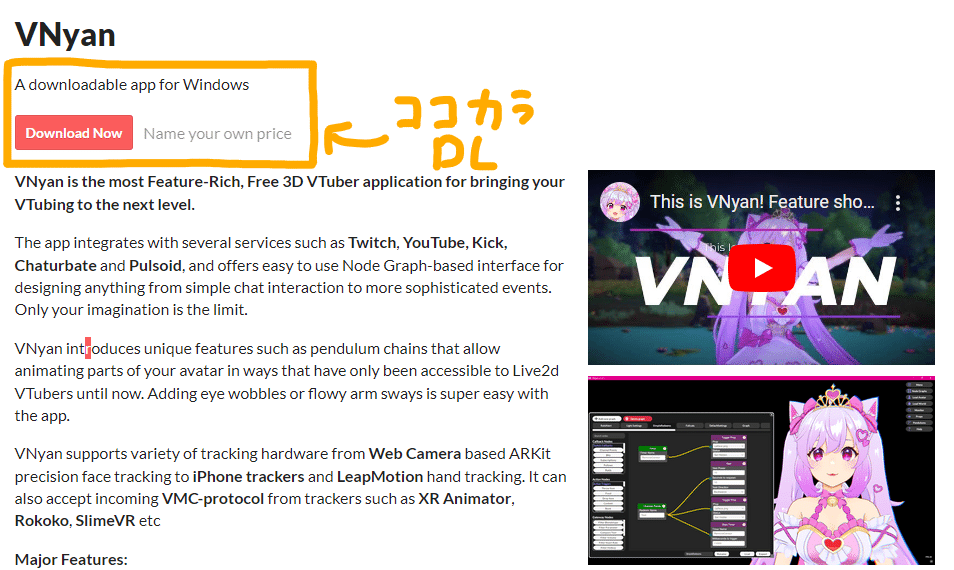

Vnyanの導入方法

次にVnyanの導入方法について

以下のリンクからVnyanのダウンロードをすることができます

itchではVnyanの購入ページに進むことができます。

ここからVnyanを無料でダウンロードすることができます。

ダウンロード後に追加の料金もかからないです。

ここでダウンロードした後にアプリ内で課金をしてくださいなんてこともないです。

優しさでアプリを作成されているので(アプリの紹介にもそう書いてあります。)

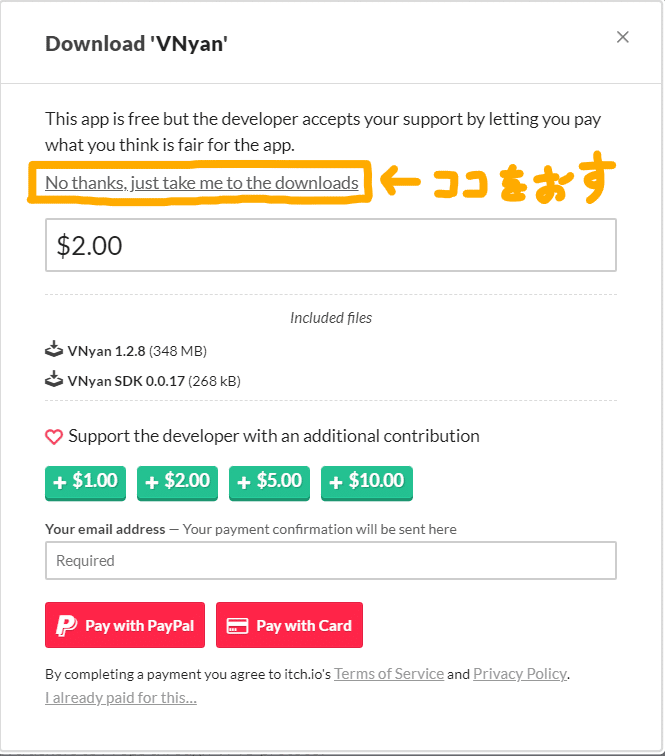

No thanks, just take me to the downloads

(大丈夫です、ダウンロードに進む)

をクリックして次の画面に進みましょう。

もしお試しで使ってみて、とても役に立つと感じた場合は

チップをするのも励みになると思います。

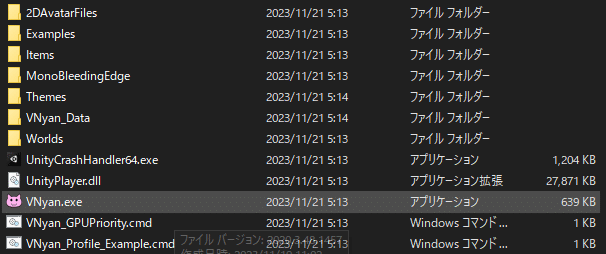

「Vnyan.exe」をクリックしてアプリケーションを起動しましょう。

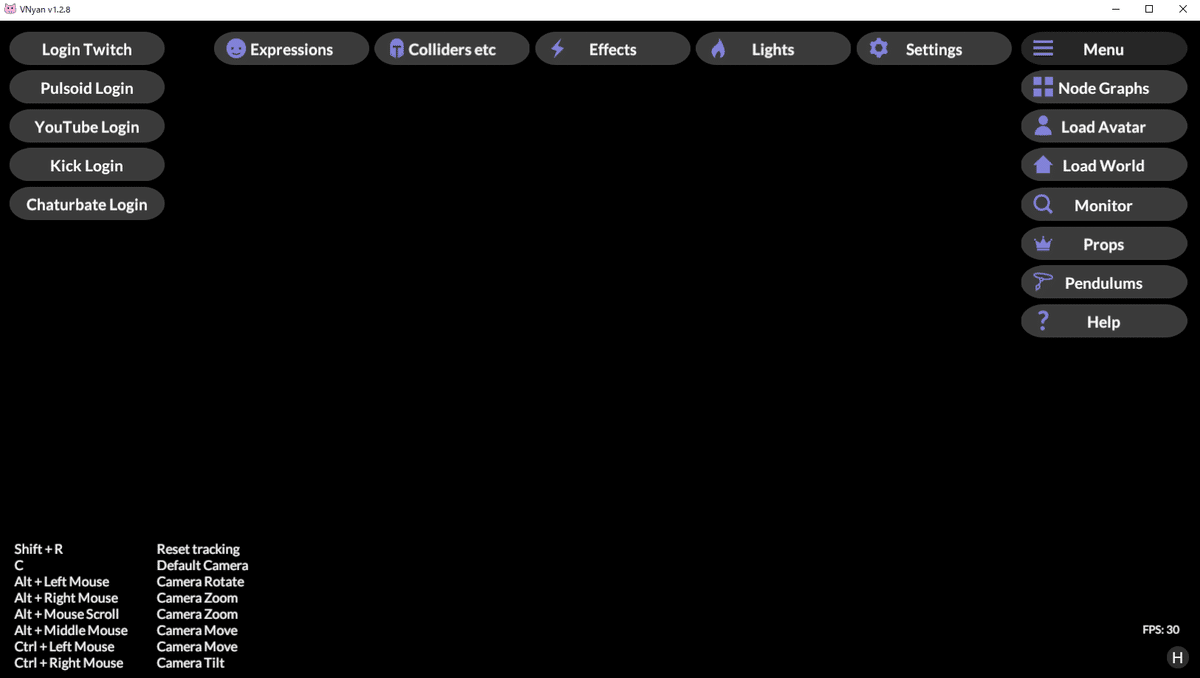

画像はver1.2.8の画面です。このバージョンからUIやテーマが一新されて、

人によって若干見た目が異なります。

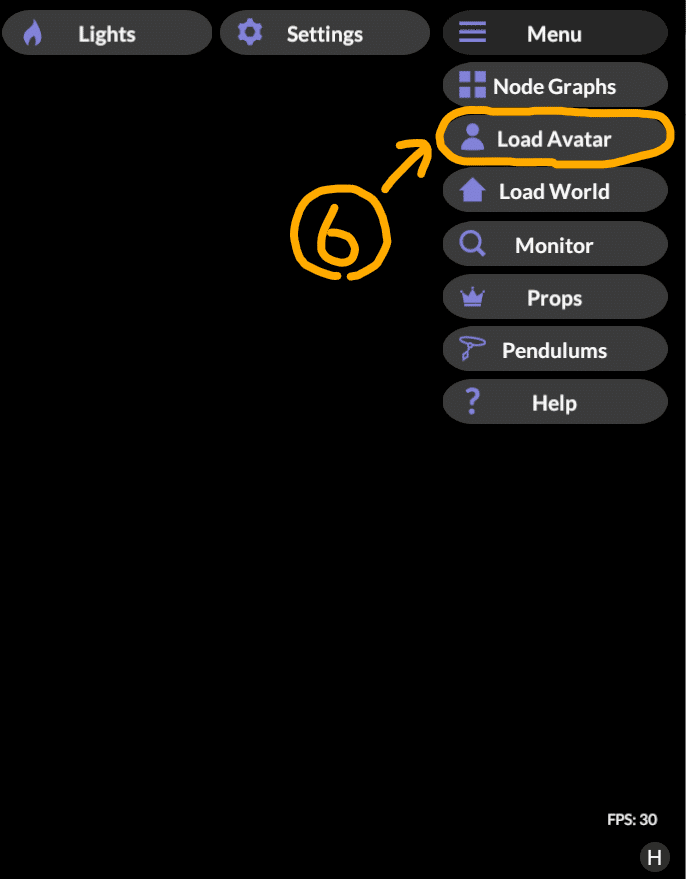

☆まず自分のアバター(3D)を読み込みましょう!

対応しているアバターファイルの種類はVRM、VRM 1.0、VSeeFaceAvatarの3種類が使えます。

VroidStudioで作られたものはVRMのモデルになるので使用することができます。

Boothなどで作られたVRC(VRchat)用のアバターは別の規格になるので

使うことができないので気を付けましょう!

※VRCアバターをVRMに変えることもできますが、

手順が増えて難易度が上がるのでおすすめしません。

自分でできる方はぜひ挑戦してみてください。

☆自分に合わせた方法でアバターに息を吹き込もう!

つぎに自前のアバターを動かすためのカメラ設定をする必要があります。

基本的に数値で設定するのですが、

数値を動かしてみて実際にどんな挙動をするのかお試ししながら設定するのがおすすめです。

髪の毛や服の物理演算は人によって違いますし、

自然に見えるところや面白く動けるところを探しましょう!

また、カメラ依存で口を動かすのではなく、マイク依存で口を動かす設定をすることもできるのでお好みの方を利用しましょう。

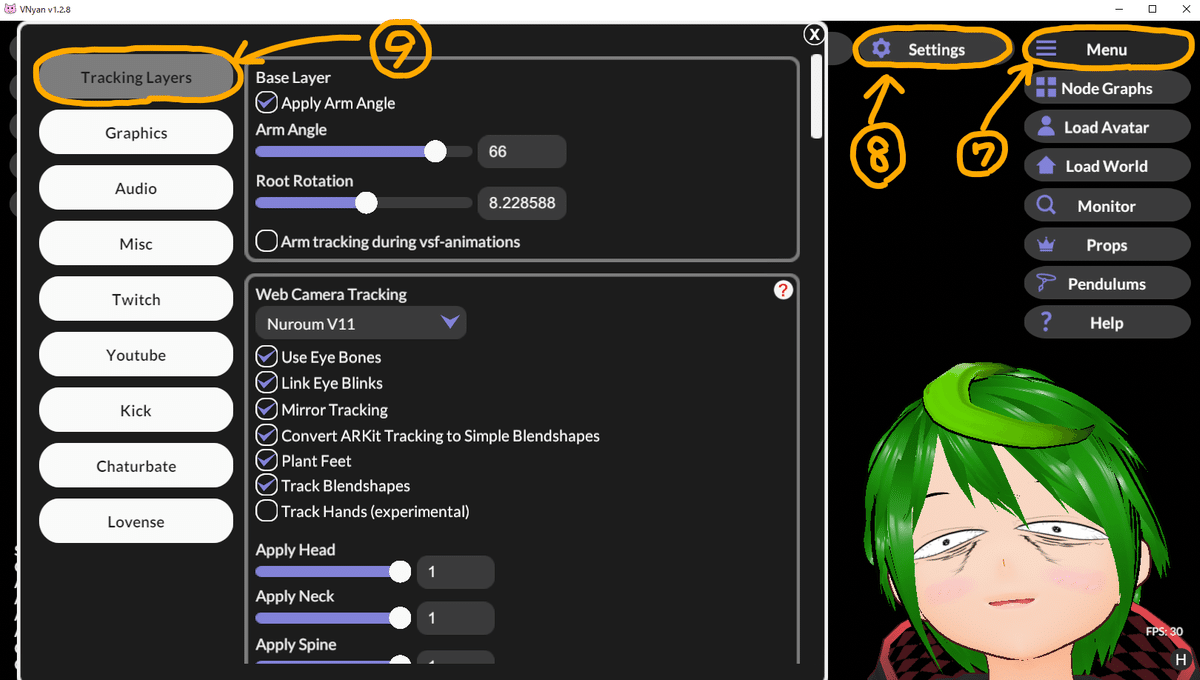

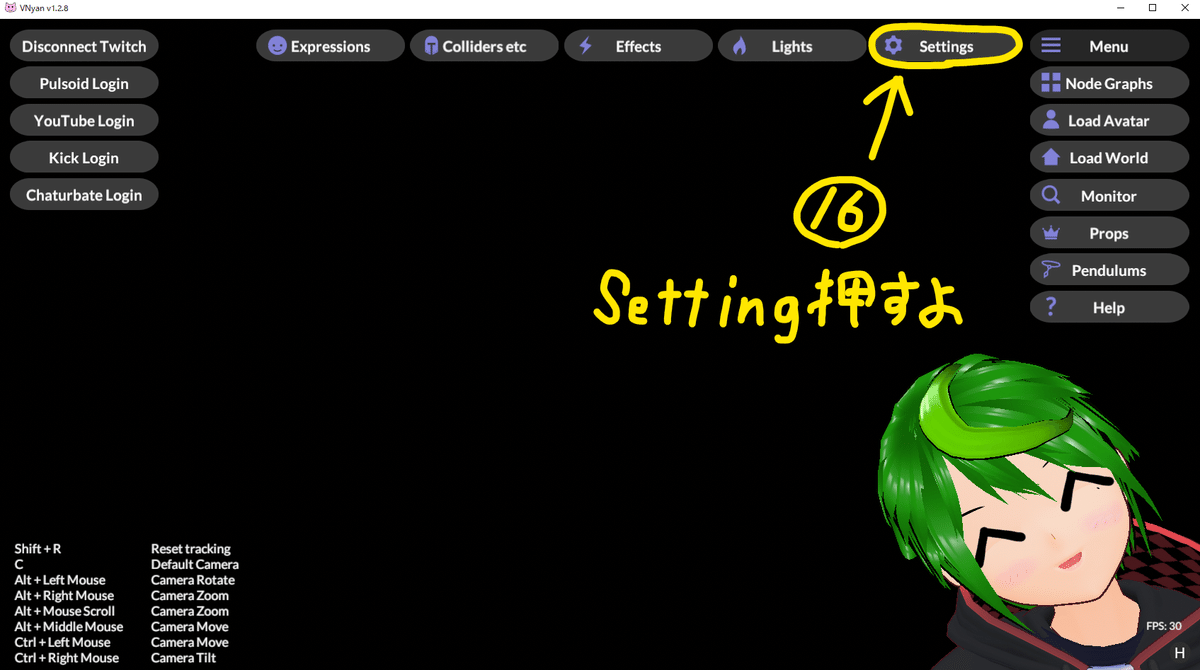

⑧(Setting)をクリックすると各種詳しい設定ができる画面が出てきます。

⑨の[Tracking Layers]から各種トラッキングデバイスの設定をしましょう。

ここから下は[Tracking Layers]の中の枠の中を詳しく説明していきます。

☆基本設定

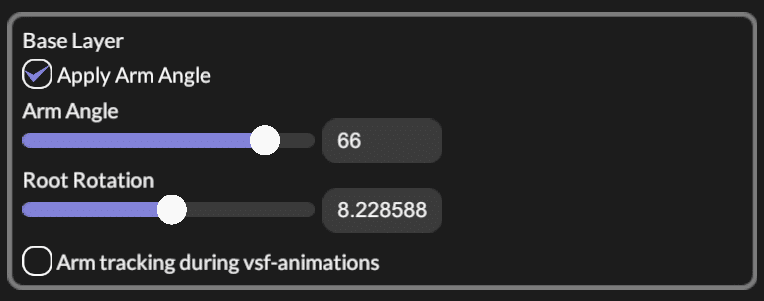

▶Base Layer

☑Apply Arm Angle (腕の角度)→通常時の腕の角度を設定します。

※チェックを外すとTポーズになります。このチェックをしないと以下の項目は設定されません。

Arm Angle (腕の角度の数値)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 66 ]

→ここで設定した角度に腕が設定されます。

Root Rotation(腕の付け根の角度)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 8.228588 ]

→通常厚着をしているVroidには腕の付け根がないはずなので、あまり関係ないです。肩だしのVの方は自然な肩の角度になるように設定してください。

📷WEBカメラを使ったトラッキングの人はコチラ

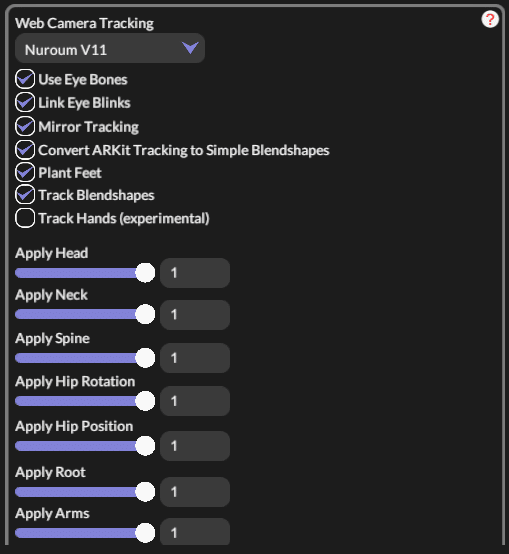

▶Web Camera Tracking(WEBカメラを使ってトラッキングをする場合はこちらの項目を設定します。iPhone, XRanimater, LeapMotionはココじゃないです。)

[ Nuroum V11 ▼ ] →▼をクリックするとあなたが使用しているカメラが表 示されます。 使用するWEBカメラを選択しましょう。

☑Use Eye Bones(カメラで検出して目の可動をするかどうか・見ている方向を検出できます。)

☑Link Eye Blinks (カメラで検出したまばたきをするかどうか)

☑Mirror Tracking (鏡写しでトラッキングするか)

☑Convert ARkit Tracking to Simple Blendshapes (ARkitのトラッキングをシンプルなブレンドシェイプに切り替える)

※ARkitというのは拡張現実のことで、iphoneなどで顔認証するときなどに使うシステムです

☑Plant Feet (チェックすると足が地面から離れない)

☑Track Blendshapes (ブレンドシェイプ[顔の細かいパーツの数値]をトラッキングする。これを有効にして設定すると、困った顔したときに困った顔になったりできる)

■Track Hands (Experimental)

Apply Head (頭のトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Apply Neck(首より上のトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Apply Spine(背骨より上のトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Apply Hip Rotation(腰より上の回転トラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Apply Hip Position(腰より上の方向のトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Apply Root(肩の付け根トラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Apply Arms(腕から手までのトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

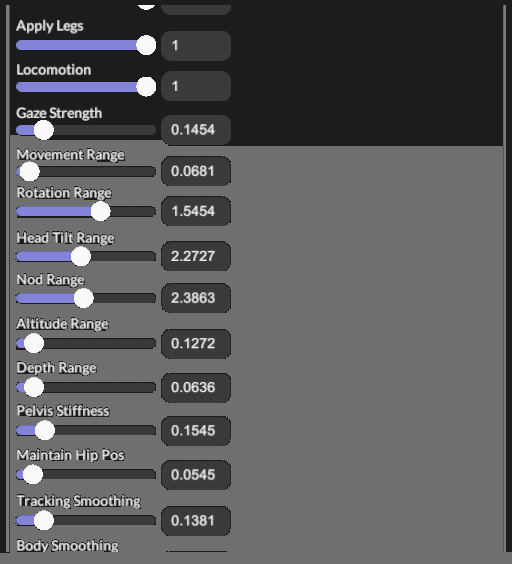

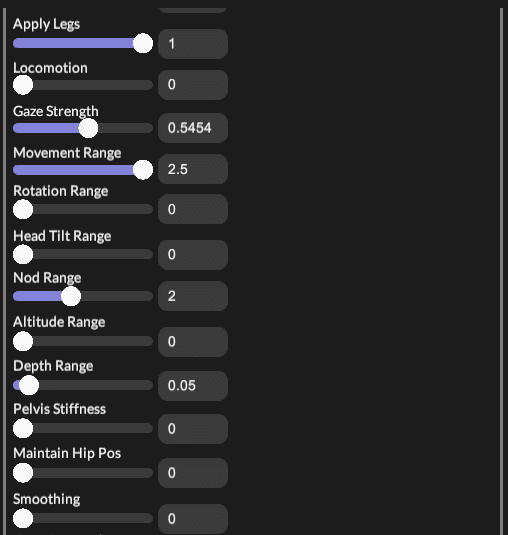

Apply Legs (足の付け根から足先までのトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Locomotion (カメラ内で移動できる→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Gaze Strength (視線の強さ→大きくする程瞳孔のトラッキングが強くなる)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.15 ]

Movement Range (体全体が動ける距離→左右の動ける距離[たぶんメートル])

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.1 ]

Rotation Range (体全体が回転できる量→数値大きくなると)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1.5 ]

Head Tilt Range(首の左右へのかたむきの距離→数値大きくするとよくかたむく)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 3 ]

Nod Range (首の前後へのうなずきの距離→数値大きくするとよくうなずく)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 3 ]

Altitude Range(腰の高さ→数値を大きくすると腰をより落とせる[膝をまげて腰を落とす])

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.15 ]

Depth Range(体全体が動ける距離→前後に動ける距離[たぶんメートル])

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.05 ]

Pelvis Stiffness (骨盤のねじれの強さ 数値低いと骨盤から下が足を組み替えて回る])

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.5 ]

Maintain Hip Pos (腰の場所を維持する0オフ/0オン オンにすると腰の位置を維持する)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.05 ]

Tracking Smoothing (Webカメラのトラッキングに対してどのくらいの速さでVの体に適応するか)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.25 ]

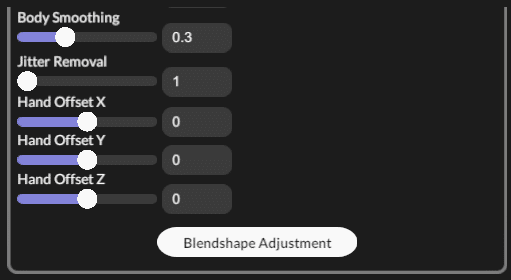

Body Smoothing (体がどのくらいスムーズに動くか)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.25 ]

Jitter Removal (トラッキングしていて震えるときに数値をあげてください)[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.25 ]

Hand Offset X

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0 ]

Hand Offset Y

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0 ]

Hand Offset Z

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0 ]

📱ARkit(iPhoneカメラを使ったトラッキング)使う人はコチラ

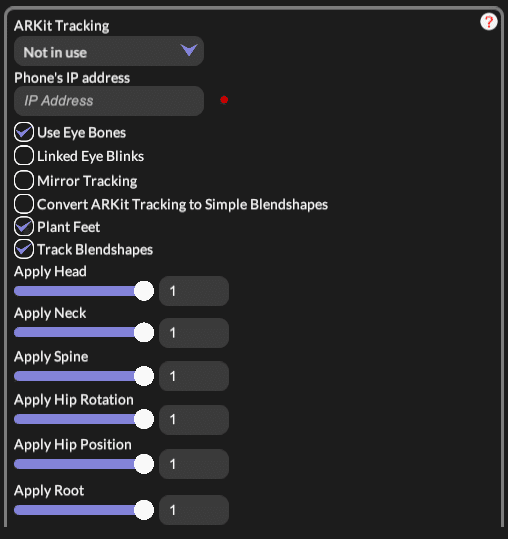

▶ARKit Tracking (iphoneの顔認証機能を使ってトラッキングする場合はコチラを使います。Webカメラ, XRanimater, LeapMotionはココじゃないです。)

[ Not in use ▼] →▼を選択すると接続されている使える機器が出てきます。

Phone's IP address

[ IP address ] →IP addressを入力して接続しましょう。

☑Use Eye Bones(カメラで検出して目の可動をするかどうか・見ている方向を検出できます。)

☑Linked Eye bones (カメラで検出したまばたきをするかどうか)

☑Mirror Tracking (鏡写しでトラッキングするか)

☑Convert ARkit Tracking to Simple BlandShapes (ARkitのトラッキングをシンプルなブレンドシェイプに切り替える)

※ARkitというのは拡張現実のことで、iphoneなどで顔認証するときなどに使うシステムです

☑Plant Feet (チェックすると足が地面から離れない)

☑Track Blendshapes (ブレンドシェイプ[顔の細かいパーツの数値]をトラッキングする。これを有効にして設定すると、困った顔したときに困った顔になったりできる)

Apply Head (頭のトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Apply Neck(首より上のトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Apply Spine(背骨より上のトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Apply Hip Rotation(腰より上の回転トラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Apply Hip Position(腰より上の方向のトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Apply Root(肩の付け根トラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Apply Legs (足の付け根から足先までのトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Locomotion (カメラ内で移動できる→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Gaze Strength (視線の強さ→大きくする程瞳孔のトラッキングが強くなる)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.15 ]

Movement Range (体全体が動ける距離→左右の動ける距離[たぶんメートル])

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.1 ]

Rotation Range (体全体が回転できる量→数値大きくなるとより回転できる)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1.5 ]

Head Tilt (首の左右へのかたむきの距離→数値大きくするとよくかたむく)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 3 ]

Nod Range (首の前後へのうなずきの距離→数値大きくするとよくうなずく)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 3 ]

Alititude Range (腰の高さ→数値を大きくすると腰をより落とせる[膝をまげて腰を落とす])

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.15 ]

Depth Range (体全体が動ける距離→前後に動ける距離[たぶんメートル])

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.05 ]

Pelvis Stiffness (骨盤のねじれの強さ 数値低いと骨盤から下が足を組み替えて回る])

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.5 ]

Maintain Hip Pos (腰の場所を維持する0オフ/0オン オンにすると腰の位置を維持する)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.05 ]

Smoothing (ARkitのトラッキングに対してどのくらいの速さでVの体に適応するかそのスムーズさ)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.25 ]

Jitter Removal (トラッキングしていて震えるときに数値をあげてください)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.25 ]

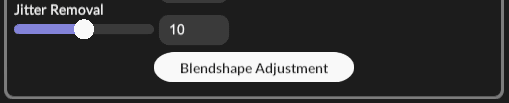

👋LeapMotionのトラッキングを設定したい方はコチラ

▶Leap Motion Tracking (LeapMotionという手のトラッキングに特化したガジェットを使ったトラッキングの設定。それ専用のセンサーがあります。)

こちらの設定は参考程度においておきますが、基本的には自分の環境によって大きく変わるので、人によって数値が全然変わります。

☑Use Leap Motion

Tracker Position

[ Desktop ▼ ]

Position: Height (LeapMotionの高さを設定します。現実の位置に合わせると違和感が減ります。)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1.0 ]

Position: Distance (LeapMotionの距離を設定します。現実の位置に合わせると違和感が減ります。)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Position: Left/Right (LeapMotionの左右の位置を設定します。現実の位置に合わせる)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0 ]

Hand Distance (LeapMotionで検出した両手の手と手の距離)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.05 ]

Scale (手を動かすことができる範囲 数値を大きくしすぎると手の可動範囲が広くなりすぎるので注意。)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0 ]

Rotation X (LeapMotionの角度, X軸)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0 ]

Rotation Y (LeapMotionの角度, Y軸)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0 ]

Rotation Z (LeapMotionの角度, Z軸)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0 ]

☑Mirror Hands (手のトラッキングを鏡写しにする)

☑Track Arms (Leapmotionからの腕の動きもトラッキングする)

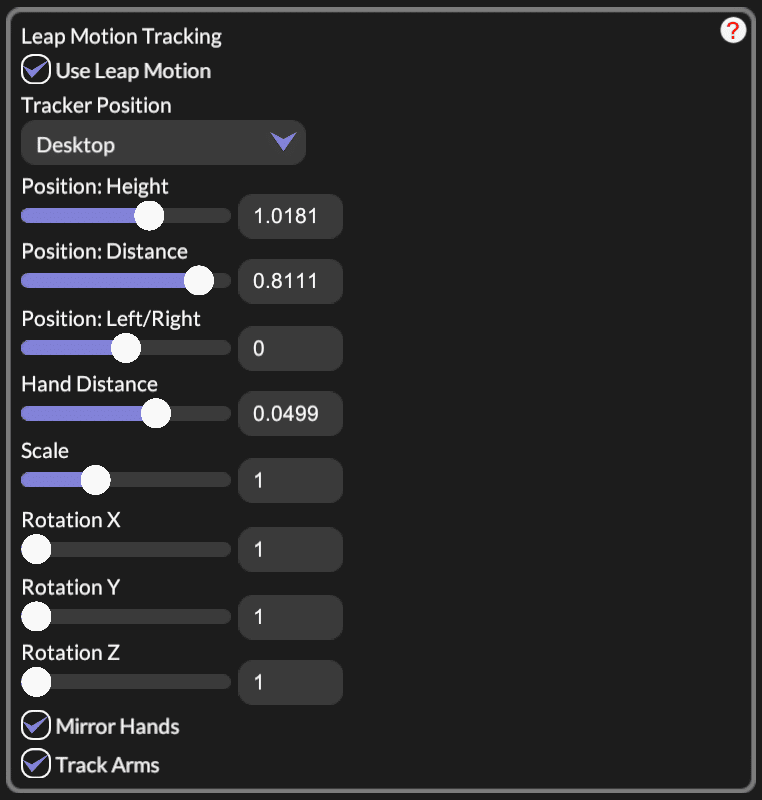

☆VMCLayers(VMCを使ったトラッキングを送りたい方はコチラ、例えばVR用のトラッカーなど)

▶VMC Layers

-VMC Receiver1 (レシーバーを複数個設定することもできます。)

[ 39539 ] (←ここにの数値を受信側と送信側でそろえましょう。)

Track Head (頭のトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Track Neck (首より上のトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Track Spine (背骨より上のトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Track Hip Position (腰より上の回転トラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Track Hip Rotation (腰より上の方向のトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Track Root (肩の付け根トラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Track Right Leg (腕から手までのトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Track Left Leg (足の付け根から足先までのトラッキングを受け付ける→0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Track Right Arm (右腕をトラッキングする 0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

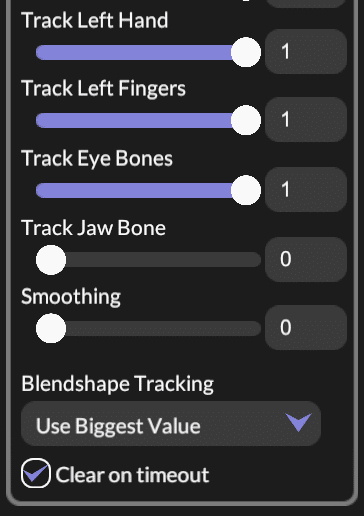

Track Left Hand (左手のトラッキングをする 0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Track Left Fingers (左手の指のトラッキングをする 0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Track Eye Bones (左手の指のトラッキングをする 0オフ/1オン)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 1 ]

Track Jaw Bone (顎のトラッキングをする)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0 ]

Smoothing (スムーズさ、数値を上げると急激には動かなくなる)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0 ]

Blendshape Tracking (顔のBlendshapeのトラッキングの優先順位を選べます)

[ Use Biggest Value ▼ ] (←ココを設定するとBlendshapeの優先度を決めれます)

Don't track (顔トラッキングをしない)

Use Biggest Value (大きい方のBlendshapeを使う)

Replace (VMCで送られてきたBlendshapeで置き換える)

☑Clear on timeout (一定時間経過して接続が切れたときに入力を消す)

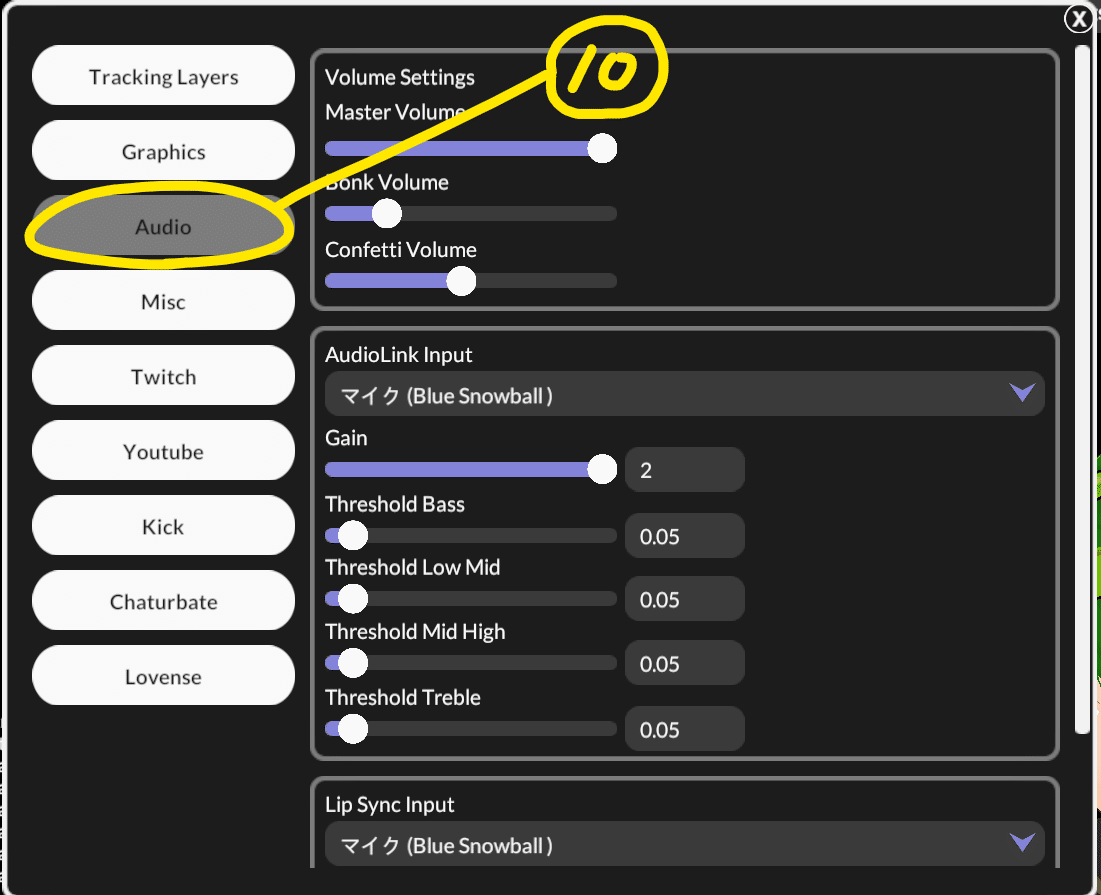

🎙️音関連の設定をしてみよう!

次に配信に必須な音関連の設定をしましょう!

上から順番に設定を共有していきます。

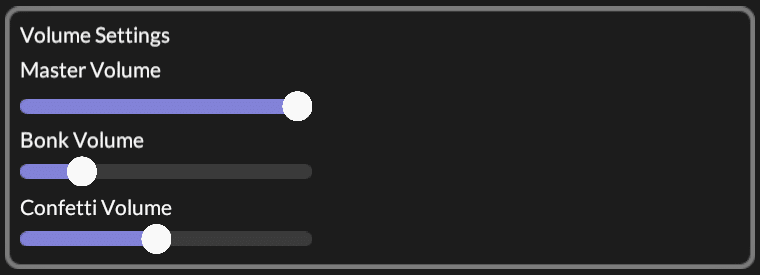

🔊Volume Settings (全体のボリュームを設定できます)

Volume Settings

Master Volume (主音量、ここで全体の音量をいじることができます。MMDに合わせた音楽やMP3の再生音量などもコチラに合わせられます。配信中の自分に聞こえる大きさに合わせると良いです。)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 100 ]

Bonk Volume (Bonkというのは殴るという意味で、配信のイベントに合わせて殴るシステムがあって、その音量が設定できます。)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 15 ]

Confetti Volume (Confettiというのは紙吹雪クラッカーのことで、配信のイベントに合わせて発射することができます。その音量が設定できます。)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 50 ]

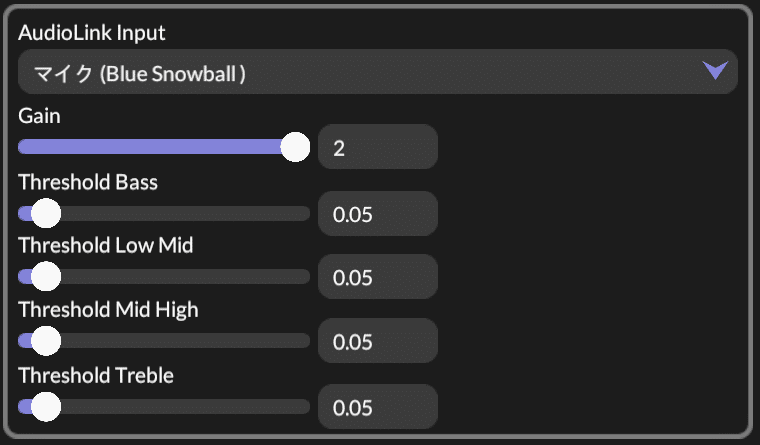

📢マイク入力の音をなんとなく検知して顔の形を変える設定

コチラはマイク入力を直接検知しているのであまり精度は期待できないです

AudioLink Input (マイク入力の選択ができます)

[ マイク (Blue Snowball) ▼]

(→どのマイクを使うかを選択しましょう。)

Gain (入力されたマイクの音の信号の大きさを調整できます)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 2 ]

Threshold Bass (低音域のしきい値)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.05 ]

Threshold Low Mid (低中音域のしきい値)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.05 ]

Threshold Mid High (高中音域のしきい値)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.05 ]

Threshold Treble (高音域のしきい値)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 0.05 ]

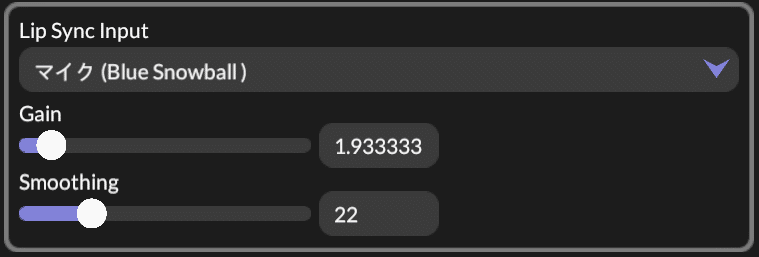

👅マイクの中でもLip syncを使う設定

ちなみに圧倒的にLip syncを使った方がいいです。

Lip Sync Input

[マイク (Blue Snowball) ▼]

(ふだん使っているメインのマイクを選択してください)

Gain (入力されたマイクの音の信号の大きさを調整できます)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 3 ]

Smoothing (入力された口の動きにどのくらいのスムーズさにするかを調整できます)

[IIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIIII] [ 10 ]

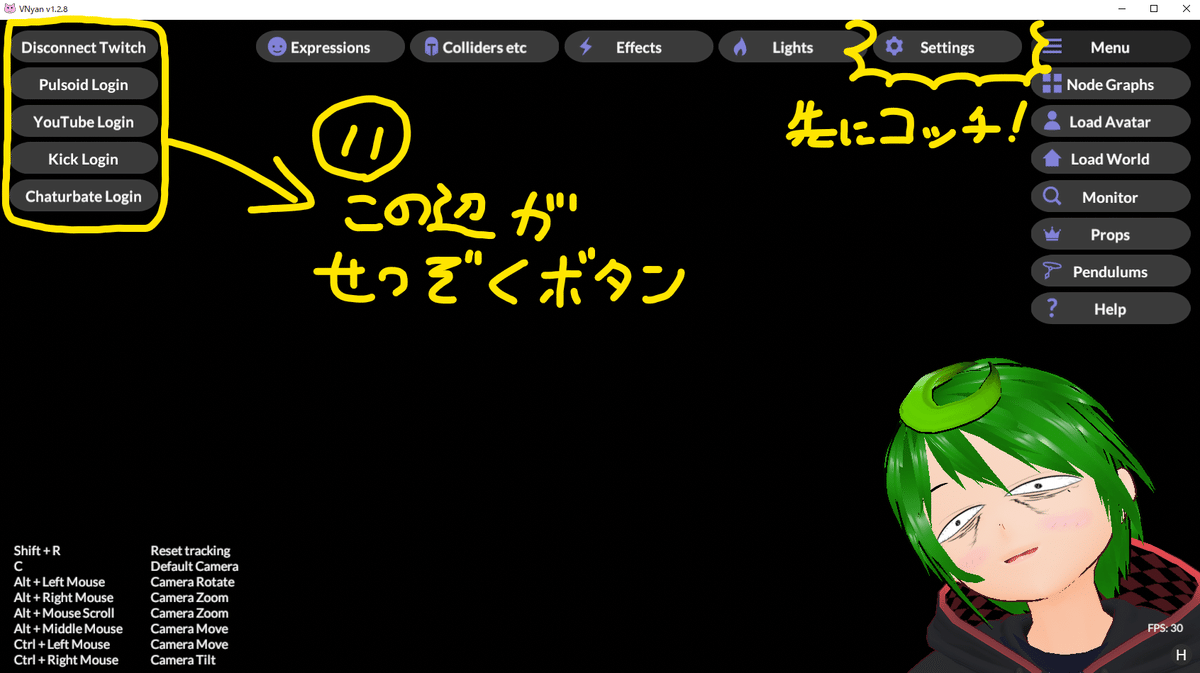

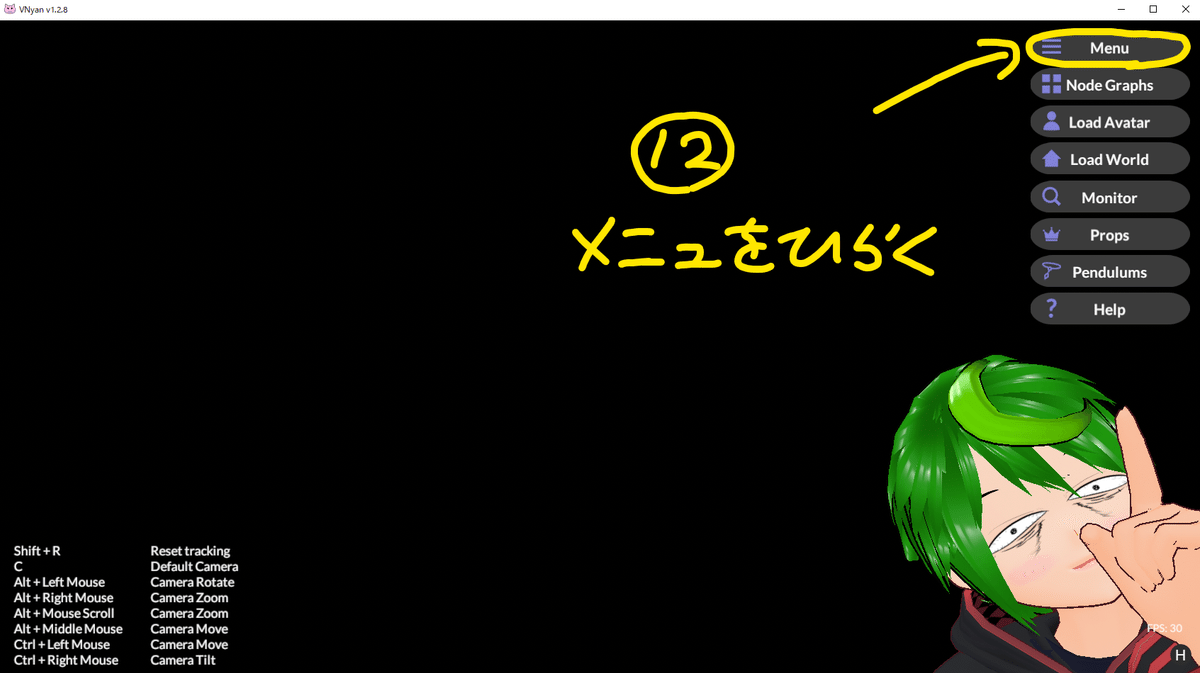

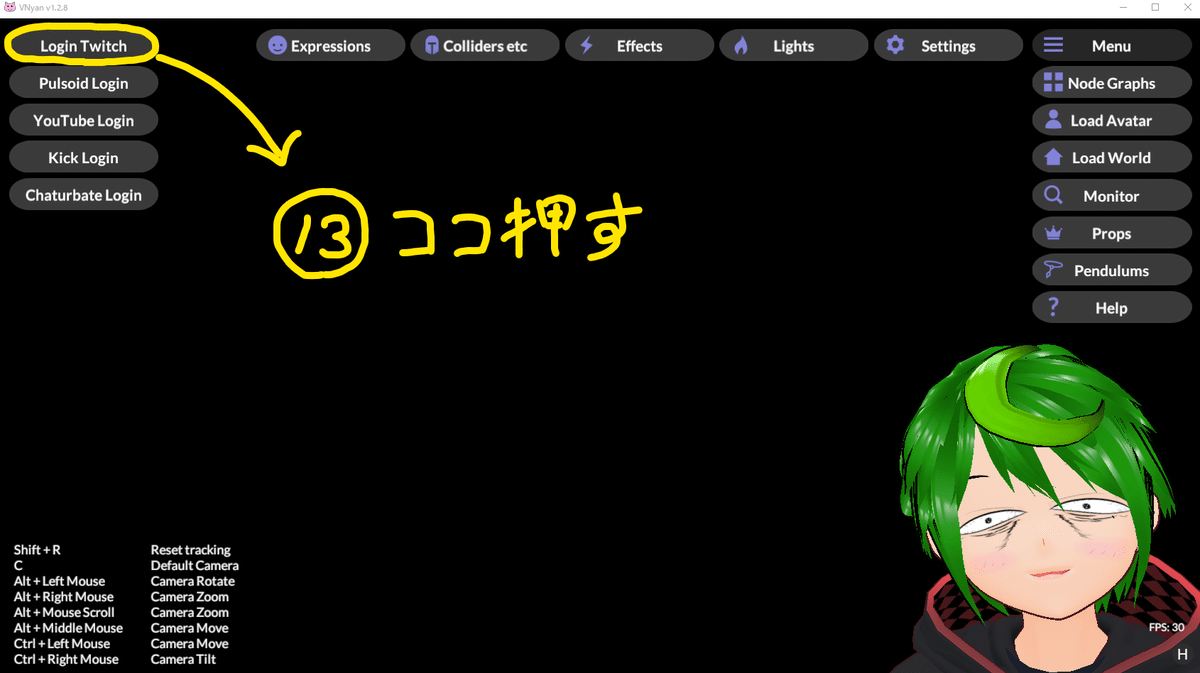

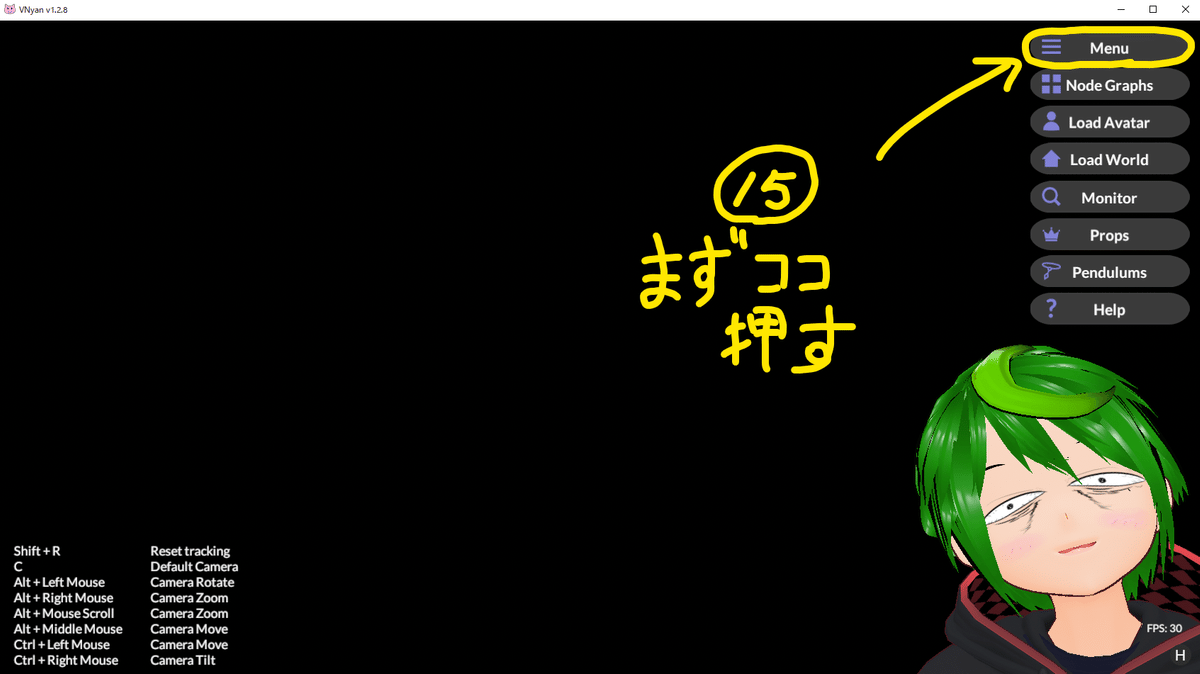

💻配信関係の設定をしよう!

次でようやくこの記事ラストになります。

OBSやTwitch、Youtubeなどの配信サービスとの接続方法を確認しましょう。

まずはTwitchやYoutubeなどの配信サービスとの接続をしましょう

🔌配信サービスとの接続

まずは配信サービスとの接続を行いましょう。

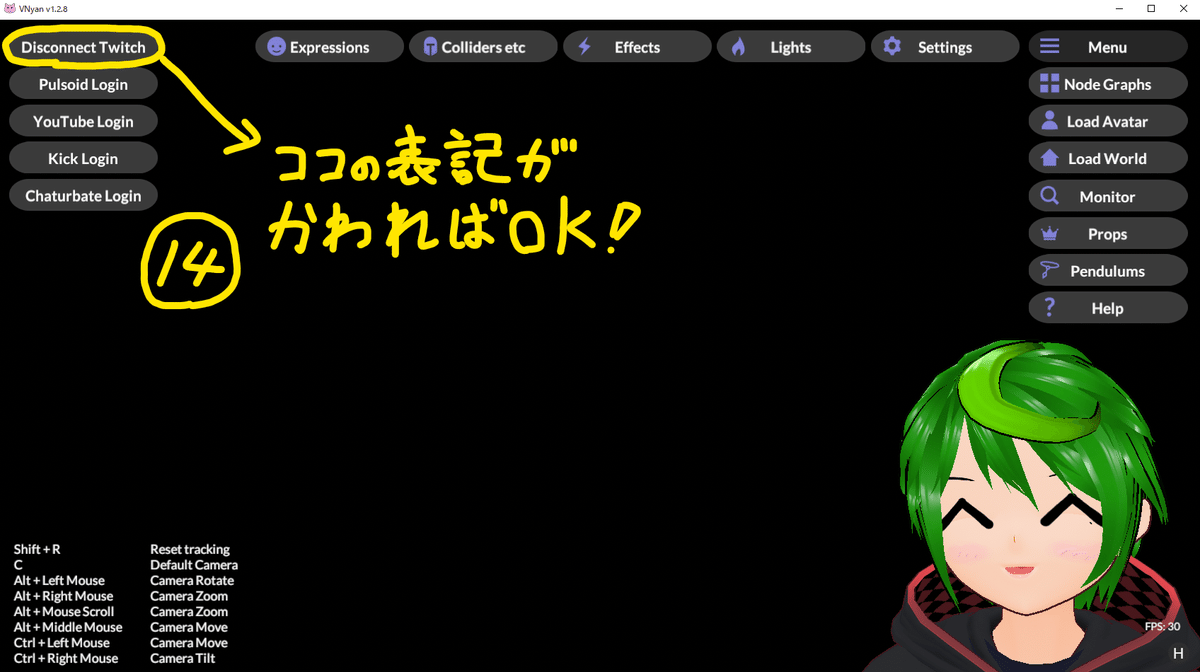

⑪で示した位置が現在接続できる配信サービスです。

接続するには先に(⚙Setting)のところから各サービスの設定をする必要がある場合があります。

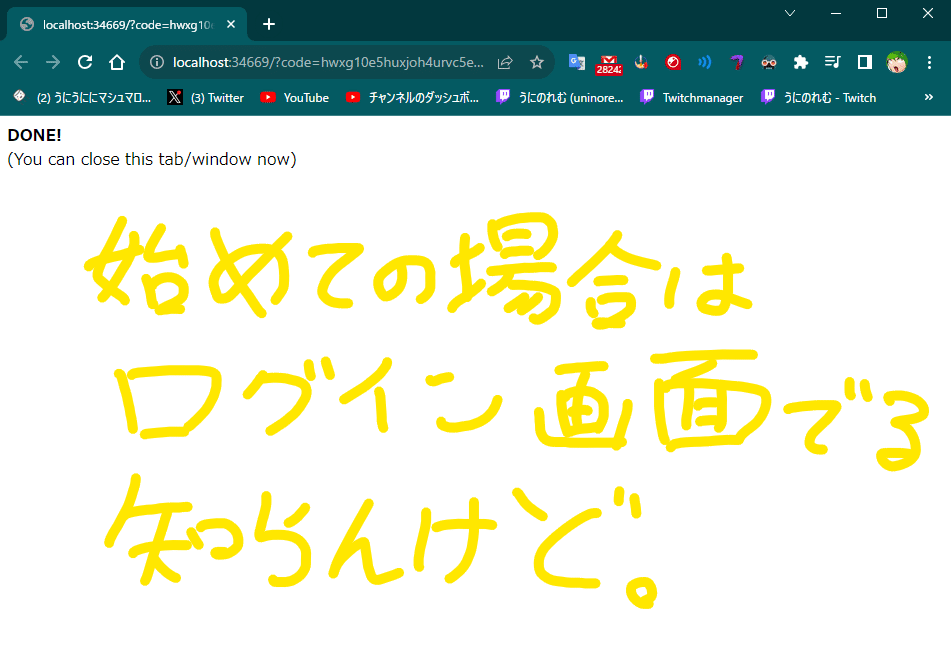

☆Twitchに接続したい場合

Twitchとの接続は比較的簡単です。

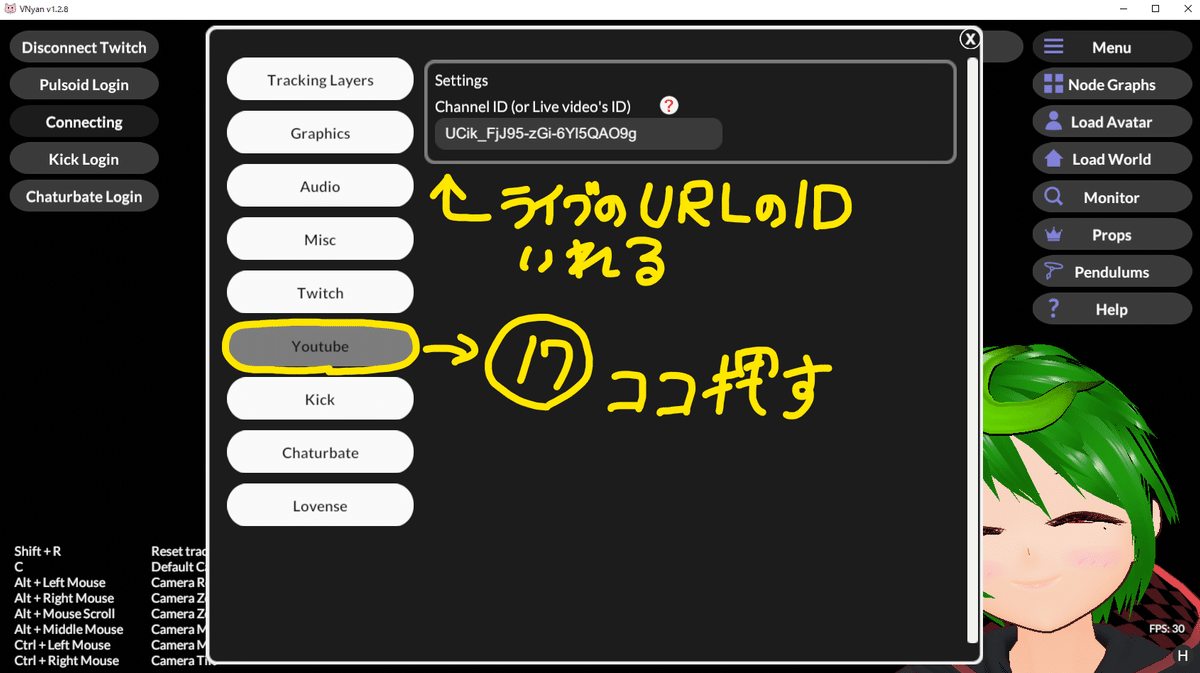

☆Youtubeに接続したい場合

Youtubeとの接続には多少ステップが必要です。

YoutubeのチャンネルのIDを入力する欄があります。基本的には配信毎にURLのIDを入力することになるのであんまり実用的ではないです。

まだつい最近追加された機能である上に、Twitch向けのアプリケーションなので

将来に期待しましょう。

🎥OBSにあなたのアバターを表示しよう!

次に最後の基本的な設定の作業になります。

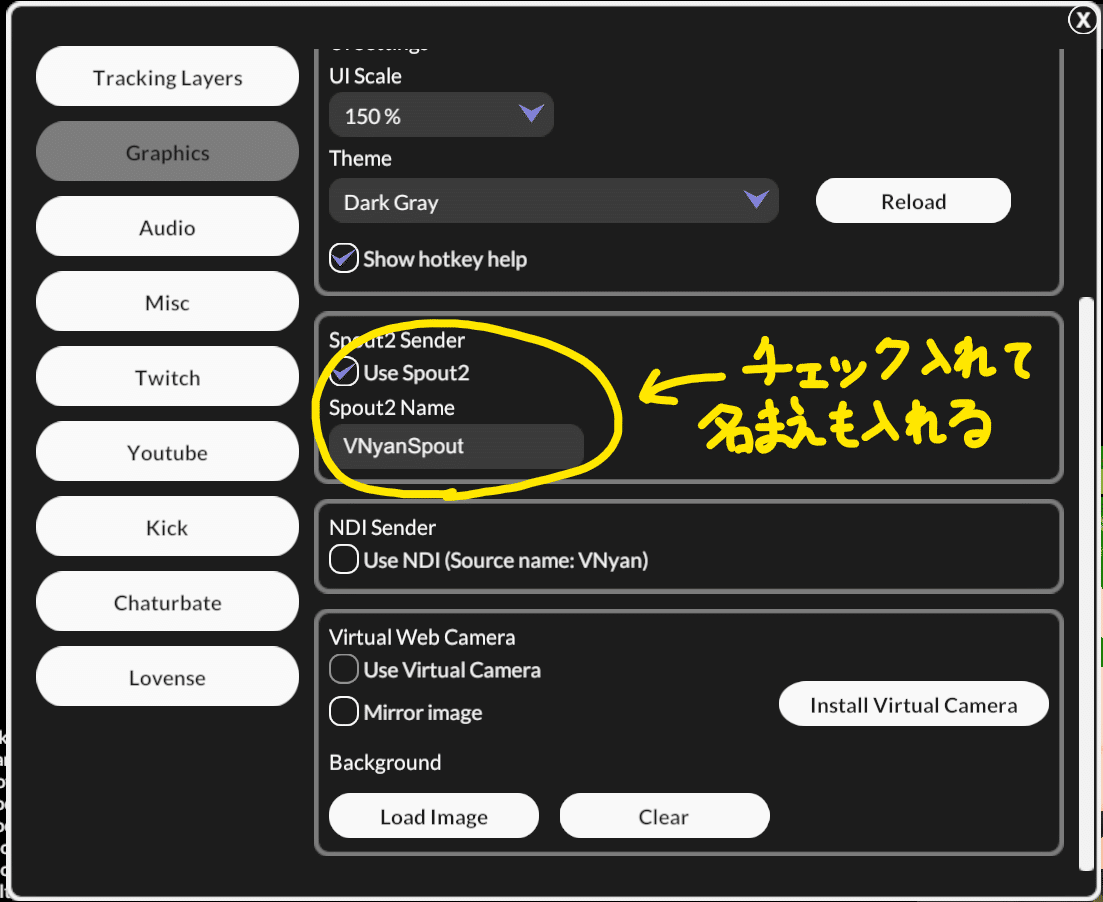

☆Spout2のキャプチャを使ってOBSにVを登場させよう!

まずVnyanでSpout2キャプチャを送るために設定する必要があります。

(Menu)=>(Setting)=>(Graphics)=>(Spout2 Sender)まで進んで、

Spout2 Sender

☑Use Spout2 ←ココにチェックを入れます。

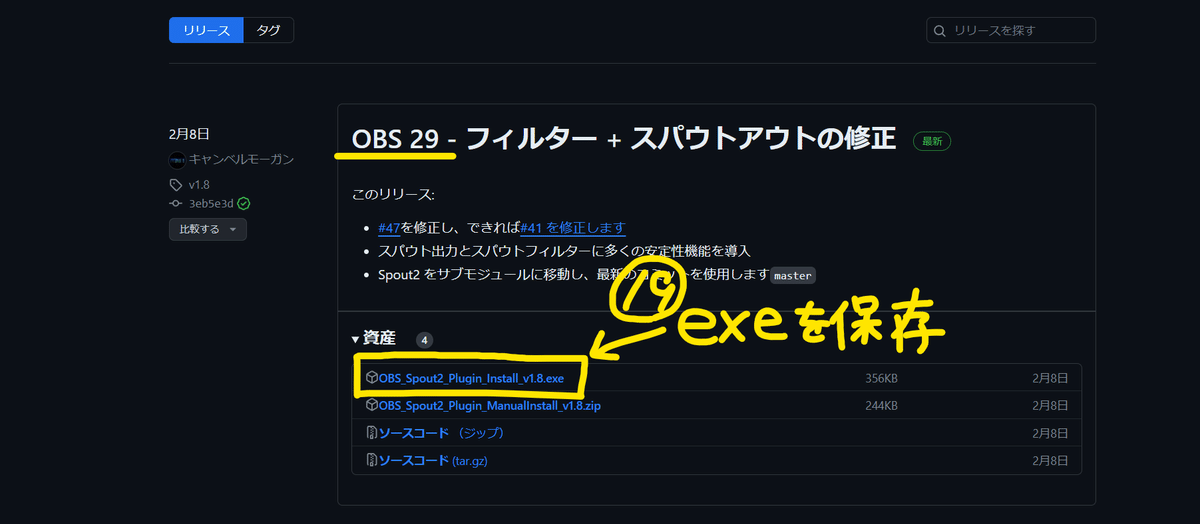

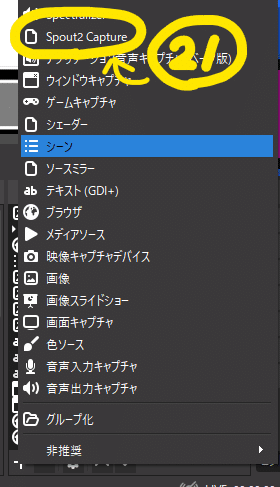

☆OBSでSpout2Captureの導入をする

次に、OBSにSpout2をダウンロードしていない方はダウンロードしてみましょう。すでに導入済の人は飛ばしちゃっても大丈夫です。

https://github.com/Off-World-Live/obs-spout2-plugin/releases

実行しましょう。

OBSのバージョンに合わせたものをダウンロードするのをオススメします!

また、現状であればまだプラグインが対応していないものも多いので

バージョンはOBS 29がおすすめです。

大抵の場合は問題なくダウンロードすることができるかと思います。

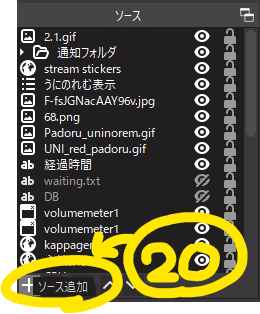

ダウンロードできたらOBSで利用できるか確認しましょう。

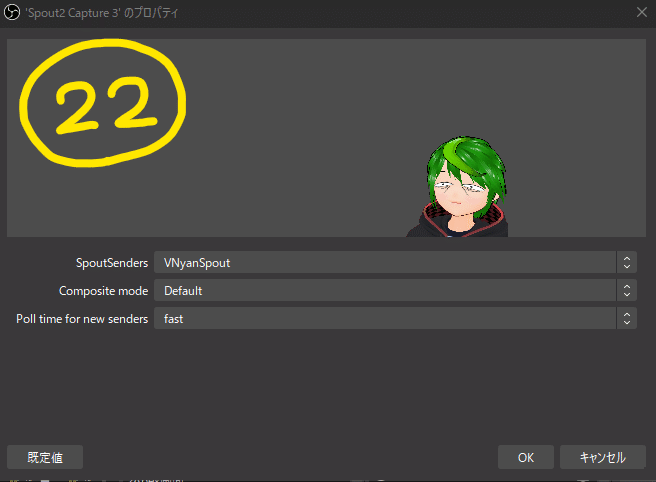

先ほどVnyanの設定で設定した名前が表示されます。

OBSでのSpout2キャプチャのプロパティですが、

SpoutSenders [ 先ほどVnyanで設定した名前を選択 ]

Composite mode [ Default ]

Poll time for new senders [ fast ]

このように設定しておくと良いと思います。

これで配信画面にVroidを表示することができました!

Spout2 captureの中には音声の情報も含まれているので、音声も調整しておくと良いです。音声ミキサーから音声も丁度よく調整しておきましょう。

おわりに

今回はVnyanの入門記事を書こうと思って一生懸命書きました!

わかります。この記事を隅々まで見た方、わかります。

この記事って17000文字以上あるんです。

文字数多すぎます。

このNOTE1つだけで初期設定が済むように、また、わからないところを調べなおさないといけないとかいうめんどくさいことにならないように、全部詰めて説明している記事になってます。

1週間くらい書くのにかかったので、ほめてください!

♡ください!w

うにのれむのTwitch配信先はコチラ(配信中に聞いてもらっても大丈夫だし、Twitchのウィスパーも気軽に送ってください!)

ぜひフォローお願いします!

他の記事に興味がある方はコチラ

お困りで急ぎでない場合はうにのれむのXのDMに直接どうぞ