Stable Diffusionの生成画像にNovelAIのディレクターツール「線画化」と「カラー化」を使って雰囲気を変えてみる話

昨日Xに「NovelAI Diffusionのカラー化はまともに使えたことがない」みたいな投稿をしたのですが、たしかにディレクターツールのカラー化を使って仕上げようとすると微妙になりやすいものの、工程の序盤や中盤に持ってくるなら使い道があるかも?

と思い直して、今朝軽く試してみた生成の流れです。

Stable Diffusion XLで生成する

私がよく投稿している「女の子(翠ちゃん)」と「黒猫(けんぜん先生)」の画像は普段Stable Diffusion XLを使って生成しています。

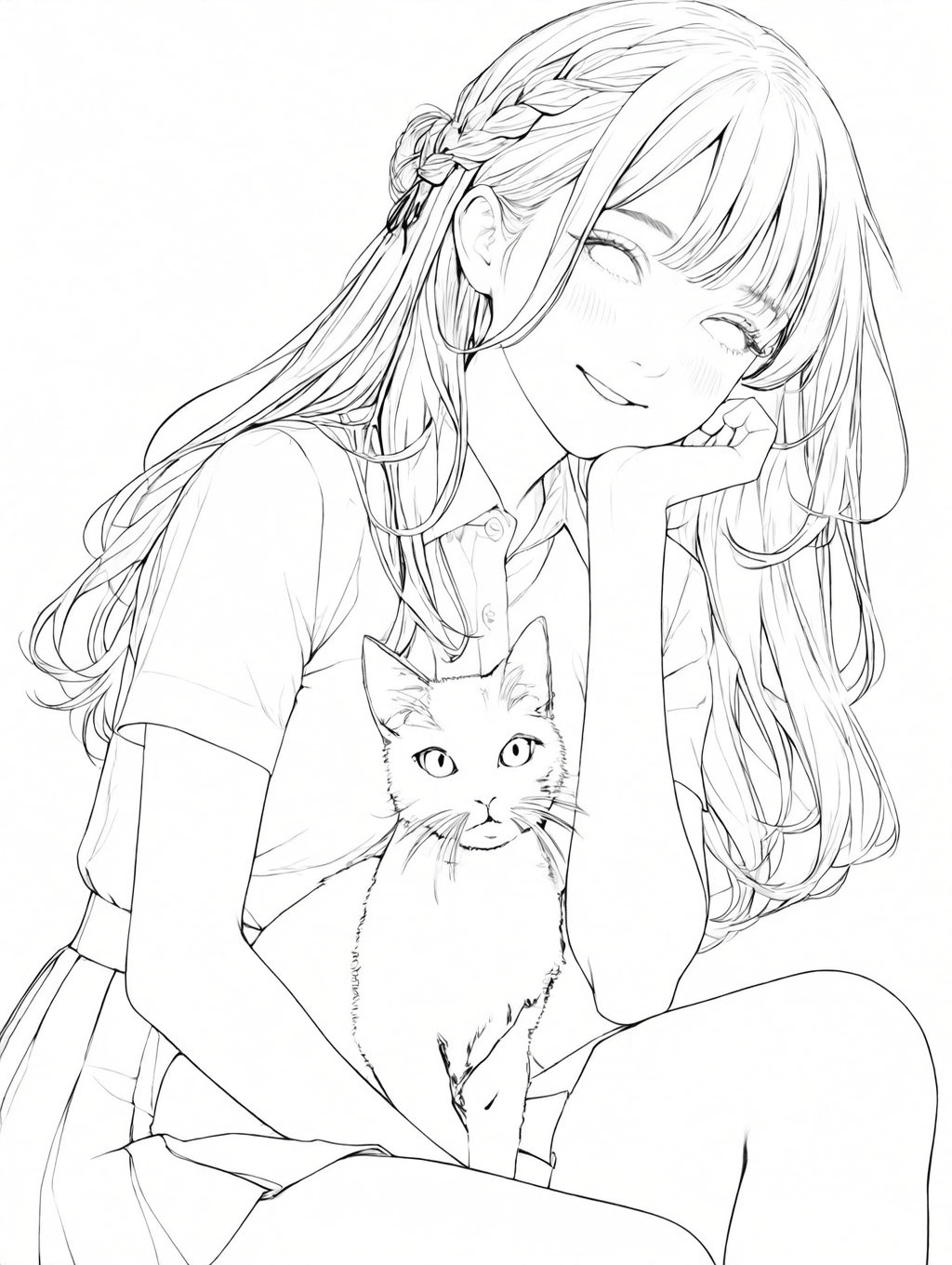

これは今朝、いつも通りに生成した画像です。

NovelAI Diffusionのディレクターツールで線画化

上の画像にNovelAIのディレクターツールを使って線画化します。この段階で背景や天使の輪(ヘイロー)が削除されてしまいます。

NovelAIのディレクターツールでカラー化

線画化した画像を、ふたたびNovelAIのディレクターツールに取り込んでカラー化(着色)します。

この画像をそのまま仕上げていこうとすると、やっぱり全体がのっぺりしていて微妙になりそうなんですよね。(入力するプロンプトによっては、この段階でももっとましになるかもしれませんが)

Stable Diffusion XLにi2iで取り込んで修正

画のタッチは元画像からあまり離したくないので、Stable Diffusion XLにi2iで取り込んで、最初に生成した画像に使ったのとほぼ同じプロンプトを効かせて元画像の雰囲気に近づけます。

※1つ前のNovelAI着色の時点で、ヘイローだけは書き加えて戻しておくべきでした(失念)

niji・journeyで背景画像を生成

消えてしまった背景を元に戻すために、nijijourneyを使って雲の画像を生成します。元画像は暖色が入っていましたが、せっかく変えるならということで青の強い画として作ってみました。

人物と背景を重ね合わせる

先ほどStable Diffusionで調整した画像を再度NovelAIのディレクターツールに取り込んで「背景削除」を使って周囲の白をカットし、nijijourneyで生成した空の画像を左右反転させて重ね合わせます(この作業はProcreateを使いました)。

雲を左右反転させるのは、重ね合わせた際に邪魔になりにくいからという理由もありますが、人物に対して光が右上から当たっているのに雲は左から当たっているのはおかしな印象になるからです。

NovelAIの背景削除はかなり優秀なので、背景がカットされた画像を重ね合わせただけでも輪郭付近にホワイトが残るなどの違和感はほとんどありませんね。

※ちなみに重ね合わせの前段階で人物には明るさの調整を入れています。

Fireflyで日差しを加えて完成

最後に夏の日差しが降り注ぐ雰囲気を加えるため(ついでに背景と人物を馴染ませ

るため)に、PhotoshopのFireflyを用いて日差しとレンズフレアを生成。

人物や雲の光陰に合わせて、Fireflyで生成した画像を拡大・回転させて右上から光が差し込むように配置した後、スクリーン80%程度でレイヤーを重ね合わせて完了です。

元画像との比較

どんな画像にどんなプロンプトを使ってカラー化させるかにもよりますが、生成した画像の雰囲気を調整するために、NovelAIのディレクターツールを使って「線画化」から「カラー化」させる工程を挟むのは有りかもしれません。

Stable Diffusionとは違った生成AIを介することで、色変更が可能な幅は大きくなるように思いました。

その場合、線画化やカラー化でカットされてしまう要素が出やすいので、後半の工程で復活させる作業を挟む必要は生じますね。