Stable Video Diffusionで美女を動かす

みなさまお久しぶりです。

昨今、様々な生成AIが発表されておりますが、みなさまにおかれましては、いじり倒していることかと思います。

そんな中、簡単にimage 2 videoが生成できてしまう【Stable Video Diffusion】という生成AIが「Stability AI」から発表されたので試していきましょう!

1.【Stable Video Diffusion】をGoogle Colabで試す!

①Google Colabの準備

X(旧Twitter)でmkshing@mk1stats さんという有志の方が公開されている

以下のNotebooksを使用します!

Notebooksを開いたら「ドライブにコピーして保存」を選択して、Google Driveに保存してください。

Stable Video Diffusionも早く触りたいでも、リソースやどうやって試せば良いのか分からないという方!

— mkshing (@mk1stats) November 22, 2023

Colabのフリープランで試せるようにハックしました。どうぞお試しください〜。

Colab: https://t.co/SiYDRzLxTA#StableVideo

初期画像は #JSDXL から生成。 https://t.co/RUOY5QBAPD pic.twitter.com/CplEznLsJ2

②起動手順

Notebooksを開いたら【ランタイム→すべてのセルを実行】を押して待つだけです。

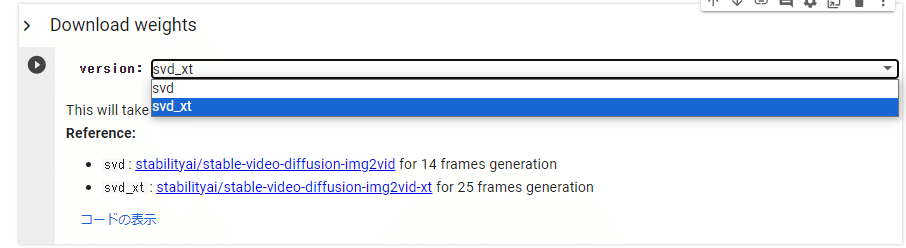

その中で、選択項目として「Download weights」というセルで動画生成時のモデルを選ぶことが可能です。

・SVD :14フレームの動画を生成

・SVD-XT:25フレームの動画生成に特化

そして、しばらく待っていると【Do the Run!】というセルの中に、URLが出てくるのでそちらをクリック。

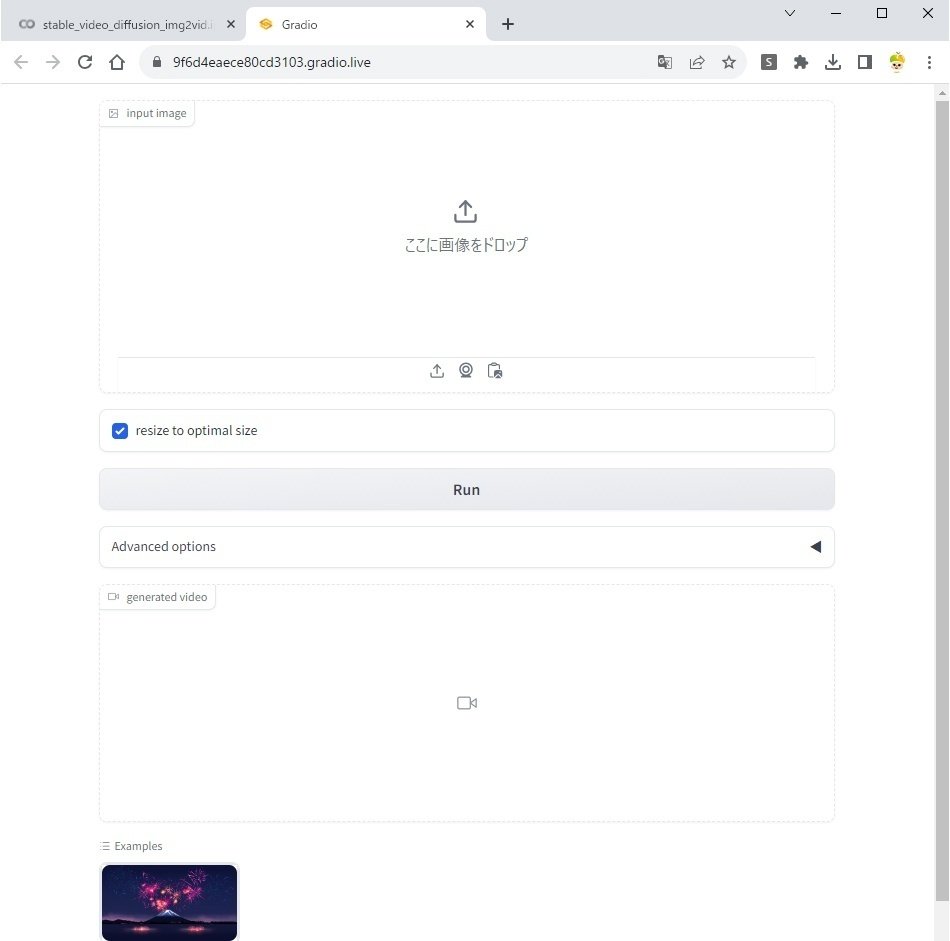

すると、以下のWebUIが起動します!

※Notebooksのセル内でもできるみたいです。

2.美女を動かしてみよう

①手順

WebUIが起動したら、動かしたい美女の画像を「input image」に配置

※今回は、【AI女子高生】安城エアロ(Aero Anjoh) ちゃん @AI_images_labo を動かしてみます!

◆解像度 は、576x1024 で生成されるように学習されています!

配置ができたら、どりあえず【Run】のボタンをクリック!

※「resize to optimal size」にチェックを入れて最適なサイズにリサイズしましょう。

Google Colabで使用するGPUによって生成時間が異なります。

V100だと2分程度で生成できます。

※T4以上は有料じゃないと使えません!

出来上がった動画がこれ!

エアロちゃんが動いてる!

— 【AI女子高生】安城エアロ(Aero Anjoh) (@AI_images_labo) November 30, 2023

※動いてない#AIaet #AImovie #AIイラスト #AI動画 #AI女子高生 #安城エアロ #StableVideoDiffusion pic.twitter.com/Hvhu1cZaI4

被写体が動いているというより、奥行きを活かして立体的に見せるような動きになっていますね!これはこれで、演出効果として良いですね♪

WebUI上では以下のように生成されますので、赤丸の中のダウンロードボタンをクリックするとローカルに保存できる仕様となっています。

他にもこんな感じで作ってみました!

レトロギャング娘のエアロちゃん☺️

— 【AI女子高生】安城エアロ(Aero Anjoh) (@AI_images_labo) November 30, 2023

ちょっとだけ動かしてみました!

モカ様の衣装好きすぎます🩷#AIaet #AImovie #AIイラスト #AI動画 #AI女子高生 #安城エアロ #StableVideoDiffusion https://t.co/4oQllTSqM7 pic.twitter.com/8LC2d3G0mo

余談ですが、衣装に使用させていただいている モカMelody Mocha様の衣装はどれも素敵で、プロンプトも公開されている素晴らしき御方なので、是非みんさんもチェックしてみてください♪

3.設定について

最後に、以下の赤丸内の「Advanced options」について説明します。

プルダウンを展開するとこんな感じ↓

それぞれを解説すると ※ほとんど解説になってない(笑)

・number of frames → 動画のフレーム数

・number of steps → 生成時のステップ数

・seed(integer or 'random') → シード値の指定

・number of frames decoded at a time→ 1度にデコードされるフレームの数

というようになります。

「number of frames」に関しては、選んだモデルの推奨値で良いかと。

「number of steps」は、“31”以上は、反映されない仕様かな?

「seed」についても、整数でいくつか固定してみましたが、大きな変化は見られませんでした。

「number of frames decoded at a time」については、大きくするとRAMへの負担が大きくなり、メモリオーバーのエラーで生成できなくなりますので、デフォルト値固定で良いかと思います。

4.まとめ

ということで、「Stable Video Diffusion」で美女を動かしてみました。

一言でいうと、めっちゃ簡単!だけど、動きもそれなり!という感じです。

まだまだ、進化過程なので、この生成AIが登場しただけでも素晴らしいことですし、自分の生成した画像たちが動き出すのは感動ものですね!

他にも、Gen-2などの動画生成AIが有名ですが、様々な生成AIを使い分けて、オリジナルの創作物を作り上げていきたいですね。

※Gen-2のMotion Brushで生成したテスト動画

それでは、以上になります!

参考になりましたら、“スキ”や”フォロー”をよろしくお願いいたします。