【NVIDIA】Chat With RTXを導入してみた

【重要】

GPUがRTX30以上、VRAM(8GB)以上でないと動かせませんでした。

【使用したスペック】

OS:Windows11

CPU:Intel Core i7-13700F

GPU:GeForce RTX 4070Ti

Chat With RTXとは?

大規模言語モデル (LLM) をローカルPCにあるコンテンツ (ドキュメント、メモ、映像、その他のデータ) に接続し、内容をチャットできるデモアプリ。

ダウンロード

以下のURLからダウンロードします。

約35GBなので時間を要します。

セットアップ

ダウンロードしましたら、zipを解凍します。

中にある「setup.exe」をダブルクリックして実行します。

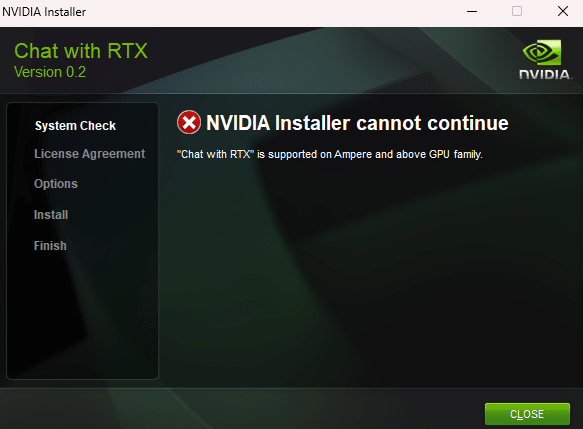

ここで落とし穴があります。

要件を満たしてないと、以下のような画面が表示されこれ以上続けらません。

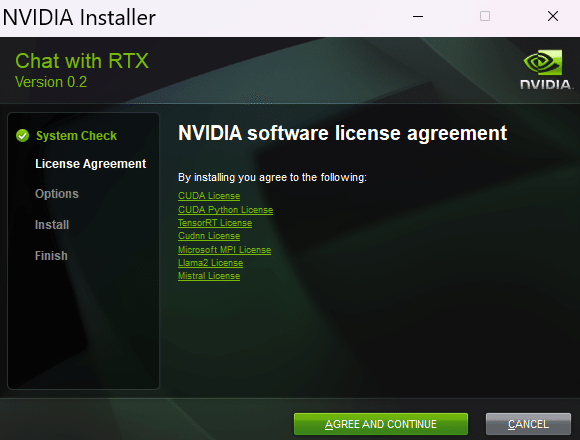

要件を満たすと以下のように次に進めます。

見事、要件を満たした方はそのままインストールを進めていきましょう。

インストールは以下の記事が参考になりました。

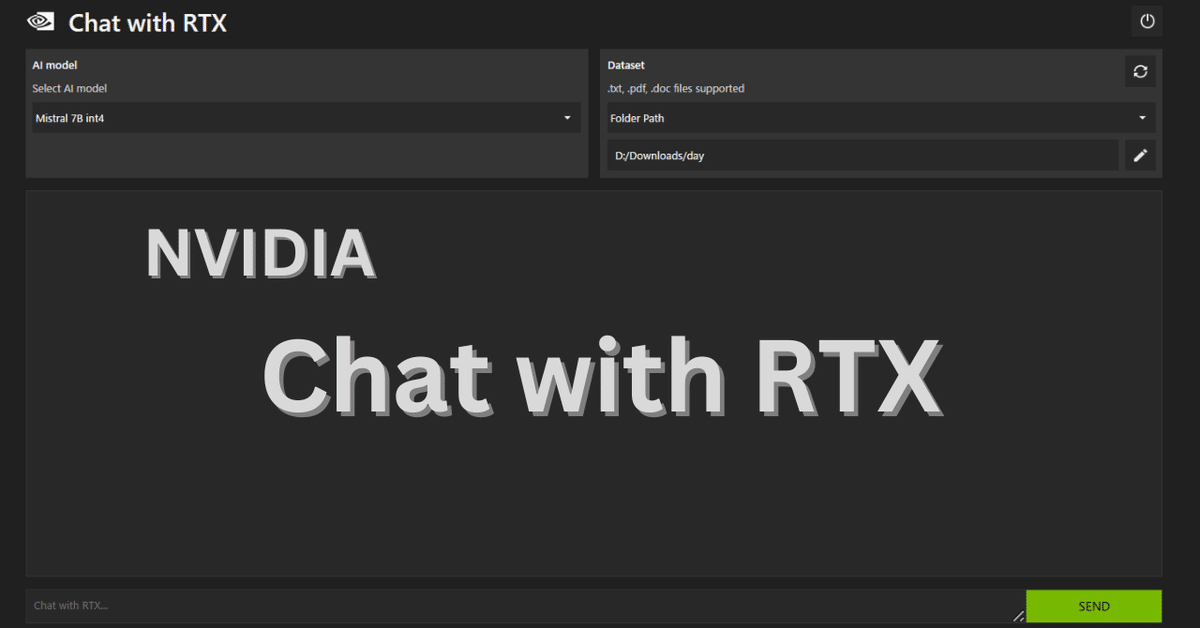

Chat With RTXを起動する

インストール先のフォルダに行きます。(私は、Cドライブ直下に入れてみました)

"C:\ChatWithRTX\RAG\trt-llm-rag-windows-main\app_launch.bat"app_launch.bat をダブルクリックするとChat With RTXが立ち上がります。

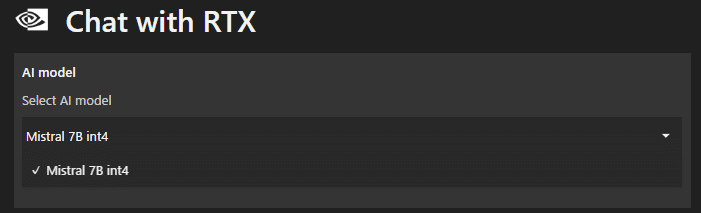

モデルを選択

左上のAI modelからモデルを選択できます。今回インストール時に入っていましたMistralを選択します。

データセットを選択する

右上のDatasetから、「Folder Path」「YouTube URL」「AI model default」を選択できます。

ローカルフォルダーのデータでチャットする

Folder Pathを選択し、鉛筆✐マークをクリックするとエクスプローラーが起動します。チャットしたいデータが入っているフォルダを選択します。

テキスト、PDF、doc/docx、xml などファイル形式が対応しているようです。(png、jpegのような画像ファイルはデータとして認識されませんでした)

LLMとチャットする

チャットしたいデータを選択しましたら、下のチャット欄に文章を入力します。

試しに、「テキストの内容を見せて」と英語で送ってみます。「SEND」ボタンをクリックして送信します。

Show me what this text says.

LLMから回答がきました。ブラウザで起動しているのでGoogle翻訳しています。

ちなみにフォルダーを読み込ませて会話すると、同じ場所にvector_embeddingフォルダーが作成されています。

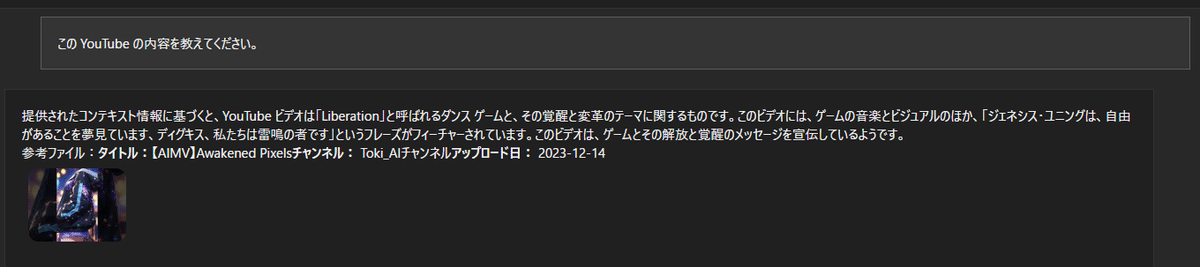

YouTubeの内容についてチャットする

YouTube プレイリストの URL を指定すると、アプリがプレイリスト内のビデオの文字起こしをロードし、カバーされているコンテンツを質問できるようになります。

Dataset欄からYouTubeのURLを入力します。

それから右のダウンロードボタンのようなものをクリックします。

ダウンロードしたデータは左上の📁マークから確認できます。

ファイルの場所は以下になります。

C:\ChatWithRTX\RAG\trt-llm-rag-windows-main\youtube_datasetxmlファイルが入っていればダウンロードできています。

チャット欄に文章を書いて、「SEND」ボタンをクリックします。

今回は、「このYouTubeの内容を教えて。」と送りました。

Tell me what this YouTube is about.うまく回答されました。

Chat With RTXを終了する

画面右上の電源ボタンをクリックすることで終了します。

コマンドプロンプトもまだ起動していますので、そちらも終了させます。

起動しているコマンドプロンプトも何かキーを押して終了させます。

注意点

会話を終了させて、別のデータを読み込ませても過去のデータを引っ張ってきている感じがしました。データを消去させる方法が見つかっていないです。先ほどのvector_embeddingフォルダーを削除してもダメでした…

まとめ

チャットのやり取りはそれほど遅延がなくサクサク回答していた。

要求スペックとデータサイズが大きいので導入するには少しハードルが高い気がしました。

導入すれば、色々と試せそうなのでぜひ要件を満たしている方は試してみてください。