絵描きがAIをイラスト製作に取り入れてみた【ワークフロー紹介】

はじめに

趣味で絵を描いているsuibariです。

イラスト生成AIが急速に発展しています。

生成AIの中でもイラスト分野は特に物議を醸していますが、ChatGPTの様に、うまく使えば人間の創作活動をサポートしてくれる存在ではないかと思っています。

本記事では、絵描きとイラスト生成AIの共存、あと自分への備忘録を目的に、イラスト生成AIを絵描きワークフローに取り入れてみた内容と感想を共有します。

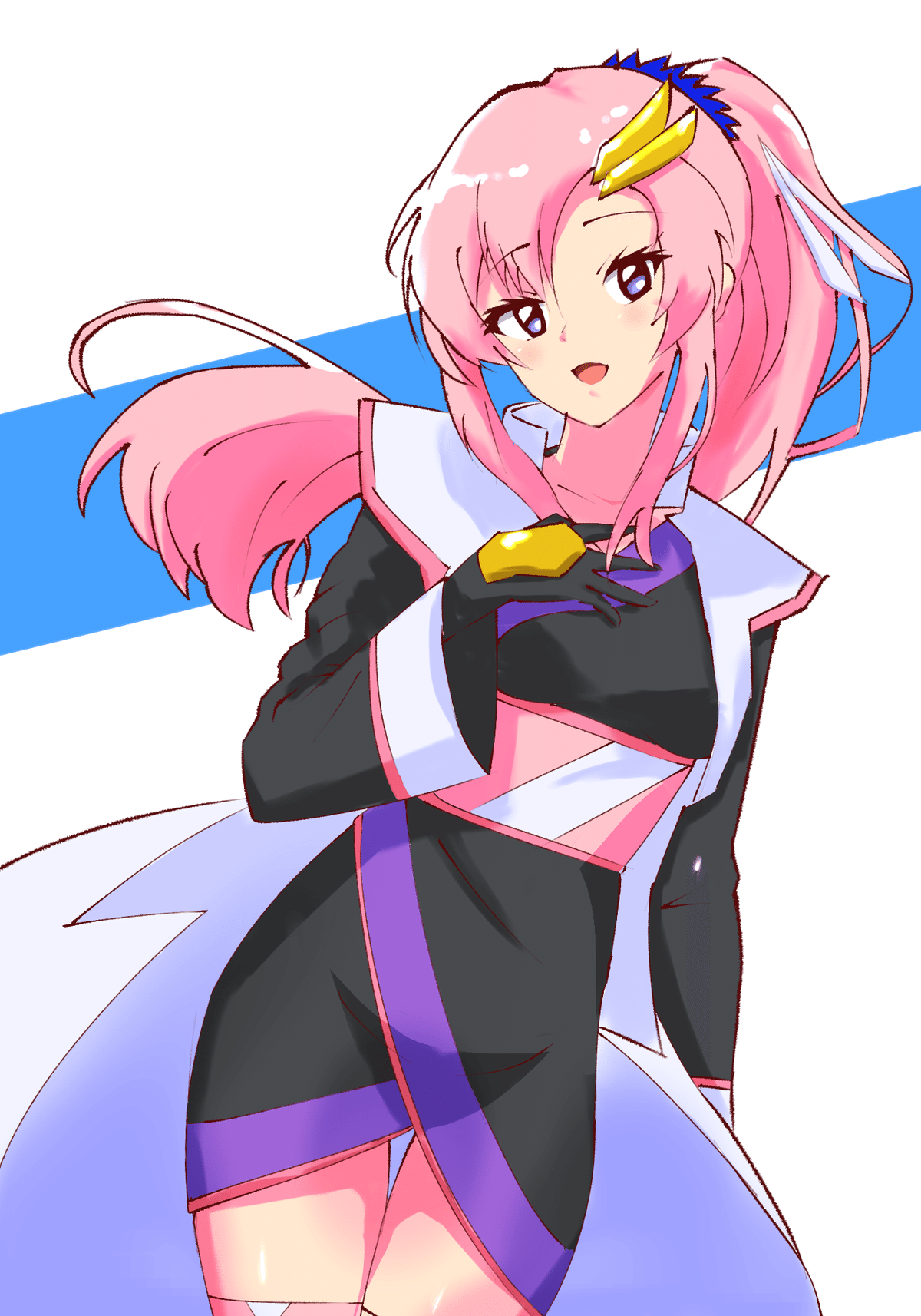

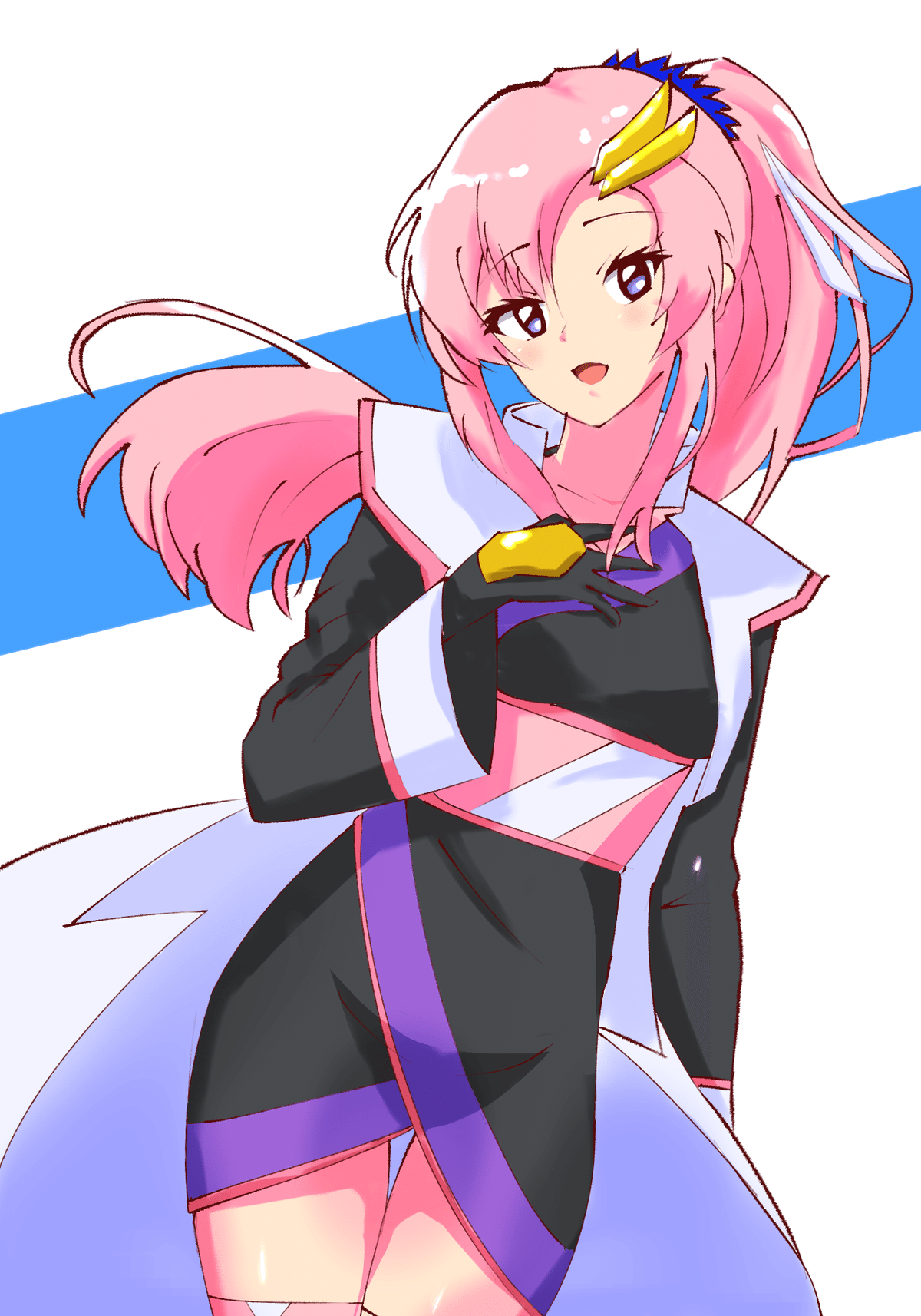

完成品

以下が本記事のワークフローで完成させたイラストです。

ワークフロー

前提

前提として、今回説明するワークフローはある程度一からイラストを描けないと適用できないものですのでご承知おきください。

ポーズマニアックスなどの人形を自分の描きたいものに変換して描けるなら適用できると思います。

自分はローカルにStable Diffusion WebUI環境を構築しています。

以下にPCスペックを記載します。

CPU:Intel Core i5 12400F

RAM:DDR5 32GB

GPU nVIDIA RTX3060Ti GDDR6X VRAM8GB

Strage:M.2 NVMe 1TB

Power:850W GOLD認証

自分は以下のフローでイラストを描いています。このフローに沿って説明を進めます。

AIを使用したところにはAI使用と書いておいたので、そこだけを見たい方は飛ばしてご覧ください。

構図決め(AI使用)

ラフ

線画(AI使用)

下塗り

1影&2影&ハイライト(AI使用)

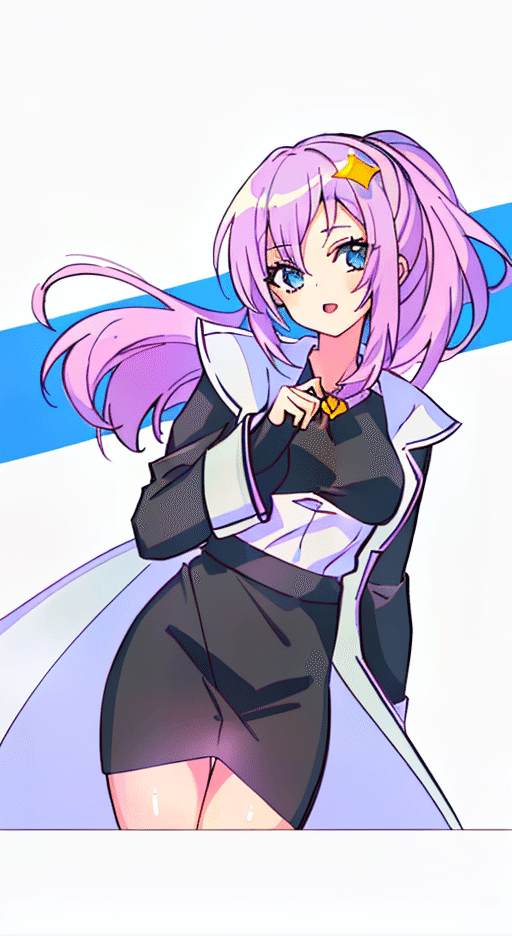

構図決め(AI使用)

構図決めは普段は脳内かポーズマニアックスで行っていましたが、AIを使用してみました。

以下がAI生成の構図です。プロンプト、パラメータも併記します。

masterpiece, best quality, 1girl, lacus clyne, cowboy shot, action, open coat, singing, hand on chest

Negative prompt: EasyNegative

Steps: 20, Sampler: Euler a, CFG scale: 7, Seed: 3799102519, Size: 512x680, Model hash: d17ace4d35, Model: yden_v2, Version: v1.2.1

ポーズは完成品とまったく同じということが分かると思います。

プロンプトが良かったのか、髪型も描きたかったラクスとほぼ同じです。

大まかに、衣装全般、眼を直せばよさそうだと分かりました。

ラフ

ラフは自分で描きます。

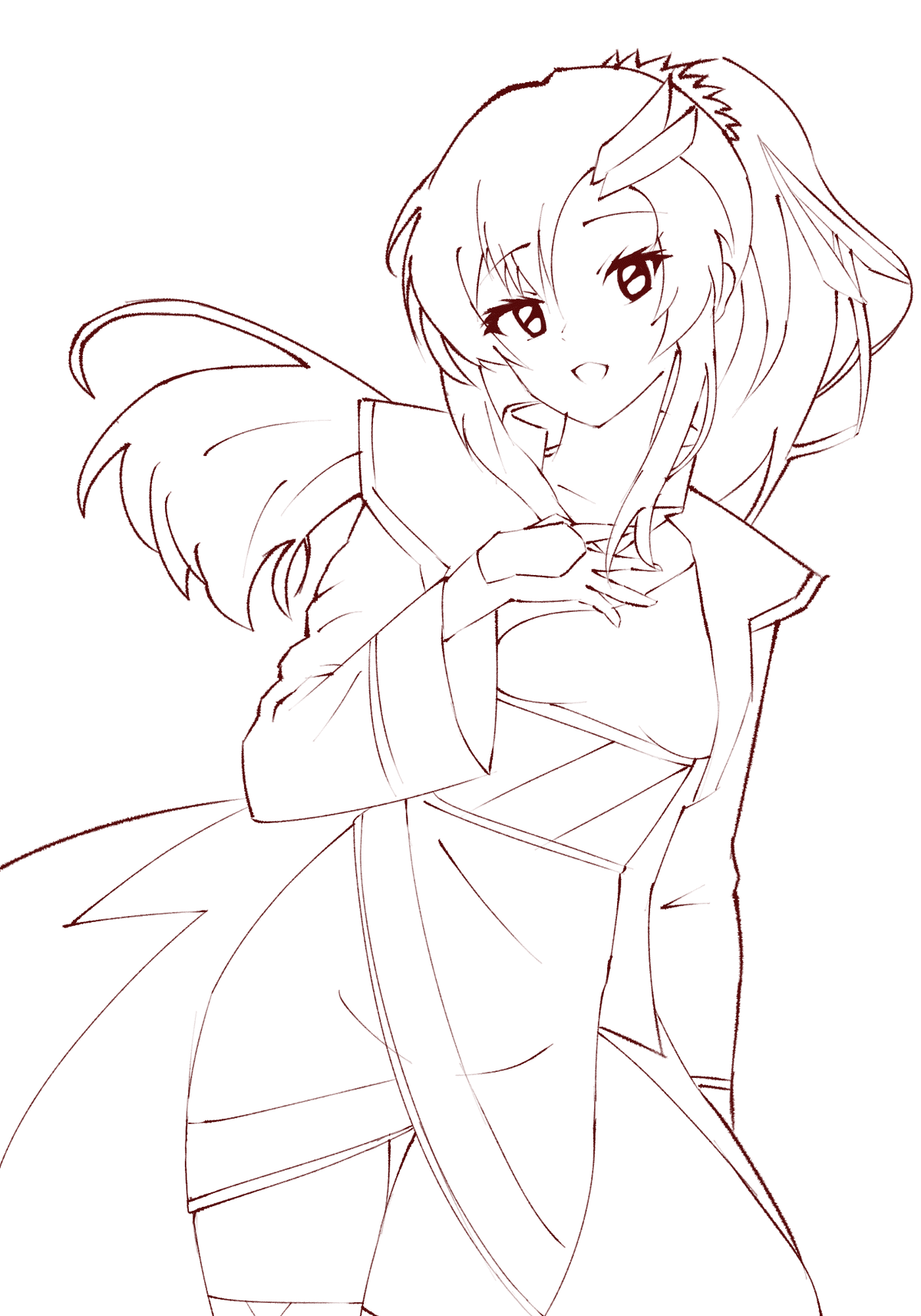

線画(AI使用)

ラフを一度AIに食わせ、その出力物を参考にしつつ線画を描きました。

AI出力線画と線画が以下です。

masterpiece, best quality, 1girl, lacus clyne, cowboy shot, action, open coat, singing, kimono, ponytail, hand on chest

Negative prompt: EasyNegative

Steps: 20, Sampler: Euler a, CFG scale: 7, Seed: 3564466063, Size: 512x712, Model hash: d17ace4d35, Model: yden_v2, Version: v1.2.1,

ControlNet 0: "preprocessor: tile_resample, model: control_v11f1e_sd15_tile [a371b31b], weight: 1, starting/ending: (0, 1), resize mode: Crop and Resize, pixel perfect: False, control mode: ControlNet is more important, preprocessor params: (512, 1, -1)"

下塗り

下塗りです。

こういうこまかく色を置いていく工程は、生成AIにはまだ難しい印象なので、なんというか、やりがいを感じます。

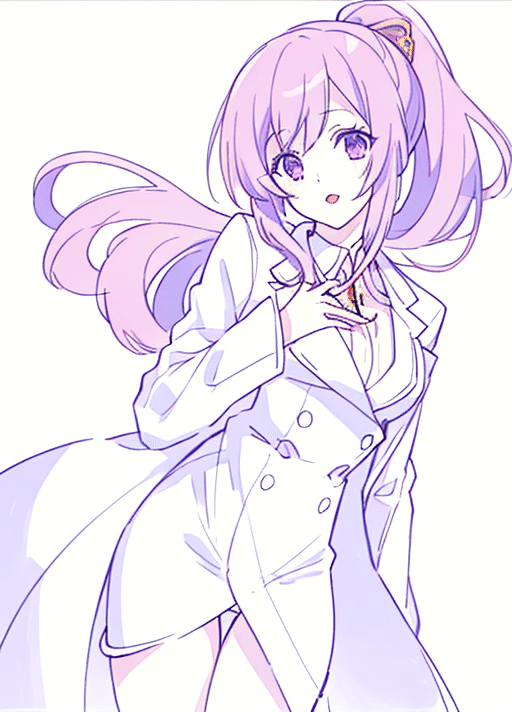

1影&2影&ハイライト(AI使用)

まず下塗りをAIに食わせます。(この時点でうますぎて心折れる)なんか髪飾りがミーアになってたりしてますが気にしない。

masterpiece, best quality, 1girl,

Steps: 20, Sampler: Euler a, CFG scale: 7, Seed: 821621923, Size: 512x936, Model hash: d17ace4d35, Model: yden_v2, Version: v1.2.1,

ControlNet 0: "preprocessor: tile_colorfix, model: control_v11f1e_sd15_tile [a371b31b], weight: 1, starting/ending: (0, 1), resize mode: Resize and Fill, pixel perfect: False, control mode: ControlNet is more important, preprocessor params: (-1, 8, 1)"

上記AI出力物の中で特に影、ハイライトを参考にして自分で描きました。

完成品を再掲しておきます。

おわりに

読んでいただきありがとうございます。

イラストへのAI組み込みワークフローの感想としては以下です。

スピード、正確性が向上し、作業手戻りが減る。とてもいい。

構図へのAI組み込みはポーズマニアックス進化版な印象。版権キャラをそのまま登場させるのは現状難しいが、例えば着てる服の雰囲気とかをプロンプトで指定できる。ポーズマニアックスでそれっぽい服を着せれるような感じ。

線画・影付けは、主にシワとか細かい影とかが参考になる。

AIが出力する完成品があまりにも上手い(やる気がそがれる)のが難点。結果ではなく過程を示してほしい。

補足:AIイラストの定義は?

こうしてAIサポートを受けて作ったイラストが、いわゆる「AIイラスト」に当てはまるかどうかの懸念について話したいです。

結論から言えば自分は、当てはまらないと考えています。

まずはPixivの定義を。

制作過程のすべて、もしくはほとんどをAIによって生成された作品。

例えば、テキストや画像などのフォーマットを問わず、一定の指示を元に生成されたリソースをそのまま、または組み合わせて、あるいは軽微な加工や修正を経て投稿する場合。

あいまいな表記ではありますが、AI出力物をほぼそのまま使ったものと定義されているようです。

世間一般の解釈が知りたかったのでtogetterも見てみました。(2万票以上の票数のアンケートですが、フォロワーの意見にバイアスがかかっている可能性もあるので参考程度にされてください)

背景は自分 キャラはAIの絵は「AI絵である」

構図はAI 手直しは自分の絵は「AI絵でない」

構図は自分 出力はAIの絵は「AI絵である」

やはり、世間一般的にもAI出力物を主題にそのまま使っていればAIイラストという見方のようです。

ワークフローにAIを組み込み、そのフロー中でもAIの出した出力物を参考にしか使っていなければ、完成品はAIイラストでないというのが自分の見解です。