大規模視覚言語(VLM)モデルとは?

概要

近年、人工知能(AI)の分野で注目されている技術の一つに、大規模視覚言語モデル(Vision Language Model, VLM)があります。この技術は、視覚情報(画像や映像)とテキスト情報(言語データ)を統合的に処理し、理解することを目指しています。

VLMは、画像認識や自然言語処理(NLP)の技術を組み合わせることで、これまでにない高度なタスクを実現することが可能です。

本記事では、大規模視覚言語モデルの基本的な概念、技術的な背景、応用例、および今後の展望について詳しく説明します。

1. 大規模視覚言語モデルの基本概念

大規模視覚言語モデルは、画像や映像といった視覚情報と、テキストや音声といった言語情報を同時に理解し、処理するAIモデルです。具体的には、以下のようなタスクを実現します。

画像キャプション生成: 画像の内容を説明するテキストを生成する。

視覚質問応答(VQA): 画像に関する質問に対して適切な回答を生成する。

画像検索: テキストを入力してそれに関連する画像を検索する。

シーン理解: 画像内の物体や状況を認識し、その意味を理解する。

これらのタスクを実現するために、VLMは視覚情報と言語情報を同時に処理する能力を持っています。

2. 技術的な背景

大規模視覚言語モデルの基盤となる技術には、以下のようなものがあります。

畳み込みニューラルネットワーク(CNN): 画像認識に特化したニューラルネットワークで、視覚情報の特徴を抽出するのに使われます。

トランスフォーマーモデル: 言語情報の処理に優れたニューラルネットワークで、特に自己注意機構を用いて文脈情報を捉えることができます。

マルチモーダル融合技術: 視覚情報と言語情報を統合的に処理する技術で、両者の特徴を効果的に融合するために使われます。

これらの技術を組み合わせることで、VLMは画像とテキストの両方を高度に理解し、関連付けることができます。

入力画像の全体に対して畳み込み層でフィルター処理を行い、プーリング層で一定領域から1つの値を抽出。その後に全結合層で結合する。

3. 応用例

大規模視覚言語モデルは、様々な分野で応用されています。以下に主な応用例を挙げます。

デジタル広告: 広告クリエイティブの自動生成やターゲティングに利用されます。例えば、ユーザーの興味に基づいて最適な画像とキャプションを生成することで、広告の効果を高めることができます。

医療分野: 医療画像の解析や診断支援に利用されます。医師が撮影した画像に基づいて、疾患の可能性を自動で指摘したり、説明文を生成することができます。

eコマース: 商品検索やレビュー生成に利用されます。ユーザーが入力したテキストに基づいて、関連する商品の画像を表示したり、商品説明を自動生成することで、購買体験を向上させます。

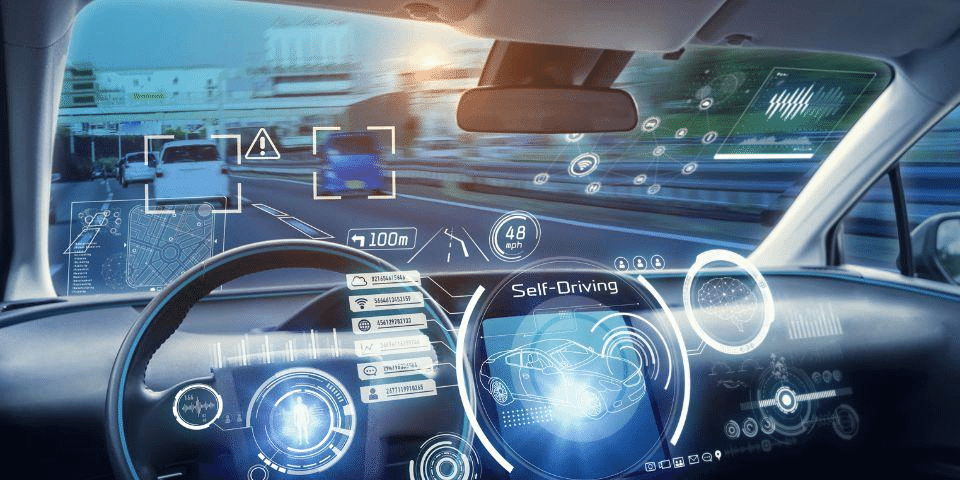

自動運転: 車載カメラで取得した映像と交通標識や道路状況に関するテキスト情報を統合して、自動運転システムの精度を向上させます。

4. 今後の展望

大規模視覚言語モデルは、今後さらに進化し、より多くの分野での応用が期待されています。以下にいくつかの展望を示します。

高度な対話システム: 視覚情報とテキスト情報を統合した対話型AIシステムの開発が進むでしょう。これにより、人間と自然な形でコミュニケーションを取ることができるようになります。

教育分野での活用: 視覚言語モデルを用いた教育ツールが開発され、生徒の理解を深めるためのインタラクティブな教材が提供されるでしょう。

エンターテインメント: 映画やゲームにおいて、視覚情報とテキスト情報を統合した新しい体験が提供されるでしょう。例えば、ゲーム内のキャラクターがプレイヤーの質問に対してリアルタイムに回答することが可能になります。

5. 結論

大規模視覚言語モデルは、視覚情報とテキスト情報を統合的に処理し、理解することで、多様なタスクを実現するAI技術です。

この技術は、デジタル広告、医療、eコマース、自動運転などの分野で既に応用されており、今後さらに多くの分野での利用が期待されています。技術の進化に伴い、より高度な対話システムや教育ツール、エンターテインメントの分野での革新が進むでしょう。

大規模視覚言語モデルの開発と応用は、AI技術の新たな可能性を切り開き、社会に多大な恩恵をもたらすことが期待されています。これからも技術の進化に注目し、様々な分野での活用を探っていくことが重要です。

参考文献

おすすめ記事

#半導体 #半導体関連 #半導体株 #半導体って何 #半導体の基礎

いいなと思ったら応援しよう!