みんなVになれよ(再編集版)

■まえがき

3Dモデルをアバターとして使いながら楽しく配信するための手引きです。

友人・知人・親しいフレンド・フォロワーに向けて書いた記事を再編集したものです。このエントリでは「予算がない」「マシンパワーが弱い」状況を考慮しません。以下の本文は基本常体で記します。

2024年11月 再編集を完了しました。古い内容も残っていますが古いなりに役立つだろうと判断したところはそのままにしてあります。また、アバター改変についての記述は本エントリには不要と判断し削除しました。

■用意するもの

・ゲーミングPC(必須)

マシンパワーはすべてを解決する 強ければ強いほどいい

この土台のパワーがV体稼働の強さになる

単なるゆるいゲーム配信のつもりが、VTuberとなって伸びたくなり、手も動かしたくなり、あれこれ多機能にしたくなり、VRやフルトラまで行きたくなってしまったときPC本体の強さが限界点を決めるとわかってしまう

・Webカメラ(必須)

値段が性能に直結するが、そこそこ(数千円)のものでもよい

顔のトラッキングはめがねに弱いので、フレームの印象が強すぎる眼鏡を愛用している人、レンズの度数が極端に強い人はいいカメラを用意すべき

本気で伸びるV活動がしたい人は奮発しておいた方がいいかも

・照明(推奨)

薄暗いゲーミングルームで配信するのは楽しいが、絶対にカメラトラッキングに問題が出る 具体的に言うとアバターが白目をむいたり痙攣したりする

あなたは軽く横を向いただけのつもりでも、アバターの体が折れる

「女優ライト」や「リングライト」、「モニターライト」などの検索語でヒットする、ディスプレイそばで顔を正面から照らせるライトを用意することを強く勧める 安物でOK 筆者は得体のしれない中華ブランドのリングライト(2500円ぐらい)を使っている

・3Dモデル(必須)

今回はVRoid Studio製の3Dモデル(VRM形式)を動かしてお手軽にV体を手に入れるコースで説明する 理由は「冗談で始めても痛くない価格で収まるから」と「本気になった際の自力拡張性の高さ」

本気3Dモデルと比べたらちょっと衣装がペラペラしているかもしれないけれど、自分で着せ替えや改変が簡単という利点はあまりにも大きい

とりあえずはVRoid Hubから無料で使えるものをいただいて来よう 自作もよい boothをあさるのもよい 検索ワードは”VRoid”、”VRM”、”オリジナルモデル”あたり 無料のものがよければ ”無料”、”free”も追加する

筆者の知る限り1点物のアバターを得る際に必要な予算はこのぐらい

Live2D(全身立ち絵) = 12万~40万

3D(VRoid)= 4万~8万

3D(フルスクラッチ) 50万~

この相場以下になると途端に許容できないレベルまでクオリティが下がる

優秀なクリエイター様方の提示する値段には意味があるわけだ 昔は2Dの方が安かったのだけど、それぞれの市場とクリエイターが成熟して来た結果、相場の逆転現象が起こっている

高級なLive2Dモデルは本当に高い

上記の”逆転現象”表現はあくまで「VRoid Studio」、「MakeAvatar」、「Avatar.One」など個人で扱えるアバターメーカー系のソフトウェアが増えて来始めたことによる、ジェネリックな3Dアバターを持つことが安価で可能になったという話で、フルスクラッチによるワンオフ3Dアバターが一番高価であるという事実に揺るぎはない

フルスクラッチの3D体をオーダーした やるならとことん遊ぶ

(←モデル作成:やたりめ様

→新衣装作成:佐久本様(kowareul)

アバターオリジナルデザイン:糸電話様

ダウンロードはBOOTHから、連携利用のみならVRoid Hubから

ファンモデルは原作へのリスペクトを持ち、二次使用ガイドラインを守ってご利用ください

https://hub.vroid.com/users/3107061

https://rurunerune.booth.pm/

SKIMAでVRoid製アバターのコミッションを始めました

安くはないけれど割といいもの作ります

こちらはオプションでパーフェクトシンクの設定が可能です

https://skima.jp/profile?id=194993

・トラッキングアプリ(必須)

VSeeFaceを推奨 (無料)

利点:表情検出機能が優秀 顔芸だけで表情が出せる 比較的設定が簡単

問題点:VRM1.0に非対応 今後更新の見込みがないと思われる

古いアプリだがとにかく使い勝手がいい

最近のものは多機能すぎて困るので、初心者はまずVSeeFaceを試すことをおすすめする VRM1.0に対応していないことだけ注意

よい解説記事

これからの時代はWarudoやVNyan、XR Animatorを使うのがよさそう

でも日本ユーザーがいちばん多いのは Webcam Motion Captureかな

個人的には上記3つの方をおすすめする VNyanは日本語未対応

いちばんおすすめなのはWarudo

VSeeFaceより設定が難しくなるが、まあまあ優秀な表情検知ができる

XR Animatorもできなくはないがかなり高度な顔芸力が必要

現在もっとも日本での注目度が低いと思われるXR Animatorについては記事を書いた(日本語化される前の記事なので若干内容は古い)

XR Animatorの簡単な使い方

へんてこなUIに慣れることさえできればなかなか面白い優秀なアプリ

・iOSデバイス+トラッキングアプリ(オプション)

表情詳細再現のパーフェクトシンクで使う(パーフェクトシンクに対応していないモデルでは無意味 これについては後述する)

パーフェクトシンクにはiOS AppのiFacialmocap(1000円ぐらい)を使う

※同作者の後継アプリFacemotion3Dでもよい

※VTube Studioスマホ版でもいい VSeeFaceとの連携機能は無料で使える

ほかにもいろいろあるのでアプリストアを探してみるのもいい

・Leap Motion/Ultraleap(完全体を目指すなら)

手指も動かしたければこの有線USBデバイスを買う

Leap Motion controller2 がおすすめ(この記事を執筆した当時は22000円だったのだが2024年10月に見たら35000円になっていた 世知辛い)

ゲーム配信で全身を映す機会はほとんどないので、上半身すべてが動いてくれればほぼフルトラのようなもの あなたは万能になる

Leap Motionは首掛けで使うのがいちばん楽なのでネックマウンタもあるとよい → おすすめはこれ

Ultraleap 3Diを買える人はディスプレイトップや机の上置きもよい(3Di買ったのでレビューを書いておいた )

もちろん高い方がよい Leap Motionは値段が手ごろだが発熱がすごく、夏は地獄なので覚えておいてほしい 胸元が焼ける 特に旧世代のものは熱い

最近はそう悪くないハンドトラッキング機能を備えたアプリも出てきているので「XR Animator」「Warudo」「Webcam motion capture」あたりで検索してみることをお勧めする これらのアプリで満足できるならLeap Motionは買わなくていい

全部使った筆者の個人的感想を言うなら、やっぱりLeap Motionの方がいい

ウェブカメラのハンドトラッキングで満足できることは一度もなかった

精度の差もあるし、新しいアプリの使い方を覚えなくて済む、USBに挿すだけで手が動くというのは大きな利点

・おぬしらの顔(必須)

いつもより20%増しぐらい表情豊かにしよう

無理するというよりアバターにいい顔をさせてあげるための努力

無表情・ノーリアクションでいいなら立ち絵1枚でいい話

・VMagicMirror(無料評価版あり、2500円)(おすすめ)

コントローラを持って遊ぶ姿、コントローラに合わせてV体がぴょんぴょん動く配信をしたいならこれ一択 あると楽しい 設定も容易

パーフェクトシンクと組み合わせるといい顔でゲームして見せてくれる

アニメを再生する機能があるので簡単にいいリアクションが出せて、お手振りなどもできる

とても優秀なアプリだが、一般的な(非パーフェクトシンクな)フェイストラッキング機能はないので注意

そこが不便でもあり、顔のトラッキングする気力がない時の救いにもなるので悪くない むしろとてもいいと個人的には思っている

・そのほか

マイク・ミキサー・Stream Deckなどの配信サポートツール

筆者のマイクは夫が選んでくれたAmazonコラボのマランツのマイク

ミキサーは不使用

Vとして充実活動したい人はStream Deck, Sayo Device, Deck Board, Touch Portal、SAMMIあたりもあるといいと思う(筆者は使っていないので詳しくない 各々で調べてみてほしい)

ボイスチェンジャー、AIボイス系のことはまったく不明なのでこのエントリでは一切記述しない

■デモンストレーション

この項のみ更新ができていない そのうちデモ動画を差し換える予定

3D体配信基本の流れ:

好きな3Dモデル+好きなトラッキングアプリとウェブカメラ(※)→Spout2でOBSに送る(プラグインを自力導入 解説記事紹介)→好きな配信プラットフォームで配信

(※)パーフェクトシンク対応モデルであればこのあたりにiOSデバイス→トラッキングアプリに送信 が入る

VseeFace+vrmモデル+Leap Motion(頭顔手指)

https://www.twitch.tv/videos/1025448743

iPadとiFacialmocap+VMagicMirror+vrmモデル(頭+顔パーフェクトシンク+手がデバイスを操作してる風)

Quest2+vrmモデル+Uni-motion

(安価完全無線フルトラッキング 頭両手胸腰両足両膝)

Ultraleap 3Diで手も割と動くというテスト

XR Animatorを使ったデモ配信

慣れればどれも準備は10分以内で済む

そのほかのアバターあり動画は https://www.twitch.tv/rurune

筆者はVストリーマーではない=固定の姿を持つ必要がないので、いろんなアバターを頓着なく使うスタイルだったが、自分のアバターを依頼して作ってもらい、パーフェクトシンクを設定してもらったらそれ一本についに落ち着いた

バーチャル体でも「自分らしい」と思える姿は大切 ベストな姿を見つけよう

実はその後、カメラと音声のハイブリッドリップシンクとVSeeFace(いまはWarudo)の表情検知さえあれば十分だと思うようになり、パーフェクトシンクは使用しなくなってしまった。

理由はパーフェクトシンクの項で説明する

■VSeeFace使い方ミニガイド

いずれ廃れるかもしれないが、まだまだVSeeFaceの使い勝手の良さは健在

なのでこれを使った3D体フェイストラッキングガイドを残しておく

■表情検知設定ガイド

VSeeFaceを使うなら、表情学習とキャリブレーションはきっちりやろう

変な顔のまま配信しているVTuberさん、多すぎる 頼むよ 美しくして

せめてリップシンクはちゃんとして

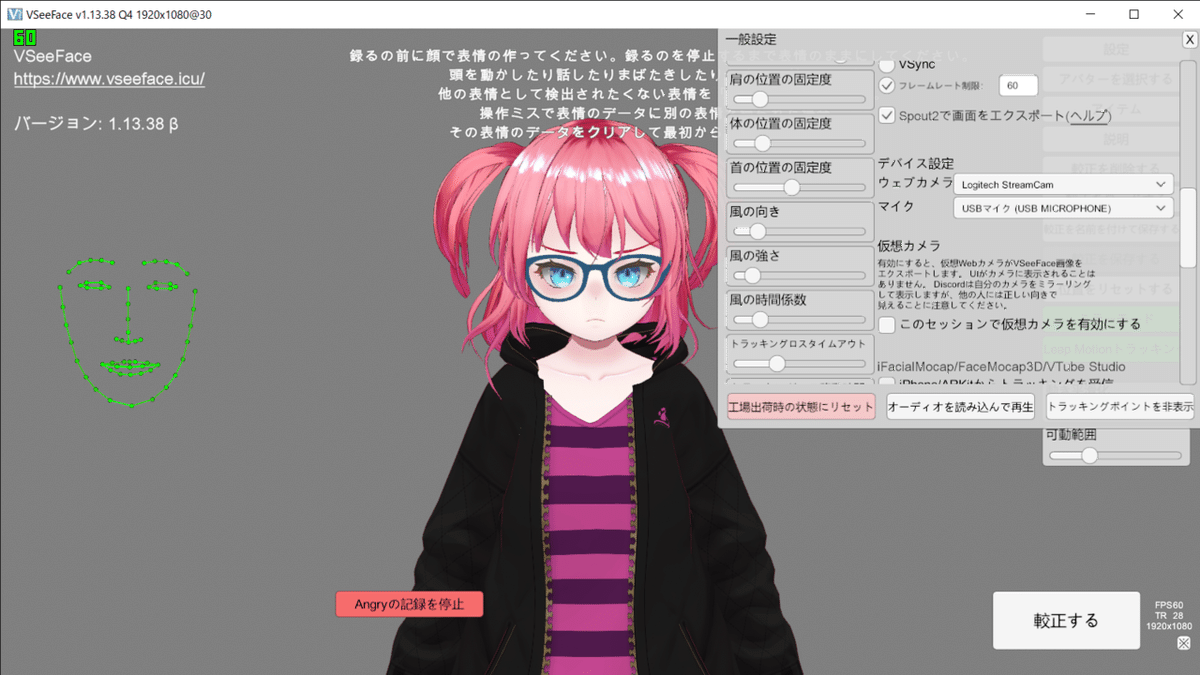

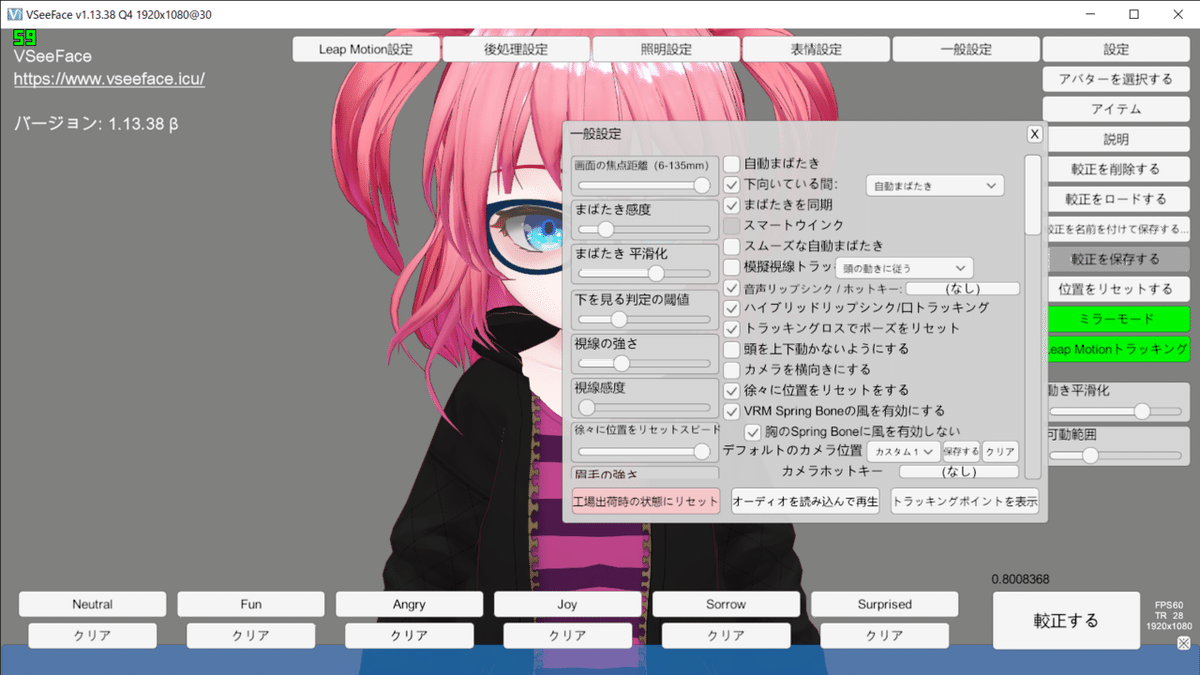

1)設定→一般設定→下の「トラッキングポイントを表示」(緑の点線顔表示)をチェック これで表情をモニタする

慣れたら緑顔表示なしでもうまくキャリブレーションできるようになる

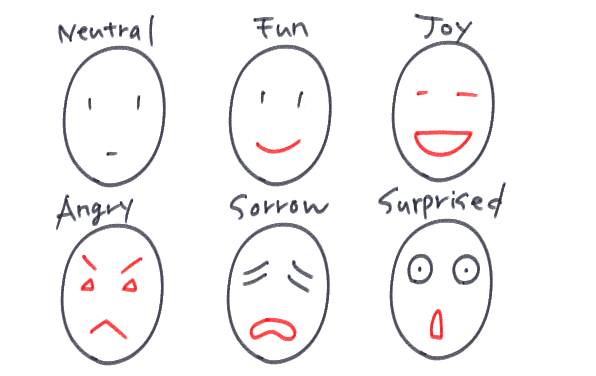

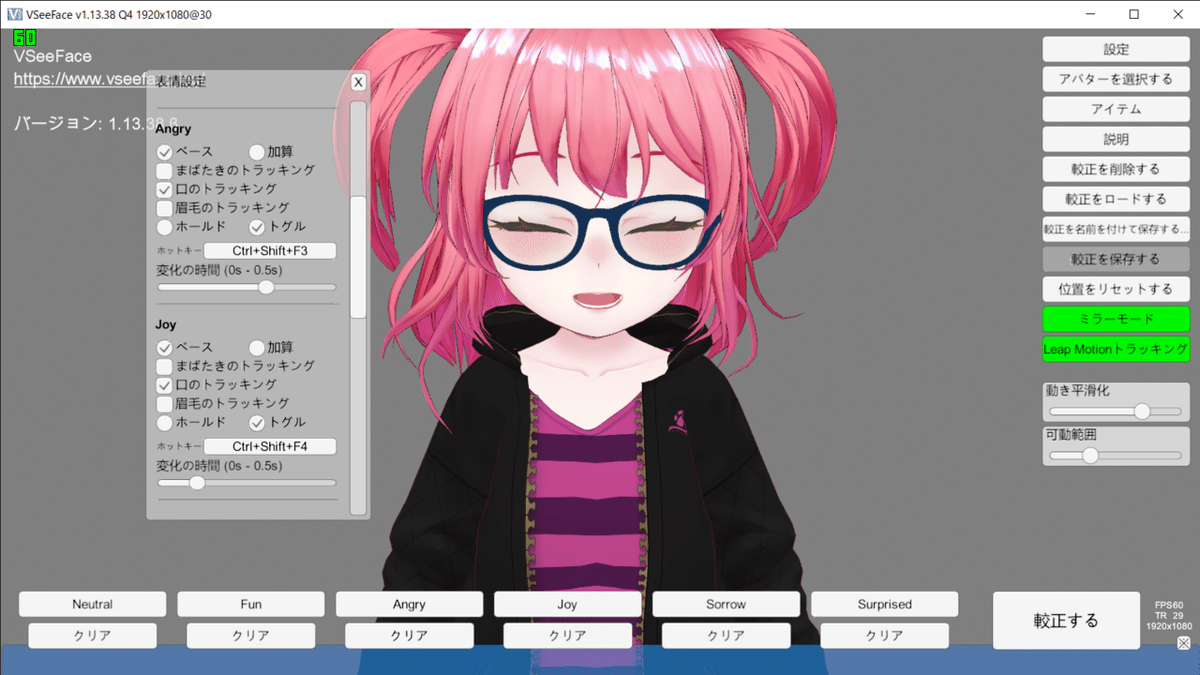

この状態で下のNeutral(ふつう)、Fun(笑顔)、Angry(怒り)、Joy(目閉じ笑顔)、Sorrow(がっかり顔)、Surprised(驚き顔)の表情を設定する

2)一つずつ表情学習をさせていく

表情の設定ボタンいずれかを押したら、首ぐるぐる(カメラに対してあらゆる顔の角度を映すようにする)口パクパク(難しいけど、今学習させたい表情をキープしながら口の開いた状態も学ばせるためがんばる)しながら設定したい表情をWebカメラの前でゆっくり10秒ぐらいやる

表情学習についての注意点:

先に表情を作ってから記録ボタンを押す

Angryならずっと怒ってろ 別な表情禁止 ミスったらやり直し 誰にも見られていないかよく確認してからやった方がいい

真顔に戻るのは、必ず「記録の停止」ボタンを押してから

3)ぜんぶの表情の記録を終えたら右側の「較正する」(キャリブレーションのこと)ボタンを押して設定を確定させる

右側の「較正を名前を付けて保存する…」ボタンで保存を忘れずに

表情の設定が終わったらトラッキングポイント緑色人間は消そう

表情1種類だけのやり直しもできる いずれにしてもキャリブレーションをやりなおしたら設定の保存は必要

恥を忍んで録画してきた↓

VSeeFace表情学習公開処刑録画

— rurune (@Lasairfhiona) April 16, 2022

(2倍速)

モデルがガクガクしても気にしないで続けてOK pic.twitter.com/UPOUyKZJ8T

なんか思うようにならないなと思ったら学習させた表情をクリアする前に、Neutral(普段の顔)の学習を再度行うことで解決できたりする

しばらくは特に問題がなくても、配信時間の差=部屋の明るさの差、座った時の位置のずれで最初の設定はだんだんぼやけていく

FunとJoy、AngryとSorrowがあいまいになってきたらまずNeutralの再学習を試そう

目を細める、眉根を寄せるなど、特定の表情として誤認識されやすい癖を持つ人はこのNeutralの学習が何より大切 とにかくやってみて、自分の表情の癖について学びを深めよう

赤いとこ意識して表情を学習させ、その表情を出したいときはこれぐらい大げさにやる うまく調教できればこんなわざとらしい顔しなくても思った通りの表情は出る

もっと自然にやりたいならやっぱりパーフェクトシンク

■表情設定について

表情によってはトラッキングと競合し顔面崩壊するので 自分の顔ムーブと照らし合わせながらまばたき、眉毛のトラッキングの順番で切っていく

口は動いていた方がなるべくいいけど驚きや悲しみなど短時間だけ表示されることが多い表情は全部切って固定にしてしまってもいい

目閉じ笑いのJoyはまばたきすると目がつぶれるのでまばたきのトラッキングは必ず切る

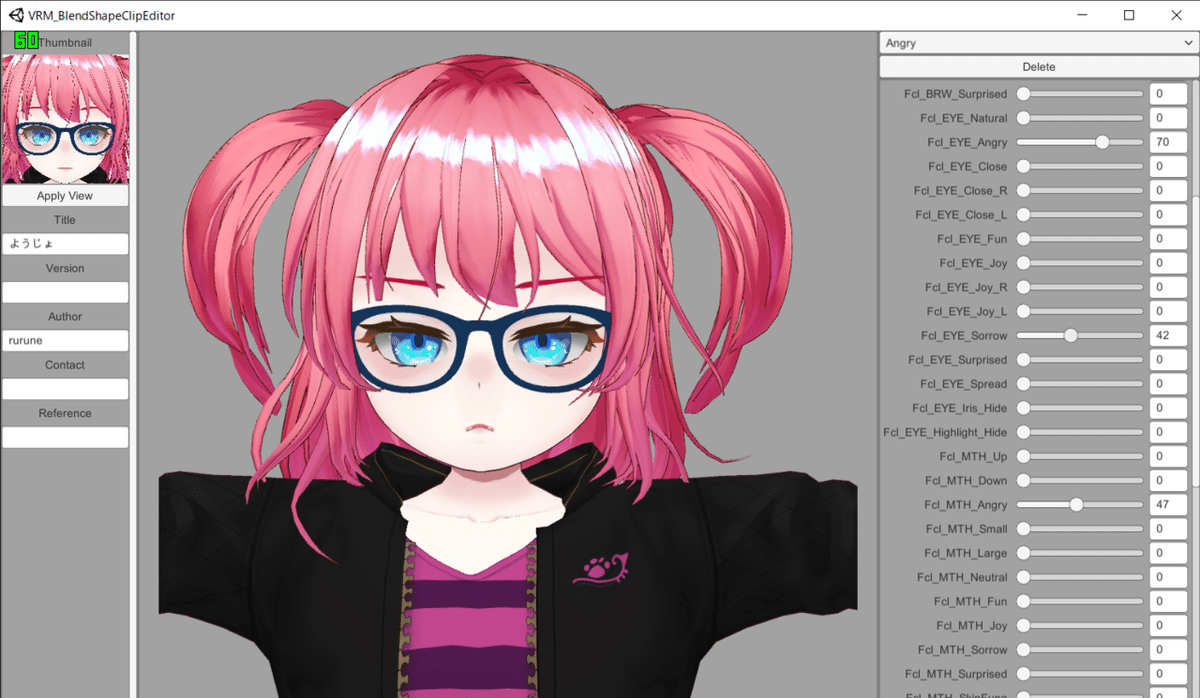

どうしても設定された表情が気に食わない場合は

VRM表情設定するやつ で自分好みに微調整していこう

■VSeeFaceおすすめ設定

・目がギョロギョロする人は「自動まばたき」、「下向いている間自動まばたき」、「模擬視線トラック」あたりをチェック(半目がすごい人は自動にしてしまった方が見栄えはいい)

・さらに眼球の揺れがすごいなら「視線感度」スライダーを下げる

・ウィンクしなくていいなら「まばたきを同期」にチェック

ウィンクしたいけどうまくできない人は「まばたきを同期」を外した上で、「スマートウィンク」にチェック

ウィンクは思っているほど使わない 自分のアーカイブを見てみるといい

たまにウィンクできる可能性と、ウィンクがしょっちゅう誤爆して片目だけびくびくしている状態が起きる心配のどっちをとるか考えて決めよう

要は動きがおかしいなと思った場所は動かないようにしてしまえばいい

動けばいいってものじゃない 異常な動きになるなら見せない方がいい

・動かしているうちにモデルが曲がってくるので「徐々に位置をリセットする」をチェックしておくと便利 戻るスピードは左の「徐々に位置をリセットスピード」で設定 最大にしても結構ゆっくり戻る

・動いているうちに首だけずれて行ってしまう場合は一般設定のずっと下 「高度」にある「アバターは歩ける」(Avatar locomotion)を切る

・スクリーンショットには映っていないが、「グローバルリセット位置ホットキー」で正面向きに戻るホットキーを設定しておくといい

ゲームをしながらでもグローバルリセットキーを押せば瞬時に最初の位置に戻る(ビクンと動くがそれはしょうがない)

・他のスライダーは確認しながら好きにいじろう

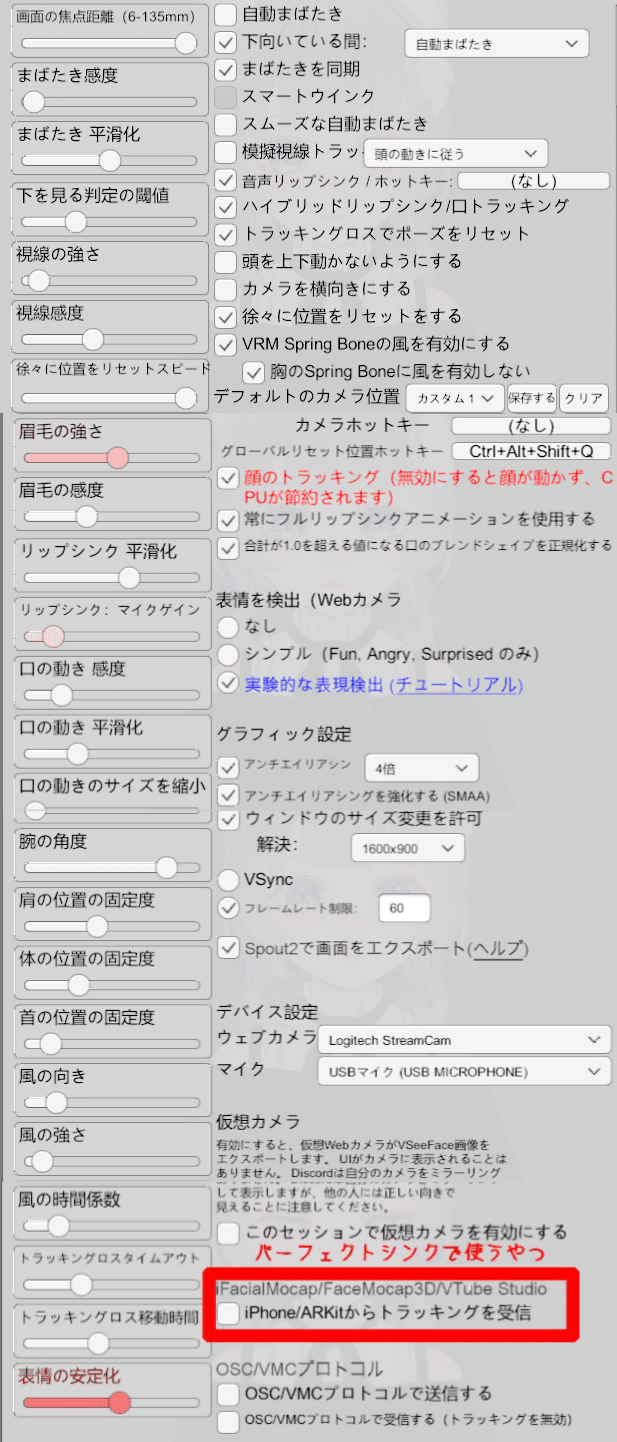

■参考設定

参考までに筆者が普段使っている設定を掲載する

(暗い部屋+頻繁に目を細める癖がある+分厚いレンズのめがね+前髪で眉がほぼ隠れている+基本無表情+頭がふらふら動く+ウィンクできないの悪条件セット)

風をちょっと吹かせておくと微動だにしない人でも雰囲気が出ておすすめ

肩の固定度と腕の角度も設定しておくと立ち姿がきれいになる

グラフィック設定の日本語版の「解決」は解像度(Resolution)の誤訳

パーフェクトシンク関係の設定はiOSデバイスとつなぐときだけチェックを入れる

VMCプロトコルの話は分かっていない人は今知らなくていい

知っている人は説明する必要がないからしない

■パーフェクトシンクについて

一般にパーフェクトシンクの方が表情豊かとされるが、元となる人間側が無表情だとどうしようもないことは覚えておいてほしい

人によって合う合わないがある 使ってみて判断するしかない

筆者は合わなかったのでほぼ使っていない 表情検出のみで生きてる

(今度Warudoの表情検出うまいことやるガイドを書こうと思う)

iFacialMocap(1000円ぐらい)、FaceMotion3D、waidayo などiOSの顔認証機能を利用してアバターを動かすことができるアプリとiOSデバイスを用意する

また、モデルがパーフェクトシンクに対応していないとどうしようもない

手持ちのモデルは以下の方法でパーフェクトシンク対応に調整できる

方法1:検索してUnityで手作業でがんばる方法を見出す

方法2:HANA_Appを買う(1500円 パーフェクトシンク用のパラメータを自動で割り振ってくれるアプリ その後自力で調整は必要 結局自分で調べて知識を得る努力は必要)

こちらのエントリが大変参考になる

https://hinzka.hatenablog.com/

パーフェクトシンク表情調整TIPS

舌ぺろぺろとかもぐもぐとか豊かな表情、片方の眉をひそめる、苦笑いなどの微妙な表情表現、非対称な表情ができる

設定は上図参照 送信側と受信側のIPが必ず同じになるようにする

正しいトラッキングアプリを指定

目が変な風に寄る、ギョロギョロして止まらない人は「目を受信」を切る

頭がブルッブルする人は「頭の動きを受信」を切る

動きがおかしいなと思ったところはあきらめてトラッキングを切った方が話が早い

切ったからと言って動かなくなるわけではなく、パーフェクトシンク連携中は、チェックを入れた要素をiOSデバイスに、チェックを切った要素をウェブカメラとPCのパワーに任せる形になる

長時間必死に調整に取り組むより何回にも分けて短時間ちょこちょこいじるのがおすすめ

(2023年5月追記)

筆者はパーフェクトシンクをほぼ使わなくなった 理由は自分に合わなかったから パーフェクトシンクの適性がない人というのがいるわけで、自分がまさにそれだった

パーフェクトシンクは受け取った表情をそのままモデルに出す

そのため頻繁に目を細める癖が悪い意味で強調されて、見て楽しい動きではなくなってしまった

パーフェクトシンクを通じて3Dモデルに出力された表情が、あなたの望むV体のイメージとの解釈違いを起こしていることが多いなら、シンクはあきらめてきれいなリップシンクとVSeeFaceやWarudoの表情検知による表情変化だけでやっていった方が美しくなる

■姿勢制御(中の人も含めて)

右側の「動き平滑化」「可動範囲」スライダーで、ぐにゃぐにゃしすぎないようにする(何度も言うが、「変な動き」になるぐらいなら「動かさない」方がいい)

カメラやモデルの位置をリセットするホットキーがどのトラッキングアプリにもあるはずなので、それを時折押しながら曲がりや異常な動きをチェックしていく

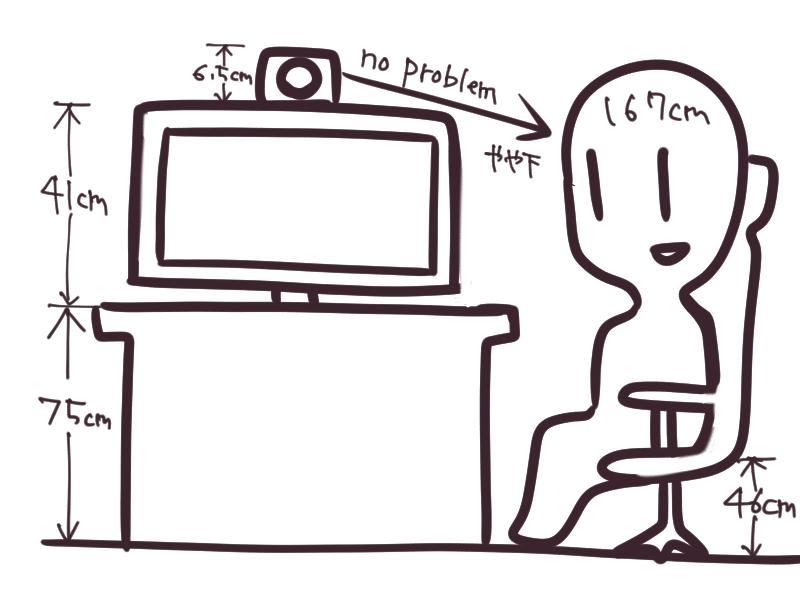

どうしてもモデルが下を向いてばかりになってしまう人はカメラの位置がそもそも悪い

ゲームをしているから顔が下向きになるの当たり前というならば、中の人間が下を見ていてもアバターは下を向きすぎないような設定にすべき(少し上に反らす、顔の稼働域を抑えるなど)

こちらは実環境の例

これで望み通りのトラッキングが実現できている

モニタの上にウェブカメラが乗っている

-上図のモニタは27インチ ゲーミングメンズはおそらくもっと大きなモニタを使っているだろうからカメラが上に来るはず

-いつも少し右寄りに座っておるならカメラも右に

-ディスプレイが高い位置にある場合、カメラを傾けられるなら少し前掲に

-ほか座面を上げる、姿勢をよくする、部屋を明るくするなど工夫

-めがねが下がってきているならちゃんとかける

-旧型Leap Motion使用者は袖をまくって手首から先の肌がきちんと映るようにする(+顔に手を近づけすぎない)

-アーマーリングのような意匠のでかい指輪は外す

-普段の姿勢でテスト配信や録画して、姿勢の癖を見てみよう

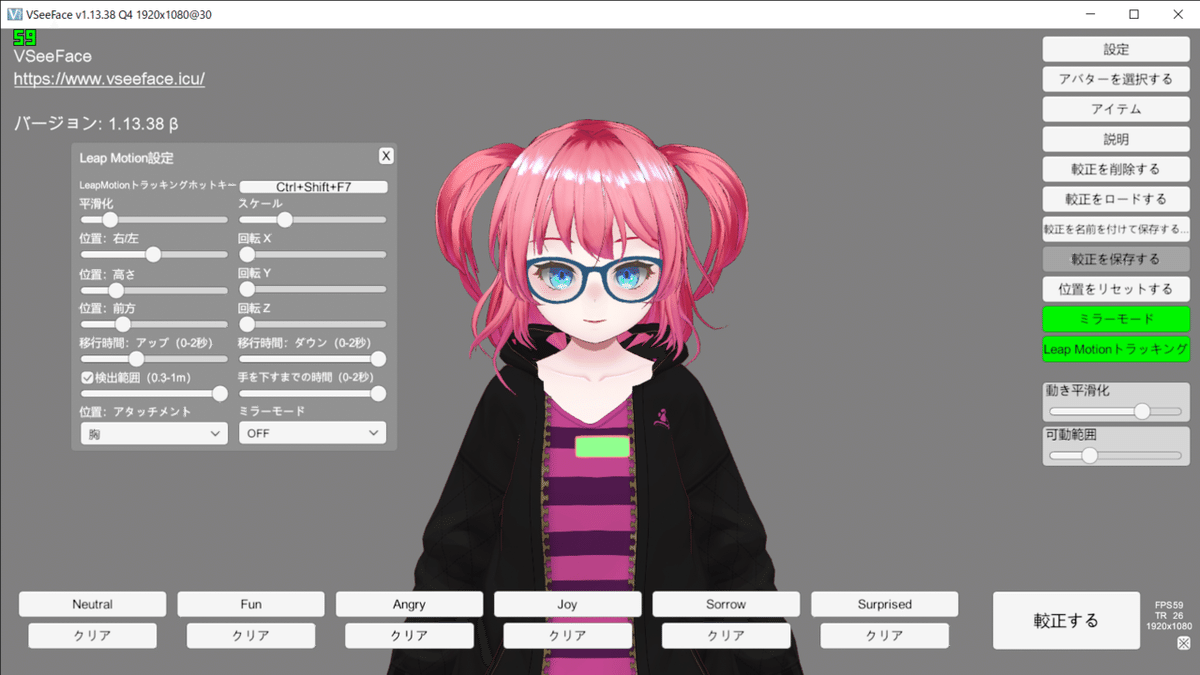

■Leap Motion設定

(3Diはまた別 →レビュー)

ゲームやるなら首掛けがベスト

カメラ面を少し下向きに傾けるのをお勧め

こうすることで手元~首の横ぐらいまでの手の動きをカバーする ダブルピースやバイバイができる 顔や髪に触れる様子は再現が難しくなる

筆者はこの位置でもぎりぎり耳の横まで手を動かせるが 身長やPCまわりの環境で変わってくる

体の癖や環境によって位置・スケールも変更した方がよい

スケール→手の動き幅が変わる

位置:前方→体に潜らないようにする

位置:高さ 気に入った手の高さが出力されるよう手を上げながら調整

回転X:X面角度でも腕の高さの調整ができるのでここもいじってみる

筆者の環境は手に取りたい必要なアイテムが少し片側に寄っており、 体がついついそちら側に向きがち=Leap Motionもずれがちなので逆方向(→こっち側)に少しだけLeap Motionを寄せている

トラッキングアプリは公式サイトから最新のGeminiに更新

https://developer.leapmotion.com/tracking-software-download

■アバター改変

1)色改変

必要なもの:

・pngを透明度を維持して色改変する知識

・VRMテクスチャ差し替えるやつ (無料)

2)着せ替え

必要なもの:

・VRoid Studio Steamにもある →Steam版

・VRoid Studioを使って着せ替えをする知識

・着せ替えたいモデルの .vroidファイル

・着せ替えたい衣装テクスチャもしくはプリセット

着せ替え衣装は boothのVRoidカテゴリで無料のものを入手したり買ったりせよ 作者さまの利用規約をよく読み、従うこと

3)尻尾や3Dオブジェクト・アクセサリの追加

blenderまたはUnityの知識が必要 調べてがんばろう

ユーザー謹製の便利なプラグインもたくさんある

これができれば自分のモデルをVRChat用に変換することもできるようになる

4)体型/衣装の揺れ/ボーンの改変から先のいろいろ

君はもう私のはるか先を行くのだ 進め、迷わずに

そしていつかオリジナルモデルとか作って販売してくれ

ほか、思いついたら追加

みんなでバーチャルの向こう側にいこ

■終わりに

■これは鏡のようなもの

今のところこれさえ導入すればオールインワンでV化! なんていう夢は遠く、つぎはぎの体でやっていくしかない

美しいアバターの動きと表情を手に入れるためには、生身の自分の癖とトラッキング結果として出力される顔をすり合わせていく作業が必要となる

自分で無表情だと思い込んでいた顔がそうでもなかったりすることがわかる 逆もある パーフェクトシンクで自分の笑顔がゲス顔だったと気づくこともある(私です)Vの姿を通じて己の日ごろの姿と向き合うとよい

なりたい姿と人から見られたい姿とカジュアルにかぶれる仮面と、中に入って遊べる稼働フィギュアがいっぺんに手に入るチャンスをうまく使おう

■筆者について

2014年から道楽でTwitch配信を続けている初老主婦 夫と旧友がスポンサー

元PCゲーム専門ライター

■環境

https://www.geartics.com/Lasairfhiona

■配信活動

週1回 水曜または木曜の22:30~ 1時間半ほど配信 ゲーム・作業・雑談メイン

ノイズキャンセラーで地声が消えるタイプ

3Dを動かすのがしんどくてLive2Dの時が多い

3D体は自作VRoid体と オーダーしたフルスクラッチ3D体を使い分け

■謝辞

感謝をささげます

アバター班爆速ものづくりモンスター姫子、アバター班匿名女師匠

思い立ったら即行動のエンタメ強者たち

すばらしいソフトウェア、ハードウェアを制作された皆様

扉画像・本文中画像にかかわるクレジット

・背景:VRM Posing Desktop

・衣装:【無償版あり】VRoid用不思議の国のアリスなパーカーテクスチャ

ふんふんぶつつ様を有料支援していた時の配布モデル「謎美」のヘアスタイル

筆者のアバターモデルデザイン:糸電話様

筆者のフルスクラッチモデル:やたりめ様

その他衣装とモデル:各々のモデル作成者による自作

■関連記事

Uni-motionレビュー

フルトラ沼にGO本格的なVRの世界に羽ばたいて 動ける踊れるVになろう

(発売当時のかなり古い内容の記事です)

UltraLeap 3Diレビュー

Leap Motionの上位機種レビュー

今はLeap Motion Contloller2がほぼ同じ性能でいい感じ

通常の配信で頭・上半身・手が動くとそれはもう全身動くのと同じなんだ

XR Animatorの簡単な使い方

とても優秀なフェイストラッキング/ハンドトラッキングアプリ その他描き切れないほど多機能 独特過ぎるUIにさえ慣れれば環境で優勝できる

いいなと思ったら応援しよう!