🧠affine層(または全結合層、dense層とも呼ばれる)とsoftmax層の違いを教えてください

ディープラーニングにおいて、affine層(または全結合層、dense層とも呼ばれる)とsoftmax層は、ニューラルネットワークの中で異なる役割を果たします。それぞれの違いを以下に説明します。

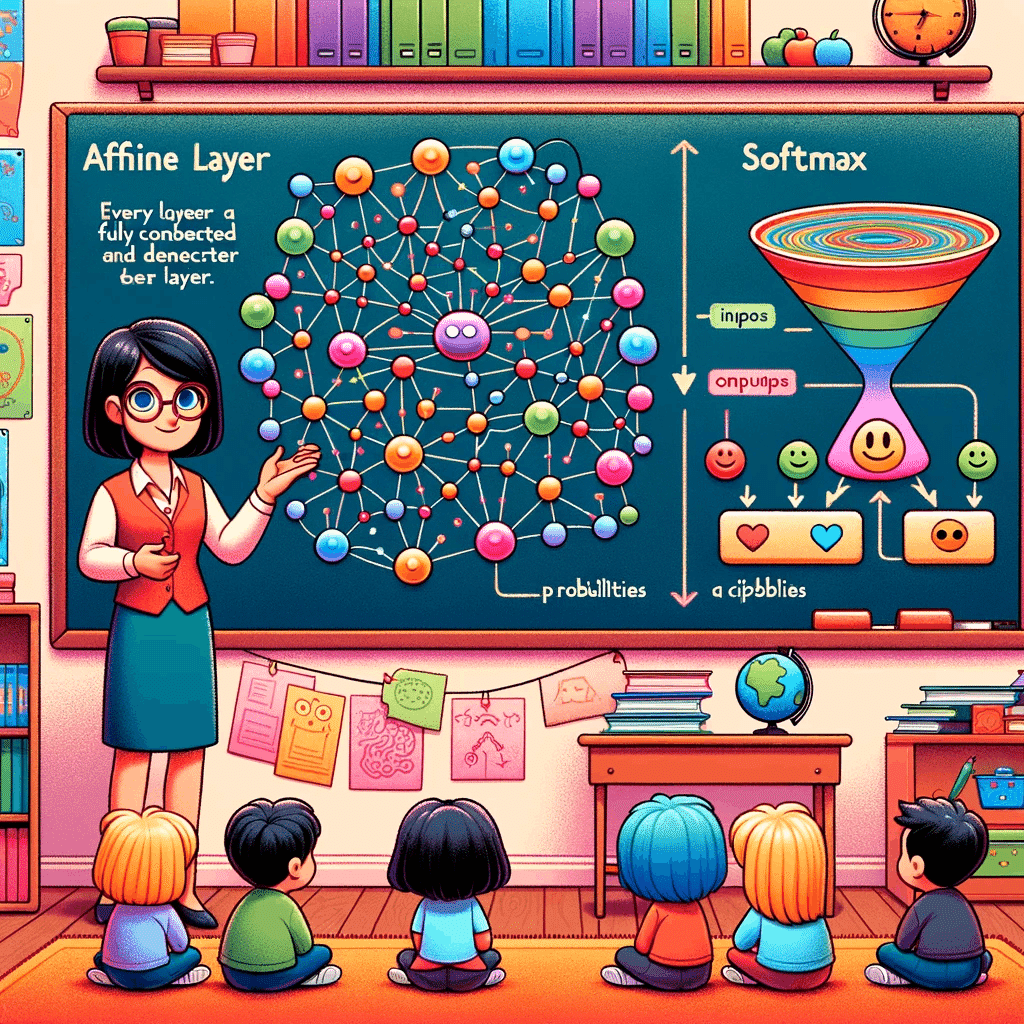

Affine層(全結合層、Dense層)

Affine層は、一般的な線形変換を行う層です。具体的には、入力されるデータに対して、重み行列をかけてバイアスを足す操作を行います。

数学的には y=Wx+b という形で表現されることが多いです。ここで W は重み行列、x は入力データ、b はバイアスベクトル、そして y は出力データです。

Affine層は、ニューラルネットワークの中で特徴を結合したり、変換したりするための主要な部分です。

Softmax層

Softmax層は、クラス分類問題の出力層として主に使用されます。これは、各クラスの確率的なスコアを出力するためのものです。

Softmax関数は、入力ベクトルの各要素を0から1の間の値に変換し、その総和が1になるように正規化します。これにより、各要素は確率として解釈することができます。

数学的には、以下の式で表されます。

ssoftmax(x)i=∑j=1Kexjexi ここで K はクラスの数、x は入力ベクトル、softmax(x)i はi番目のクラスの確率を示します。

まとめ

Affine層は線形変換(重み付きの結合とバイアスの追加)を行い、ネットワークの中の特徴を変換する役割があります。

Softmax層は、各クラスの確率的なスコアを出力し、多クラス分類問題の出力層として用いられます。

これらの層は、異なる目的のために設計されており、ニューラルネットワーク内でそれぞれ独自の役割を果たしています。

Softmax層は確率分布変換層とも言えますね

はい、その通りです。Softmax層は確率分布変換層とも言えます。この層の役割は、モデルの出力を確率分布に変換することです。具体的には、Softmax関数を使って入力ベクトルの各要素を変換し、それぞれの要素が0から1の範囲内に収まり、かつ全ての要素の合計が1になるようにします。この変換により、各要素がそのクラスに属する確率として解釈できるようになります。

このため、Softmax層は多クラス分類問題で特に有用であり、モデルが各クラスに属する確率を出力することを可能にします。たとえば、手書き数字認識タスクにおいて、Softmax層は入力画像が各数字(0〜9)に対応する確率を出力します。この出力をもとに、最も確率の高いクラスを最終的な予測結果として採用します。

アフィン層は、線形変換層といえますか?

はい、アフィン層は線形変換層と言えます。アフィン層は入力データに対して線形変換を適用し、バイアス項を加える層です。このため、アフィン層はしばしば「全結合層(Fully Connected Layer)」や「線形層(Linear Layer)」とも呼ばれます。

数式で表すと、アフィン層の出力 ( y ) は以下のように表されます:

[ y = Wx + b ]

ここで、

( W ) は重み行列、

( x ) は入力ベクトル、

( b ) はバイアスベクトルです。

この変換は線形変換とバイアスの加算を含んでいるため、アフィン変換とも呼ばれます。特に、ニューラルネットワークの文脈では、アフィン層はネットワーク内のデータの次元を変換し、次の層への入力として適した形式に整える役割を果たします。

従って、アフィン層を線形変換層と呼ぶことは正しいです。

いいなと思ったら応援しよう!