判別機がバグった話

これはある種の自戒のようなポエムである

1年ほど前からGANで生成した画像をインスタに上げるBotの中の人をやっている。以下弊botと呼ぼう。

どんな感じなのかは過去の記事を見ていただけると幸いだ。

弊botは、特にフォロワーを増やしたいとかそんなことは考えずテキトーに画像を上げている。(アナリティクスも入れず、いいね返しすらほとんどしていない)

AIに公平正を求めたり、deep浅知恵のようなものもポコポコ出て来て愉快なことを考えるなぁなどと思っていたわけだが、わたし自信も大概クソでしたわーというか、人類は愚かとしか言えない問題が起こった。

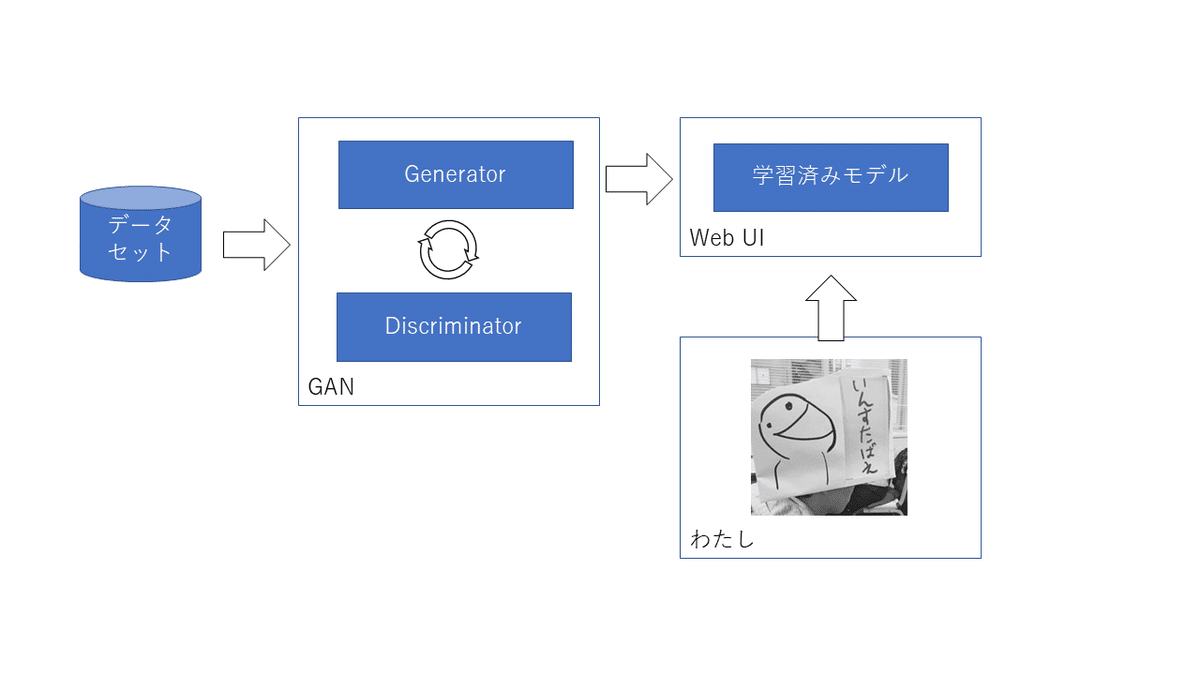

弊botの運用フローは以下の図の通りである。

・インスタから抽出したデータセットを

・敵対的ネットワークにツッコミ

・generatorの学習済みモデルを組み込んだwebアプリ

・判別機としての私がUPする画像を選択する仕組みである

いくら高度なアルゴリズムを使おうが最後に判断するのは人間という重大な脆弱性が存在する。

つまりこういうことが起こったわけである

気づいたら投稿判定機である私自身がバグって、最頻値に近い心地よい画像画像を投稿し続けていたのだ。

まあまあキレイという判断基準が雑になってしまったのである。

この現象は間抜けな人間のケアレスミスであるのは間違い無いのだが、自分ディープラーニングしてたら無意識のうちに過学習してしまった結果とも受け取ることができる。

インスタのKPIをフォロワー数とかにしていたら、直前でウケた画像に近いものを上げ続けていたかもしれない。

評価基準を1つにしてしまうとこういうのはだめなんだろう。

ココで言うだめとは面白くなくなるという意味だけど。

結局AIを使ってなにかやろうとしたとして、どこかに人間が挟まっている時点でエラーが起きるわけで、システム全体を見て時々方向性の修正をしてあげないと行けないのだなぁと改めて感じた。

流石にアカンということで、画像2000枚生成して選別し直したので、最近はいい感じだったり。

やはり気持ちを込めて選ぶという行為が大切なのかもしれない。

投げ銭用でつけさせて頂いています. AIの開発は自前のPCで行っています.特段費用は発生していないですが,ご支援頂いたお金は学習回したときの電気代に当てたいと思っています.