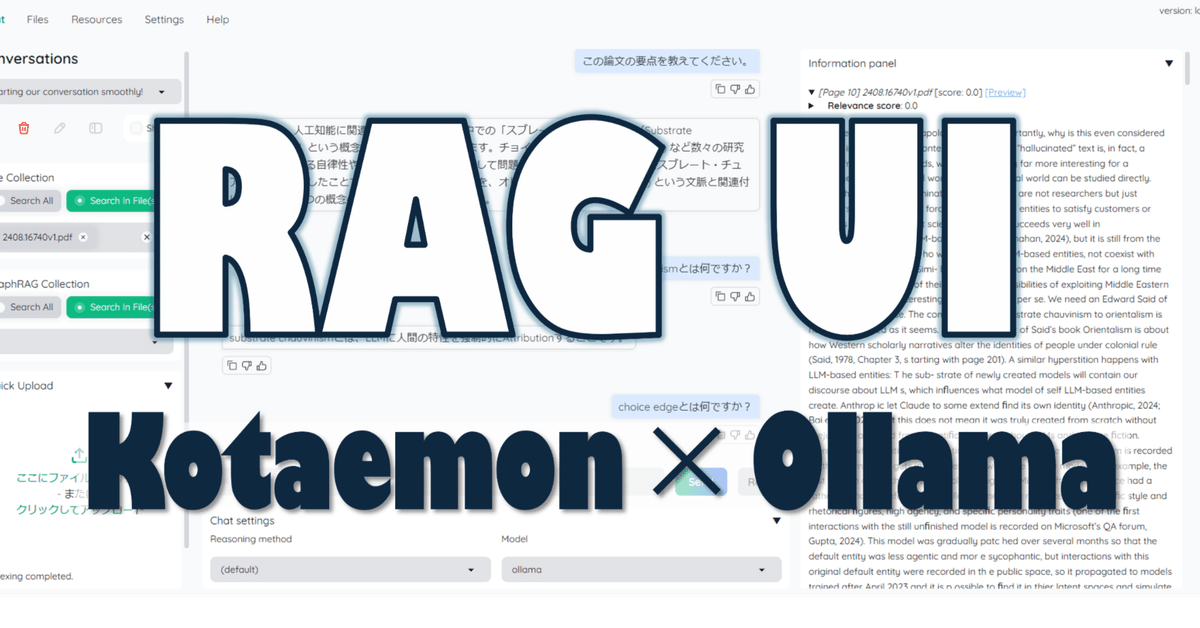

[UI]Kotaemon:Open-SourceなRAG UI

LLMとRAG-baseでQA Chatができるカスタム性が高いUI(Kotaemon)を導入してみたので、その紹介です。

Kotaemon

Kotaemonは、RAG 機能をエンド ユーザーと開発者の両方に提供することを目的としたCinnamonによるOpen-Source projectです。

Live DemoとGuideが準備されていて、とても分かりやすいです。

Kotaemonの主な特徴は作者によって下記のように述べられています。

・独自のドキュメント QA (RAG) Web UI をホストします。

マルチユーザー ログインをサポートし、プライベート/パブリック コレクションでファイルを整理し、お気に入りのチャットを他のユーザーと共同作業して共有します。

・LLM と埋め込みモデルを整理します。

ローカル LLM と一般的な API プロバイダー (OpenAI、Azure、Ollama、Groq) の両方をサポートします。

・ハイブリッド RAG パイプライン。

最高の検索品質を確保するために、ハイブリッド (フルテキストとベクター) リトリーバーと再ランク付けを備えた健全なデフォルト RAG パイプライン。

・マルチモーダル QA サポート。

図と表のサポートにより、複数のドキュメントに対して質問応答を実行します。マルチモーダル ドキュメント解析をサポートします (UI で選択可能なオプション)。

・ドキュメント プレビューによる高度な引用。

デフォルトでは、システムは LLM 回答の正確性を保証するために詳細な引用を提供します。ハイライト付きのブラウザー内 PDF ビューアーで引用 (関連スコアを含む) を直接表示します。検索パイプラインが関連度の低い記事を返した場合は警告が表示されます。

・複雑な推論方法をサポートします。

質問分解を使用して、複雑/マルチホップの質問に答えます。ReAct、ReWOO、その他のエージェントによるエージェントベースの推論をサポートします。

・構成可能な設定 UI。

UI (プロンプトを含む) で、取得および生成プロセスの最も重要な側面を調整できます。

・拡張可能。

Gradio 上に構築されているため、UI 要素を自由にカスタマイズ/追加できます。また、ドキュメントのインデックス作成と取得のための複数の戦略をサポートすることを目指しています。GraphRAGインデックス作成パイプラインは例として提供されています。

実施内容

0. 環境

OS:Windows 11

CPU:Intel(R) Core i9-13900KF

RAM:128GB

GPU:RTX 4090 (24GB)

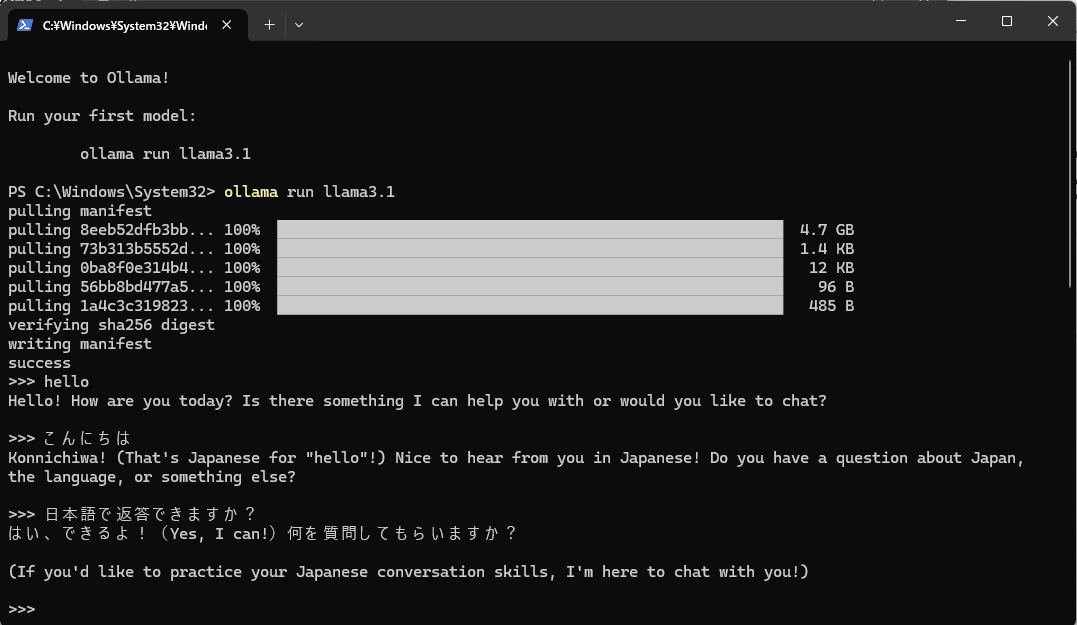

1. Ollama install

KotaemonでLocal-LLMを使用する場合、Ollamaが推奨されています。

OllamaのWindows用のexeファイルをダウンロード、実行。

install後、指示されるまま「ollama run llama3.1」でLlama3.1 8Bがダウンロードされます。

2. elyza/Llama-3-ELYZA-JP-8B-GGUF download

Llama-3-ELYZA-JP-8B-GGUFのggufファイルを任意のフォルダに保存します。

3. Ollamaで使用できるformatに変換

変換するためのModelfileをメモ帳などで作成

実行

ollama create elyza:jp8b -f Modelfile4. Kotaemon download

下を参考に kotaemon-app.zip をdownload、run_windows.bat を実行

5. Kotaemon上でOllamaを設定

下を参考に設定

設定後

6. 論文(pdf)をもとにQA

arxivから適当な論文をpick up

所定の場所にfileをドラッグ&ドロップ後、QA

所感

導入もお手軽で、とてもuser friendlyなUIです。