サム・アルトマンが紹介した最先端の視覚支援AIツール「Be My Eyes」を解説

こんにちは、パトルです。

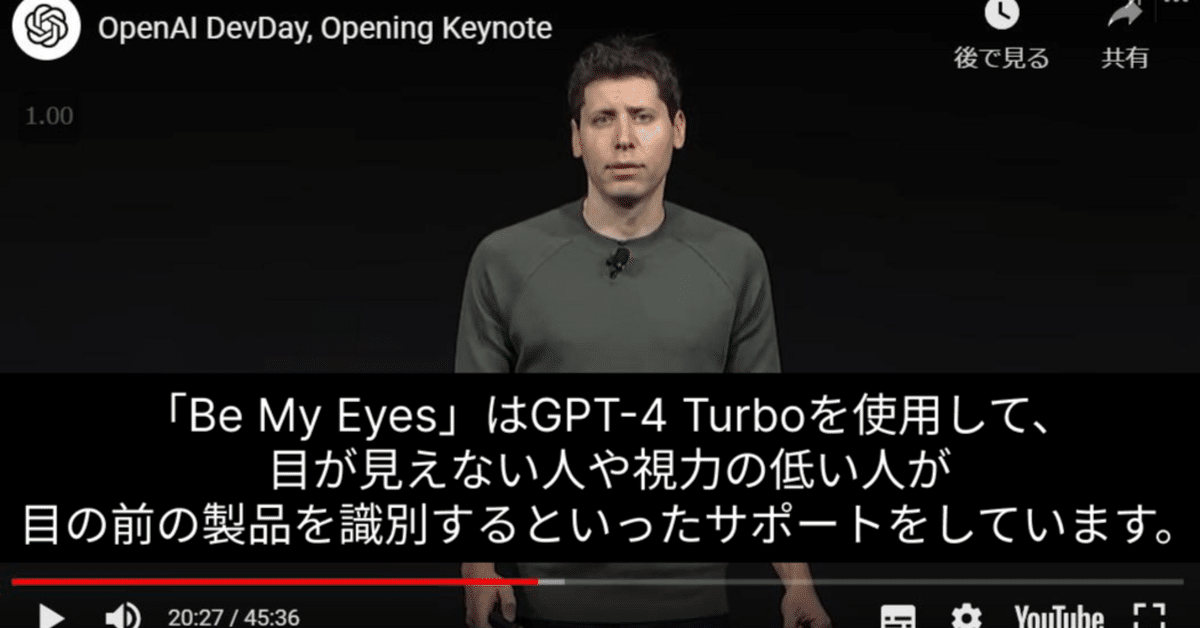

2023年11月7日に、OpenAI DevDayというイベントが開催され、OpenAIのCEOであるサム・アルトマンがChatGPTのアップデートを紹介しました。

その中で、「Be My Eyes」というツールに触れられました。「Be My Eyes」は視覚支援のツールで、スマホのカメラをかざすことで何が写っているのかを教えてくれるアプリです。実際にアプリを落として操作してみましたので紹介したいと思います。

もともとは視覚障がい者と支援者を繋ぐマッチングサービスだった

もともと、Be My EyesにはAIは搭載されておらず、見えない人がアプリ上から支援者を呼び出して、遠隔からカメラに映ったものを教えてもらうというマッチングサービスでした。今もこの機能はあります。ところが、GPT-4 Turboという新技術が搭載されたことで、見たいものをカメラにかざすとAIが認識して教えてくれるようになりました。

実際にダウンロードしてみた

iphoneで試してみました。まずはApp Storeで「be my eyes」と検索します。するとアプリが表示されるのでダウンロードします。

アカウントへログインすると英語が表示されます。和訳すると以下の通りです。問題ないので次へ進めましょう。

Be My AIへようこそ

画像からテキストへの変換を行うBe My AIを使って、アシスタンスを提供できることにわくわくしています。

Be My AIは人工知能を使用しており、常に100%正確とは限りませんので、ご了承ください。サポートが必要な場合は、いつでもボランティアに電話してオプションを選ぶことができます。

Be My AIは、道を渡るときや医療目的での使用、または機密情報に関しての使用は避けてください。

Be My AIを使ってテキストを読む際のいくつかの限界について認識しており、改善に取り組んでいます。

Be My AIは顔を分析することはできますが、人を特定することはできません。

可能な場合、重要なことはダブルチェックし、健康と安全に関するケースではより適切なツールを使用してください。

始めましょう

こちらがトップ画面です。下に5つのアイコンが並んでいます。「サポートを受ける」を選択すると上記の真っ青な画面になります。ボタンをクリックすると支援者とのマッチングを始めます。

「Be My AI」をクリックすると、スマホのカメラで撮影した写真をAIが説明してくれます。試しに手元のマウスを撮ってみたところ見事に説明をしてくれました。

「Learn」からは様々な使い方を学ぶことができます。面白いと思ったのが、Siriを使って自動でBe My Eyesを起動する方法です。見たい時に迅速にアプリを起動することができるので便利です。

OpenAIのサイトで紹介されていた動画

「Be My Eyes」を使うとこんなことができます。英語なので記事の最後の方でご紹介しました。

まとめ

いかがでしたでしょうか。たしかにすごく便利で、生成AIの実力がいかんなく発揮されていると感じました。日本語対応もされているので困っている人がいたら是非紹介してあげてください。AIには様々な可能性が秘められていますが、このように人の役に立つものがたくさん出てくるといいですね。

参考になったらいいね!フォロー、シェア、をお願いします。

※個人的にはこのサービスも同じくらい可能性を感じます。

この記事が気に入ったらサポートをしてみませんか?