低コスト×高性能の衝撃! ~DeepSeekの実像に迫る~

近年、大規模言語モデル(LLM)の進歩がめざましく、OpenAIのGPTシリーズやGoogleのPaLMなど、各国のテック企業がしのぎを削っています。

そんな中、中国の新興AIスタートアップ「DeepSeek」が公開した最新のモデル「DeepSeek-R1」が、大きな注目を集めています。ニュースやSNS上では「開発コストが非常に安い」「海外のアプリストアで1位を獲得した」「半導体規制をものともしない革新的技術」として話題沸騰ですが、果たしてその実力と真偽はどうなのでしょうか。

今回は、DeepSeekという企業や「DeepSeek-R1」の基本情報、公開されているベンチマークの特徴、さらには懸念点・批判的視点を含めて整理して紹介していきます。

報道や表層的な数値だけをうのみにせず、技術的・ビジネス的な背景にもしっかり目を向けながら、DeepSeekの“脅威”と“可能性”、そして“課題”を探ってみましょう。

1. DeepSeekとは何者? 〜スタートアップの概要〜

1-1. 会社の背景

DeepSeekは2023年7月に中国・杭州で設立された、比較的新しいAIスタートアップです。主に自然言語処理(NLP)やコンピュータビジョン、リアルタイム処理などの先端的なAIソリューションを手がけています。これまで官公庁や自治体、民間企業、法律関連など、多岐にわたる分野にサービスを提供してきたという点が特徴です。

参考:https://www.deepseek.com/

※アカウント作成すれば誰でも手軽に無料で使えます。

1-2. これまでの主なプロダクト

過去には「DeepSeek-V2」「DeepSeek-V3」という汎用言語モデルや、大規模コードデータの学習に特化した「DeepSeek Coder」などをリリース。特筆すべきは、これらのモデルをHugging Faceといったプラットフォーム上でオープンソース化している点。大手AI企業がクローズドモデルを保護しがちな状況で、深層学習の核となるモデルの“重み”までもオープンにしているのは、研究コミュニティから一定の評価を得ています。

2. DeepSeek-R1が“新世代”と呼ばれる理由

2-1. 概要

DeepSeek-R1は、DeepSeekが「初代の推論モデル」として位置づける大規模言語モデルです。論理推論や数学的問題解決、リアルタイム意思決定など、高度なタスクへの対応を目指した設計が特徴。公開直後に米国や英国、オーストラリアなどのApp Store無料アプリダウンロード数でトップを獲得したとの報道があり、一気に注目を集めました。

2-2. 開発の背景

最初は「DeepSeek-R1-Zero」という、強化学習(RL)のみを使った試作モデルを作成。このR1-Zeroは、あたかも「ひらめき」や「自己検証」をするような挙動が観察されましたが、言語の混在や一貫性の問題が大きかったそうです。そこで、事前学習データ(コールドスタート)+強化学習を掛け合わせる改良版のR1を完成。これにより自然言語応答の可読性や安定性が向上したといわれています。

2-3. オープンソース化

さらにDeepSeek-R1は、MIT Licenseという非常に緩やかなライセンスで公開。商用利用や改変・再配布も可能です。こうした完全オープンソースの姿勢は研究者や開発者からは称賛される一方、大手のAI企業が築いてきた独占的なモデル提供ビジネスを脅かす可能性も指摘されています。

3. ベンチマークから見る実力と、その“読み方”

DeepSeekや第三者が公表しているベンチマーク結果は、OpenAIの「o1」モデル(内部コードネームらしきもの)に迫るか、場合によってはわずかに追い越す数値も見られます。

OpenAIとの比較結果は下記の通りです。

これらを見ると、“英語の高度推論”ではまだOpenAIに一歩及ばない部分もあるものの、数学やコーディングタスクでは互角以上の結果を示しています。ただし、ベンチマークはモデル性能を一面から切り取った指標に過ぎません。実際の運用環境や多様なユーザー入力に対して、どの程度の安定性やスピードが発揮されるかは、まだ未知数な部分が多いです。

3-1. ディスティルモデルの存在

DeepSeek-R1を蒸留して小型化した「DeepSeek-R1-Distill-Qwen-32B」「DeepSeek-R1-Distill-Llama版」も公開されています。これらはモバイルやエッジ環境でも使いやすく、AI利用のハードルを下げる効果が期待されます。

3-2. 「Test Time Scaling」という学習効率化

さらに注目すべきは、推論時にモデルが生み出す「思考過程(Chain of Thought, COT)」を改めて再学習に取り込む試み。これにより、新しい大規模データを用意しなくても、モデル自身の“思考ログ”を活かして自己成長していくアイデアが紹介されています。ただし、これが本当に効果的かどうかは外部検証がまだ不十分です。

3-3. DeepSeekとOpenAIの比較

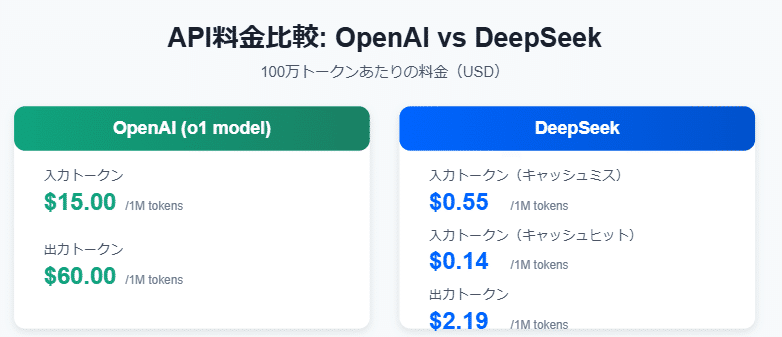

OpenAIはグローバル市場を見据えた汎用AI開発を推進する一方、DeepSeekは中国市場に特化し、産業向けAIソリューションの展開に注力しています。特筆すべきは、両社の価格戦略の違いで、DeepSeekは「AI技術の民主化」を掲げ、OpenAIと比べて大幅に低コストなAPI料金を実現しています。

技術力と市場戦略

OpenAIはGPT-4やDALL-E 3などのマルチモーダルAIで世界をリードし、Microsoftとの連携により企業向けサービスを強化。一方のDeepSeekは、中国語処理に優れたDeepSeek-R1を基盤に、金融・医療分野での特化型AIを展開しています。

OpenAIはAGI(汎用人工知能)の実現を目指し、ロボティクスなど新分野への進出を図る一方、DeepSeekは中国の「AI2030」計画と連動しながら、東南アジア市場への展開を視野に入れています。

両社の異なるアプローチは、グローバルAI市場の多様性を体現していると言えるでしょう。

OpenAIとの企業比較は下記の通りです。

4. 開発コストと効率性 〜本当の“ゲームチェンジャー”なのか?〜

DeepSeekのコスト面や半導体活用の発表は市場を大きく揺るがしています。

特に半導体関連銘柄のNVIDIAが一時、時価91兆円消失したほどのインパクトを与えています。

4-1. 他社を圧倒する開発費の低さ

DeepSeekは、R1の開発費用が約600万ドル(6〜7億円程度) だったと主張しています。一般的にGPT-3クラスの大規模モデルは数百億円規模の投資が必要と言われるため、確かに破格の安さです。この点については市場やメディアが注目しており、「AI開発コストの常識を覆す」という論調が目立っています。

しかし、あるアナリストは「過去の研究開発(R&D)費用や、外部パートナーの計算リソースを借りたコストが計上されていないのでは?」と懐疑的です。

実際に大規模モデルを安定稼働させるには、学習だけでなく推論のためのクラウドインフラにも継続的なコストがかかります。したがって、“本当に”開発・運用コストが従来の1/10以下なのかは、まだ不透明な部分が残ります。

4-2. 半導体市場へのインパクト

中国企業が先端のGPUを自由に入手できない状況で、安価なH800(NVIDIA製)を使って高性能を実現したという点も注目されています。米中のテクノロジー競争の中で、中国側が不利なハードウェア環境を逆手に取り、効率化技術を磨いているという見方もあるほどです。

一方で、こうしたニュースが広まった直後、NvidiaやASMLなどの半導体関連株が下落したのは事実です。しかし、AI関連株は投資家の思惑で短期的に大きく動きがちですので、これをもって「中国が完全に優位に立った」と判断するのは早計です。

5. DeepSeek-R1の抱える課題とリスク

5-1. セキュリティ・サイバー攻撃

リリース直後にサイバー攻撃を受け、新規アカウント作成を一時制限したという報道があります。急激に注目を集めるオープンソースモデルは、悪用リスクや攻撃リスクも高いといえます。今後、セキュリティ体制の整備は必須課題でしょう。

5-2. 応答の安定性・一貫性

ユーザーからは「他モデルの名前と混同した発言をする」「多言語が混ざり合う」といった不安定さが指摘されています。特にマルチリンガル対応の調整は、プロンプト設計や追加の微調整(ファインチューニング)が求められるケースが想定されます。

5-3. データガバナンス・プライバシー

中国企業という背景から、利用者がデータプライバシー面で慎重になる可能性があります。モデルの利用時に入力された機密情報がどのように扱われるのか、中国の法規制との絡みは気になるところです。

5-4. 第三者評価の不足

ベンチマーク結果は主にDeepSeek自身や一部関係者が公開した数値に依存しています。学術機関や独立したセキュリティ企業が継続的に検証しないと、過大評価や誤った利用リスクが懸念されます。

6. 競合企業の反応と今後の展開

6-1. 業界内の声

Meta(Yann LeCun氏): 「オープンソースAIの勝利だ」と歓迎。

Nvidia: 「素晴らしいAIの進歩で、“Test Time Scaling”の好例」と前向きなコメント。

Bernsteinアナリスト: 開発コストの主張には否定的。大規模基盤モデル上に構築したのでは? との見方。

OpenAI(Sam Altman氏): 「目を見張る」と評価した一方、より大きなコンピューティングパワーがOnenAIの成功の鍵だとコメントしました。

※https://jp.reuters.com/business/technology/355HRNJLIVMU5K5ISVCJSEYOEQ-2025-01-28/

6-2. ユーザー・コミュニティの動き

「Open R1」プロジェクトと呼ばれるコミュニティ主導の再現計画が進行しているように、オープンソースのエコシステムは活発化が見込まれます。これにより、バグ修正や独自機能の追加も分散的に行われ、モデルの成長が加速する可能性があります。

6-3. クローズドvsオープンソースの競争

OpenAIやGoogle、Metaといった企業も自社モデルのアップデートを絶えず行い、さらなる性能向上を目指しています。DeepSeekのように低コスト・短期間開発を掲げる新興企業が増えれば、クローズドモデルとオープンソースモデルの“2極化”がAI開発をより一層ヒートアップさせるでしょう。

7. まとめ 〜DeepSeekの“熱狂”と“現実”のはざまで〜

短期間&低コスト開発の主張

DeepSeekは「600万ドル」という開発費で、高性能な推論能力を持つモデルを完成させたとしています。実際にベンチマーク結果も高く、ここだけを見ると“ゲームチェンジャー”に映ります。しかし、サーバーインフラや電気代、人件費などを本当に含んでいるのかは、いまだ不透明です。オープンソースの強みと懸念

MIT Licenseでモデル重量まで公開されているのは革新的ですが、悪用リスクやセキュリティの問題も生じやすいです。さらに、中国企業特有のデータガバナンスへの不安がつきまといます。半導体規制を逆手に取った可能性

米中摩擦の中、最新GPUが入手しにくい状況がかえって効率化技術を研ぎ澄ます原動力になったという説もあり、これは他のスタートアップにとっても参考になるかもしれません。外部検証の不足

DeepSeek自身の発表に依存する部分が大きく、信頼性を補強する第三者評価や学術的レビューがまだ限定的です。市場の熱狂に比べて、実運用上での安定性や大規模商用導入の実績は少なく、過度な期待は禁物です。

DeepSeek-R1は、従来の常識を壊しかねない程の大きな可能性を秘めながら、同時に不透明な部分も多々あるモデルと言えます。

今後のアップデートやコミュニティによる“再現”が進めば、実際の実力がより明確になります。もし本当に、安価なGPUと最小限のコストで高性能な大規模言語モデルが開発可能となれば、AI開発競争の地図が塗り替えられるかもしれません。逆に、過剰な報道が先行しているだけという疑念もあり、市場へのインパクトは一時的なものに終わる可能性も否定できません。

いずれにせよ、現時点では「実態を慎重に見極める段階」 と言えます。ベンチマークで示された性能が本物なら、OpenAIやGoogleが持つ巨大リソースへの依存は相対的に下がり、より多くの企業・開発者が自由に高度なAIを作れる時代が一歩近づいたとも考えられます。

今後、数か月から1年程度は、この「DeepSeek-R1」の動向やコミュニティでの検証結果が、大いに注目されるはずです。今後もAI開発競争から目が離せません。

今回も最後までお読みいただきありがとうございます。

#AI民主化 #GameChanger #テクノロジー革命 #AIの未来

#DeepSeek #AI開発 #LLM #オープンソースAI #人工知能

#テック革新 #スタートアップ #AI投資 #次世代技術

#自然言語処理 #機械学習 #TestTimeScaling #ディープラーニング