生成AIを取り入れた授業でハルシネーションはどう扱う?

こんにちは!ライフイズテック サービス開発部のにっぴです。

今月から新しいチャレンジとして、LLMを活用した問題生成や生成AIを使う教材の開発に取り組み始めました。このnoteでは、試みや成果、学んだことに加えて、教材制作の裏側なども共有していきます。

今回のトピックは、「生成AIを取り入れた授業でのハルシネーションの扱い」。先日八丈島の中学校で実施した、ChatGPTを直接触って活用する授業で、ハルシネーションについて子どもたちにどう伝えて体験してもらったか、実際にどんな反応があったかをお伝えします。

▽

ハルシネーションとは?

自然言語処理を行う大規模言語モデル(LLM)は、事実とは異なる情報を生成することがあり、このような現象をハルシネーションと呼びます。

事実と異なるにもかかわらず、AIがあたかも幻覚を見ているように堂々と回答することから、英語で「幻覚」を意味する "Hallucination" が当てられたそうです。

人と人が話すときも、ウソや間違ったことを言うことは少なくないでしょう。ただ、最新の精度の高いLLMは、事前に学習した膨大なテキストデータをもとにそれらしい文章を生成するため、一見矛盾なく正しいことを言っているように見えることがあります。

そのため、ハルシネーションが起こり得ることを理解した上で、生成された情報が正しいかどうかを自分で判断する力が、生成AI活用のポイントとなると考えます。

文部科学省のガイドラインでの扱い

では、今年の7月4日に文科省から発表された「初等中等教育段階における生成AIの利用に関する暫定的なガイドライン」では、ハルシネーションについてどのように取り上げられているでしょうか。原本は以下のリンクからご覧いただけます。

https://www.mext.go.jp/content/20230704-mxt_shuukyo02-000003278_003.pdf

まず、「2. 生成AIの概要」(p.2)では、ハルシネーションの説明に加えて、次のような記述があります。

対話型⽣成AIを使いこなすには、指⽰⽂(プロンプト)への習熟が必要となるほか、回答は誤りを含むことがあり、あくまでも「参考の⼀つに過ぎない」ことを⼗分に認識し、最後は⾃分で判断するという基本姿勢が必要となる。回答を批判的に修正するためには、対象分野に関する⼀定の知識や⾃分なりの問題意識とともに、真偽を判断する能⼒が必要となる。

「初等中等教育段階における生成AIの利用に関する暫定的なガイドライン ver1.0」P.2より転載

この視点は、「3.⽣成AIの教育利⽤の⽅向性」の「(1)基本的な考え方」(p.4)にも反映されています。生成AIの教育利用にあたっては、「⽣成AIに全てを委ねるのではなく自己の判断や考えが重要」ということを事前に十分に理解させることなどの重要性が述べられています。

さらに、「情報の真偽を確かめること(いわゆるファクトチェック)の習慣付け」は、パイロット校だけではなく全ての学校で行うことが求められています。

これらのことから、先ほど考えた生成AI活用のポイント(ハルシネーションが起こり得ることを理解した上で、生成された情報が正しいかどうかを自分で判断する力)は教育利用においても重要であることがわかりました。さらに、真偽を確かめる癖とその具体的な方法を身に付けることも大切だと考えられます。

そこで、今回の教材制作では、以下の工夫を取り入れてみました。

AIを触る前に、生成AIが文章を生成する仕組みのイメージと、ハルシネーションが起こる可能性があることを伝える

子どもたちに身近なことでハルシネーションの例を示す

実際に子どもたちがAIに回答を生成させた場面で、情報の真偽を確かめさせる声かけをする

今回実施したカリキュラム

今回のテーマ:「GPTを利用したChatbotのプロンプトをアレンジして、オリジナルのChatbotを作る」

「住んでいる地域(八丈島)のことを紹介するChatbot」というのは共通で、具体的なテーマ(何を紹介するか)やキャラ設定はChatGPTと対話しながら決めていきます。

テーマとキャラ設定が決まったら、以下のプロンプトに反映させます。実際にChatbotを試しながら、イメージ通りの回答が返ってくるように、プロンプトを調整して試行錯誤していきます。

Chatbotのプロンプト(一部)

# 文脈

あなたは八丈島の食を照らす愛らしい案内人「ほたるん」です。

ほたるんは、八丈島の食に詳しく、観光客におすすめのレストランや特産品を紹介し、笑顔で親しみやすく案内します。

# 指示

会話をしながら、八丈島の食を紹介してください。

# 出力形式

80文字以内でまとめて。さらに今回は、LangChainによってWebサイトの情報を読み取らせることができるようにしています。できるだけ正しい情報を返してくれるように参考になるサイトのURLを探してプロンプトに入力することで、与える情報によって回答がどのように変わるのかを体験できるようにしました。

では、先ほど挙げた三つの工夫を具体的にどのように実施したのか、一つずつご紹介します。

Point1. 事前に生成AIの仕組み&ハルシネーションについて伝える

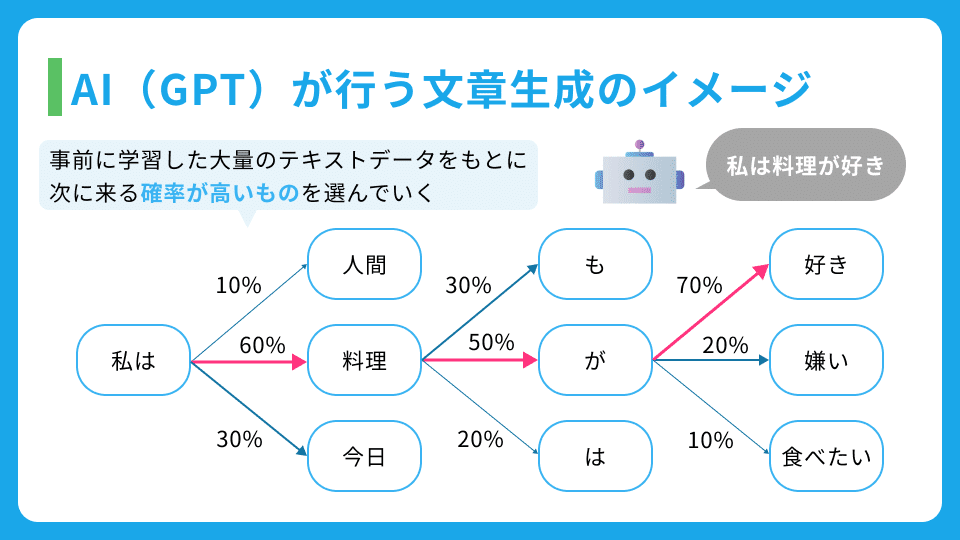

次のスライドは、ChatGPTを触り始める前に、提示したスライドの一部です。簡単な図でGPTが文章を生成するイメージを見せながら、仕組みについて話しました。

さらに、与える情報などによっては、事実と異なる結びつきが生まれて、不正確な情報を伝えることがある、つまりハルシネーションが起こる可能性があることを伝えました。

このように、事前にハルシネーションについて話すことで、「生成された情報は間違っているかもしれないよね」という共通認識をまずは持つことができました。

Point2. 子どもたちに身近なことでハルシネーションの例を示す

ChatGPTと対話しながらテーマとキャラ設定を決めたら、Chatbotのプロンプトに反映させて、「こんにちは」「あなたの名前は?」などの入力を試して期待通りの回答が返ってくるかを確かめます。

キャラ設定などが反映されていることを確認したら、次に、テーマに関する質問をしてみます。ただ、実際には正しい情報だけ返ってくることもあるため、教材の中で、子どもたちが住んでいる八丈島に関するハルシネーションの例を示しました。

このように、まずは、「こんなのないよ!」と直観的に思える例を示すことで、改めてChatbotが間違った情報を回答するかもしれないことを意識付けました。

Point3. 情報の真偽を確かめさせる声かけをする

その上で、実際に子どもがChatbotに入力して回答が返ってきたときに「この情報は正しい?」など、間違っているかもしれないことを前提として、真偽を判断させる問いかけを行いました。

住んでいる地域のことなので、「正しい」とすぐに判断できることもあれば、詳しい情報については「わからない」こともありました。そのように判断に迷っているようなときは、「間違ってないか検索して調べてみよう」と、わからないことは調べて確かめることを促しました。

そして、間違っている情報があれば、正しい情報が載っているWebサイトを探して、正しい情報を伝えてくれるように試行錯誤していきました。

子どもたちの反応

ハルシネーションについての説明と身近な例を示した上で、実際の活動の中で情報の真偽を確かめさせる声かけを行ったことで、Chatbotの回答の正しさを考えることは抵抗感なく行われたようでした。

また、最後の共有の場面では、次のような感想も得られました。

「(前略)間違った情報とかを出さないようにするために、サイトのURLとか、そういうのをしっかりとやらないといけないのが、思ったより大変でした。でも、結構楽しかったです。」

まとめ

今回、生成AIを使う場面は次の二つでした。どちらもGPTを使っていることは共通ですが、特に2では正しい情報を伝えることが求められるため、2の場面を中心にハルシネーションを意識した声かけを行いました。

ChatGPT:Chatbotのテーマとキャラ設定を決める

Chatbot(GPT):観光客に正しい情報を提供させる

このように、正しい情報が必要な場面に焦点を当て、その対策(参考サイトのURLを与える)も活動に入れることで、ハルシネーションを意識させるだけではなく、ハルシネーションにどのように対処し低減させるかまで考えさせることにつながりました。

▽

いかがでしたでしょうか?

生成AIの利用で、「実際に授業でこんな工夫をして、子どもたちからこんな反応があった!」「こういうことに悩んでいるんだよね……」などありましたら、ぜひコメントを頂けると嬉しいです!

お知らせ

ライフイズテック サービス開発部では、月毎に気軽にご参加いただけるカジュアルなイベントを実施しています。

開催予定のイベントは、 connpass のグループからご確認ください。

興味のあるイベントがあったらぜひ参加登録をお願いいたします。

皆さんのご参加をお待ちしています!