動画生成AI(Runway)でアニメ調キャラクターを動かす方法

次の動画の作り方を解説します。

AI animation test shot pic.twitter.com/BB0moOGJE8

— nbykos (@nbykos) September 13, 2024

Runwayのimage-to-videoで生成しました。

以下は手順です。

nijijourneyで「アニメ調ゲーム風」のイラストを作成

Runway Gen-3 alpha turboでimage-to-videoで生成

1. nijijourneyで「アニメ調ゲーム風」のイラストを作成

nijijourneyで元画像を生成します。ポイントは「アニメ調のゲーム風」に仕上げることです。今回は以下の生成画像を使いました。プロンプトはキャプションに貼り付けておきます。

なぜアニメ調ゲーム風が良いのか?

基本的にどの動画生成AIも実写が基本です。i2vの場合、動画生成AIは提供された画像から動きを作り出すのですが、その表現の引き出しは実写動画が多いのです。そんな動画生成AIに対して、無理矢理プロンプトで表現させようとすると何が起きるのか?表現の引き出しの多い実写から無理矢理動きを持ってくるのです。その結果、イラストキャラクターが骨張ったリアルポリコレ女に化ける現象が起きます。ホラーです。

しかし実写の引き出しが使えるアニメ調の表現があります。それがCGでありゲームです。特に原神のようなアニメ調のゲーム画像は実写ほどではないにしろ、破綻しない程度に動きを付け足すことができます。

重要な点は動画生成AIに対して「これはゲーム画像だな」と思わせることです。上記画像のプロンプトを読むとわかりますが、`3D art, 3D, Blender, OC renderer` という様にCGのレンダリングですよという記載があります。この程度でもCGっぽさが出てAIの認識を誤魔化すことができます。光の具合が重要っぽいです。

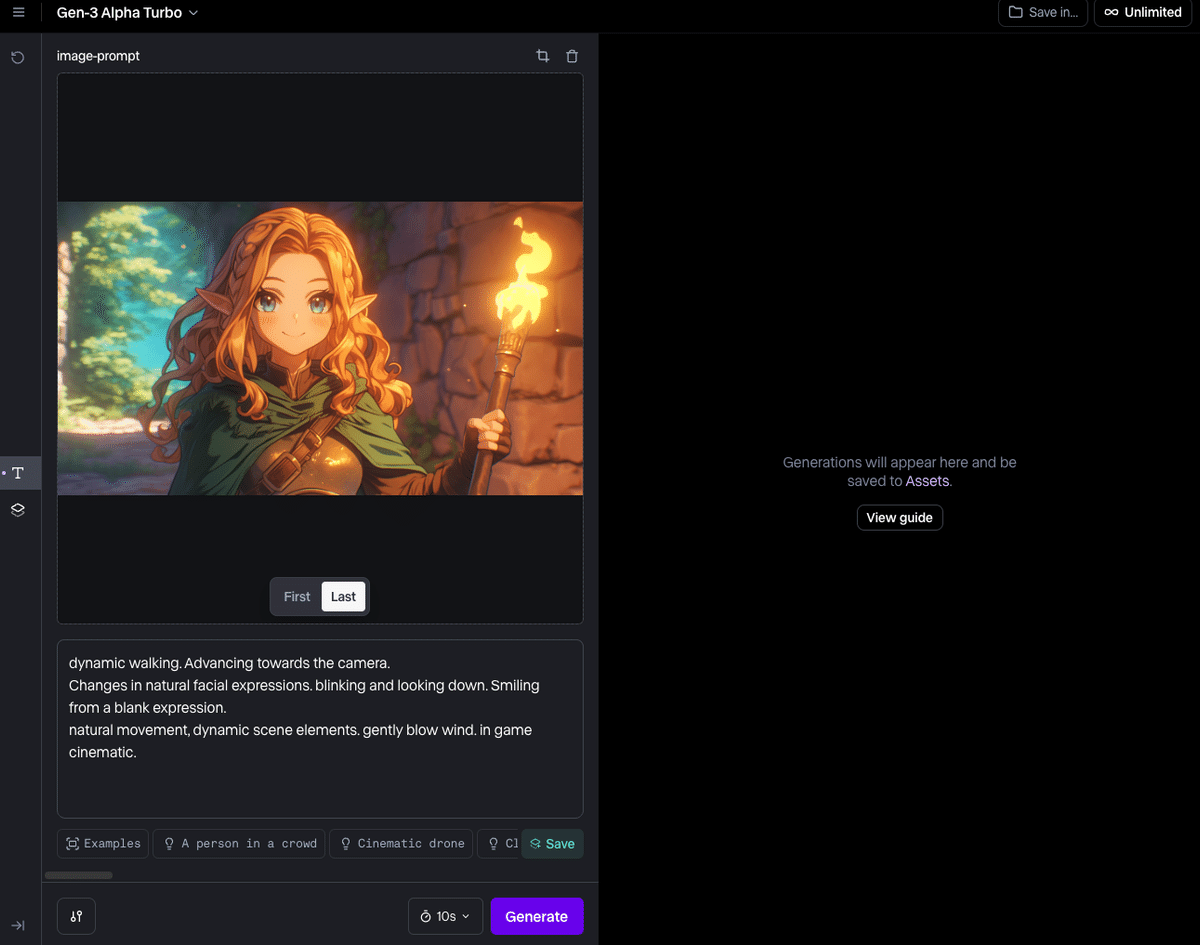

2. Runway Gen-3 alpha turboでimage-to-video生成

生成した画像をEnd Frameに指定します。プロンプトは以下です。

dynamic walking. Advancing towards the camera.

Changes in natural facial expressions. blinking and looking down. Smiling from a blank expression.

natural movement, dynamic scene elements. gently blow wind. in game cinematic.

諸々セットアップが揃うとこんな感じになるはず。

あとは複数回試行してください。Gen-3 Alpha Turboはかなり一貫性が高いため、ガチャにも限度があります。2、3回試してうまく効果が出ない場合はプロンプトや画像そのものを変えてみましょう。FrameをStart/End切り替えるのも効果の違いが出て学びになります。

なぜEnd Frameを指定したのか?

これは経験則なのですが、Turboの場合はStart FrameよりもEnd Frameの方がプロンプトの指示を受け付けてくれる印象があります。推測ですが、Turboは高い一貫性を発揮するために元フレームをできるだけ維持するのかもしれません。End Frame指定なら最終的にそのフレームに収まればいいので、多少は無茶してくれるのかも。

いずれにせよ、Turboを使う場合はStart Frameよりも先にEnd Frameを試すとプロンプトの効果を可視化しやすい印象ですね。おすすめです。

動画プロンプトの説明

dynamic walking

ただのwalkingだと緩慢だったり、動きが鈍かったりします。画像が実写ではない場合、そもそも歩いてくれなかったりします(人間以外が歩くのはおかしいから)。「dynamic」とつけて動きを強調することで歩きモーションが発生しやすくなります。

Advancing towards the camera

動画生成AIの謎の一つですが、人を歩かせるとなぜか奥に向かって歩くことが多いです。もし画面内の人物が手前を向いていると、後ろ向きに歩きます。「カメラに向かって前進しろ」と指定することでこれを回避します。

ちなみに、車はこれと反対の現象が起きがちです。画面手前に向かって進みたがるので、車が奥を向いていると猛烈な勢いでバックし始めます。

Changes in natural facial expressions. blinking and looking down. Smiling from a blank expression.

これは「表情を動かせ!」という苦肉の策です。AIに対して「表情を動かしていいんだよ、瞬きしていいんだよ、視線を動かしていいんだよ」って伝えてます。正直、この指定通りに動きません。でも表情自体は動きます。

もしここで欲張って「エルフは艶っぽい表情で視線を動かして何ちゃら!」みたいな気合を入れると実写化します。主語を敢えて省き、AIに空気を読ませることが実写化させない工夫ですね。というかこれが限界でした。他に方法ご存知の方いたら教えてください。

natural movement, dynamic scene elements. gently blow wind. in game cinematic.

前半の文句は常套句として使えます。画面内の要素を自然に動かしたいのならとりあえず入れて良いでしょう。後半の風とゲームシネマティックというのはもはや祈りですね。それでもあるなしでわずかに違いが出る気はしています。

同じ手法で生成した具体例

最初のXポストのリプライツリーにもぶら下がっていますが、いくつか貼り付けます。全て上記と同じ方法で生成しています。

— nbykos (@nbykos) September 14, 2024

アーーニャ#runwayml gen-3 turbo pic.twitter.com/qHSZIIK28l

— nbykos (@nbykos) September 2, 2024

— nbykos (@nbykos) September 13, 2024

ぜひお試しあれ!

そして再現可能な知見だったか知りたい。

Twitter(新X)で画像生成と動画生成について投稿してます。今後はもっと使い方の参考になるものを発信していこうと思うのでぜひフォローしてね!

https://x.com/nbykos

この記事が気に入ったらサポートをしてみませんか?