生成AIはこわくない_Vol2ノーコード・ローコードで試してみよう

はじめに

この記事はGoogle Cloud Champion Innovators Advent Calendar 2024 の17日目の記事です。

生成AIが「なんかこわくてチャレンジできない」人がいるらしいと聞いてタイトルを決めました。

Vol1では基礎知識編を書いたので、Vol2は実際に使って見たいと思います。

コードを書かなくても、ドラッグアンドドロップでモデルを構築できる(!)Vertex AI Studioをご紹介します。

対象者

生成AIを実際に使ってみたい人

ノーコード、ローコードでLLMを試してみたい人

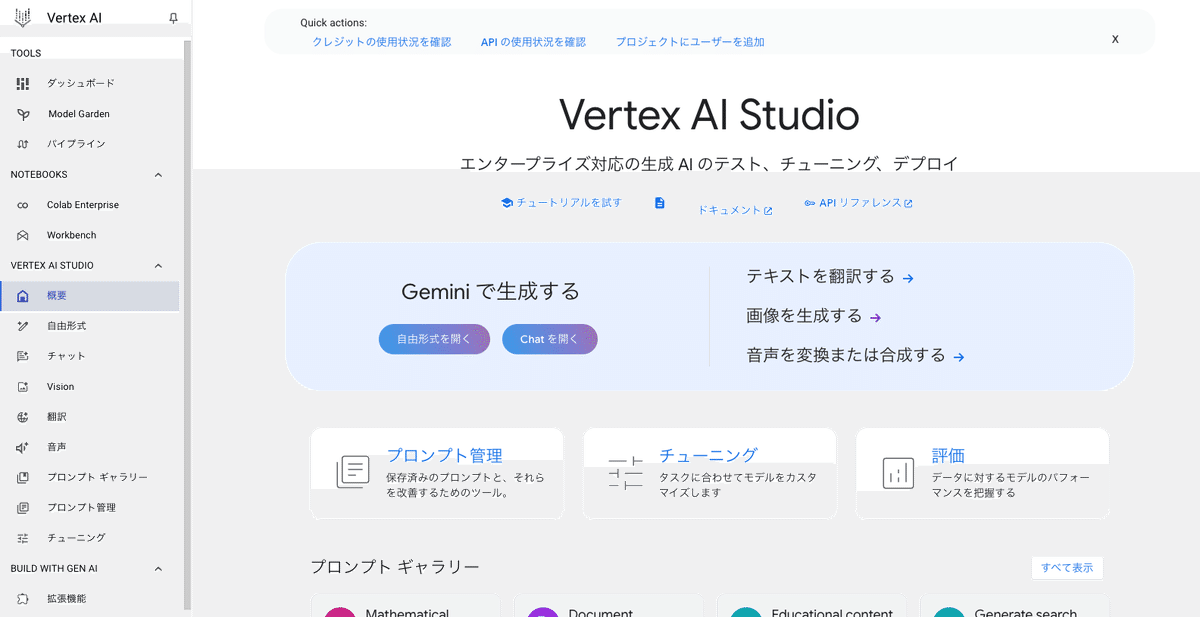

Vertex AI Studioの概要

ここではまずVertex AI Studioの概要を説明します。

適宜飛ばしていただければと思います

Vertex AI Studioは、Google Cloudが提供する、機械学習モデルの開発を率化するためのフルマネージドな開発環境です。

特に、生成AIの開発に特化しており、自然言語処理、画像生成、音声認識など、様々なAIモデルを簡単に作成・デプロイすることができます。

Vertex AI Studioを起動する

GoogleCloudのコンソール画面からVertex AI Studioを起動します。

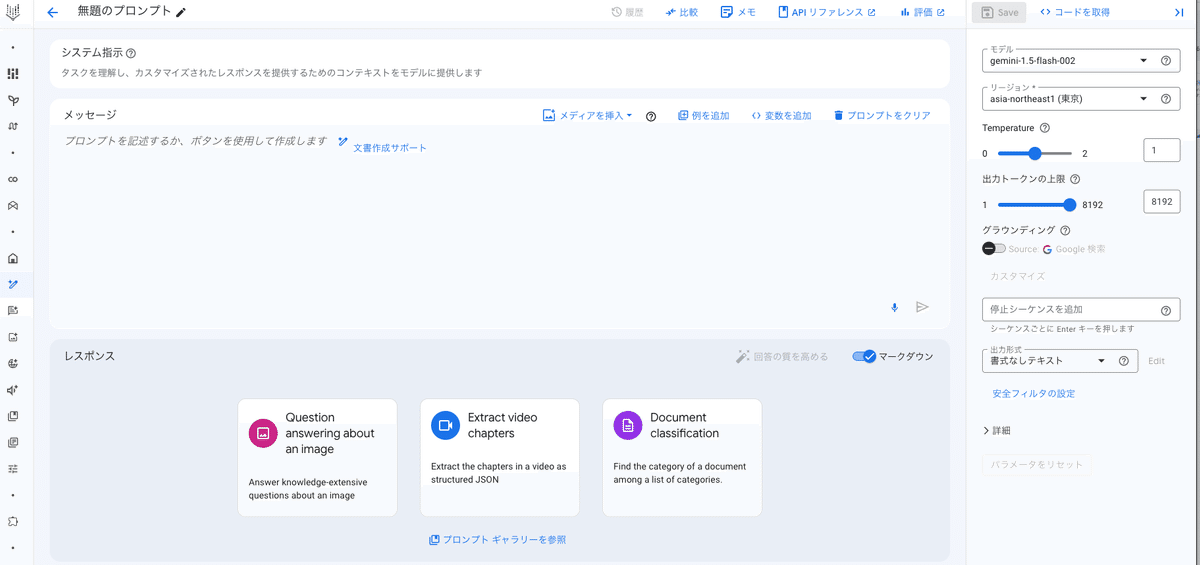

以下にメニュー共通ででてくる各パラメータについて解説していきます。

これらのパラメータはコンソール画面での実行に限らずコマンドでの実行時も設定可能です。

モデルの選択

GeminiAPIで利用可能なモデルについてはGoogleCloudの公式ドキュメントを確認しましょう。

それぞれ特徴があるので目的に合わせて選定してください。

初めてだしよくわからないという方はひとまずGemini 1.5 Flashで良いかと思います(簡単に言うとコスパが良いから)。

※実は12/12にGemini 2.0 Flashも登場したので試したのですが、後述の商品棚解析は1.5の方がしっくり来ました。ただ2.0はレスポンスも更に早いですし、これからに期待です。

Temperature

生成されるテキストの「ランダム性」や「創造性」を制御するために使われます。以下に目安を示しますので実際に値を変動させて回答の変化を見てみても良いでしょう。

高いTemperature(例: 1.0以上)

モデルの出力がランダムで多様性が高くなります。

より創造的で予測不可能な回答が生成されやすいです。

例えば、質問に対して複数の異なる解釈や意外性のある答えが得られます。

低いTemperature(例: 0.1〜0.3)

モデルの出力が決定論的で確定的になります。

より予測可能で一貫した回答が生成されます。ランダム性が抑えられるため、堅実で正確な回答が得られることが多いです。

高い精度が求められるタスクでは有効です。

0.0に近いTemperature:

モデルはほぼ最も確率の高い選択肢のみを選ぶようになります。生成されるテキストは非常に「保守的」で、決まった答えだけが出力される傾向があります。

出力トークンの上限

言葉の通り1 つのプロンプトに対して出力されるテキストの最大量を定義するものです。

出力トークンはコストに直接影響します。長文を生成すればするほど、コストが高くなります。

出力トークンを制御する以外にプロンプトで「何文字で答えて」というようにモデルの応答が長すぎないように設定するという方法もあります。

シード

生成結果の再現性: 同じシード値を用いれば、何度同じプロンプトを入力しても、ほぼ同じテキストが生成されます。これは、実験やデバッグの際に非常に役立ちます。

異なるシード値で生成されたテキストを比較することで、モデルのパラメータやプロンプトの変更が生成結果にどのような影響を与えるかなどを分析するという活用方法もあります。

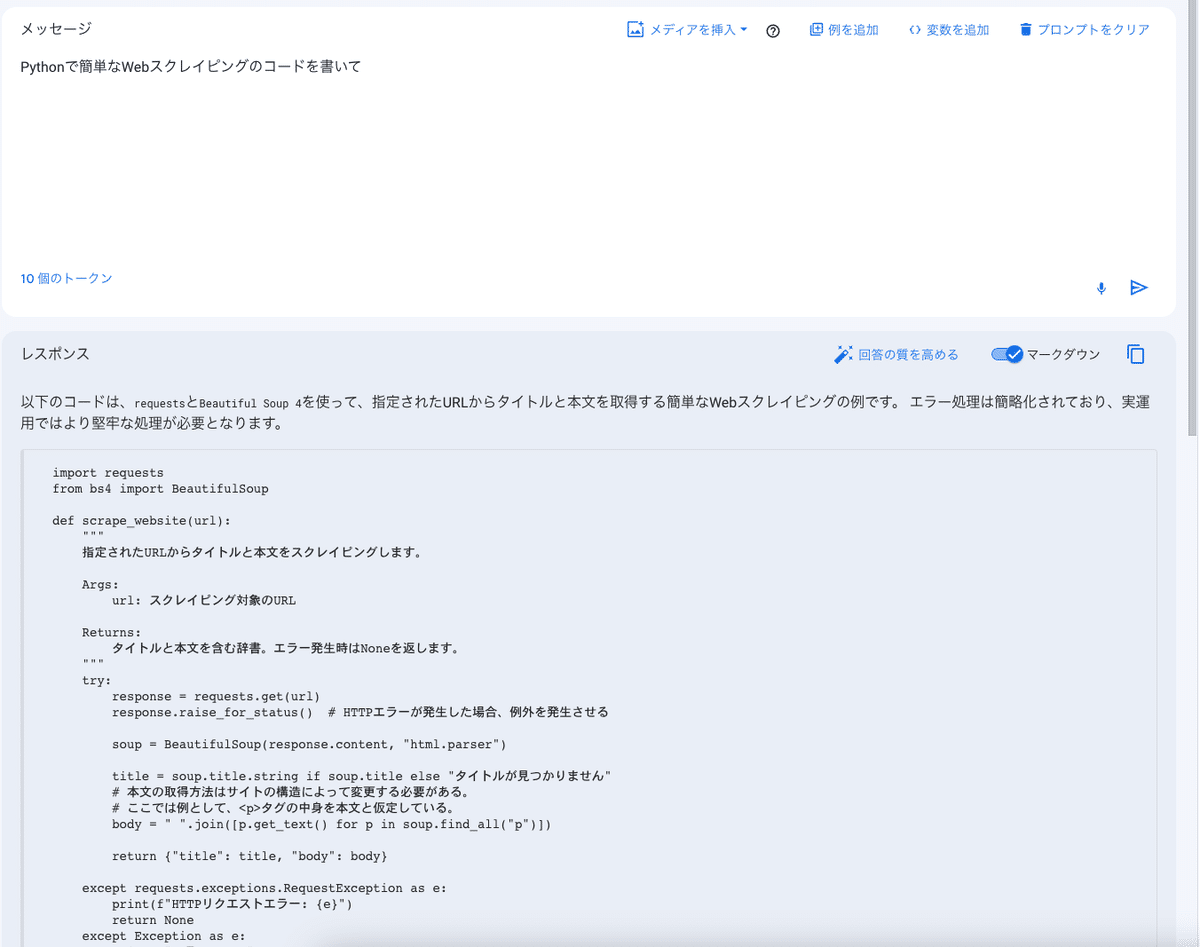

メニュ−1.自由形式

ユーザーが具体的な指示を自由に入力し、それに基づいてAIが多様な作業を実行することをサポートする機能です。

試しにコード生成のプロンプトを投げて見ました。

よそ見している間に書いてくれました(早い)。

この例ではテキスト入力に対してテキストを出力してもらっていますが、テキスト、コード、画像、音声、動画、音声付き動画、PDFを入力として使うことができます。

自由形式のメリット

柔軟性: どんなプロンプトでも試せるので、アイデア次第で様々なことができる

創造性: 新しいアイデアやコンテンツを生成できる

効率化: 繰り返し行う作業を自動化できる

学習: AIモデルの機能を深く理解できる

メニュー2.チャット

実際にチャット機能を試した画面ショットです。

使った写真はこちら

「惜しい!!コンビニじゃなくてスーパー!!」と写真のソースを知っている私は思いますが、これだけ見たらたしかにスーパーかコンビニかは判断つかないかもしれないですね。

そしてメーカーやブランド名をちゃんと答えてくれる。

賢いです。

チャット機能ではこのように会話形式で進めていくことができるので前の質問の続きを聞くこともできますね。

メニュー3.Vision

vision機能ではテキストプロンプトを元に画像生成が可能です。

ただ残念ながらこちらはまだ一部ユーザーに利用を制限しているため公開されたら試してみたいと思います。

メニュー4.翻訳

これだけ見るとGoogle翻訳と何が違うのかとなってしまいますね

個人的に便利だなと思うのは「例の追加」機能で、専門用語や独特の言い回しを例として追加できるところかなと思います。

昔、論文読んでてよくわからないところを英語の得意な人に聞いたのですが、専門用語がわからず「これってどういう事?」みたいなやり取りがありました。そういった独特の言い回しが登場するようなシーンで良い感じに使えそうだなと思ってます。

メニュー5.音声

聞きたい!という方は是非試してみてください。このパターンだと日本語の得意な外国の人みたいな感じで流暢に読み上げてくれました。

今度は私が枕草子を読み上げてテキストに落としてもらいました

古文なのもあり漢字が若干違いますが、音としては間違えてない。

滑舌が対して良くない私の声でも間違えないでくれました。

議事録などに使ってもバッチリですね。

VertixAIStudioの便利なところ

コードの自動生成

ここまであまり触れないで来てしまいましたが、実は「メニュ−1.自由形式」のところからずっと右上に「コードを取得」というのがあるのをお気づきでしょうか?

なんと、ここを開くと勝手にコードを書いてくれているのです。

コンソール画面で指定したパラメータも設定してくれています。

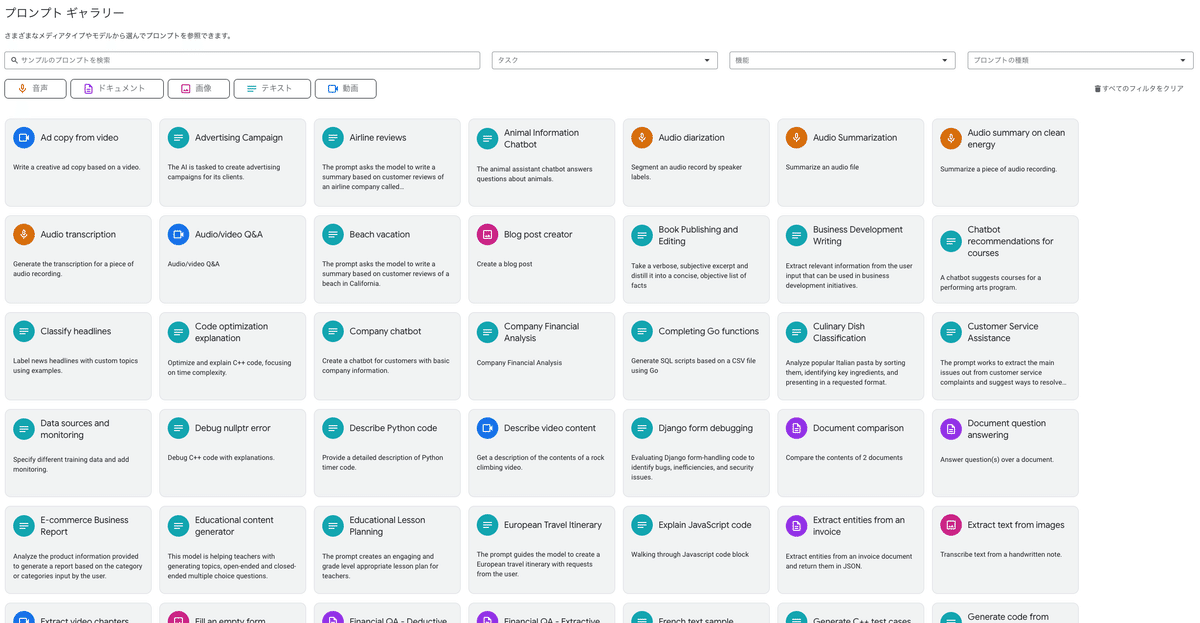

プロンプトギャラリー

サンプルを選択すると、Google の生成 AI モデルのプロンプトとレスポンスの例が表示されます。

タスクや機能などを指定して検索が可能です。

コンソールでプロンプトを表示してテストすることもできます。

こちらのドキュメントから行くと日本語で表示されているのでわかりやすいかもしれません。

Model Garden

さて、ここまでできたらもっと色々試して実装したいですよね?

ModelGardenにはGoogle 製、サードパーティ製、オープンソース製などの150を超えるモデルがあります。

そしてこれらのモデルを活用し、エンドポイントへのワンタッチデプロイ、Jupyter Notebookからの操作によるファインチューニングなどができます。

実際にコンソールを開いてみるとわかるのですが

モダリティ、タスク、プロバイダ、特徴などでセレクトしていくことが可能です。

項目を選んでいくとフィルタリングがなされ、モデルを絞り込んでいくことができます

生成AIが怖くなくなったら是非試してみましょう。

今回は初心者向けにVertex AI Studioの話を書来ましたが、ご要望が多ければ今度はModelGardenの使い方を書いてみたいと思います。

おまけ

11月にKaggleでGoogle による 5 日間の Gen AI 集中コースが開催されて、周囲でもかなり好評だったのですが、自分のペースで学べるコースとして公開されました!

5-Day Gen AI Intensive Course with Google Now as a Learn Guide!