【これからの進化に期待】Stable Video Diffusion ファーストインプレッション

ライフイズテックのサービス開発部 CTO室(AI Lab)に所属しているひでさんです。

Stable Video Diffusion発表

2023/11/22、画像生成AI「Stable Diffusion」を開発するStability AIが、テキストや画像から高解像度の動画を生成できる新しいDiffusionモデル「Stable Video Diffusion」を発表しました。下記のYoutube動画のように、

Astronaut walking on the moon (月面を歩く宇宙飛行士)

と入力すれば、月を歩く宇宙飛行士の動画が生成される、といったことが実現可能になります。

テキストや画像からの動画生成というと動画生成Runway ( https://runwayml.com/ ) が広く使われており、他の追随を許さない感じだったので、画像生成の源流であるStability AIから動画生成のモデルが発表されたことで、動画生成の分野の更なる進化スピードの加速しそうです。

発表されたStable Video Diffusion、現在試せるのは、画像から動画を生成する(img 2 movie)モデルで、テキストから動画を生成する(text 2 movie)モデルは今後公開予定(※)とのこと。

(※)text 2 movieモデルをいち早く使えいたい方はこちらからWaitlistへ申し込みをしてください。

Google Colaboで試す

先行して公開されてimg 2 movieのモデルを使ってみましょう。Stability AI社所属の @mkshing さんが、x上でGoogle Colabo(無料版でもOK)で実行可能なnotebookを提供してくれていますので今回はこちらを利用してみます。

Stable Video Diffusionも早く触りたいでも、リソースやどうやって試せば良いのか分からないという方!

— mkshing (@mk1stats) November 22, 2023

Colabのフリープランで試せるようにハックしました。どうぞお試しください〜。

Colab: https://t.co/SiYDRzLxTA#StableVideo

初期画像は #JSDXL から生成。 https://t.co/RUOY5QBAPD pic.twitter.com/CplEznLsJ2

@mkshing さん提供のGoogle Colaboの Notebook を開いたら、「ファイル」>「ドライブにコピーを保存」して作業を開始しましょう。

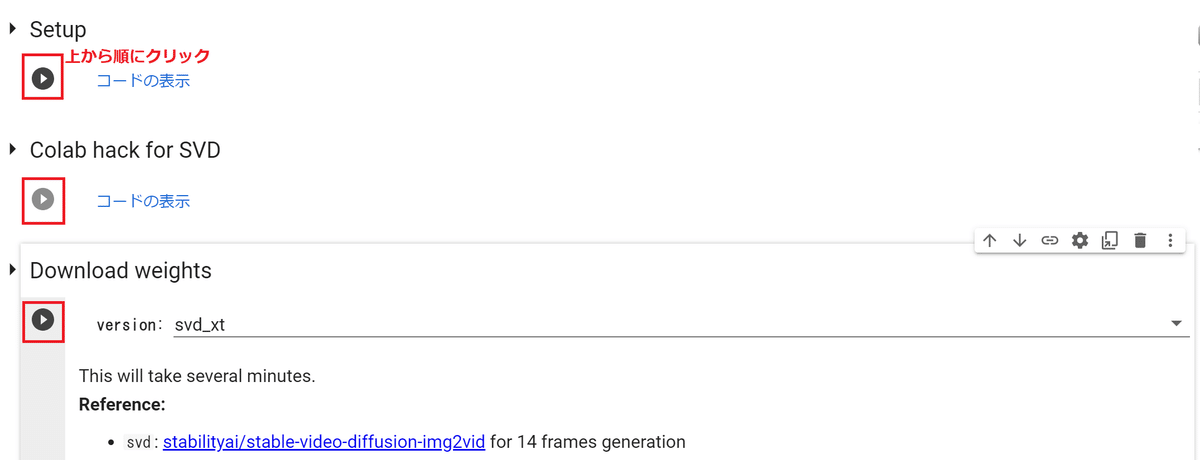

あとは、「Setup」「Colabo hack for SVD」・・・というように上から順に並んでいる実行ボタン(下図参照)を押して必要な処理を実行していきます。

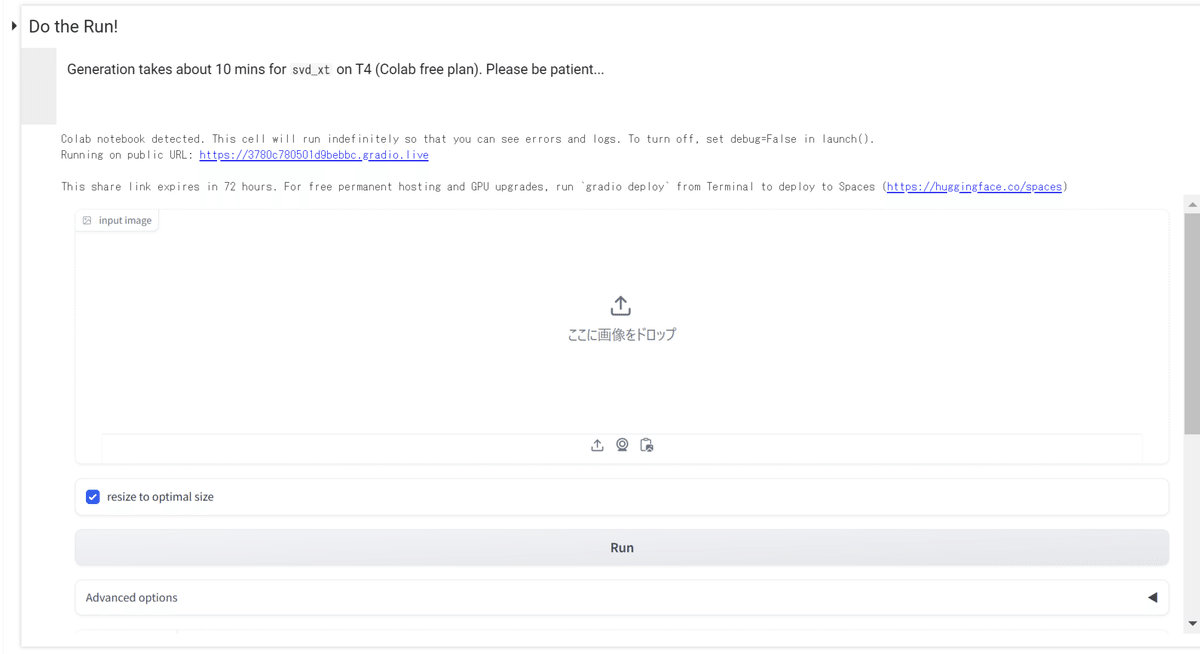

少し時間がかかりますが気長に待ちましょう「Do the Run!」まで実行出来たら準備完了で下記のようなUIが出てきますので、上部に変換したい画像を設定して「Run」を押すだけでOKです。(簡単ですね。)

サンプル1

バスケをしている様子を動かしてみる

⇒ドリブルをする様子を生成しようしているが、破綻してしまっている(ただし、地面にボールがドルブルするな動きが見えているのは可能性を感じる)

サンプル2

ファンタジーゲームにでてきそうな男性キャラ

⇒背景がうまく動いた! 本来なら、人物が待ちを歩く動画になることを期待したいが・・・

まとめ

今回は、先週公開されたStable Video Diffusionをまずは触ってみました。

[img 2 movie] オープンソース(注意点あり)で公開された。任意の画像を選ぶだけでAIが自動的に動かせる場所を判別して動かしてくれる。

精度はまだまだの印象。今後の進化に期待。

[img 2 movie] 動かす領域の指定などはカスタマイズには対応していない

runway については最近静止画を読み込み専用ツールでなぞると指定した箇所を動かせるMotion Brushを提供開始済み。

[text 2 movie] まだ公開されていないため試すことはできない。

[img 2 movie](公開はまだだが)、[text 2 movie]のオープンソース(注意点あり)での公開により、この動画生成の進化は一層加速すると思われる。

注意点:オープンソースで公開はされましたが、現在は研究目的のみの利用であり商用目的での利用は不可です。

今後すさまじい進化を遂げていくであろう画像生成に注目です。また、アップデートがあればレポートしたいと思います。

お知らせ

ライフイズテック サービス開発部では、カジュアルなオンラインイベントを実施しています。開催予定のイベントは、 connpass のグループからご確認いただけます。興味のあるイベントがあったらまずは参加登録をお願いいたします。ぜひお気軽にご参加ください!