【Live2D】口あいうえお(母音)チェックを自前でサクッとやる方法

はじめまして、倉津と申します。

Live2Dモデラーとしてはまだまだ修行中の身で、主にHTML/CSSコーダー兼デザイナー兼イラストレーターとして活動しています。

📢2025/02/05 追記

この記事は3年前のものであり、現状に合致しない点もあるかと思います。Live2D公式さんで最新版「あいうえお」についての動画がございますので、ぜひそちらも参考になさってみてください!

はじめに

Live2Dモデルを配信等で動かす場合、必須になるのが…そう、トラッキングソフトですね。長年、定番ソフトとして愛用されていた「Face Rig」の他、その後継となる「Animaze」、そして新しいながらも最近よく見かけるのが「Vtube Studio」ではないでしょうか。

リップシンク(口パク)を作る時、ただ開閉させるだけではなく、きちんと母音(あいうえお)を意識して作ることも多いと思います。

その時に悩ましいのが「どのパラメータに、どの母音を割り振るか」!

そもそもアプリごとに結構な違いがあります。

やっかいなのが「例え同じトラッキングソフトを使っても、口の開閉の癖には個人差があり、さらにカメラの性能差もある」という点です。

さらに「Vtube Studio」では「iOS系とWebカメラ/Androidで差が出る」という、頭を抱えたくなるような事象が発生します。

それでも「Face Rig」などは長年愛用されてきただけあり、母音のパラメータ割り振りについても情報が揃っていますが、新人の「Vtube Studio」などは前述した事象も相まって、まだまだ母音パラメータの情報が少ないです。

「ネットで情報を探し回るより、自前でチェックできないか?」

と思ったことがきっかけで生まれたチェック方法です。とはいえ、その方法はびっくりするほどシンプル。サクッと説明していきますね。

①下記の画像をレイヤー別に用意

・口開閉&口変形の錬結時のパラメータ表

・パラメータ用のポインター

▲これは「口 変形5点×口 開閉5点」で錬結してる場合

(5点はあくまで私の場合なので、普段ご自分が作る数でどうぞ!)

▲ポインター画像

②全パラメータにポインター設定

ひたすら、パラメータと同じところにポインター画像をセットします。

このサンプルでは「口 変形5点×口 開閉5点」パターンですが、もちろん、自分のモデルのパラメータ割り振りに合わせて作成してください。

出来上がり図 pic.twitter.com/agWFWOoFmy

— 倉津@Live2Dもやってます (@krt_pbw) May 16, 2021

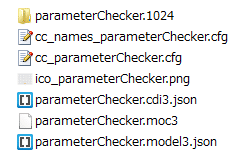

③moc3ファイルに書き出し

終わったら通常のモデルと同じように、moc3ファイルを書き出します。

※下図は「Face Rig」向けに用意したファイル一式

④トラッキングソフトにモデル読み込み

いよいよ楽しい(?)チェック開始です。

こちらは、Windows+Webカメラの「Vtube Studio」でチェックをしている様子です。iOSだとまた結構、違うらしいです。

ちなみに「Vtube Studio」でチェック時は事前に精度調整しました。

(主に「Mouth Smile」と「Mouth Open」の2つ)

チェック開始! pic.twitter.com/0xegPbboW9

— 倉津@Live2Dもやってます (@krt_pbw) May 16, 2021

⑤母音の位置をメモする

「あ」「い」「う」「え」「お」の発音時、どこにパラメータがいくのか、位置をメモしましょう。動画で撮ってもよし、手描きしてもよし。

あまりにもひどい手描きのメモを晒しておきます。

あくまでも「倉津の場合」のパターンです。フォロワーさんにも試してもらいましたが、想定以上に結果が異なりました!

特に「Vtube Studio」の場合、「笑顔気味の『あ』」とか「真顔の『い』」などでもパラメータの飛ぶ位置が異なってくるので大変です。

日を変えて実施すると、昨日の自分自身とも微妙に結果が違う時も……

モーメント用に投稿。現状の最新版…これ、チェックするたびに微妙な差が出てくる気がするので、どこかで折り合いを付けるしかない pic.twitter.com/cqst2oERQv

— 倉津@Live2Dもやってます (@krt_pbw) May 16, 2021

⑥モデルに実装(ゴール!!)

私の場合は「Vtube StudioとFace Rigで共用できる母音パラ」を探るために今回のチェックを実施しました。共用となると大変だなぁ…

なんと言ってもOS差でも異なってくるのが大変。

モデル2体を同時に動かせるFaceRigでテストすると楽しい#Live2D pic.twitter.com/PgyTgTFkQO

— 倉津@Live2Dもやってます (@krt_pbw) May 16, 2021

結局は個人差&OS環境差&カメラ性能差などで変わってきてしまうので難しいところですが、セルフ受肉の人は「完全セルフ仕様」の母音を実装できるでしょうし、受注制作の場合は事前にクライアント側で母音チェックした結果をもらっておくとスムーズかもしれませんね。

さいごに

母音にこだわりすぎるとドツボに嵌まる感じなので、そこそこで脱出して次へ進む方がいいなというのを実感してます。特に「い」が難しい…!

ただいま上記のSDキャラを素体にした、SDモデルをリリース中です!

旧版よりアップデートしたものになります。

新版では口の開閉も公式を参考にしていますのでご了承ください。

ブログで「Live2D」の奮闘ログなども綴ってます。

完全ビギナー時代のログは「初心者がハマってもがいてる様子」となっているので先達には「懐かしいな…うちにもそういう時代あったかも」と懐古していただけるかと思います。

いいなと思ったら応援しよう!