scikit-learn機械学習㉔SVM理論3:カーネル・トリック

前回までにマージンの最大化とソフト・マージンによるサポート・ベクトル分類器について紹介してきました。

ただし、これまでずっと線形分離が可能なケースを取り上げてきました。

例えば、下図は2次元データにおいてマージンの最大化による分割を行ったものです。この境界は直線となっています。

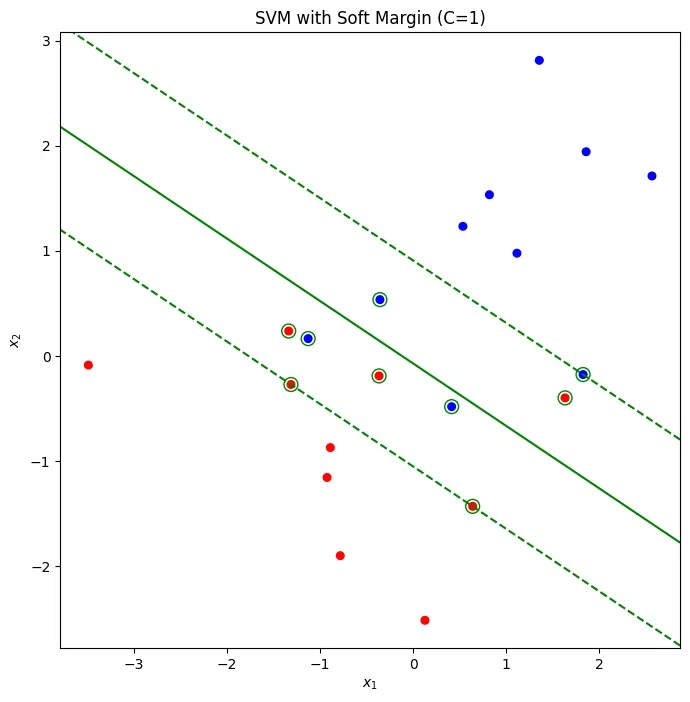

また、下図はソフト・マージンを導入したケースです。

マージンの中にデータポイントが入り込んでいますが、ある程度の線形分離が可能であればそれなりに良い分類予測が行えます。また、過学習を防ぐ効果もありました。

しかし、これらは基本的には線形分離可能なデータを扱っています。では、データの分布がそもそも非線形だとしたらどうでしょうか。

実は、このような非線形な境界を持つデータでも、カーネル・トリックを使うことで線形分離が可能になります。サポートベクトルマシン(SVM)では、このカーネル・トリックが非常に特徴的であり、非線形な分類問題に対しても強力な手法となっています。

この記事では、カーネル・トリックの仕組みを紹介します。

この記事が気に入ったらチップで応援してみませんか?