Midjourneyキラー!?話題の画像生成AI「FLUX.1」を試す

こんにちは、スクーティーという生成AIを活用したシステム開発が得意な会社の代表をやっているかけやと申します。

FLUX.1が話題です。

FLUX.1 は、Stable Diffusion 3 のリリース後、開発元を離れたメンバーにより設立された Black Forest Labs 社による、高性能なオープンソースの Text-to-Image モデルです。Midjourney に匹敵する高品質な画像を生成できる上に、複雑なプロンプト記述が不要な点も魅力です。

本記事では、FLUX.1を実際に動作させる方法をステップバイステップで解説します。

FLUX.1とは

FLUX.1は、Stable Diffusionの開発者たちが立ち上げたBlack Forest Labs (BFL)が発表した最新の画像生成AIモデルです。120億ものパラメータを誇るFLUX.1は、プロンプトの指示に忠実に従い、画像中に文字も入れられる点が特徴的です

Black Forest Labsについて

Black Forest Labs (BFL)は、元Stable Diffusionの開発者メンバーであるRobin Rombach氏、Patrick Esser氏、Andreas Blattmann氏などによって2024年に設立されたAI企業です。3100万ドルの資金調達に成功し、コンテンツ制作業界で豊富な経験を持つMichael Ovitz氏や、ニューラルスタイル転送の先駆者であるMatthias Bethge教授らを迎えたアドバイザリーボードを擁しています。

FLUX.1の3つのバリエーションモデル

BFLは利用者のニーズに対応するため、以下の3つのバリエーションモデルを提供しています。

FLUX.1[pro]

商用利用: 商用利用が可能で、企業やプロジェクトでの使用に適しています。

アクセス方法: APIを通じて提供され、利用には料金が発生します(1枚あたり約0.05ドル)。

品質: 最高性能モデルであり、画像生成の品質、プロンプトの忠実度、出力の多様性が非常に高いです。

FLUX.1[dev]

商用利用: 非商用モデルであり、個人利用や非商用研究、評価目的での使用が許可されていますが、商用利用は基本的に不可です。

アクセス方法: Hugging FaceやReplicate、fal.aiを通じて利用でき、オープンウェイトとして提供されます。

品質: FLUX.1[pro]と同等の品質を持ち、効率的に画像を生成することが可能ですが、商用利用には制限があります。

FLUX.1[schnell]

最速で個人利用に適したモデル

オープンウェイトで、商用利用可能

FLUX.1[pro]は商用利用を意識した高性能なモデルであり、FLUX.1[dev]は主に研究や個人利用向けのオープンウェイトモデルになります。

FLUX.1の特徴

アクセス性と高い生成能力のバランスを取ることを目指している

高品質な画像生成と多様な出力が特徴

写真と見分けがつかないほどリアルな画像を生成可能

無料ホスティングサービス ReplicateでFLUX.1を試す

手軽に FLUX.1 を試すには、Replicate が便利です。GPU 環境の準備などは一切不要です。

このリンクにアクセスする。

プロンプト入力欄に生成したい画像を指示するテキストを入力します。例:「パンダが「AI code King」と書かれた看板を持っている」

アスペクト比を選択し、「Generate」ボタンをクリックします。

しばらくすると、生成された画像が表示されます。

Replicate は、機械学習モデルを簡単に実行できるクラウドサービスです。開発者が作成した様々な機械学習モデルが公開されており、ユーザーは Web UI や API 経由で利用できます。

Replicate を使用するのが便利なケース

手軽に機械学習モデルを試したい場合: Replicate では、コードを書かずに Web UI 上でパラメータを設定するだけで、簡単に機械学習モデルを実行できます。複雑な環境構築は不要なため、気軽に試したい場合に最適です。

GPU 環境がない、あるいは用意が面倒な場合: 機械学習モデルの実行には、一般的に高性能な GPU が必要となります。Replicate はクラウドサービスのため、ユーザーが自身で GPU 環境を用意する必要はありません。

API 経由で機械学習モデルを利用したい場合: Replicate は API を提供しており、プログラムから機械学習モデルを呼び出して利用することが可能です。そのため、アプリケーションに機械学習の機能を組み込みたい場合にも便利です。

Replicate の利点

簡単な操作: Web UI がシンプルで使いやすく、初心者でも容易に利用できます。

豊富なモデル: 画像生成、音声処理、自然言語処理など、様々なタスクに対応する機械学習モデルが公開されています。

API 提供: アプリケーションへの組み込みに便利な API が用意されています。

無料利用枠: 無料で利用できる範囲が用意されており、気軽に試すことができます。無料枠に関しては「If you’re new to Replicate, you can try us out for free, but eventually you’ll need to enter a credit card.」とだけ書かれており、具体的にどれくらいの時間を無料で利用できるかは明示されていないようです。

FLUX.1 の文脈で Replicate を使用するケース

FLUX.1 は、高品質な画像を生成できる Text-to-Image モデルですが、その実行にはある程度の計算資源を必要とします。Replicate を使用すれば、GPU 環境を準備することなく、簡単に FLUX.1 を試したり、API 経由で利用したりすることができます。

とりあえずQualityを90から最高の100にし、「photo of a Vietnamese man eating pho (traditional Vietnamese rice noodle) in the outdoor table in the local restaurant 」というプロンプトで画像生成してみましたが・・・

うーん、、、微妙笑

人物の写実的な描画が得意と聞いてたのですが、「AIが描いた」感が結構あると思います。

箸をもっている(と思われる)手の表現もちょっと分かりづらいですね。

ComfyUI と Lightning AI でFLUX.1を動作させる

より詳細な設定を行い、自由に FLUX.1 を活用したい場合は、ComfyUI と Lightning AI を組み合わせてFLUX.1を動作させるという方法もあります。

ComfyUIは、Stable Diffusionなどの画像生成AIモデルを操作するための、ノードベースのワークフローインターフェースです。GUIで視覚的にワークフローを構築できるため、複雑な画像生成プロセスを直感的に操作できます。

Lightning AI は、VS Code のようなインターフェースを持つクラウドサービスで、1 Studioまで、月間GPU使用時間22時間までを無料で利用できます。

以下は、ComfyUIとLightning AIを用いたFLUX.1の動作確認手順です。

1. Lightning AI のセットアップ

Lightning AI にサインアップします。※メール認証に数日かかります

サインアップ時に、正しい電話番号を入力しても「Invalid number」と言われる謎トラップがありましたが、Supportに連絡したら対応してもらえました。

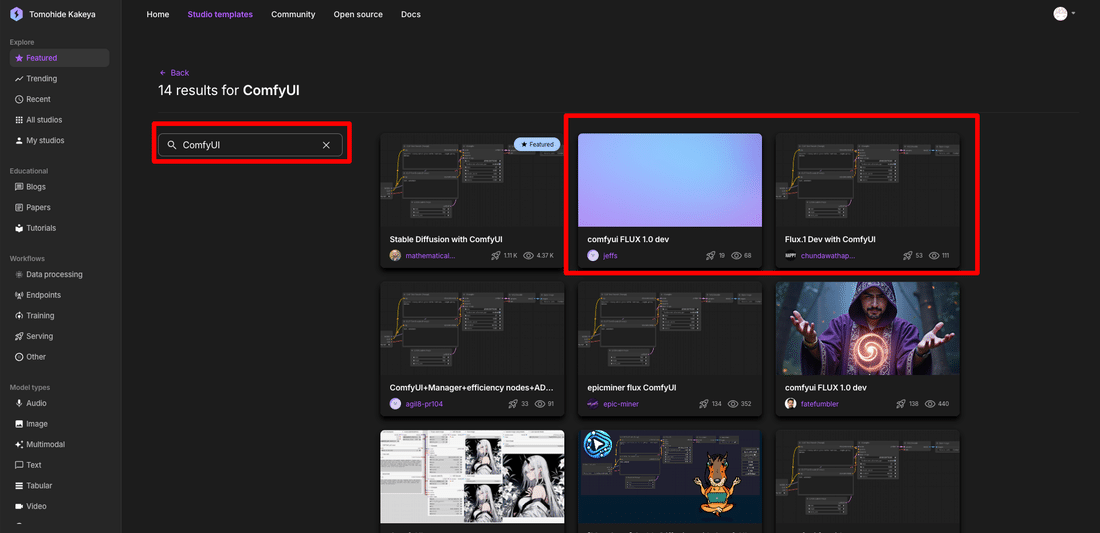

Studio Templates メニューから "ComfyUI" で検索し、FLUX.1と連携されたテンプレートがいくつか見つかりますので1つ選択し、"Open studio" をクリックします。

今回私は、「Flux.1 Dev with ComfyUI」というStadioを選択しました。

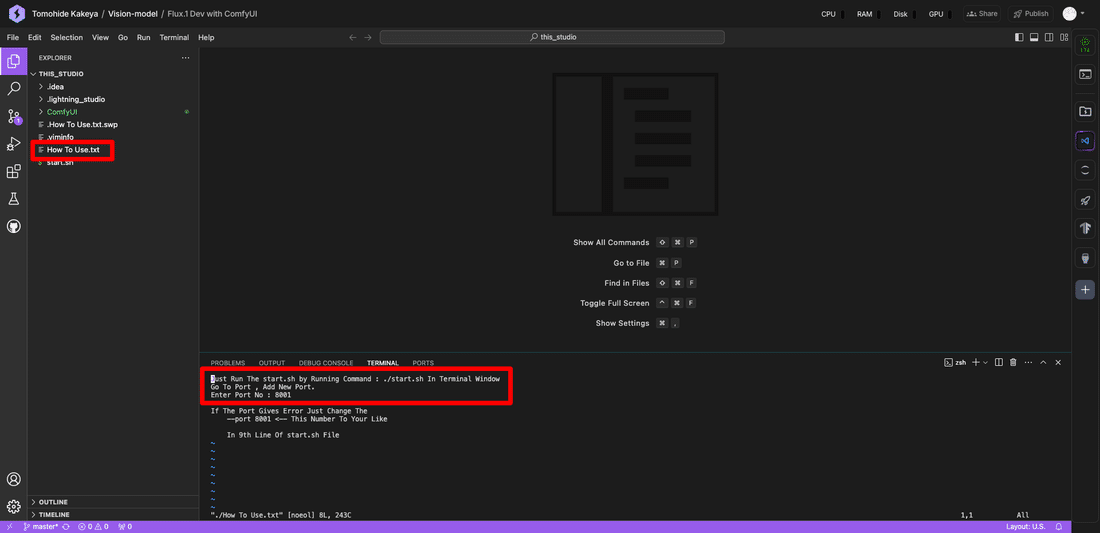

スタジオが起動したら、「How To Use.txt」というファイルがあることがわかります。ターミナルからこれを開いてみました。すると、「start.shを実行し、8001番ポートを追加するだけ」と書かれているので、実行してみます。

start.sh を実行したら、PORTSタブから8001番ポートを追加します。

その後、Fowarded Addressに表示されているURLの地球アイコンをクリックすると、別タブでComfyUIが開きます。

2. ComfyUI のワークフローでFLUX.1を実行

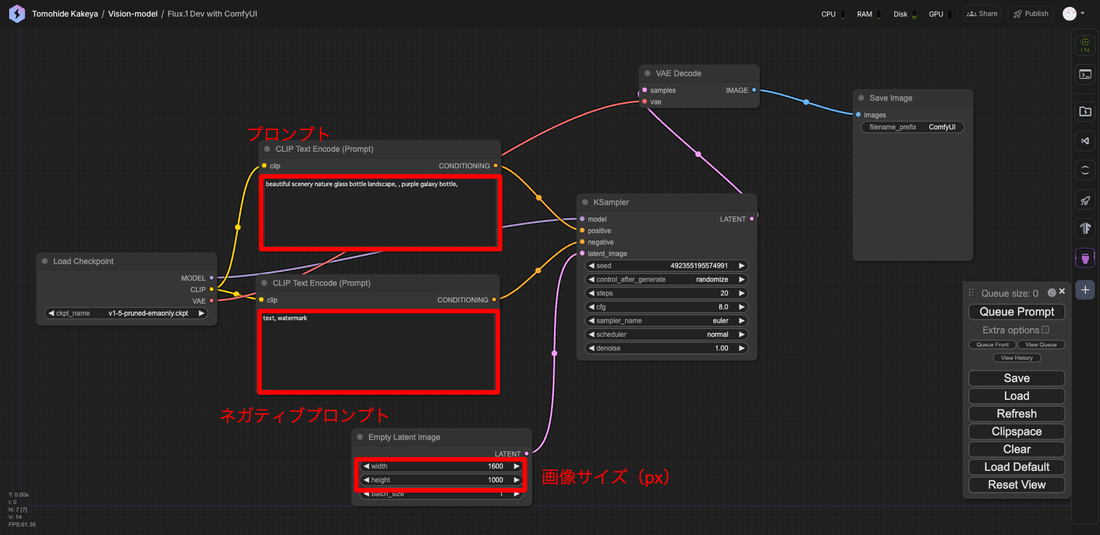

すると、ComfyUIのワークフローが開きます。このワークフローは、選択したテンプレートによって異なります。

私が選択した「Flux.1 Dev with ComfyUI」だと、以下のようなワークフロー担っていました。

プロンプトとネガティブプロンプト、画像サイズなどを設定できます。

Queue Promptをクリックすると処理が開始されます。

暫く待つと、画像が生成されます。

3. 画像生成

画像が出力されたら、画像にカーソルを合わせて右クリックするとメニューがでますので、Open Imageを選択すると、画面を拡大表示できます。

出来上がった画像ですが、、、理由がわからない笑

Stepsというパラメータがあり、それを上げるとノイズ除去の効果が上がるということだったのですが、あまり変わりませんでした。

今回はComfyUIの使用方法について調査することが目的ではないので、FLUX.1の動作を少し見たいだけであれば、Replicate で十分かとおもいました。

最後に

最後までお読みいただき、ありがとうございます!

弊社では、LLM(大規模言語モデル)やアーキテクチャの選定、技術検証、生成AIを使用したプロトタイピングやシステム開発、お客様社内での啓蒙活動等を対応させていただく「生成AIコンサルティング」サービスを提供しています。

また、業務利用できるChatGPTのような仕組みである「セキュアGAI」や、生成AIとOCRを組み合わせた「AI文書読み取りサービス」といったAIソリューションも提供しています。

ぜひお気軽にお問い合わせください!