Stable Diffusion 3.5 ControlNet 深度レビューと使用例

SD 3.5 ControlNet Depth は Flux.1 Depth の強力な代替として登場し、深度マップを通じて AI 画像生成における正確な空間制御をクリエイターに提供します。

進化し続ける AI 画像生成の分野で、Stability AI は Stable Diffusion 3.5 の ControlNet スイートで画期的な進歩を遂げました。このリリースは AI アート作成の極めて重要な瞬間であり、Black Forest Labs のFlux.1 Toolsスイートの代替として登場しました。このスイートではFlux.1 Depth がすでに強力な深度制御ソリューションとしての地位を確立しています。Flux.1 Depth と Stable Diffusion 3.5 Large ControlNet Depth はどちらも空間制御と深度操作において同様の機能を備えており、クリエイターにワークフローの選択肢と柔軟性を提供します。ControlNet Depth コンポーネントにより、クリエイターは正確な深度情報と空間認識を世代で活用できるようになり、AI を活用したビジュアル作成へのアプローチ方法が変わります。

経験豊富な AI アーティストであっても、旅を始めたばかりであっても、このガイドは、SD3.5 の ControlNet Depth を使用した深度認識画像生成を習得するためのロードマップとして役立ち、技術的な基礎から高度なテクニックまですべてを探求し、プロフェッショナル AI 画像生成エコシステムで Flux.1 Depth の代替としてどのように機能するかを理解できます。

今すぐ SD 3.5 Large ControlNet Depth ワークフローを実行してください。

SD3.5 ControlNet の深度を理解する

ControlNet Depth は、画像生成における空間関係の正確な制御を可能にする高度な調整モデルです。その中核には、ピクセルの強度がカメラからの距離に対応するグレースケール表現である深度マップを使用します。このテクノロジは、Stable Diffusion 3.5 Large モデルとシームレスに統合され、モデルが生成プロセス全体を通じて空間関係を理解して維持できるようにします。

深度マップは空間参照ガイドを提供することで機能します。明るい領域は視聴者に近いオブジェクトを表し、暗い領域は遠いオブジェクトを表します。この基本原理により、モデルは生成された画像で一貫した空間関係と正確な遠近感を維持できます。

主な特徴

このシステムの空間情報処理は、いくつかの重要な機能によって際立っています。

入力画像からの深度マップの自動抽出

正確な空間関係の維持

柔軟な構成制御

利点

Stable Diffusion 3.5 Large - ControlNet Depth により、AI 画像生成ワークフローが大幅に改善されました。

強化された空間精度:

より正確なオブジェクトの配置

より良い遠距離関係

一貫した視点の取り扱い

奥行き知覚の向上:

自然な深度グラデーション

正確な大気の遠近法

前景と背景の分離を強化

高度な構成制御:

微調整された空間配置

オブジェクトのスケーリングの改善

より自然なシーンレイアウト

これらの機能強化により、SD3.5 ControlNet Depth は、建築の視覚化から製品の写真撮影など、正確な空間制御を必要とする専門的なアプリケーションに特に効果的になります。

SD3.5 ControlNet 深度の使用方法

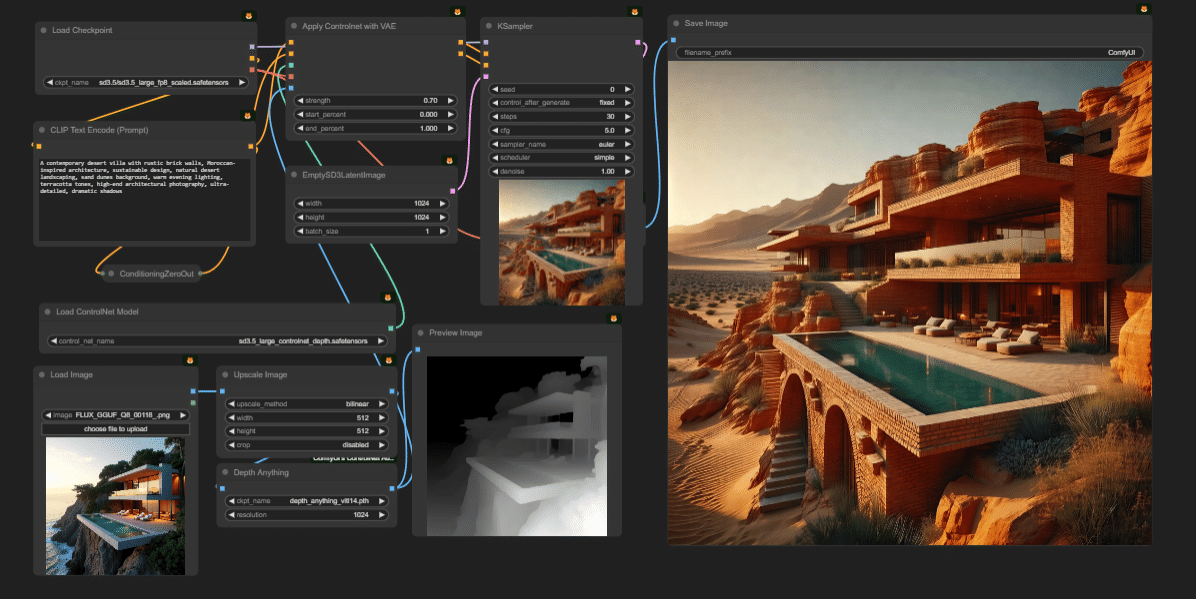

ステップ1: すぐに使用できるSD3.5 ControlNet深度ワークフローを適用する

まず、MimicPC のすぐに使用できるSD3.5 Large ControlNet Depth ワークフローテンプレートにアクセスします。システムは、ほとんどのユース ケースに最適な設定で事前構成されています。

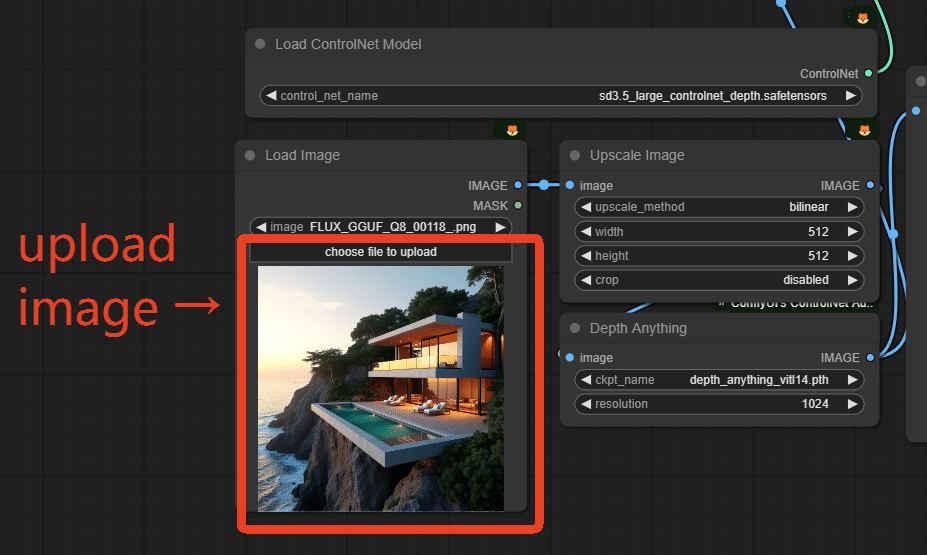

ステップ2: ソースイメージと入力プロンプトをアップロードする

インターフェイスのアップロード ボタンをクリックしてソース イメージを選択します。次に、希望するプロンプトを入力します。このプロンプトでは、生成するイメージに必要なスタイルと特性を説明する必要があります。

ステップ3: 最終結果を生成する

画像をアップロードし、プロンプトを入力したら、「キュー」ボタンをクリックするだけで生成プロセスが開始されます。システムは自動的にソース画像を処理して深度マップを作成し、元の画像と一緒に表示します。この深度マップには、ソース画像から抽出された空間情報が表示され、明るい領域は前景要素を表し、暗い領域は背景要素を表します。深度マップが作成されると、システムは深度情報とプロンプトの両方に基づいて、自動的に最終画像を生成します。

使用例と使用例

電子商取引の製品写真

プロンプト:「黒大理石に金色のアクセントが付いたエレガントなクリスタル香水瓶、超高級製品の写真、柔らかい金色の縁取りのドラマチックなサイド照明、ガラス表面の水滴、背景に浮かぶシルク生地、ガラスファセットのプロフェッショナルなマクロ詳細、高級フレグランスキャンペーンスタイル、ボリューム照明、8k 品質、プレミアム広告美学、ハッセルブラッド写真スタイル」

建築デザイン

プロンプト:「素朴なレンガの壁、モロッコ風の建築、持続可能なデザイン、自然の砂漠の景観、砂丘の背景、暖かい夜の照明、テラコッタ調、高級建築写真、超詳細でドラマチックな影を備えた現代的な砂漠の別荘」

ファッションとポートレート写真

プロンプト:「エレガントなファッション編集記事、流れるようなオートクチュールのガウンを着た若い女性、ダイナミックな動きのある豪華なシルク生地、ドラマチックなスタジオ照明、ヴォーグ誌スタイル、プロのファッション写真、映画のような構成、非常に詳細な生地の質感、ダイナミックなポーズのモデル、高級ファッションキャンペーンの美学、モダンでミニマリストな設定、完璧なスタジオ照明のセットアップ、パオロ・ロヴェルシの写真スタイル、ファッションウィークのランウェイの外観、空気のような動き、建築的なドレスデザイン、吊り下げられた生地の動き」

アニメ風/絵画風の変換

プロンプト:「ダイナミックなアニメのポートレート、サイバーパンク スタイル、大胆なセル シェーディング、ネオン リム ライティング、ハイテク要素を備えたシャープで詳細な目、鮮やかな色のコントラスト、ドラマチックな遠近感、詳細な機械要素、ホログラフィック効果、鋭角的な特徴、現代のアニメ制作品質、大胆な線画、ドラマチックな照明、非常に詳細な髪の毛、メタリックなアクセント、映画のような構成」

結論

Stable Diffusion 3.5 ControlNet Depth は、深度情報をクリエイティブ プロセスに組み込むことで、AI 画像生成を正確に制御します。この拡散モデルの実装では、深度マップを使用して画像生成をガイドし、アーティストやクリエイターが構造の一貫性を維持しながら出力を正確に制御できるようにします。深度モデルはソース画像の空間関係を分析し、生成された画像が意図した構成に従い、希望する芸術的スタイルを組み込むフレームワークを作成します。

作成を始める準備はできましたか? MimicPC は、複雑なセットアップ手順に煩わされることなく、これらのテクニックを実装するための合理化されたソリューションを提供します。クラウドベースの AI プラットフォームである MimicPC は、Stable Diffusion 3.5 Large ControlNet Depthワークフローなど、すぐに使用できるワークフロー テンプレートを提供し、プロ品質の画像をすぐに生成できるようにします。