多視点オンライン演劇「スーパーフラットライフ」の技術演出メモ

2020年4月3日と4日に生配信された多視点オンライン演劇「スーパーフラットライフ」。「親友との同性婚」というテーマも話題になりましたが、ギョーカイ関係者からは「あれ、どうやってライブ配信してるの?」「本当に“生”なの?」という声をよく聞きます。

正直、僕自身もアーカイブ映像を見たときに、カメラスイッチングや役者の演技が完璧すぎて、収録では?と感じてしまうくらいでした。それはそれで「課題」に感じました。あくまでも多視点オンライン演劇という新ジャンルを開拓したくて創り出したものなので、収録映像並のクオリティというのはありがたい話でありつつ、あくまで「ライブ感」「”今“感」を楽しんで欲しかったわけです。

そこで備忘録的に今回の多視点オンライン演劇の技術演出について、その取り組みの詳細、演出コンセプトや機材、演出技法についてまとめつつ、今後の課題についてもまとめてみたいとおもいます。「スーパーフラットライフ」を観ていただいて「あれってどうやってるの?」と疑問に思った方への「正解」として、さらにオンライン演劇をこれからやってみようというクリエーターの方にも参考になるよう機材の詳しい情報もまとめました。

(1)演出コンセプト

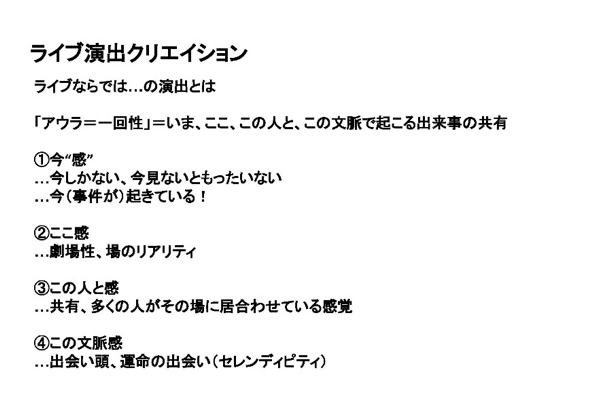

多視点オンライン演劇という新しい表現を目指すために技術演出を手伝ってくれた平瀬謙太朗(CANOPUS)と詰めていたキーワードが「アウラ(一回性)」です。当時のメモをご紹介しましょう。

アウラとは、「いま」「ここ」「この人と」「この文脈で」をいっぺんに共有する芸術体験のことで、コピーやオンデマンド配信などの再現可能な「複製芸術」と対をなす概念です。このライブの本質に立ち返りつつ、それがどこまでオンラインで実現できるのかを検討していきました。

ライブであることは、もちろんその場に居合わせられれば実感もわきますが、作品が映像であることによって普通には「いま・ここ感」を感じにくいという課題があります。どんなにライブだとしても映像というだけで視聴者は脳内で一定の距離を置きます。その中で臨場感や没入感をどう出すか。例えばワールドカップなどスポーツイベントであれば、「いま、この時間に開催されている」という事実そのものがそのライブ感を下支えするし、通常であれば、選手たちのプレイに呼応する形で盛り上がる現場の観客の歓声も、そのライブ感を強化します。

さらにスポーツではなくドラマというフィクションであることがよりライブ感から距離を置いてしまいます。ライブとは今現実に起きていること、であって、フィクションは現実には起きていないことですから、まあ、映画を観るという視聴態度を考えれば想像つくでしょう。ドラマでライブ感を出すのは難しいのです。

一方で、古来から「演劇」というスタイルは「いま・ここ」の表現形式そのものです。能楽、歌舞伎、ミュージカル、小劇場演劇などなど…。アーカイブ映像で見るとモーレツにつまらなく感じる一方で、劇場に足を運んで「いま・ここ」のフィクションを楽しむことはかけがえのない芸術体験であり、その感動があるからこそ数百年の、あるいは数千年とも言える歴史を持っているのです。

なぜ、演劇はフィクションなのにライブ感があるのでしょう?その、あたりまえのようであり、よくよく考えると不思議な「演劇性」という感動体験を改めて分析しながら、その演劇性が、劇場ではないオンラインでも活かせないか、と議論を進めました。そこで整理したのが以下です。

難しくまとめていそうで(笑)、割とシンプルな話です。

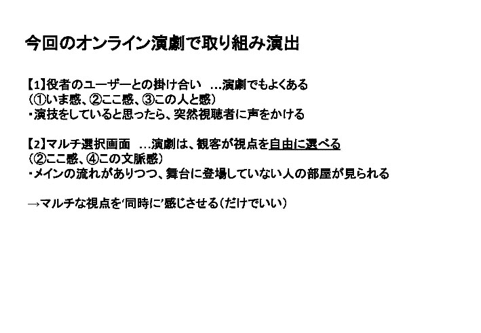

一つ目は、フィクションとしての映像をただ配信するだけでなく、適度なタイミングで視聴者を「現実」に引き戻すための演出(としての、役者との掛け合い)を加えること。この前提に「コメント」を大事にするという姿勢があります。先ほど、スポーツ・ライブでは選手のプレイに合わせて歓声が生まれるという話をしましたが、まさにこのステージ上の動きに呼応する視聴者側の反応こそ「ライブ」を感じる重要な要素と考え、そうであるならばオンラインコンテンツの最大で最強のUIである「コメント機能」を最大限活用しようということになりました。もちろん、やり過ぎるとドラマへの没入感もなくなってしまうためドラマの構成において「暗転」のタイミングでコメントを呼びかけたり、役者が突然視聴者に絡んだりするタイミングをある程度緻密に計算しながら設計していくことに。

二つ目は「マルチ選択画面」。演劇と、映像作品との決定的な違いは「視点を選べること」。映像のドラマはきほん、役者の動きも表情も監督が撮影・編集された特定のカットをみることになります。そのカット割りの妙が映像作品の作品性を強化するのですが、いっぽう演劇は、役者がいる「場そのもの」を重視します。重視というか、ステージ上で演技をしているので、どうにもこうにも、役者だけでなくステージ全体が丸見えなわけです。主役が相手役に愛の告白をするとき、視聴者は主役の方を見るか、相手役の表情を見るか、はたまた全然関係なさそうな舞台の端に立つ脇役を見るか自由に視点を選べます。この「視点を選べる」という視聴者優位の構造は、実はその場の空間性、つまり「ここ」感を強化しているんじゃないかと思うし、現場で起きているというライブ感に近い感覚を得られるのではないかと。それを映像で再現するのであれば、画面上に複数のカメラによる画を用意しておき、視聴者がそれを自分で選べることで実現できるのではないかと。

参考にしたのはリプチンスキーの有名な動画「NEW BOOK」です。リプチンスキーについて語り出すとそれはそれで一本NOTEが書けてしまうので割愛します(笑)。以下の映像をじっくりご覧頂くことで、一つの現象を多視点で描くことで空間性というか、その場で起きている感が強化されていることに気付くはずです。

しかし、その上で、視聴者が画面を能動的に選べるようなUIまでは採用しませんでした。いろいろ議論したんですが、視聴者にクリックをさせて画面を選ばせる行為って、けっこう「面倒だよね」というシンプルな理由です。多視点を描いて空間性を強化することは残しつつ、画面を選ぶほどに視聴者に過度な行動を供給することはしないというバランスを重視しました。

ちなみに視聴者の参加度を高めてよりフィクションの世界へ没入させる手法として「イマーシブ演劇」というジャンルがあります。New Yorkの「Sleep No more」が有名ですが、日本でもイマーシブな演出を実践する劇団や劇作家の方はいらっしゃって、それはそれでオンライン演劇との相性も良いです。例えば「リアル脱出ゲーム」で有名なscrapは、コロナ禍でオンラインでの没入エンタメをいち早く開発し反響を得ています。一昨年から立ち上がった「泊まれる演劇」もオンラインにシフトして視聴者を集めています。イマーシブ演劇は演劇ジャンルとしてのポテンシャルも高いですし、エンタメとしてとても面白いです。ただ、サスペンスなどのジャンルでの良いものの僕が描きたかったテーマ「新しい結婚観」というテーマへの感情移入という点では相性が良くない気がしましたので演出手法としては取り入れませんでした。

(2)多視点の設計

というわけで、ライブ感、「いま・ここ」感を出すために「コメント」と「多視点」という演出コンセプトを掲げ、特に「多視点」ではシェアハウスを舞台にしながら屋内はもちろん、屋外、ZOOMなどのツール上での画面を含めて様々な視点をいっぺんに(シーケンスの中で自然に)同時体験できる手法を目指すことにしました。描かれた「画」のバリュエーションはこちらのトレーラーでだいたい描かれていますのでご覧ください。

それを実現するための環境・技術を準備していくわけですが、以下では場所、仕組み、機材などなどより実践的な情報をお届けしましょう。

(2-1)場所の選定

さて、今回エリとトモコが住むシェアハウスが舞台の中心となるのですが、その場所探しに苦労しました。条件として

①エリとトモコの各部屋と集まれるリビングがある2LDK以上の間取り

②近くに機材が設置できるコントロールセンターや役者の楽屋などのスペース

③光回線が固定回線として使えること

④あわよくば他の役者の待機場所もあること

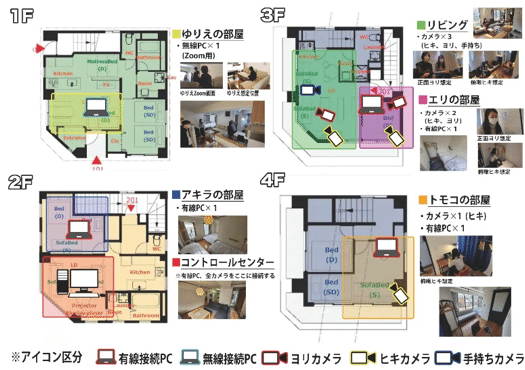

これらの条件を満たす場所が奇跡的に見つかりました。都内某所にあるアパート式のレンタルハウスがあって、そちらの大屋さんにご協力をいただき1階から4階までをまるっと貸し切ってメインの舞台はもちろんスタッフルームやマモルやアキラの部屋までを1つのスペースに収めることが出来たんです。

こちらがその外観です。この一棟の中で設計した構成図がこちらです。

3,4階がメゾネット式の3LDKになっていて、ここをメインの舞台としリビングルーム、トモコの部屋、エリの部屋に合計5台のカメラを設置。2階がコントロールセンターでスイッチングや配信機材を集中。空いた部屋をアキラのメインルーム兼マモルの待機部屋に。1階がメイクルーム(楽屋)とゆりえの登場する部屋に。もう完璧と言っていいほどのスペース配分でした。このアパートでなかったらどうなっただろうと…。

(2-2)機材構成

多視点を実現するための「画」ですが以下のような構成になっています

①シェアハウスの屋内にある5つの定点カメラ

②途中臨場感を出すための手持ちカメラ

③ZOOMやスペシャでのやりとりを表示するエリのPC画面

④アキラをzoomでつなぐPC

⑤ゆりえをzoomでつなぐPC

⑥屋外から中継するマモルやトコモのスマホ

⑦スペチャ参加者の各端末

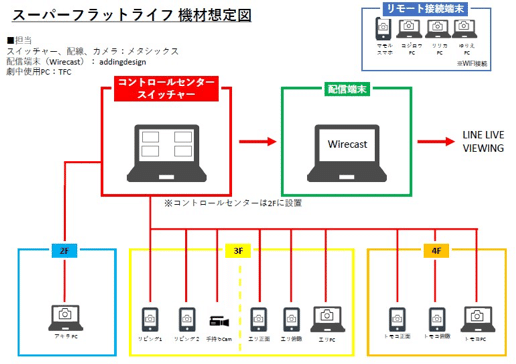

これらのうち、⑦は収録で行ったため(後述)、ライブでは①~⑥の系統をネットワーク化してコントロールセンターに集約しました。それがこちらの図です。

もともとHarumari TOKYOでは様々なライブ配信をプロデュースしていたため機材設計は慣れたものでしたが、流石にこれだけの量のカメラやPCをつなぐのは初めてで、まして演劇としてドラマの進展に合わせて画面をスイッチングしていくテクニックも必要でした。そこで今回は、テレビの技術演出にも長けたメタシックスさんの超優秀な技術スタッフに協力を仰ぎました。今回の完璧すぎるスイッチング展開は彼らあってこそのクオリティです。

今回使った機材類の一部を紹介していきましょう。

◆定点カメラ

定点カメラで使ったのはiPhone。すべて11以上スペックで揃えました。カメラレンズの性能で言えばほかにもすぐれたスマホは沢山あるのですが、いろいろ使って見ると、特にライブ配信に関しては暗い箇所での照度のコントロールや自動フォーカスなどをAIがしっかり調整してくれて他と比べものにならないくらい映像が安定します。

◆ビデオカメラアプリ

ビデオカメラアプリはAirmix soloを使用。せっかくのiPhoneの広角レンズが活かせないのは残念ですが挙動の安定性とATEMとの相性はこれが一番。その後、FilMic PROが11proと12proで広角対応になったので一応試してはみました。挙動も安定はしていたのですが、今回、アングルチェックする中でそこまで広角じゃなくてもいけるかな、ということで採用しませんでしたが次回以降に試してみようと思います。

◆HTMIケーブルと電源について

今回、3.4階に設置した定点カメラを有線で2階のスイッチャーに接続したわけですが、議論ポイントになったのがケーブル類。iPhoneは純正コネクターもあって、かつ後述するATEMとの相性からいってもHDMIケーブルなのですが、基本的にHDMIは5mまで。それ以上の長さであると不具合の可能性も高くなる。そのため、一部カメラはコンバーターでSDIに変換の上接続。手持ちカメラについても機動性を意識して業務用のカメラでSDI接続としました。

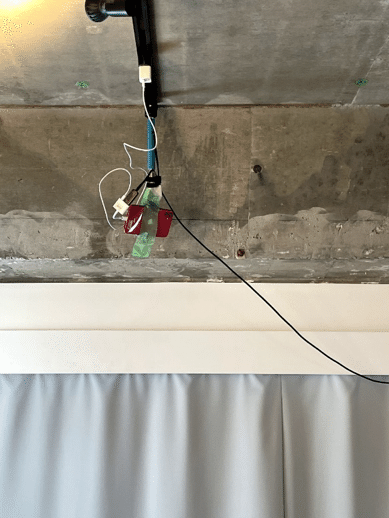

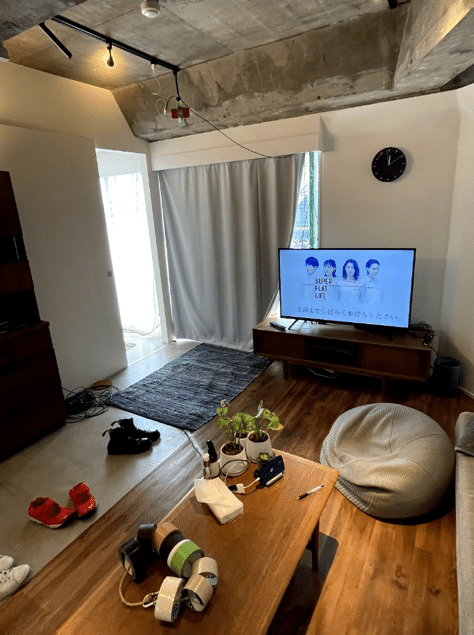

助かったのが電源。3時間近くiPhoneを起動しっぱなしなので当然バッテリーが持たない。今回のアパートを選んだ理由が、レール型の照明であったこと。このレールがあれば、俯瞰カメラ用のiPhoneをハンドクリップで固定するのはもちろん、レール用コンセントを使って至近で給電できたことが大きい。

これだけの機材となると込み入った配線となり、カメラの画角に見切れないようにケーブルを這わすのは困難。そんな中、このレール型照明の仕組みはほんと助かりました。

◆PC類

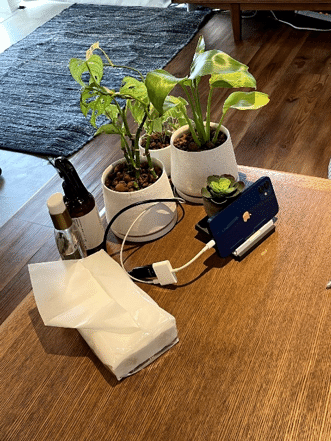

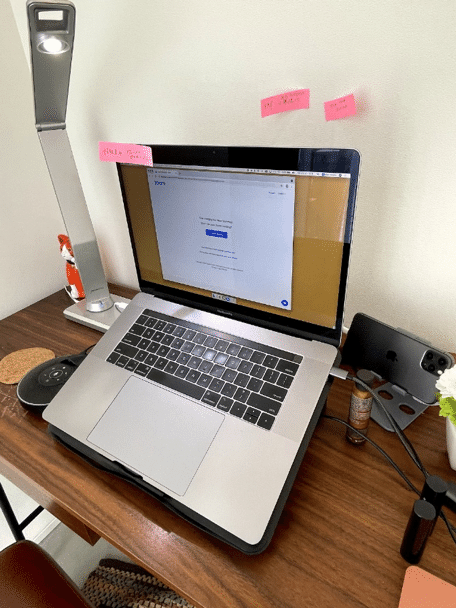

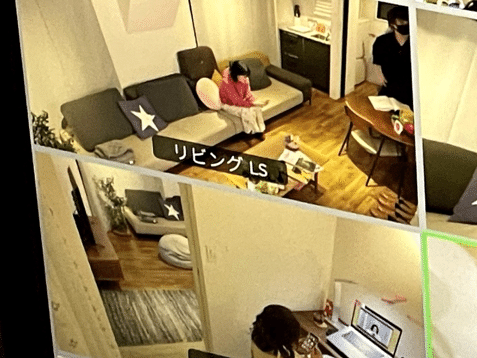

役者がZOOMやスペチャで会話をしている画面を写すために使ったのはもちろんMac Book Pro。電源供給と熱にさえ気を付ければサクサク動いてくれました。特にエリが使うPCは、ドラマででてくるほとんどのPC操作画面に使用します。この写真のとおり、実際にエリが使用していたPCからHDMI経由でスイッチャーに取り込んだのと、ZOOMなどの会話は写真右下のスピーカーフォンで出したモノをピンマイクで拾う形に。音声は役者自身のピンマイクと、このMacからでる音声を拾ったモノとをシーンに分けて切り替えながら進行していました。

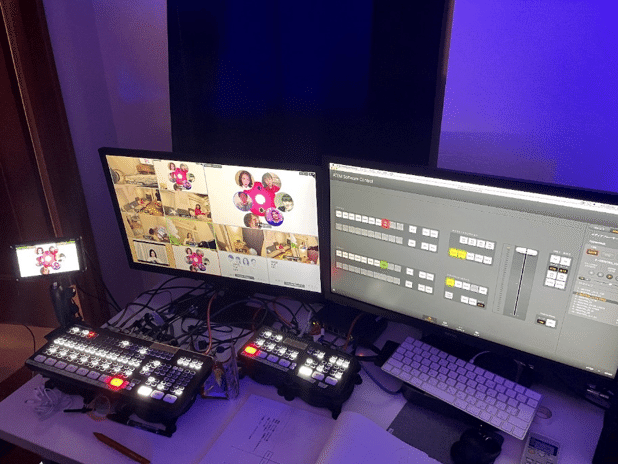

◆スイッチャー類

コントロールセンターに設置したスイッチャーはBlackMagicのATEM。今回8系統以上の配線となったため、最近出たばかりのStreamをベースにしつつ、4系統のMineもHUB的に使用。Miniだと出力ができないので、今回のようなスイッチングを管理するならやはり出力を2系統もっているStreamがないと厳しいですね。これ以外に、サブだしVTR用のMacとモニタなども用意しましたがそこは割愛します。

★OBSについて

こうした画面割りやシーン展開はOBSのプラグインを使っても近い形での表現は可能なことは分かっていました。しかし、配信のキモでもあるOBSとその搭載端末にスイッチングの負荷までかけてしまうと、そのPCが落ちた途端にすべてが終わる(なにも出来なくなる)ため、リスク分散のためにも今回は配信端末と演出端末をわけてコントロール。結果、正解だったと思います。また、OBS自体も今回は使わずLINEさんの指定であったWirecastを使用しました。

★回線について

配信回線はお借りしたアパートに常設されていた光回線を使用。ONUから直接ケーブルを引いて使いました。上り回線のスピードがすこぶる良かったのでとても安定していましたが、バックアップのためにTVUルーターを使用。常設の光回線といくつかのSIMでバンドルして配信していました。

また今回分かったのがいくら固定回線のスピードがあっても無線接続は本当に危険。今回、ZOOMやスタッフの連絡端末など沢山の端末を無線でつないでいたこともあって、とても不安定でした。なぜか、外から4Gも繋がりにくくなってしまうという事態に。

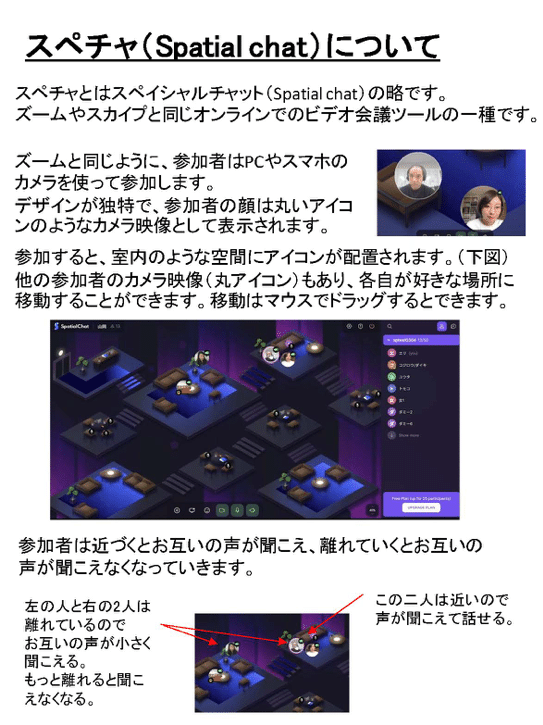

(2-3)スペチャ(spacialchat)

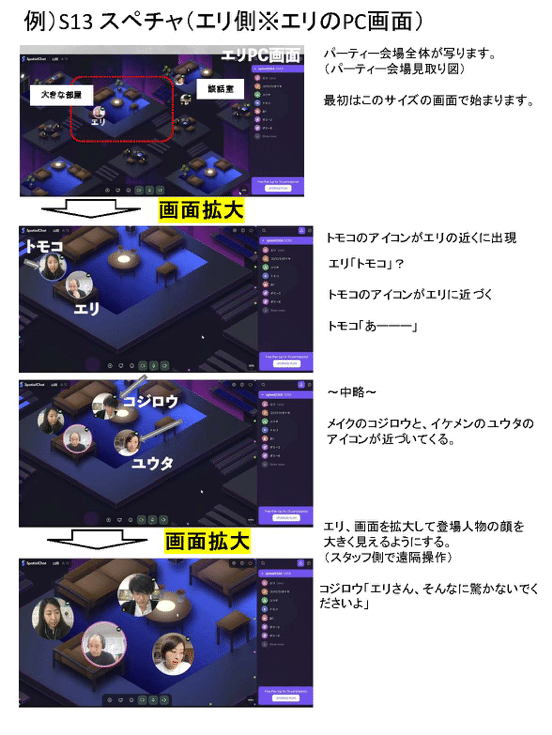

劇中のオンライン婚活パーティの時に使用したビデオ共有プラットフォームがSpacialChat、通称スペチャです。まだ日本では浸透していないですが、zoomとちがって、参加者の音声が、アイコンの距離でコントロールできたり、UIが洗練されていたりとコロナ禍の中でいちぶマニアに注目を集めていました。今回、演出的にも面白そうなので採用。

しかし、これを役者さんたちになれてもらうのが大変でした。演技指導とは別に「スペチャ講習会」なるものをやったりして…w。その時の資料をご紹介します。これ読むとスペチャの操作方法もわかります。

なお、本編で写していたスペチャの画面はエリのPCではなく、「運営」と称して同じ会場にログインしていたスタッフのmacを画面に取り込みました。スペチャはユーザー単位(PC単位)で表示画面のサイズや位置を変えられるわけですが、流石に秋元才加さん(エリ役)に演技しながら画角調整までしてもらうのは難しいための対応となりました。その他、秋元さんには、純粋にエリとしてPCを操作してもらっていたのですが「念のため」の対応としてエリPCに、スタッフが遠隔操作できる環境を創っておき、ZOOMのアクセスやLINE通話に出るといった行為はスタッフが遠隔でエリのPCを操作する形で進行していました。

例えばこのゆりえとエリのZOOMのシーンでは、アキラに対してチャットする動きは、スタッフがエリのPCを遠隔操作して入力しています。対するアキラもそれに手投入で返しています。この遠隔操作にもタイムラグがあったりして、役者と息を合わせて良きタイミングでチャットをうつ練習はなんども繰り返しやっていました。

また苦労したのが演者たちの通信環境の確保でした。メインキャスト以外は自宅や所属事務所のオフィスからアクセスしてもらったのですがどうも通信が不安定で。実際、本番でも「カクカク」したり音声と映像にディレイが起きたりと不安定極まりなかったのですが、それはそれで逆に「生でやっている感」がでて結果良かったのかも知れません。

なお、このシーンの一部はライブではなく収録で行いました。演者のスケジュールの都合と、何かあったときのリアルタイム対応が遠隔地だと難しいと判断したためです。でも、この演劇当初はあえて遠隔地をつなぐことをトライしてみたかったというのもあり、次回は挑戦したいですね。

参考までにリハーサルの様子です。スタッフのぼやきとともに。(笑)

(3)多視点演出

先述の機材を駆使するとATEMに集約された各画面は写真のような感じになります。

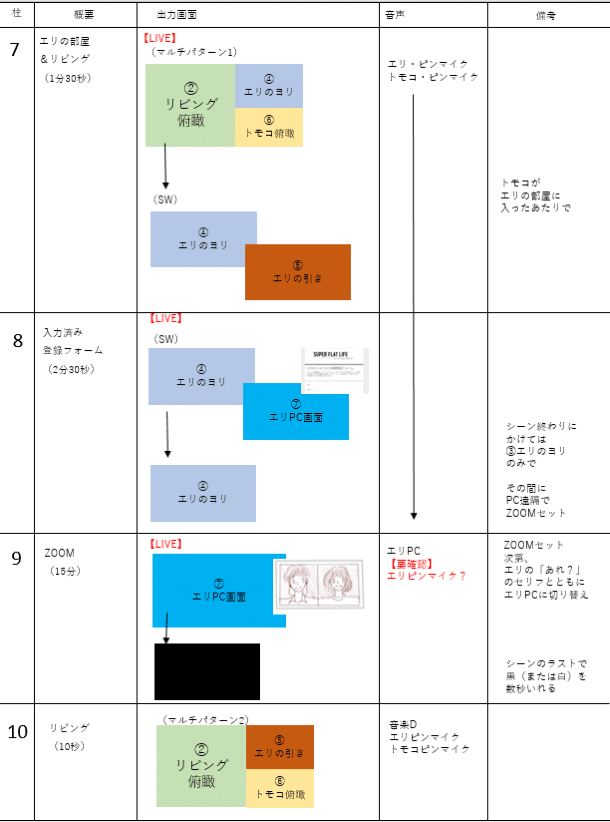

このライブ映像に、サブだしのVTRを含めてドラマの展開に合わせて配信する画面をスイッチしていくわけです。それはもう、地上波のテレ番組並かそれ以上の細かい構成を組みました。台本に合わせてベースとなる画面割りをシートにまとめつつ、現場の役者の動きに合わせて「いい画」を選んでアドリブでスイッチング。これをできるスキルはやっぱりライブ映像の技術演出になれたスタッフでないとできません。今回、内製でできなかったところでもあり、メタシックスの鬼スイッチャーさんの技術のたまものです。しっかり盗ませてもらいましたwので、次回はうちのオペレーションディレクターに挑戦させたいところ。

構成の表、いわゆる「バラシ表」の画面割り版はこんな感じで整理していました。

画面のスイッチングだけでなく、音声も「役者のピンマイク」「VTR音声」「エリのPCの音」「BGM」とパターンがあってそれらも明記。技術を入れた打ち合わせは本番前たった3回しかなく、初回の通しリハではいきなり通信トラブルがあったりと地獄を見ましたが、ほんと本番はほぼ完璧でした。

ちなみにライブ中はカメラの死角にテレビモニターがあって、演者はそこで配信画面を確認できるようになっていました。

また、スイッチング後の演技のタイミングなども死角に隠れたAPさんが小声で「次のシーンまで10秒前、9.8.…」とカウントしていたんです。コントロールセンターとAPはトランシーバーでつないで全体進行を共有。役者はAPさんの声で全体の状況を把握。仮に通信トラブルや役者のセリフが飛んでしまったりといった状態になった場合に2階にあるコントロールセンターのフロアディレクターである僕から3,4階にいる役者たちへの連絡系統もちゃんと用意していたのです。結局、なんのトラブルもなかったのでその指示系統をつかうことはなかったのですが。。。

さてさて、語りたいことはまだ沢山。また改めてこちらの記事に追加していきたいと思っております。オンライン演劇を運営していたり、これから挑戦しようとされる方に参考になる情報になれば幸いです。逆に、ここはどうやったの?といったご質問があればぜひコメント欄に。可能な範囲でお答えします。