Claude3とGPT-4どちらが上か、あるいはタケノコの里

みなさんこんにちは。ケンブリッジ・テクノロジー・パートナーズでコンサル兼テクニカル・アーキテクトを担当している広沢です。

Claude3という生成AIのモデルをご存じでしょうか。

2024年3月4日にAnthropic社が公開したモデルで、GPT-4を上回る能力があるということで話題になっています。

Claude3の解説については様々な記事が出ているので、ここでは割愛して、今回の記事ではClaude3がどれほどの能力があるのかを「文章のコンテキスト理解」という側面で実際に検証した内容を公開したいと思います。

Anthropic社の公式解説ページ

https://www.anthropic.com/news/claude-3-family

結論

文章の正しい理解という観点において、Claude3(Opus)が頭1つ超えた

AnthropicのベンチマークだとClaude3は83.1ポイントで、GPT-4は80.9ポイントで2.2ポイント差だが、この数字以上の差があるように見える。

具体的にはClaude3は文章を「文字ずら」での理解ではなく「文章のコンテキスト」をとらえ本質的な理解をしているように見える。

各モデルのポジショニングは下図のとおり

(応答ごとに回答の質がバラつくので幅を持たせた評価としています)能力と費用のコスパ分析については別の記事を書いているのでそちらもご覧ください。

Claude3とGPT-4をコスト面から比較、コスパが良いのはどのLLM?

検証観点

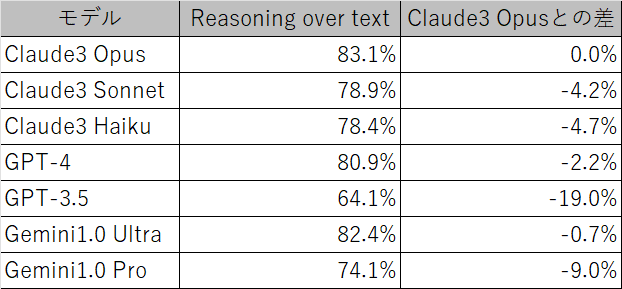

LLMの能力をどのように評価するかという点ですが、Anthropic社が公開している、性能評価のうち、「Reasoning over text(DROP, FI score)」に着目しました。

この評価項目は「Wikipediaの記事から数値推論、日付や期間推論、複数の段落にまたがる推論、省略された情報の推論の正答率」を測定するベンチマーク項目です(下図の青枠の個所)。

簡単にいうと、「与えられた文章を読み解き内容を理解する能力」と言えると思います。

この観点に着目したのはLLMのユースケースでは、チャットボットや要約などが多くのケースで求められていて、このユースケースで正しく応答したり内容を要約するには「文章を正しく理解する」ということが避けて通れないためです。

Reasoning over text(DROP, FI score)のベンチマークのみを取り出すと下表になります。今回発表されたClaude3のうち最も性能が高いOpusのモデルと比較すると、GPT-4とは-2.2ポイントの差で僅かな差となっています。

GPT-3.5と比べると-19.0ポイントと大きなさが出ていることが分かります。

実際に検証してみて、この数字の差がどのように表れるのかを検証したいと思います。

なお、Claude3の前身であるClaude2.1との比較は前述のベンチマークでは測定されていませんでしたが、難しい問題に対するClaude3と2.1の正解率・不正解率・回答不可率の比較が掲載されており、これを見ると、かなり改善されていることが見て取れます。なのでClaude2.1はGPT-3.5くらいでしょうか。

検証方法

ということで、前置きが長くなりましたが、いよいよ検証方法について説明したいと思います。

冒頭でも少し触れましたが、生成AIのユースケースのうち多くを占めているのがチャットボットや要約などになります。私たちの会社でも要約や情報検索などでの使用を検討しています。

ですので、生成AIの文章の理解力を検証していきたいと思います。

検証範囲

検証範囲は以下の6つを対象とします。

それぞれの生成AIがどう応答を返してくれるか楽しみですね。

Claude3 Opus(最上位モデル)

Claude3 Sonnet(バランスモデル)

Calude3 Haiku(速度重視モデル)

GPT-4

GPT-3.5

Claude2.1(Claudeの前世代モデル)

検証方法

検証方法としては、とあるブログ記事(弊社VPのブログ)をインプットに記事を弊社の社員(コンサルタント)にどのような点がおすすめなのかを説明してもらいます。

全てのモデルに同じ記事・同じプロンプトで実行することにより、各モデル間の能力の違いを判定します。

対象の記事は以下の記事を利用させていただきました。

記事の内容はざっくりこんな感じ。

冒頭で「満員電車で本を読むなら空気を読もう」ということについて、「何か面白いことをやるなら空気を読まずに本を読むべき」だと伝えている。

特にお客さんとの業務改革で施策を検討するうえで、新たな発想をするためには「異物」であることが大切である。

最も手っ取り早く「異物」になるためには、本を沢山読むことだ。

筆者は「You are what you read.」という言葉を使い、「人間は、読んだものの結果でしかない」と言い読書を勧めている。

プロンプトは全てのモデルで以下を使用する。

以下の<doc>をインプットに下部に記載する指示に従い回答してください。

<doc>

~~ここにブログ記事のテキストを貼り付ける~~

</doc>

あなたはコンサルティングファームのディレクターです。

<doc>のブログを以下の要件に従い回答してください。

- 若手コンサルタントが読みたくなるような推薦文とする

- 推薦文は400文字以内とする

- 結論はかかず、ブログを読みたいと思わせる文章とする

検証を行う際のポイントは以下としています。

記事約2,000文字の文章を400文字に要約した際の内容の適切さ検証する

※400文字というのは「要点を省略しすぎず、だらだら全て書かない文字数」というのを検証しながら調整した文字数です。「結論は書かず読みたくなるような推薦文」と指示することで、記事の一番重要な部分を識別できているかを検証する

また、生成AIは同じプロンプトを投げても毎回回答が変わります。

なので、5回実行して一番代表的な回答をしたものを採用しました。

検証結果

各モデルに同じプロンプトを投げた結果とその評価を記載します。

Claude3 Opus

<LLMの応答>

若手コンサルタントの皆さんへ

変革プロジェクトで重要なのは、お客様に新しい視点と価値を提供すること。そのためには、業界の常識に囚われず、"異物"であり続けることが大切です。

それを実現する最も手っ取り早い方法は、多様な分野の本を読むこと。満員電車の中でも、空襲下でも、本を読み続けることが、私たちコンサルタントに求められています。

また、お客様と同じものを読むのではなく、あえて違う本を選ぶことで、ユニークな視点を培うことができるでしょう。

"You are what you read." - 私たちは読んだものの結果なのです。

コンサルタントとして成長するヒントが詰まったブログを、ぜひ一読ください。

<評価>

要約された内容の正確性 :★★★★★

重要な要点の抜け漏れのなさ:★★★★★

依頼した要件の適合性 :★★★★☆

記事の内容を正しく把握し、依頼に対して回答できています。

コンサルとしての価値を出すために異物であることの必要性や、その解決法としての読書、そして、あえて違う本を読む点。

また、"You are what you read."というキーワードを抜き出している点。

正直、自分自身でもこの推薦文を書くのはとても時間がかかると思いました。

強いていえば、「読みたい」と思わせるような書き方は足りないかもしれません。

Claude3(Sonet)

<LLMの応答>

コンサルタントとして成功するには、常に新しい視点を持ち続けることが不可欠です。このブログは、そのための素晴らしいヒントが詰まっています。

本を読むことの意義、知識を得ることの大切さが力強く訴えられています。ビジネスの常識にとらわれず、異物となることで新たなアイデアが生まれる、という指摘は示唆に富んでいます。

更に興味深いのは、自分が"読んだもの"そのものになるという指摘です。読書が自分自身を形作るという視点は、コンサルタントとしての在り方を考える上で参考になるはずです。

このブログを読めば、知的好奇心を刺激される一方で、コンサルタントとしての本質的な問いにも直面することでしょう。常に新しい視野を求め、成長し続けたいコンサルタントにとって、ぜひ一読をおすすめします。

<評価>

要約された内容の正確性 :★★★☆☆

重要な要点の抜け漏れのなさ:★★★★★

依頼した要件の適合性 :★★★★☆

Opusの回答と一見遜色ないように見えます。異物になることがなぜ大切かであったり、読書が自分自身を作るという視点など重要な要素が集約されています。

ただ、Opusと違うのは各内容の関連(つながり)が書かれていない点が残念なところです。具体的には「異物となる点が重要」ということと、「読んだ本がその人を形成する」という観点が繋がっていません。

一見筋が良さそうな回答ですが、情報が繋がっていないため、納得度が高くならない文章だと感じます。

Claude3(Haiku)

<LLMの応答>

若手コンサルタント各位、

この度ご紹介するのは、当社の「施策立案トレーニング」の中で高い評価を受けている一本のブログ記事です。ご覧いただければ、企業変革のための「根源的アプローチ」の着想が得られるはずです。

著者は、35年にも及ぶ満員電車通勤の経験から、「空気を読まず本を読み続けること」の重要性を説きます。単なる常識の踏襲ではなく、異質な視点を獲得するための「読書」の価値を、こと細かく述べています。特に印象的なのは、「You are what you read.」という言葉。読書が人間形成に大きな影響を与えるという指摘は、私たちコンサルタントにとって、きっと新鮮な視点を提供してくれるはずです。

この他にも、ロンドン大空襲時の写真を巧みに引用しながら、「知的営みを止めてはいけない」というメッセージを込めています。まさに、変革期における「精神的支柱」の在り方を示唆する内容といえるでしょう。

ぜひ一読いただき、お客様とのディスカッションにも活かしていただければと思います。変化の時代を勝ち抜くための、大変示唆に富む一本だと確信しています。

<評価>

要約された内容の正確性 :★☆☆☆☆

重要な要点の抜け漏れのなさ:★★★☆☆

依頼した要件の適合性 :★★★☆☆

内容に誤りが一部見受けられます(「施策立案トレで高い評価を受けているブログ」という紹介)。確かに単語としては登場してきているので、文章を誤った形で繋げたことで発生しているようです。

また、重要な点として取り上げる箇所の筋が悪いということから、要約・アドバイスとしてはイマイチな文章となっています。

GPT-4

<LLMの応答>

このブログは、ビジネスの世界で抜本的な変化を起こすためには、周りに迎合するだけでは不十分であることを力強く訴えています。

作者は、満員電車での読書や、ドイツ空軍の爆撃にも負けず本を読み続けた人々の姿勢から、異物であることの価値を説きます。コンサルタントとして客観的な視点を保ち、革新的なアイデアを提供するには、常識にとらわれない多様な知識が必要です。

日経新聞だけでなく、「コンテナ物語」や「最悪の事故が起こるまで人は何をしていたのか」のような、他では見つけられない本を読むことの重要性を強調。読書を通じて、あなた自身の考えを形成し、ビジネスにおける革新の火付け役になることの鍵を握っています。

興味深い視点と、人とは異なる知識を身につけたい若手コンサルタントにとって、読むべき一冊です。

<評価>

要約された内容の正確性 :★★★★☆

重要な要点の抜け漏れのなさ:★★★★☆

依頼した要件の適合性 :★★★★☆

内容は400文字以内に比較的正しく凝縮されています(中身をそれほど理解せず、重要そうなキーワードを繋げた印象)。

ただし、異物であることの価値と、なぜそれが必要なのか(コンサルの価値)を関連付けて説明できていません。

筆者が好きな言葉でこの記事の重要な要素である「You are what you read.」に関連する記載がなく、匂わせて読みたいと思わせるところもない点が残念でした。

GPT-3.5

<LLMの応答>

「施策立案トレーニング」を通して、ビジネスを変革するための斬新なアイディアを得るための秘訣が、このブログに凝縮されています。著者は異端の視点からビジネスにアプローチし、日常の中に潜む価値を見出すことの重要性を説きます。

また、満員電車の中で本を読み、戦時下のロンドンの写真を通じて、知的な活動の重要性を訴えます。その言葉からは、他者と異なる視点を持ち、新しいアイディアを生み出すことがビジネスにおいて如何に重要かを感じさせられます。

このブログは、若手コンサルタントにとって、新たな視点を得るきっかけとなること間違いありません。

<評価>

要約された内容の正確性 :★☆☆☆☆

重要な要点の抜け漏れのなさ:★☆☆☆☆

依頼した要件の適合性 :★★☆☆☆

日本語として成り立っているものの、内容は正しく理解できていないようです。「施策立案トレーニング」を通じての示唆ではなく、コンサルが異物となり価値を出すという要素が正しく書かれておらず、ミスリードをするような内容になっています。

また、他者と異なる本を読むこと、それが人を作るという一番重要な要素がまったく抜け落ちてしまっています。

総じて、「AIだから多少の誤りは許容する」という次元を下回っており「使い物にならない回答」という感じです。

Claude2.1

<LLMの応答>

若手のみなさん、このブログはぜひ読んでください。

ディレクターが実際に経験した「本を読み続けることの大切さ」が熱く語られています。満員電車での読書体験から、クライアントとのコミュニケーションにおける「異物であることの重要性」まで、私たちコンサルタントにとって大切なことがたくさん詰まっています。

特に「You are what you read」という言葉は胸に刺さりました。人は読んだものの結果なのです。みなさんが今後どんなコンサルタントになるかは、今から何を読むかにかかっているのです。

ぜひこのブログを読んで、自分が目指すコンサルタント像を考えてみてください。きっと新たな発見があるはずです。

<評価>

要約された内容の正確性 :★☆☆☆☆

重要な要点の抜け漏れのなさ:★★☆☆☆

依頼した要件の適合性 :★★☆☆☆

日本語としては成り立っていますが、内容の取り違え(異物であることがコミュニケーションに大切となっている)があったり、なぜそれが大事なのかという点が省かれてしまっています。

また、文と文の間が繋がっていないため、分かりにくく納得感も得られない文章になってしまっているように感じます。

考察

結果まとめと総評

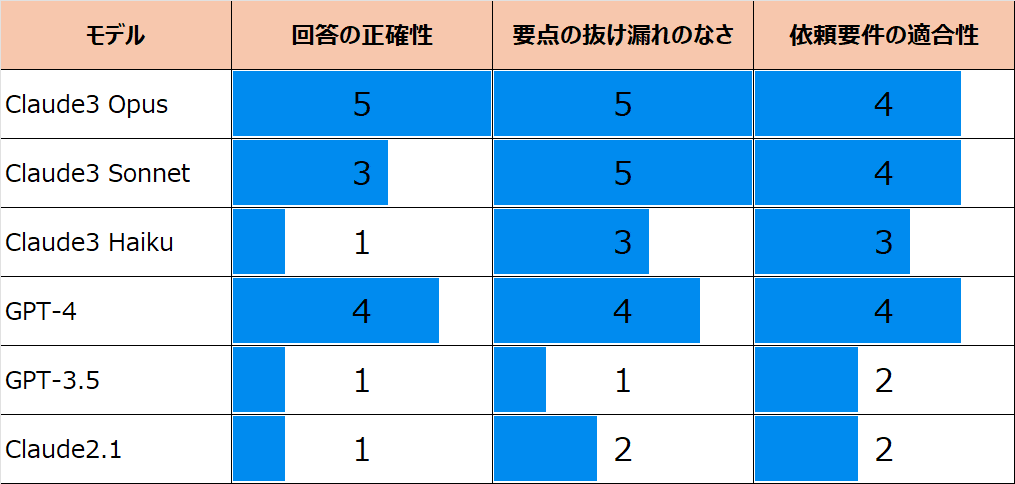

結果をまとめると、以下のようになります。

総評としてClaude3 Sonnetが頭一つ抜けた結果となりました。

Claude3 SonnetとGPT-4はポイント上は同率となっていますが、5回の回答をそれぞれ比較すると、わずかにGPT-4の方が良い回答をしているようでした。

各モデルを一言で総評した結果が以下となります。

これらの結果を踏まえたポジショニングが冒頭で掲載した以下の図です。

GPT-4がローンチされたのがちょうど1年前(2023年3月14日)。

生成AIがさらに進化したことを感じました。

GPT-4との差はAnthropicのベンチマークだと2.2ポイントでしたが、回答内容をじっくり見るとその点数以上の差があるように感じました。

(検証内容や検証方法による差異かもしれません)

なお、弊社ではLLMをシステムに組み込もうとしているのですが、AWSを使っているので、可能ならAmazon Bedrockで使えると便利なのですが、Claude3 Opusはまだ使えず、使えるのは「Sonnet」、「Haiku」になってしまうので悩ましいところ。Opusも数週間でローンチされるという噂もあるので、早く来てくれることを望んでいます(切実)。

少し引いた目線で見ると

2022年11月のChat GPTの衝撃から約1年半でGPT、Claude、Gemini(Bard)、Copilot(MS)、LLaMA、PaLM、ELYZAなどなどなど、テキスト系生成AIだけでも数え上げられないくらい新バージョンがローンチされてきました。

まさに「雨後の竹の子」状態です。どんどん良いものが出てくるので、現在はClaude3が抜けていますが、すぐにGPTが追い越すでしょう。もしくは新たなLLMが出てくるかもしれません。

一つ一つキャッチアップして、自社のユースケースに合うものは取り入れて、必要に応じてモデルをスイッチしていくのが良いのかなと思います。

3/21追記

2024年夏にGPT-5が出る予定との報道がでました。

また性能改善されるはずなのでここで、Claude3のリーダーポジションに逆転が起きるんだろうなとワクワクしています。

OpenAIの次世代大規模言語モデル「GPT-5」が2024年夏に公開されるとの報道

LLMはいろいろ検証のしがいがあるので、今後も別の観点で検証していきたいと思います。長い記事になりましたが最後まで読んでいただきありがとうございました。

なお、冒頭でも書きましたが能力と費用のコスパ分析については別の記事を書いているのでそちらもご覧ください。

この記事が気に入ったらサポートをしてみませんか?